【Java性能调优宝典】:从JVM调优到代码层面的极致优化

发布时间: 2024-09-22 06:54:41 阅读量: 85 订阅数: 78

# 1. Java性能调优概述

在软件开发领域,性能调优一直是一个热门且复杂的议题。随着技术的发展和应用的普及,Java作为一门成熟的编程语言,在企业级应用开发中占据了重要的地位。随着Java应用的复杂度不断增长,系统性能往往成为决定产品成功与否的关键因素。Java性能调优不仅包括对Java虚拟机(JVM)参数的调整,还涉及代码层面的优化以及系统架构上的改进。

性能调优是一项系统工程,它要求开发者具备对Java应用程序、JVM工作原理、操作系统特性、硬件资源等多个方面的深刻理解。调优过程往往需要通过工具对运行时的行为进行监控和分析,才能发现系统瓶颈,进而在算法、代码、虚拟机参数等多个层面进行优化。

本章将为读者提供一个Java性能调优的概述,旨在帮助读者理解性能调优的基本概念、流程以及在日常开发中所处的地位。我们将从JVM的结构和性能监控工具的基础知识开始,逐步深入到代码层面的性能优化方法,最后通过实战案例来展示性能调优的应用。通过对本章内容的学习,读者将对Java性能调优形成一个系统性的认识,为后续章节的深入学习打下坚实的基础。

# 2. 深入理解JVM和性能调优基础

## 2.1 Java虚拟机(JVM)结构

### 2.1.1 堆内存与非堆内存的划分

Java虚拟机(JVM)内存管理是性能调优的核心内容之一。在JVM中,内存主要分为堆内存和非堆内存。堆内存是JVM所管理的最大的一块内存空间,它主要用于存放新创建的对象实例。堆内存的分配和回收操作比较频繁,因此调优时应优先考虑堆内存的优化。

堆内存的结构包括几个主要部分:新生代(Young Generation),老年代(Old Generation),和持久代(PermGen,Java 8之后被元数据空间Metaspace替代)。新生代用于存放刚刚创建的对象,其中还细分为Eden区和两个Survivor区。对象首先在Eden区分配,当Eden区满时,会触发一次Minor GC(年轻代垃圾收集),然后将存活的对象移动到Survivor区中。老年代则用于存放生命周期较长的对象,当老年代满时,会触发一次Major GC(完全垃圾收集),释放内存空间。

非堆内存指的是除堆内存之外的内存区域,主要包括方法区、直接内存和JVM内部处理或优化所需的内存(如JIT编译器优化后的代码缓存)。方法区用于存储类信息、常量、静态变量等数据。JVM在启动时,会分配一定量的直接内存(Direct Memory)作为缓冲区使用,这可以提高I/O操作的性能。

### 2.1.2 垃圾回收机制与收集器选择

JVM的垃圾回收机制是自动内存管理的关键部分,其目的是为了释放不再使用的对象占用的内存空间,以供新对象使用。垃圾回收算法复杂多样,JVM垃圾收集器的具体实现也有所不同,但基本原理相同。在调优时,选择合适的垃圾收集器至关重要。

垃圾回收机制主要涉及以下几个方面的选择和调整:

- **垃圾收集器类型**:常见的有Serial GC、Parallel GC(包括Throughput Collector)、CMS(Concurrent Mark Sweep)GC、G1 GC(Garbage-First Garbage Collector)和ZGC(Z Garbage Collector)。每种收集器都有其适用的场景和优缺点。

- **内存区域**:不同代之间垃圾收集的触发条件,例如新生代的Eden和Survivor区的大小比例,老年代的大小等。

- **触发时机**:垃圾收集的触发时机,比如Eden区空间不足时触发Minor GC,老年代空间不足时触发Full GC等。

在生产环境中,推荐根据应用的特点选择合适的垃圾收集器,例如对于响应时间要求极高的应用,可以选择G1 GC或ZGC,它们提供了更好的停顿时间控制;而对于吞吐量要求高的应用,Parallel GC是较好的选择。

## 2.2 JVM性能监控工具

### 2.2.1 常用性能监控工具介绍

在进行JVM性能调优时,使用合适的监控工具可以对系统的性能瓶颈进行准确的定位。以下是几个常用的JVM性能监控工具:

- **jstat**: Java虚拟机统计监控工具,可以用来监视垃圾回收统计信息以及堆内存使用情况。

- **jmap**: Java内存映射工具,可以用来生成堆转储快照(heap dump),分析内存中对象的统计信息。

- **jstack**: Java堆栈跟踪工具,可以用来获取线程的堆栈跟踪信息,辅助排查死锁等问题。

- **VisualVM**: 一个集成多种功能的工具,可以监控本地和远程JVM的性能,提供内存、线程、JMX信息的监控等。

- **JConsole**: Java监视和管理控制台,它是Java开发工具包的一部分,用于监控Java应用程序和JVM的性能。

### 2.2.2 性能监控数据的分析与解读

监控到的数据需要通过适当的工具或方法进行分析,以识别系统瓶颈和性能问题。比如,使用jstat工具可以查看到垃圾回收的频率和回收时间,如果发现频繁的Full GC,可能意味着老年代内存设置过小,或者存在内存泄漏。

使用VisualVM进行内存监控时,如果发现堆内存使用率不断攀升,且无明显下降趋势,可能说明存在内存泄漏。这时候,通过生成堆转储文件,然后使用内存分析工具(如MAT,Eclipse Memory Analyzer Tool)进行分析,找到内存中的大型对象和引用链,可以有效地识别和定位问题。

在解读监控数据时,还需要结合业务特点和系统配置来综合判断。比如系统负载高的情况下,频繁的GC可能并不一定需要优化,因为GC本身在处理大量对象的生命周期时也是需要消耗资源的。

## 2.3 JVM调优策略

### 2.3.1 内存调优技巧

内存调优是JVM调优中非常重要的一部分,其主要目的就是确保JVM有足够的内存以避免频繁的Full GC,并且能够高效地利用现有资源。以下是一些内存调优的技巧:

- **合理配置堆内存大小**:堆内存的大小配置应根据应用的实际需求和硬件资源进行调整。可以使用`-Xms`和`-Xmx`参数来设置堆内存的初始值和最大值。通常建议将最大堆内存设置为不超过物理内存的1/4。

- **调整新生代和老年代的比例**:通过`-XX:NewRatio`参数可以调整新生代和老年代的比例。合理调整比例可以减少GC的频率和停顿时间。

- **使用合适的垃圾收集器**:根据应用的特点选择最合适的垃圾收集器。例如,对于需要快速响应的应用,可以使用G1 GC或ZGC等,这些收集器能提供更可预测的停顿时间。

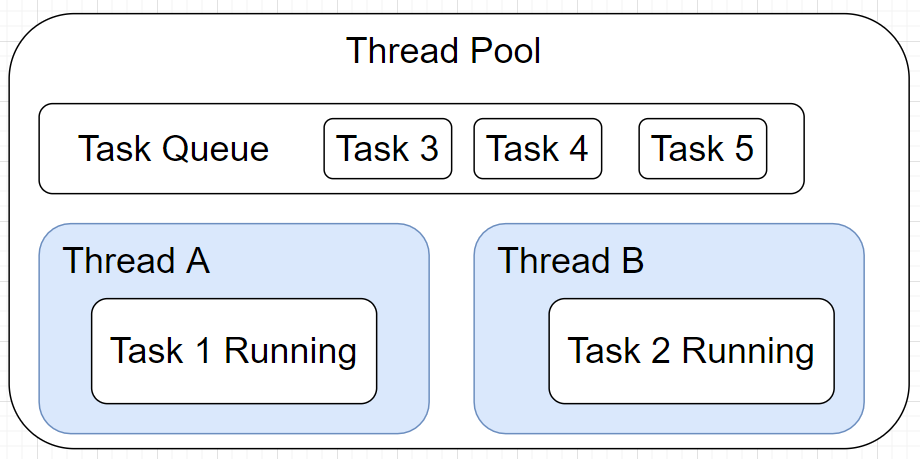

### 2.3.2 线程池与并发调整

线程池是控制并发线程数的一个重要工具,合理的线程池配置可以有效提高系统的性能和稳定性。在JVM中,可以通过调整线程池的参数来优化并发性能:

- **设置合适的线程数**:线程池的大小设置应根据CPU核心数以及业务的并发需求来决定。一个常见的公式是:线程数 = CPU核心数 * 目标CPU利用率 * (1 + 平均等待时间 / 平均工作时间)。

- **调整线程池任务拒绝策略**:当线程池达到饱和状态时,需要有策略来处理新提交的任务。JDK提供了一些内置的拒绝策略,比如`AbortPolicy`(默认策略,直接抛出异常)、`CallerRunsPolicy`等,也可以根据需要自定义拒绝策略。

- **使用并发工具类**:在多线程环境下,合理使用并发工具类(如`java.util.concurrent`包中的`CountDownLatch`、`CyclicBarrier`、`Semaphore`等)可以有效提高性能。

通过调整JVM和应用的参数,合理配置内存和线程资源,可以有效地提升Java应用的性能。接下来的章节将会继续深入到代码层面的优化,以及具体的实战案例分析,帮助读者更全面地理解和掌握Java性能调优的技能。

# 3. 代码层面的性能优化

## 3.1 算法优化

### 3.1.1 数据结构的选择与使用

在软件开发中,选择合适的数据结构对于性能优化至关重要。正确的数据结构不仅可以简化代码逻辑,还能大幅度提高程序的运行效率。比如,在需要快速查找的场景下,使用哈希表(HashMap)通常要比使用链表(LinkedList)快得多。在需要排序的场景下,数组和链表的排序算法复杂度也会大不相同,快速排序、归并排序适合数组,链表更适合插入排序。

下面的代码示例展示了如何在Java中根据不同的使用场景选择合适的数据结构:

```java

import java.util.*;

public class DataStructureChoice {

public static void main(String[] args) {

// 使用ArrayList存储和访问数据

List<Integer> arrayList = new ArrayList<>();

// 使用HashMap存储键值对数据

Map<String, Integer> hashMap = new HashMap<>();

// 向ArrayList中添加数据

arrayList.add(10);

arrayList.add(20);

// 向HashMap中添加数据

hashMap.put("key1", 1);

hashMap.put("key2", 2);

// 从ArrayList中获取数据

int value = arrayList.get(1);

// 从HashMap中获取数据

Integer valueHashMap = hashMap.get("key1");

}

}

```

在上述代码中,使用`ArrayList`来存储整数列表,对于随机访问非常有效。如果需要频繁地插入或删除操作,则可以考虑使用`LinkedList`。对于需要快速查找的场景,比如判断某个值是否存在,使用`HashMap`会比使用`ArrayList`中的`contains`方法更高效。选择合适的数据结构能够显著提升性能,尤其是当数据量庞大时。

### 3.1.2 常见算法优化案例分析

在算法设计和优化方面,一些常见问题可以通过特定的算法改进来解决。例如,在处理大数据量时,排序算法的选择至关重要。传统的冒泡排序的时间复杂度为O(n^2),而快速排序(Quick Sort)和归并排序(Merge Sort)则能将时间复杂度降至O(n log n)。在实现时,需要注意算法的选择,并且对数据进行基准测试以确认最佳的排序算法。

另一个案例是在字符串操作中,使用`StringBuilder`比使用`String`对象拼接更高效。因为`String`对象是不可变的,每次拼接操作都会

0

0