【多维数据故障预测】:CNN-BiLSTM的策略与实践

发布时间: 2024-11-17 00:50:46 阅读量: 50 订阅数: 44

# 1. 多维数据故障预测简介

## 1.1 故障预测的重要性

在IT行业中,系统的稳定性和可靠性至关重要。多维数据故障预测利用历史数据来预测未来可能出现的问题,从而提前采取措施,减少系统故障带来的损失。为了提升预测的准确性,需要采用先进的算法和技术。

## 1.2 多维数据的特点

多维数据通常指的是具有多个特征和变量的数据集合。这类数据在时间、空间等多个维度上具有复杂的相关性和变化规律。它广泛存在于各种传感器数据、网络流量监测、服务器日志等领域。

## 1.3 故障预测的挑战

故障预测面临的一个主要挑战是处理大规模、多维的数据集。此外,数据的噪声、不平衡性和非线性特征等都会影响预测结果的准确性。因此,选择合适的模型和算法对于故障预测至关重要。

## 1.4 CNN-BiLSTM技术引入

CNN(卷积神经网络)擅长提取空间特征,BiLSTM(双向长短时记忆网络)则能够处理时间序列数据中的长距离依赖。CNN-BiLSTM模型结合了这两种网络的优势,能够有效地从多维数据中学习和预测,是当前多维数据故障预测的研究热点。

# 2. CNN-BiLSTM理论基础

### 2.1 CNN技术概述

#### 2.1.1 卷积神经网络的起源与发展

卷积神经网络(Convolutional Neural Networks, CNNs)是一种专为处理具有类似网格结构数据而设计的深度学习架构,尤其在图像和视频识别领域取得了巨大成功。其起源可以追溯到20世纪80年代和90年代初,Yann LeCun和他的同事们提出的反向传播算法和卷积网络架构。然而,直到2012年AlexNet在ImageNet大规模视觉识别挑战赛中胜出后,CNNs才真正进入公众视野,引起了广泛关注。

CNN的快速发展离不开大规模数据集和强大计算能力的支持。其发展历程展示了深度学习技术如何逐渐优化并解决实际问题。近年来,随着深度学习框架和算法的不断进步,CNNs已广泛应用于各种复杂的模式识别任务中,从视觉识别到语音识别,再到自然语言处理。

#### 2.1.2 CNN在数据处理中的应用

CNN通过模拟人类视觉系统的工作原理,使用卷积层来提取输入数据的特征。该特性使CNN在图像识别、视频分析和自然语言处理中表现出色。例如,在医学图像分析中,CNN可以协助医生检测疾病特征,提高诊断的准确性。此外,CNN也广泛应用于自动驾驶车辆中,用于实时处理和理解道路图像。

### 2.2 BiLSTM技术概述

#### 2.2.1 长短时记忆网络的特点

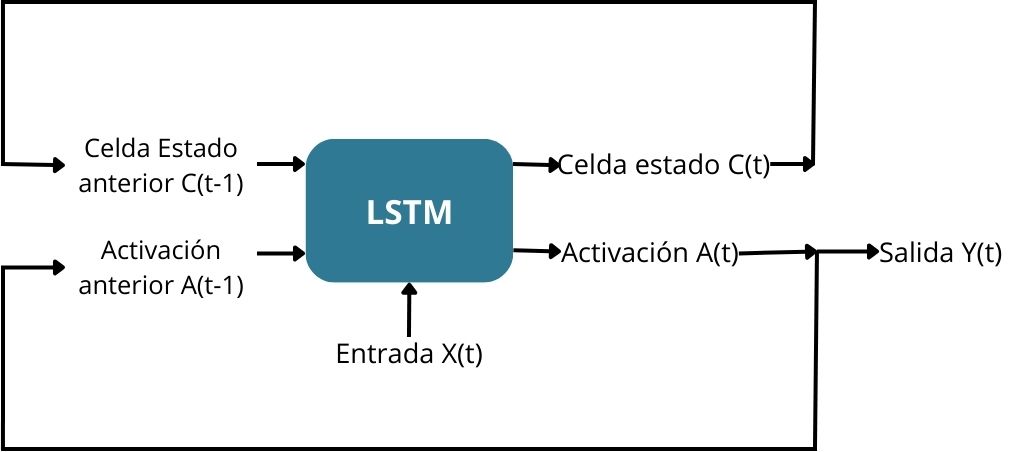

长短时记忆网络(Long Short-Term Memory, LSTM)是一种特殊的循环神经网络(Recurrent Neural Network, RNN),设计用来解决传统RNN在处理长序列数据时出现的梯度消失或梯度爆炸问题。LSTM通过引入门控机制,能够学习序列数据中的长期依赖关系。

LSTM的核心是三个门结构:遗忘门、输入门和输出门。它们共同工作,动态地控制信息的流动和保留,使得LSTM可以在必要时保持或舍弃信息。这一特性赋予了LSTM处理长序列数据的能力,使其在语音识别、机器翻译和文本生成等领域表现出色。

#### 2.2.2 双向LSTM结构与原理

双向LSTM(BiLSTM)是LSTM的一个变种,它由两个方向相反的LSTM层构成。正向LSTM逐个处理输入序列中的数据,而反向LSTM以相反的顺序处理相同的数据。通过这种方式,BiLSTM能够结合过去和未来的上下文信息,从而提供一个更加全面的数据表示。

这种结构特别适合于需要考虑整个序列上下文的任务,如情感分析和命名实体识别。例如,在情感分析任务中,一句话的最终含义可能需要结合上下文中的某些关键词,而BiLSTM能够在整个句子的上下文中准确捕捉这些依赖关系。

### 2.3 CNN与BiLSTM的结合

#### 2.3.1 结合CNN和BiLSTM的优势

CNN和BiLSTM结合的模型,即CNN-BiLSTM,能够同时利用CNN在特征提取上的高效性和BiLSTM在处理序列数据上的强大能力。这种混合架构特别适用于处理既需要从输入数据中提取复杂特征,又需要理解数据序列长期依赖关系的任务。

例如,在多维数据故障预测中,CNN能够有效地从传感器数据中提取关键特征,而BiLSTM则可以利用这些特征来理解时间序列数据中的模式,预测未来的潜在故障。CNN-BiLSTM模型通过这种方式,能够为复杂的预测任务提供精确的输出。

#### 2.3.2 构建CNN-BiLSTM模型的理论基础

构建一个高效的CNN-BiLSTM模型需要理解模型中各部分的作用和它们之间的相互作用。CNN层负责捕捉数据的空间特征,而BiLSTM层则从时间维度上捕捉序列特征。在构建这种模型时,需要仔细选择每一层的参数,如卷积核的大小、数量、LSTM单元的数量等。

此外,模型的输入层需要进行适当的数据预处理,如归一化或标准化,以保证数据的特征尺度一致,从而提高模型的训练效率。在模型的输出层,可以根据任务需求选择适合的激活函数和损失函数,例如在分类任务中常用softmax函数作为激活函数,并配合交叉熵损失函数。

在接下来的章节中,我们将详细探讨CNN-BiLSTM模型的构建、训练、调优和实际应用,为读者提供一个全面的理论和实践框架。

# 3. CNN-BiLSTM模型构建与优化

## 3.1 模型架构设计

### 3.1.1 CNN层的设计原理

卷积神经网络(CNN)是深度学习领域中非常重要的模型之一,它在图像和视频识别、图像分类、医学图像分析、自然语言处理等方面表现优异。CNN的设计原理基于人类视觉系统的生理结构,它通过模拟人类视觉皮层处理视觉信息的方式来提取图像特征。

CNN层的核心组成部分为卷积层,其通过多个小型滤波器(核)对输入数据进行卷积操作,以捕捉局部特征。每个卷积核在输入数据上滑动,计算其与数据片段的点积,从而得到一组特征映射(feature maps)。通过不断堆叠卷积层和激活层,CNN能够逐层从简单到复杂的提取数据中的特征。

从技术角度来讲,CNN层的设计需要考虑:

- 卷积核的大小、数量以及步长。

- 激活函数,常见的有ReLU, sigmoid, tanh等。

- 是否使用池化层(Pooling Layer),以降低特征图的空间尺寸,减少参数数量和计算量。

- 正则化策略,比如dropout,以避免过拟合。

### 3.1.2 BiLSTM层的配置方法

双向长短时记忆网络(BiLSTM)是一种特殊的循环神经网络(RNN),其通过分别在时间序列的两个方向上运行两个独立的LSTM网络,从而获取序列的前向和后向上下文信息。BiLSTM能更好地捕捉序列数据中的时序特征,尤其适用于处理具有时间关联性的数据。

在设计BiLSTM层时,需要考虑:

- 隐藏层的数量和大小,即LSTM单元的数量和每个单元中记忆单元的数量。

- 序列处理的初始状态,例如是否使用零向量作为初始状态。

- 序列数据的批处理方式,以及序列的最大长度。

BiLSTM层的配置方法通常涉及到数据的形状和批处理的维度。在构建模型时,需要保证输入数据的维度与BiLSTM层所期望的维度相匹配。

## 3.2 模型训练与验证

### 3.2.1 数据预处理和批处理

数据预处理是深度学习模型训练的一个重要环节,主要包括数据清洗、归一化、标准化、去噪等步骤。对于多维数据,还可能包括特征选择和降维技术的应用。预处理的主要目的是提高模型的学习效率和预测准确性。

批处理则涉及到将数据集分成多个小批次,在每个批次上进行模型训练。这种方法可以有效地利用内存资源,提高GPU的利用率,并且有助于减少过拟合的风险。

在CNN-BiLSTM模型中,数据预处理可能包括:

- 将数据转换为张量格式,以满足模型输入要求。

- 对于时间序列数据,需要填充或

0

0