迁移学习在语音识别领域的创新实践:技术与应用

发布时间: 2024-11-19 19:40:26 阅读量: 25 订阅数: 38

2020人工智能与机器学习创新峰会PPT汇总.zip

# 1. 迁移学习与语音识别概述

## 1.1 迁移学习的定义和发展历程

迁移学习是机器学习领域的一个分支,它允许知识从一个任务转移到另一个任务,从而加速学习过程并提高在目标任务上的性能。从简单的特征提取方法到复杂的深度学习模型,迁移学习经历了由浅入深的发展过程,逐渐成为推动人工智能技术发展的关键力量。

## 1.2 语音识别技术的原理

语音识别技术的核心是将人类的语音信号转换为机器可理解的文本。这个过程包括了信号的采集、预处理、特征提取、模型训练和解码识别等步骤。近年来,随着深度学习技术的应用,语音识别技术取得了突破性进展,尤其在准确性、实时性和适应性方面。

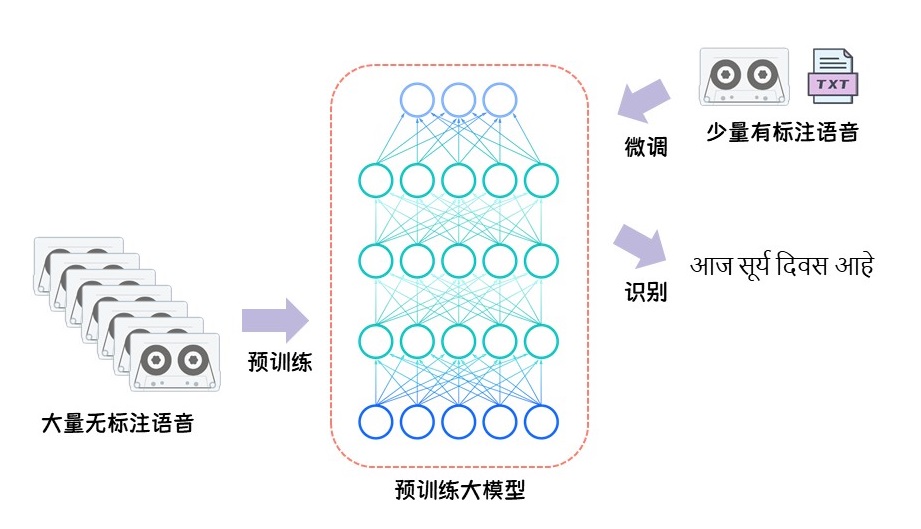

## 1.3 迁移学习与语音识别的结合

将迁移学习应用于语音识别领域,可以解决传统方法中的一些局限性,例如数据依赖性强、训练时间长等问题。通过迁移学习,可以在已有知识的基础上优化模型,使其能够更快地适应新的语言环境或特定任务,从而提升语音识别系统的整体性能。

# 2. 迁移学习在语音识别中的理论基础

### 2.1 迁移学习的核心概念

#### 2.1.1 迁移学习的定义和发展历程

迁移学习是一种机器学习方法,它通过将一个问题的知识应用到另一个相关问题,以改善学习效果。这一理念最早可追溯到20世纪90年代,其背后的动机是克服传统机器学习方法在处理新问题时所需的大量标记数据和计算资源。迁移学习的关键在于知识的迁移,通过在不同但相关的任务间转移知识,实现对目标任务性能的提升。

迁移学习的发展历程与深度学习的兴起密不可分。随着神经网络的深入应用,研究人员发现预训练模型能够在多个任务中复用,从而极大地减少了训练时间和所需的数据量。迁移学习的演进可分为几个阶段:

- 初期:基于实例的迁移,利用相似任务中的实例直接迁移。

- 发展:特征表示学习,通过预训练深层网络提取特征。

- 成熟:基于模型的迁移,尤其是预训练模型加微调(Fine-tuning)的方法成为主流。

#### 2.1.2 迁移学习的主要模型和方法

迁移学习的核心在于模型参数的迁移。根据迁移的粒度和方式,迁移学习模型和方法可以大致分为以下几种:

- **实例迁移(Instance-based Transfer)**:直接迁移部分训练样本到目标任务,常用于数据增强。

- **特征表示迁移(Feature-representation Transfer)**:迁移深度学习模型中的低层特征或高层特征表示,使得模型可以利用源任务学到的有用特征。

- **参数迁移(Parameter Transfer)**:迁移模型参数或参数的一部分,例如迁移预训练的神经网络权重。

- **关系迁移(Relation Transfer)**:迁移不同任务间的数据分布和关系。

- **策略迁移(Policy Transfer)**:迁移学习策略和优化方法。

### 2.2 语音识别技术的原理

#### 2.2.1 语音信号的处理和特征提取

语音信号处理是语音识别的第一步,其主要目的是将语音信号转换为可由计算机处理的数字形式。这涉及到以下几个步骤:

1. **采样和量化**:将模拟语音信号转换为数字信号,这是通过以一定频率采集连续的语音信号样本,并将每个样本转换为数字值完成的。

2. **预加重和窗函数处理**:提高高频部分的能量并减少边缘效应,这通常通过预加重滤波器和窗函数实现。

3. **分帧和加窗**:将连续的数字信号分割成若干小帧,并给每帧应用窗函数以减小帧边界的不连续性。

4. **特征提取**:从每一帧中提取出有代表性的特征,常用的特征包括梅尔频率倒谱系数(MFCCs)和线性预测编码系数(LPCs)。

#### 2.2.2 语音识别模型的构建

语音识别模型的核心任务是将特征表示的语音信号转换为文本。构建模型通常涉及以下步骤:

1. **声学模型**:通过统计方法或深度学习模型来构建,能够从特征中学习到语音信号与文字之间的映射关系。

2. **语言模型**:利用自然语言处理的知识来预测词序列出现的概率,这对于识别结果的准确性至关重要。

3. **解码器**:将声学模型和语言模型结合在一起,通过搜索算法找到最可能的词序列。

语音识别模型可以基于不同的技术构建,包括隐马尔可夫模型(HMM)、深度神经网络(DNN)、卷积神经网络(CNN)、循环神经网络(RNN)以及最近非常流行的长短时记忆网络(LSTM)和Transformer模型。

### 2.3 迁移学习与语音识别的结合

#### 2.3.1 迁移学习在语音识别中的优势

将迁移学习应用于语音识别领域具有以下优势:

- **减少数据需求**:迁移学习允许使用较小的数据集进行训练,从而节约数据收集和标注的时间与成本。

- **提高模型泛化能力**:通过预训练模型学习到的丰富特征表示,有助于模型更好地泛化到新的任务或领域。

- **加快训练速度**:利用预训练模型作为起点,可以在较少的迭代次数内快速达到较高的性能。

- **改进性能**:预训练模型通常在大规模数据集上进行训练,因此能够捕获更丰富的语音特征。

#### 2.3.2 实现语音识别中的迁移学习策略

实现迁移学习的关键策略包括:

- **模型选择**:选择合适的预训练模型和目标任务,以确保两者间有足够的相关性。

- **迁移层次**:根据任务的相似度,确定迁移特征、层或整个模型。

- **微调策略**:根据目标任务的特性调整微调的策略,包括学习率、优化器的选择以及训练周期。

- **正则化和组合**:使用正则化技术如dropout来防止过拟合,并探索模型集成以增强模型性能。

通过以上策略,迁移学习可以在不同的语音识别任务中发挥其优势,尤其在目标领域数据稀缺或计算资源有限的情况下,迁移学习提供了高效且有效的解决方案。

# 3. 迁移学习在语音识别中的实践应用

## 3.1 基于迁移学习的语音识别系统搭建

### 3.1.1 数据预处理和迁移数据集的选择

在构建一个基于迁移学习的语音识别系统时,数据预处理和选择一个合适的迁移数据集是两个关键步骤。数据预处理包括声音信号的降噪、分段、归一化等操作。合理的预处理能够减少系统的错误率并提升识别准确性。

接下来,选择合适的迁移数据集至关重要。一个好的迁移数据集应具备足够的多样性,能覆盖不同的发音者、口音、环境噪音等,以确保模型在不同场景下均能保持良好的泛化性能。

**示例代码**:展示如何进行语音信号的预处理。

```python

import librosa

import numpy as np

def preprocess_audio(audio_path):

# 加载音频文件

audio, sample_rate = librosa.load(audio_path, sr=None)

# 使用librosa的预设进行降噪

audio = librosa.effects.preemphasis(audio)

# 切分为10毫秒的帧

frames = librosa.feature.mfcc(y=audio, sr=sample_rate, n_mfcc=13)

# 归一化处理

frames = (frames - np.mean(frames)) / np.std(f

```

0

0