YOLOv5图像分割赋能自动驾驶:感知与决策的秘密武器

发布时间: 2024-08-18 15:29:23 阅读量: 20 订阅数: 35

# 1. YOLOv5图像分割简介

YOLOv5图像分割是一种基于深度学习的图像分割技术,它利用卷积神经网络(CNN)对图像进行语义分割,即识别和标记图像中不同对象的像素。与传统图像分割方法相比,YOLOv5图像分割具有速度快、精度高的优势,在自动驾驶、医疗影像分析等领域具有广泛的应用前景。

YOLOv5图像分割模型由一个主干网络和一个分割头组成。主干网络负责提取图像特征,而分割头则负责将这些特征转换为像素级的分割掩码。YOLOv5图像分割模型采用端到端训练方式,可以一次性完成特征提取和分割任务,大大提高了效率。

# 2. YOLOv5图像分割的理论基础

### 2.1 深度学习与卷积神经网络

**深度学习**是一种机器学习方法,它使用多层神经网络来学习数据中的复杂模式。卷积神经网络(CNN)是深度学习中的一种特殊类型,它专门用于处理网格状数据,例如图像。

CNN由一系列卷积层组成,每个卷积层都应用一组过滤器或内核到输入数据。过滤器在输入数据上滑动,提取局部特征。然后,将提取的特征传递到下一层,在那里它们被进一步处理。

### 2.2 YOLOv5模型架构与原理

YOLOv5是用于图像分割的单阶段目标检测模型。它基于YOLOv4模型,但进行了改进,提高了准确性和速度。

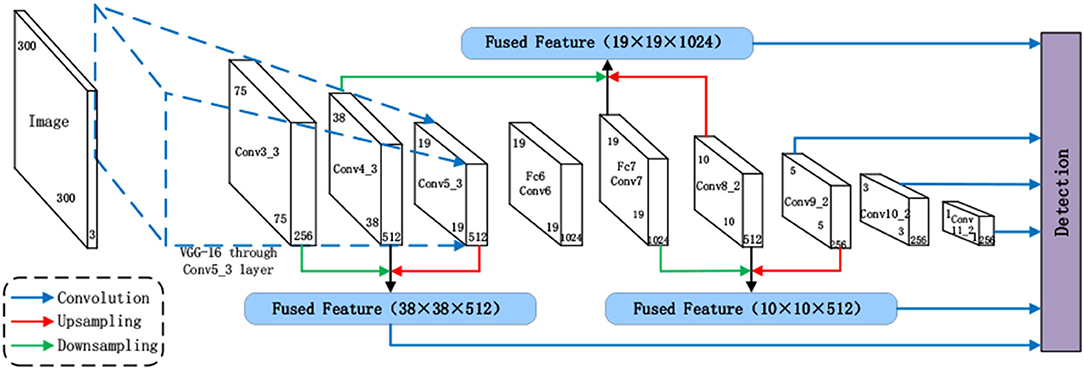

YOLOv5模型架构包括以下主要组件:

- **主干网络:**该网络负责提取图像中的特征。它通常由一组卷积层组成,每个卷积层都遵循一个池化层。

- **Neck:**该网络将主干网络中的特征映射到一个统一的尺寸。它通常由一组卷积层和上采样层组成。

- **检测头:**该网络负责生成边界框和类别预测。它通常由一组卷积层和全连接层组成。

YOLOv5模型的原理如下:

1. **特征提取:**主干网络从输入图像中提取特征。

2. **特征融合:**Neck将不同尺度的特征映射融合到一个统一的尺寸。

3. **边界框预测:**检测头生成边界框和类别预测。

4. **非极大值抑制(NMS):**NMS用于从重叠的边界框中选择最具信心的边界框。

**代码块 2.1:YOLOv5模型架构**

```python

import torch

import torch.nn as nn

class YOLOv5(nn.Module):

def __init__(self):

super(YOLOv5, self).__init__()

# 主干网络

self.backbone = nn.Sequential(

nn.Conv2d(3, 32, 3, 1, 1),

nn.ReLU(),

nn.MaxPool2d(2, 2),

nn.Conv2d(32, 64, 3, 1, 1),

nn.ReLU(),

nn.MaxPool2d(2, 2),

nn.Conv2d(64, 128, 3, 1, 1),

nn.ReLU(),

nn.MaxPool2d(2, 2),

)

# Neck

self.neck = nn.Sequential(

nn.Conv2d(128, 256, 3, 1, 1),

nn.ReLU(),

nn.Upsample(scale_factor=2),

nn.Conv2d(256, 128, 3, 1, 1),

nn.ReLU(),

)

# 检测头

self.detection_head = nn.Sequential(

nn.Conv2d(128, 256, 3, 1, 1),

nn.ReLU(),

nn.Conv2d(256, 512, 3, 1, 1),

nn.ReLU(),

nn.Conv2d(512, 1024, 3, 1, 1),

nn.ReLU(),

nn.Conv2d(1024, 3 * (5 + 80), 1, 1, 0),

)

def forward(self, x):

# 特征提取

x = self.backbone(x)

# 特征融合

x = self.neck(x)

# 边界框预测

x = self.detection_head(x)

# 非极大值抑制

boxes, scores, classes = self.nms(x)

return boxes, scores, classes

```

**逻辑分析:**

* `forward`方法接受一个输入图像`x`。

* `backbone`网络提取图像的特征。

* `neck`网络将特征映射融合到一个统一的尺寸。

* `detection_head`网络生成边界框和类别预测。

* `nms`方法应用非极大值抑制来选择最具信心的边界框。

**参数说明:**

* `x`:输入图像,形状为`(batch_size, 3, height, width)`。

* `boxes`:边界框坐标,形状为`(batch_size, num_boxes, 4)`。

* `scores`:边界框置信度,形状为`(batch_size, num_boxes)`。

* `classes`:边界框类别,形状为`(batch_size, num_boxes)`。

**表格 2.1:YOLOv5模型架构的层结构**

| 层类型 | 输出形状 |

|---|---|

| 卷积层 | (batch_size, 32, height/2, width/2) |

| ReLU激活 | (batch_size, 32, height/2, width/2) |

| 池化层 | (batch_size, 32, height/4, width/4) |

| 卷积层 | (batch_size, 64, height/4, width/4) |

| ReLU激活 | (batch_size, 64, height/4, width/4) |

| 池化层 | (batch_size,

0

0