Scrapy中的去重与增量爬取技术探究

发布时间: 2024-04-15 18:49:12 阅读量: 225 订阅数: 47

scrapy 爬虫练习

# 1. 爬虫框架介绍

网络爬虫,简单来说就是一种自动获取网页信息的程序,能够模拟浏览器请求并解析网页内容。爬虫框架则是一种可以帮助用户快速开发爬虫程序的工具,提供了一系列功能组件,简化了爬虫程序的开发流程。

爬虫框架的作用主要在于提供了网络请求、页面解析、数据存储等功能,让开发者能够专注于业务逻辑的实现,而不必过多关注底层细节。使用爬虫框架可以提高开发效率,降低开发难度,同时也能有效管理爬虫程序的各个模块,使代码结构更加清晰和易于维护。

# 2. Scrapy框架基础

2.1 为什么选择Scrapy

网络爬虫在数据采集与处理方面扮演着至关重要的角色。Scrapy作为一个基于Python的高级网络爬虫框架,被广泛应用于各类数据挖掘、信息监控和历史数据的抓取任务中。Scrapy框架具有强大的功能和灵活性,允许用户通过简单而强大的API来管理爬虫流程和数据流,使得开发者可以专注于数据的提取和分析,而不必过多关注底层细节。

2.2 Scrapy框架的核心组件

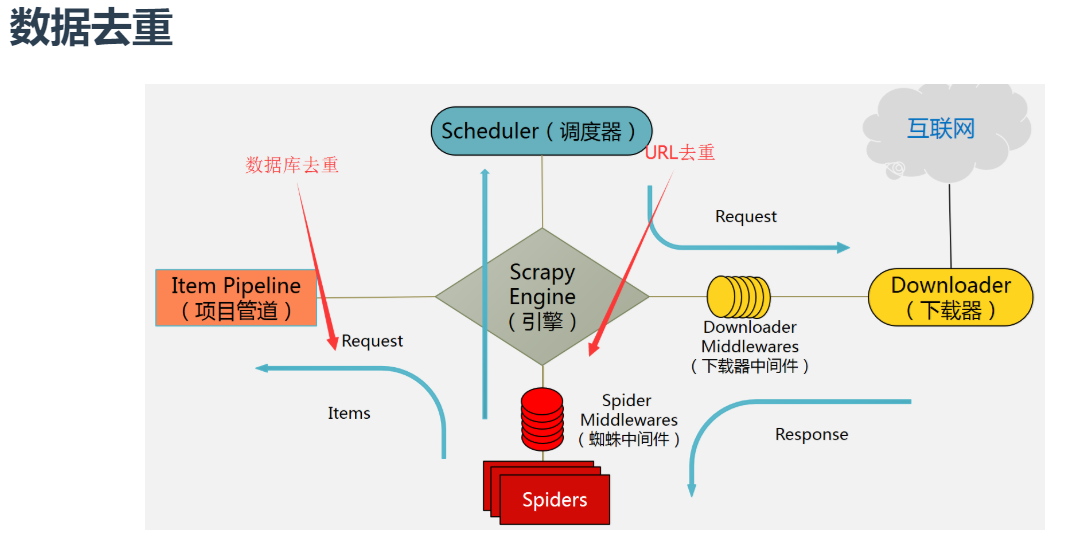

Scrapy框架主要由四个核心组件构成,分别是Scrapy的引擎、Scrapy的调度器、Scrapy的下载器以及Scrapy的爬虫管理器。这些组件各自承担着不同的任务,相互协作完成数据的抓取和处理流程。

#### 2.2.1 Scrapy的引擎

Scrapy的引擎负责控制数据流在各个组件之间的流动,根据各组件的信号进行工作调度和通信。引擎负责启动和停止爬取过程,以及分发信号,如请求下载资源或者将解析后的数据发送给管道。

#### 2.2.2 Scrapy的调度器

Scrapy的调度器负责接收引擎发过来的请求并安排给下载器。调度器通过优先级调度,以及过滤重复请求等功能,保证了爬虫的高效运行,同时还处理了请求的并发性。

#### 2.2.3 Scrapy的下载器

Scrapy的下载器负责下载网页并将其转换为Scrapy的响应。在下载器中,可以设置请求头信息、代理、超时时间等参数,以便应对不同类型的网站和反爬虫机制。

#### 2.2.4 Scrapy的爬虫管理器

Scrapy的爬虫管理器负责接收引擎发送过来的请求,并根据指定的规则调用相应的爬虫程序进行处理。通过爬虫管理器,用户可以定义爬取规则,解析页面内容,并将抽取的数据交给引擎处理。

```python

# 示例代码:简单的Scrapy爬虫实现

import scrapy

class MySpider(scrapy.Spider):

name = 'example'

def start_requests(self):

urls = ['http://example.com']

for url in urls:

yield scrapy.Request(url=url, callback=self.parse)

def parse(self, response):

data = response.css('div.content').extract()

for item in data:

yield {

'content': item

}

```

在上面的示例中,定义了一个简单的Scrapy爬虫,通过调度器、下载器以及爬虫管理器的协作,实现了对页面内容的抓取、解析和数据提取。

以上就是对Scrapy框架核心组件的详细介绍,通过深入了解这些组件的功能和作用,可以更好地利用Scrapy框架来构建强大的网络爬虫应用。

# 3. Scrapy中的数据解析技术

数据解析在网络爬虫中扮演着至关重要的角色,它能够帮助我们从网页中提取出我们需要的信息,而Scrapy框架提供了多种数据解析技术来实现这一目的。

#### 3.1 数据解析的重要性

数据解析是网络爬虫过程中必不可少的一环,通过数据解析,我们可以从网页中提取出所需数据,为后续的数据处理和存储提供支持。

#### 3.2 XPath解析技术

XPath是一门在XML文档中查找信息的语言,它同样适用于HTML文档,而在Scrapy框架中,我们可以利用XPath表达式来解析数据。

##### 3.2.1 什么是XPath

XPath是一种在XML文档中定位节点的语言,它提供了诸如按节点名称、属性、位置等条件来筛选节点的能力。

##### 3.2.2 XPath常用语法

在XPath中,常见的语法包括路径表达式、节点选择、谓词等,通过这些语法,我们可以准确地定位目标节点。

##### 3.2.3 在Scrapy中如何使用XPath解析数据

在Scrapy中,我们可以使用`response.xpath()`方法配合XPath表达式来提取数据,从而实现对网页信息的解析。

```python

# 示例代码

def parse(self, response):

data = response.xpath('//div[@class="container"]/ul/li/text()').extract()

yield {'data': data}

```

#### 3.3 CSS选择器解析技术

CSS选择器是一种常见的用于网页样式设计的语法,而在Scrapy中,我们同样可以利用CSS选择器来解析网页数据。

##### 3.3.1 什么是CSS选择器

CSS选择器是一种通过标签、类、ID等属性选择元素的语法,它简洁明了,适用于各种网页结构。

##### 3.3.2 CSS选择器常见用法

常见的CSS选择器语法包括标签选择器、类选择器、ID选择器、属性选择器等,通过这些选择器,我们可以快速定位目标元素。

##### 3.3.3 如何在Scrapy中使用CSS选择器

在Scrapy中,我们可以使用`response.css()`方法结合CSS选择器来提取数据,同样可以实现数据解析的功能。

```python

# 示例代码

def parse(self, response):

data = response.css('.content > p::text').extract()

yield {'data': data}

```

通过上述介绍,我们了解了在Scrapy框架中如何利用XPath和CSS选择器等数据解析技术来提取网页信息,为后续的数据处理打下了基础。

# 4. 反爬虫与突破技巧

4.1 反爬虫手段解析

在网络爬虫的世界中,反爬虫技术是网站为了阻止爬虫程序抓取数据而采取的一系列手段。常见的反爬虫手段包括但不限于:

- **IP封禁**:网站会监控访问频率高且具有相似行为的IP地址,并封禁这些IP。

- **请求头检测**:通过检查HTTP请求头部信息中的User-Agent等字段,识别并封锁爬虫程序。

- **验证码**:在访问页面时弹出验证码,需要用户手动输入才能访问。

- **动态加载**:使用JavaScript动态加载内容, ers难以获取到完整的页面源代码。

4.2 如何规避反爬虫措施

4.2.1 设置请求头信息

在发起HTTP请求时,通过设置合理的请求头信息,可以让爬虫程序更好地伪装成浏览器请求,从而避免被封锁。以下是一个Python示例代码:

```python

import requests

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.3'

}

response = requests.get('https://www.example.com', headers=headers)

print(response.text)

```

4.2.2 使用IP代理

通过使用代理IP,我们可以隐藏真实的IP地址,降低被封锁的风险。下面是一个简单的示例代码:

```python

import requests

proxies = {

'http': 'http://127.0.0.1:8000',

'https': 'https://127.0.0.1:8000'

}

response = requests.get('https://www.example.com', proxies=proxies)

print(response.text)

```

4.2.3 使用随机User-Agent

通过随机选择User-Agent,我们可以增加爬虫程序的反检测能力。以下是一个Python示例代码:

```python

import random

import requests

user_agents = [

'User-Agent 1',

'User-Agent 2',

'User-Agent 3'

]

headers = {

'User-Agent': random.choice(user_agents)

}

response = requests.get('https://www.example.com', headers=headers)

print(response.text)

```

通过以上方法,我们可以更好地规避网站的反爬虫措施,确保爬取数据的顺利进行。

# 5. 数据存储与输出

数据的爬取和解析只是爬虫工作的一部分,将爬取到的数据进行存储和输出同样重要。本章将介绍如何选择合适的数据存储方式、进行数据处理与清洗,以及数据的输出与展示技巧。

1. **数据存储的选择**

1.1 存储到数据库:数据库是数据存储的一种常见方式,可以选择关系型数据库如MySQL、非关系型数据库如MongoDB等。

1.2 存储到文件系统:将数据存储为文件形式,如CSV、JSON、Excel等格式,适合简单的数据存储需求。

2. **数据处理与清洗**

2.1 数据清洗的重要性:爬取到的数据可能存在格式不规范、缺失值等问题,需要进行清洗处理以确保数据质量。

2.2 使用Python库进行数据处理:Python提供了丰富的数据处理库,如Pandas、NumPy等,能够帮助我们进行数据处理、分析等操作。

3. **数据输出与展示**

3.1 数据可视化技术:数据可视化是将数据通过图表、地图等形式展现出来,有助于直观地理解数据、发现规律。

3.2 制作数据报告:通过将数据整理成报告的形式,可以更好地呈现数据分析结果,帮助他人更好地理解数据背后的含义。

下面我们结合实例来演示如何利用Python爬虫获取数据后进行存储、清洗、处理和展示。

```python

import pandas as pd

# 假设这是爬取到的数据

data = {

'Name': ['Alice', 'Bob', 'Charlie'],

'Age': [25, 30, 35],

'Salary': [50000, 60000, 70000]

}

# 创建DataFrame对象

df = pd.DataFrame(data)

# 数据存储到CSV文件

df.to_csv('data.csv', index=False)

# 数据清洗处理,假设将年龄大于30岁的数据删除

df_cleaned = df[df['Age'] <= 30]

# 数据可视化展示

import matplotlib.pyplot as plt

plt.bar(df_cleaned['Name'], df_cleaned['Salary'])

plt.xlabel('Name')

plt.ylabel('Salary')

plt.title('Salary of Employees')

plt.show()

```

通过上述代码,我们实现了数据的存储到CSV文件、简单的数据清洗处理以及通过柱状图展示数据。这个过程展示了爬取数据后的后续处理流程,帮助我们更好地利用爬虫获取的数据。

0

0