Scrapy爬虫项目搭建与配置详解

发布时间: 2024-04-15 18:43:14 阅读量: 85 订阅数: 47

详解Python的爬虫框架 Scrapy

# 1. 介绍

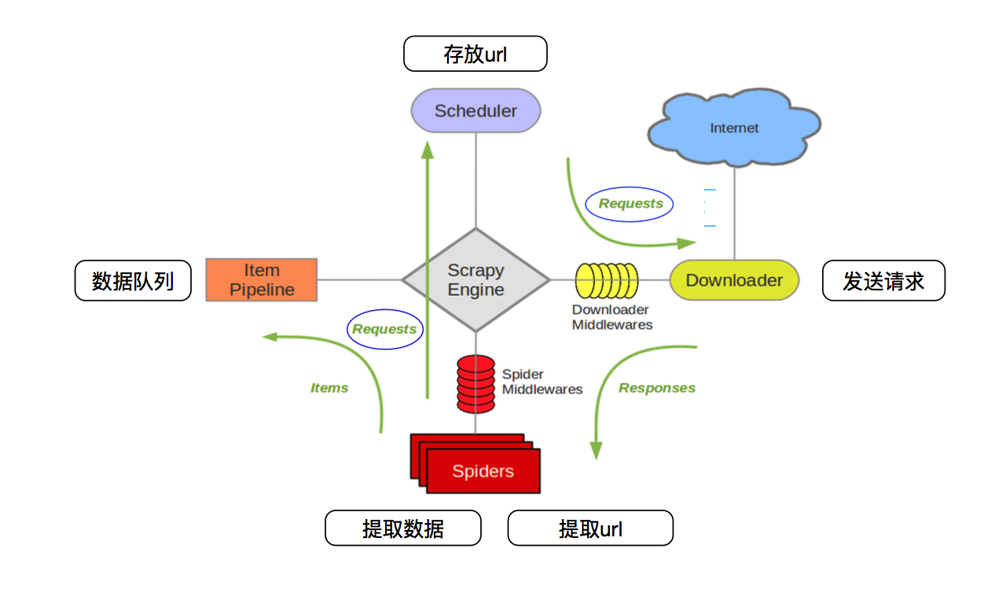

在信息爆炸的时代,数据是至关重要的资源。为了获取海量数据,人们常常需要使用爬虫技术。数据收集需求分析是构建爬虫的第一步,而爬虫技术则可以自动化地从互联网上抓取所需的信息。Scrapy框架作为一个强大的爬虫框架,具有高效的数据抓取能力、可扩展性强等特点。通过使用Scrapy框架,我们可以方便地搭建一个稳定、高效的爬虫系统,快速获取所需数据。因此,了解Scrapy框架的特点和优势对于提升数据收集效率至关重要。接下来,我们将深入探讨Scrapy框架的相关知识,帮助您更好地利用爬虫技术来满足数据需求。

# 2. 准备工作

### 安装Python和Scrapy

为了开始我们的爬虫项目,首先需要安装Python和Scrapy。Python是一种高效的编程语言,而Scrapy是一个强大的爬虫框架,二者搭配使用可以提高我们爬取数据的效率和灵活性。

#### 安装Python

- 首先,访问Python官方网站,下载最新的Python安装程序。

- 运行安装程序,勾选“Add Python to PATH”选项,以便在命令行中可以直接运行Python。

- 安装完成后,打开命令行工具,输入`python --version`查看Python版本,确保安装成功。

#### 安装Scrapy

- 在命令行中,通过pip工具安装Scrapy,命令为`pip install Scrapy`。

- 安装完成后,可以通过`scrapy --version`检查Scrapy是否成功安装。

### 设置虚拟环境

虚拟环境是Python的一个重要概念,它可以让我们在同一台电脑上管理多个项目所需的不同包和版本,避免项目之间的依赖冲突。

#### 为什么要使用虚拟环境

在开发过程中,我们可能会使用不同的库和不同版本的库,为了避免全局环境下的混乱,我们需要用虚拟环境来隔离不同项目的依赖。

#### 使用virtualenv创建虚拟环境

- 安装`virtualenv`工具,命令为`pip install virtualenv`。

- 在命令行中通过`virtualenv venv`创建一个名为`venv`的虚拟环境。

- 激活虚拟环境:

- Windows系统:输入`venv\Scripts\activate`激活。

- MacOS/Linux系统:输入`source venv/bin/activate`激活。

#### 激活虚拟环境

在虚拟环境激活状态下,我们所安装的Python包只会在当前虚拟环境中生效,这样可以确保项目的环境独立性。

# 3. 项目搭建

### 3.1 创建Scrapy项目

在进行数据爬取之前,首先需要创建一个Scrapy项目。Scrapy框架提供了一个命令来创建项目,让我们一起来看看具体的步骤。

#### 3.1.1 使用命令创建项目

打开终端,运行以下命令来创建一个新的Scrapy项目:

```bash

scrapy startproject myproject

```

#### 3.1.2 项目目录结构解析

创建项目后,你会看到生成了如下的目录结构:

- myproject/

- scrapy.cfg

- myproject/

- __init__.py

- items.py

- middlewares.py

- pipelines.py

- settings.py

- spiders/

- __init__.py

### 3.2 配置Scrapy项目

配置Scrapy项目是非常重要的一步,通过合适的配置可以提高爬虫的效率和灵活性。

#### 3.2.1 配置settings.py文件

在`settings.py`文件中,可以设置一些参数来控制爬虫的行为,比如User-Agent等。

```python

# 设置User-Agent

USER_AGENT = 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.3'

```

#### 3.2.2 配置items.py文件

在`items.py`文件中,我们定义爬取下来的数据模型和字段,让我们来定义一个简单的示例:

```python

import scrapy

class MyItem(scrapy.Item):

title = scrapy.Field()

link = scrapy.Field()

```

#### 3.2.3 配置spiders目录

在`spiders`目录中,我们编写具体的爬虫代码,定义爬虫类来指定如何爬取网站的数据。

##### 3.2.3.1 创建Spider类

下面是一个简单的Spider类的示例:

```python

import scrapy

class MySpider(scrapy.Spider):

name = 'example'

start_urls = ['http://example.com']

def parse(self, response):

# 解析网页内容的方法

pass

```

通过以上配置和代码,我们已经完成了Scrapy项目的搭建,接下来就可以开始编写具体的爬虫逻辑进行数据的获取和处理。

# 4. 数据存储与处理

4.1 存储爬取数据

数据爬取的过程中,我们获取了大量的原始数据,这些数据需要进行存储和处理,才能为后续的数据分析和应用提供支持。在本节中,我们将介绍如何使用Scrapy内置的管道 (Pipeline) 来存储爬取的数据,以及如何将数据存储到数据库中。

#### 4.1.1 使用Scrapy内置的管道存储数据

在Scrapy中,管道是一个负责处理爬取到的数据的组件,可以完成数据的清洗、存储等工作。下面是使用Scrapy内置管道存储数据的步骤。

##### 4.1.1.1 配置管道

在`settings.py`文件中,找到 `ITEM_PIPELINES` 配置项,可以设置多个管道,按顺序依次处理数据。例如:

```python

ITEM_PIPELINES = {

'myproject.pipelines.MyPipeline': 300,

}

```

这里 `myproject.pipelines.MyPipeline` 是自定义的管道类,`300` 是处理顺序,数值越小越优先执行。

##### 4.1.1.2 数据处理与存储

在自定义的管道类中,可以编写对爬取到的数据进行处理的代码,例如清洗、筛选、存储等操作。在 `process_item` 方法中,可以对每个item进行处理,并返回处理后的结果。

```python

class MyPipeline(object):

def process_item(self, item, spider):

# 数据处理逻辑

return item

```

#### 4.1.2 存储数据到数据库

除了使用Scrapy内置的管道来存储数据,我们也可以将数据存储到数据库中,以便更灵活地进行数据的管理和查询。

##### 4.1.2.1 配置数据库连接

在 `settings.py` 中配置数据库连接信息,例如:

```python

DATABASE = {

'drivername': 'mysql',

'host': 'localhost',

'port': '3306',

'username': 'root',

'password': 'password',

'database': 'mydatabase'

}

```

##### 4.1.2.2 使用ORM操作数据库

Scrapy可以配合ORM(Object-Relational Mapping)框架来操作数据库。通过定义数据模型和字段,可以方便地进行数据库操作。在 `items.py` 中定义数据模型,并在管道中将数据存储到数据库中。

### 数据分析与处理

数据爬取回来之后,经常会包含一些无效数据或者需要进一步处理的部分。在这里,我们将介绍数据清洗和使用Pandas库对数据进行分析的过程。

#### 数据清洗的重要性

数据清洗是数据分析的第一步,通过数据清洗可以去除脏数据、缺失值等,使数据更加规范化,保证后续分析的准确性和可靠性。

#### 使用Pandas进行数据分析和处理

Pandas是Python中一个强大的数据处理库,提供了丰富的数据结构和函数,可以帮助我们进行数据的清洗和分析。

##### 数据清洗

通过Pandas库,我们可以很方便地进行数据清洗,包括去除重复值、处理缺失值、数据类型转换等操作。例如:

```python

import pandas as pd

# 读取数据

data = pd.read_csv('data.csv')

# 去除重复值

data = data.drop_duplicates()

# 处理缺失值

data['column'].fillna(value, inplace=True)

```

##### 数据可视化

除了数据清洗外,Pandas还提供了丰富的数据可视化功能,可以通过绘制图表、制作统计图表等方式呈现数据分析的结果,辅助我们更直观地理解数据。

以上是关于数据存储与处理的内容,通过使用Scrapy管道和Pandas库,我们可以高效地处理爬取的数据,并进行进一步的分析和应用。

# 5. 总结与展望

在本文中,我们详细介绍了如何使用Scrapy框架构建一个完整的爬虫项目。通过学习前面的章节内容,我们可以看到爬虫技术在数据收集和分析中的重要性。在本章中,我们将总结本文的主要内容,并展望未来爬虫技术的发展趋势。

### 5.1 总结

#### 5.1.1 学习收获

通过本文的学习,我们了解了爬虫的基本概念、Scrapy框架的特点和优势,以及构建一个完整爬虫项目的步骤。我们学会了如何配置Scrapy项目、编写爬虫代码、存储和处理爬取的数据等重要内容。同时,我们也掌握了数据清洗与分析的方法,包括使用Pandas进行数据处理和可视化。

#### 5.1.2 知识应用

在实际项目中,我们可以运用本文所介绍的知识和方法,构建各种类型的爬虫项目,从而实现对特定网站或数据源的信息提取和分析。通过数据存储和处理,我们可以进一步优化爬虫项目,实现数据的清洗、整合和可视化,为后续的数据分析和应用提供支持。

#### 5.1.3 潜在挑战

在实际项目中,可能会遇到各种挑战和问题,例如网站反爬虫机制、数据格式不规范、数据量大等。因此,我们需要不断学习和提升自己的技能,才能更好地应对这些挑战,确保爬虫项目的稳定运行和高效性能。

### 5.2 展望

#### 5.2.1 爬虫项目优化方向

未来,随着网络数据的不断增加和多样化,爬虫技术也将不断发展和完善。我们可以通过优化爬虫项目结构、提高爬取效率、改进数据处理方法等方式,进一步提升爬虫项目的质量和效果。同时,结合人工智能和机器学习技术,可以实现更智能化的数据抓取和分析,为各行业带来更多可能性。

#### 5.2.2 技术发展趋势

未来爬虫技术可能会朝着分布式爬虫、无需编程的爬虫工具、智能化数据处理等方向发展。同时,随着数据隐私和安全意识的增强,爬虫技术也会面临更严格的监管和限制。因此,我们需要密切关注技术的发展动态,不断学习和探索,以适应技术发展的趋势和需求。

通过本文的学习和实践,相信大家对爬虫技术有了更深入的理解和认识。在未来的工作中,希望大家能够充分发挥爬虫技术的优势,为数据分析和挖掘工作贡献自己的力量。让我们一起期待爬虫技术未来的发展,探索更广阔的数据世界!

以上为本文的总结与展望内容,希望读者能够从中获得启发和收获。感谢大家的阅读与支持!

0

0