【避免过拟合】

发布时间: 2024-09-03 06:21:58 阅读量: 96 订阅数: 41

# 1. 避免过拟合的理论基础

过拟合是机器学习领域的一个关键挑战,尤其在深度学习中较为常见。理解过拟合的理论基础对于设计稳健的模型至关重要。

## 1.1 过拟合现象的理解

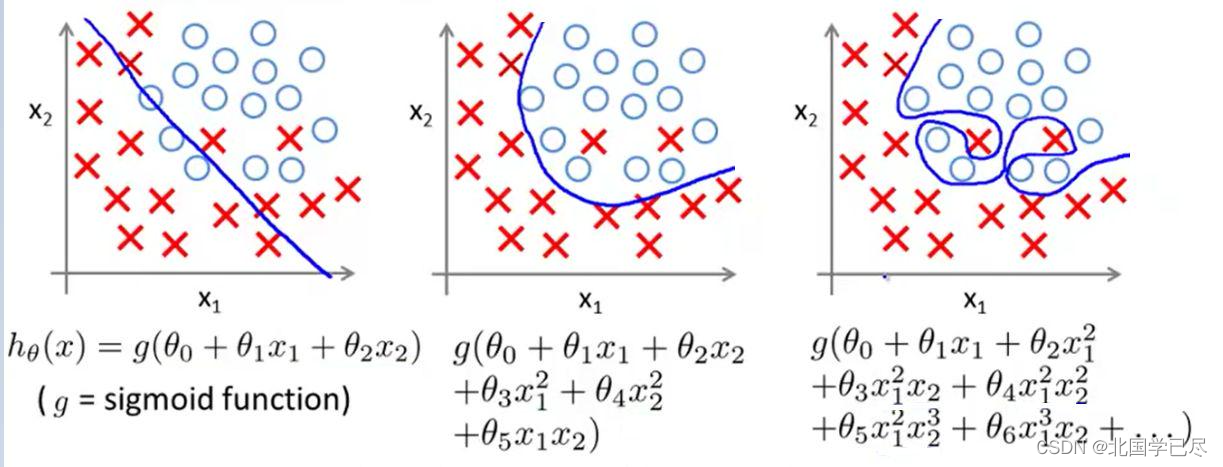

过拟合发生在模型过于复杂时,它在训练数据上表现良好,但在新数据上泛化能力差。这通常是因为模型学习到了训练数据中的噪声和异常值,而不是潜在的规律。

## 1.2 模型复杂度与泛化误差

模型的复杂度与泛化误差之间存在一种关系,通常被表述为偏差-方差权衡。一个过于简单的模型可能导致高偏差(欠拟合),而过于复杂的模型则可能引入高方差(过拟合)。

## 1.3 避免过拟合的策略

为了避免过拟合,可以采取多种策略,包括但不限于:使用更多的训练数据、简化模型结构、增加正则化项以及使用交叉验证等。下一章中我们将探讨数据预处理和增强策略,它是避免过拟合的重要步骤之一。

# 2. 数据预处理和增强策略

数据是机器学习模型的原材料,模型的质量在很大程度上取决于数据的质量。为了构建有效的预测模型,首先需要对数据进行彻底的预处理和增强,确保模型能够从输入数据中学习到有用的信息,同时避免学习到噪声和过拟合。本章节将详细介绍如何进行数据预处理和增强。

## 2.1 数据集划分与标准化

在构建机器学习模型之前,需要对原始数据集进行划分,以创建训练集、验证集和测试集。这些数据集将用于不同的目的,以确保模型在未知数据上具有良好的泛化能力。

### 2.1.1 训练集、验证集和测试集的作用与划分方法

**训练集**:用于训练模型的大部分数据。模型通过在训练集上进行学习,调整其内部参数以最小化预测误差。

**验证集**:一小部分与训练集隔离的数据,用于模型调优。模型在验证集上的性能评估用于调整超参数,比如学习率、正则化强度等。

**测试集**:一个独立的、与训练和验证集完全不重合的数据集。用于模型最终的性能评估,确保其泛化能力。

在划分数据集时,常用的方法是**随机划分**。大多数机器学习库提供了便捷的函数来进行数据划分。例如,在Python的`scikit-learn`库中,可以使用`train_test_split`函数轻松地将数据划分为训练集和测试集。此外,也可以使用`StratifiedKFold`等方法来进行分层划分,以保持类别比例的一致性。

```python

from sklearn.model_selection import train_test_split

from sklearn.datasets import load_iris

# 加载数据集

iris = load_iris()

X, y = iris.data, iris.target

# 划分数据集为训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

```

### 2.1.2 数据标准化和归一化技术

数据标准化(Standardization)和归一化(Normalization)是处理数据特征分布的方法,确保各特征在相同尺度上进行比较,这对很多模型(如支持向量机、K近邻等)的性能至关重要。

**标准化**的目标是使得数据的均值为0,标准差为1。其计算公式为:

\[ x_{std} = \frac{x - \mu}{\sigma} \]

其中,\( \mu \) 是特征的均值,\( \sigma \) 是标准差。

**归一化**的目标是将数据缩放到[0, 1]区间内。归一化可以通过以下公式实现:

\[ x_{norm} = \frac{x - \text{min}(x)}{\text{max}(x) - \text{min}(x)} \]

这些操作在`scikit-learn`库中可以通过`StandardScaler`和`MinMaxScaler`类轻松实现。

```python

from sklearn.preprocessing import StandardScaler, MinMaxScaler

# 标准化

scaler_standard = StandardScaler()

X_train_std = scaler_standard.fit_transform(X_train)

X_test_std = scaler_standard.transform(X_test)

# 归一化

scaler_minmax = MinMaxScaler()

X_train_norm = scaler_minmax.fit_transform(X_train)

X_test_norm = scaler_minmax.transform(X_test)

```

## 2.2 数据增强技术

数据增强是机器学习中用于增加训练数据多样性的技术,尤其在图像、文本和时间序列数据中应用广泛。通过应用一系列变换,增强技术可以使模型对输入数据的微小变化具有鲁棒性,进而提高泛化能力。

### 2.2.1 图像数据增强

在图像处理中,数据增强包括旋转、缩放、翻转、裁剪、颜色变换等操作。这些操作可以使用`OpenCV`库和`scikit-image`库进行。

例如,在Python中,可以通过`ImageDataGenerator`类来增强图像数据:

```python

from tensorflow.keras.preprocessing.image import ImageDataGenerator

# 创建一个图像数据生成器实例

datagen = ImageDataGenerator(

rotation_range=20,

width_shift_range=0.2,

height_shift_range=0.2,

shear_range=0.2,

zoom_range=0.2,

horizontal_flip=True,

fill_mode='nearest'

)

# 假设 X_train 中包含图像数据

for X_batch, y_batch in datagen.flow(X_train, y_train, batch_size=32):

# 使用 X_batch 进行训练

break

```

### 2.2.2 文本和序列数据增强

文本和序列数据增强通常包括同义词替换、删除、插入和交换字符、句子重排等技术。这些技术可以增加数据的多样性,帮助模型更好地理解文本的语义。

例如,对于英文文本数据,可以使用`nltk`库中的`WordNetLemmatizer`和`random`库来实现同义词替换和随机词替换:

```python

import random

from nltk.stem import WordNetLemmatizer

lemmatizer = WordNetLemmatizer()

def replace_random_word(text):

words = text.split()

new_words = []

for word in words:

new_words.append(lemmatizer.lemmatize(word))

if random.random() < 0.1: # 10%的概率替换为同义词

synonyms = get_synonyms(word)

new_word = random.choice(synonyms)

new_words[-1] = new_word

return " ".join(new_words)

# 辅助函数,获取同义词

def get_synonyms(word):

# 这里简化处理,只返回与单词相同的列表

synonyms = [word]

return synonyms

```

### 2.2.3 时间序列数据增强

时间序列数据增强需要更细致的考量,因为时间相关性和依赖性是此类数据的关键特性。常用的增强方法包括添加噪声、裁剪、时间扭曲等。这些方法通常需要根据特定的时间序列数据来定制。

例如,可以在时间序列数据中添加高斯噪声来实现增强:

```python

import numpy as np

import pandas as pd

def add_gaussian_noise(series, noise_level):

noise = np.random.normal(0, noise_level, series.shape)

return series + noise

# 假设 data 是一个pandas Series,代表时间序列数据

data_noisy = add_gaussian_noise(data, noise_level=0.1)

```

## 2.3 特征选择与降维

在高维数据中,特征选择与降维是减少过拟合的重要步骤。通过识别和选择对预测任务最重要的特征,可以提高模型的训练效率并减少噪声。

### 2.3.1 特征重要性评估方法

常用的特征重要性评估方法包括基于模型的特征重要性(如随机森林特征重要性)和基于统计的特征重要性(如卡方检验、相关系数、互信息等)。

以随机森林为例,可以通过`feature_importances_`属性获取特征重要性:

```python

from sklearn.ensemble import RandomForestClassifier

# 训练随机森林模型

forest = RandomForestClassifier(n_estimators=100)

forest.fit(X_train, y_train)

# 获取特征重要性

importances = forest.feature_importances_

# 将特征重要性转换为DataFrame以便于分析

feature_importance_df = pd.DataFrame({'feature': list(X.columns), 'importance': importances})

```

### 2.3.2 主成分分析(PCA)和其他降维技术

主成分分析(PCA)是最常见的降维技术之一,它通过线性变换将数据投影到少数几个主成分上。PCA寻找数据的协方差矩阵的特征值和特征向量,并按贡献度排序,通常只保留贡献度最大的前几个主成分。

```python

from sklearn.decomposition import PCA

# 创建PCA实例,假设想要保留95%的方差

pca = PCA(n_components=0.95)

X_train_pca = pca.fit_transform(X_train)

X_test_pca = pca.transform(X_test)

```

在本章节中,我们从数据集划分与标准化讲起,深入探讨了数据增强技术和特征选择与降维方法。这些预处理步骤对于提高模型的泛化能力至关重要。在下一章节,我们将深入模型的复杂度控制方法,探索各种模型正则化技术、集成学习方法和神经网络架构设计,以进一步避免过拟合问题。

# 3. 模型复杂度控制方法

## 3.1 模型正则化技术

### 3.1.1 L1和L2正则化

正则化技术在机器学习领域中用于处理过拟合,通过在目标函数中添加正则化项来约束模型的复杂度。L1正则化和L2正则化是最常见的两种形式。

**L1正则化**,也称为Lasso(Least Absolute Shrinkage and Selection Operator),在损失函数中添加了权重的绝对值之和。这种正则化不仅能够减轻过拟合,还具有选择特征的能力。当L1正则化项足够大时,一些权重可以被精确地推到零,从而实现特征选择。

```python

from sklearn.linear_model import LassoCV

# 使用LassoCV进行交叉验证和参数选择

lasso = LassoCV(cv=5, random_state=0).fit(X_train, y_train)

# 输出最优的alpha值

print("Optimal alpha value:", lasso.alpha_)

```

在上述代码中,`LassoCV`类通过交叉验证自动调整正则化参数`alpha`以找到最佳模型。`cv`参数设置了交叉验证的折数。

**L2正则化**,也称为岭回归(Ridge Regression),在损失函数中添加了权重的平方和。与L1不同,L2正则化倾向于将权重值均匀地缩小,但不会将它们减小到零。这有助于防止特征之间的影响过于极端,但不会导致特征选择。

```python

from sklearn.linear_model import RidgeCV

# 使用RidgeCV进行交叉验证和参数选择

ridge = RidgeCV(cv=5, random_state=0).fit(X_train, y_train)

# 输出最优的alpha值

print("Optimal alpha value:", ridge.alpha_)

```

### 3.1.2 Dropout技术及其应用

Dropout是一种在训练神经网络时广泛使用的正则化技术。它的核心思想是在训练过程中随机地“丢弃”(即临时移除)网络中的一部分节点,使网络结构在每次迭代过程中都发生变化,从而防止网络对特定的输入数据过度拟合。

```python

from keras.layers import Dropout

from keras.models import Sequential

from keras.layers import Dense

# 创建一个简单的神经网络模型

model = Sequential()

model.add(Dens

```

0

0