深度学习模型调优秘籍:精细调整,挖掘模型最大潜力

发布时间: 2024-08-17 03:19:12 阅读量: 44 订阅数: 22

YOLO模型调优秘籍:深度学习中的参数优化艺术

# 1. 深度学习模型调优概述**

深度学习模型调优是提高模型性能和泛化能力的关键步骤。它涉及一系列技术,用于调整模型的超参数和结构,以优化其在特定任务上的表现。

模型调优的目标是找到一组参数,使模型能够在训练集和测试集上都取得良好的性能。这需要平衡模型的复杂性,以避免过拟合,同时确保其具有足够的容量来捕获数据的复杂性,以避免欠拟合。

模型调优是一个迭代过程,涉及尝试不同的超参数组合,评估模型的性能,并根据结果进行调整。通过仔细的调优,可以显著提高模型的准确性、鲁棒性和效率。

# 2. 模型调优理论基础

### 2.1 模型过拟合和欠拟合的原理

**过拟合**是指模型在训练集上表现良好,但在测试集上表现不佳的情况。这是因为模型过于关注训练集中的特定细节,以至于无法泛化到新的、未见过的数据。

**欠拟合**是指模型在训练集和测试集上都表现不佳的情况。这是因为模型未能从数据中学习足够的模式,以做出准确的预测。

### 2.2 正则化方法:L1、L2正则化

正则化是一种技术,用于防止模型过拟合。它通过向损失函数中添加额外的惩罚项来实现,该惩罚项与模型权重的幅度成正比。

**L1正则化(Lasso)**:

```python

import tensorflow as tf

# 定义模型权重

weights = tf.Variable(tf.random.normal([10, 10]))

# 定义损失函数

loss = tf.reduce_mean(tf.square(y_pred - y_true)) + 0.1 * tf.reduce_sum(tf.abs(weights))

# 训练模型

optimizer = tf.optimizers.Adam(learning_rate=0.001)

optimizer.minimize(loss)

```

L1正则化通过向损失函数中添加权重绝对值的总和来惩罚模型。这鼓励模型使用较少的非零权重,从而产生稀疏解。

**L2正则化(岭回归)**:

```python

import tensorflow as tf

# 定义模型权重

weights = tf.Variable(tf.random.normal([10, 10]))

# 定义损失函数

loss = tf.reduce_mean(tf.square(y_pred - y_true)) + 0.1 * tf.reduce_sum(tf.square(weights))

# 训练模型

optimizer = tf.optimizers.Adam(learning_rate=0.001)

optimizer.minimize(loss)

```

L2正则化通过向损失函数中添加权重平方和的总和来惩罚模型。这鼓励模型使用较小的权重值,从而产生更平滑的解。

### 2.3 激活函数和优化器选择

**激活函数**是非线性函数,用于将神经网络的输出映射到特定范围。不同的激活函数具有不同的特性,会影响模型的学习能力和泛化能力。

**优化器**是用于更新模型权重的算法。不同的优化器具有不同的更新规则,会影响模型的训练速度和收敛性。

| 激活函数 | 特性 |

|---|---|

| ReLU | 非负输出,减少梯度消失问题 |

| Sigmoid | 输出范围为(0, 1),用于二分类问题 |

| Tanh | 输出范围为(-1, 1),用于双向分类问题 |

| 优化器 | 特性 |

|---|---|

| 梯度下降 | 简单有效,但收敛速度慢 |

| 动量优化器 | 加速收敛,但可能导致震荡 |

| RMSprop | 自适应学习率,减少梯度震荡 |

| Adam | 动量和RMSprop的结合,综合优势 |

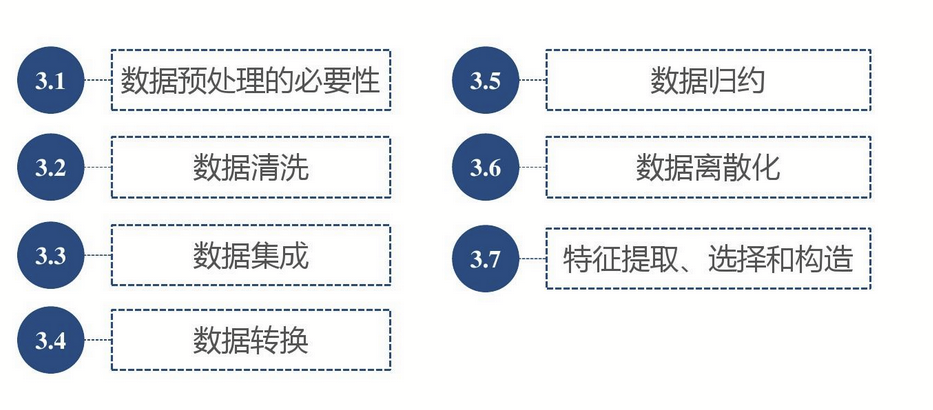

# 3. 模型调优实践技巧

### 3.1 数据预处理和特征工程

数据预处理是模型调优的关键步骤,它可以提高数据的质量和模型的性能。数据预处理包括以下步骤:

* **数据清洗:**删除缺失值、异常值和噪声数据。

* **数据归一化:**将不同范围的数据缩放至同一范围,以提高模型训练的效率和精度。

* **数据标准化:**将数据的均值归一化为0,标准差归一化为1,以消除特征之间的差异。

* **特征工程:**创建新特征或转换现有特征,以提高模型的预测能力。

### 3.2 超参数调优:网格搜索和贝叶斯优化

超参数是模型训练过程中不可训练的参数,例如学习率、批量大小和正则化系数。超参数调优是找到最佳超参数组合的过程,以最大化模型性能。

**网格搜索:**网格搜索是一种穷举搜索方法,它在给定的超参数范围内遍历所有可能的组合。这种方法简单易行,但计

0

0