R语言tree包扩展应用:融合其他机器学习包的技巧

发布时间: 2024-11-02 03:19:06 阅读量: 36 订阅数: 47

# 1. R语言与tree包概述

## R语言简介

R是一种用于统计分析、图形表示和报告的编程语言和软件环境。它的强项在于其强大的统计功能和灵活的数据处理能力。R语言社区活跃,拥有一系列的包,可以方便地扩展功能。

## tree包的作用

`tree`包在R中用于构建决策树,是数据分析和预测建模的重要工具。它可以处理分类和回归问题,通过可视化的方式展现决策逻辑,使得结果直观易懂。

## 应用场景

`tree`包特别适合处理那些需要可视化决策过程的场景,比如信用评分、市场细分、客户行为分析等。它的优势在于模型易于解释,适用于那些需要向非技术用户解释决策过程的情况。

在R中使用`tree`包,你可以按照以下步骤:

1. 安装包:使用`install.packages("tree")`命令。

2. 加载包:通过`library(tree)`进行调用。

3. 使用:加载数据、构建模型、预测、可视化树形结构。

这个过程能快速帮助你从数据中提取有用信息,并以决策树的形式展示出来,尤其适合初学者和需要快速得到结果的研究者。

# 2. tree包基础知识和应用

## 2.1 tree包的基本概念和安装

### 2.1.1 tree包的作用和适用场景

在数据分析和机器学习领域,决策树是一种常用的预测建模方法,它通过一系列的判断规则对数据进行分类或回归。`tree`包是R语言中实现决策树算法的一个工具包,它提供了简洁的函数接口来构建决策树,可视化树结构,并进行预测。

`tree`包特别适合于处理分类问题,可以应用于各种场景,比如客户信用评分、疾病诊断、股票市场预测等。它能够处理数值型数据、类别型数据,甚至是缺失值数据,这些特点使得`tree`包在数据科学家和分析师之间广受欢迎。

### 2.1.2 安装和加载tree包的步骤

安装`tree`包的步骤很简单,只需要在R控制台中输入以下命令:

```R

install.packages("tree")

```

安装完成后,加载`tree`包到R会话中以便使用:

```R

library(tree)

```

加载包后,就可以使用`tree`包中提供的各种功能,开始构建决策树模型了。

## 2.2 tree包的基本使用方法

### 2.2.1 tree()函数的参数解析

`tree()`函数是构建决策树的核心函数,其基本语法如下:

```R

tree(formula, data, weights, subset, na.action, control, ...)

```

- `formula`:模型公式,指定了响应变量和预测变量。

- `data`:数据框,包含公式中指定的变量。

- `weights`:可选参数,为每个观测值提供权重。

- `subset`:用于选择数据框中的一部分数据进行分析。

- `na.action`:缺失值处理方法,默认为忽略。

- `control`:控制树生长的参数,例如最大树深度、分支停止的标准等。

- `...`:其他选项。

### 2.2.2 构建决策树模型的示例

下面通过一个使用`tree`包构建决策树的简单示例来说明这个过程。假设我们有一组数据`mydata`,包含自变量`x1`和`x2`,以及因变量`y`,我们希望根据`x1`和`x2`的值来预测`y`。

```R

# 构建决策树模型

tree_model <- tree(y ~ x1 + x2, data = mydata)

# 打印树结构

print(tree_model)

# 可视化决策树

plot(tree_model)

text(tree_model, pretty = 0)

```

这段代码首先使用`tree()`函数基于`mydata`数据集构建了一个决策树模型`tree_model`,然后使用`print()`函数打印出树的结构。最后,使用`plot()`和`text()`函数将决策树可视化。

## 2.3 tree包的高级功能

### 2.3.1 调整树结构的参数

`tree`包中`control`参数允许我们调整决策树的结构,包括:

- `mindev`:控制叶节点的最小改进量。

- `minsize`:控制叶节点的最小大小。

- `mincut`:控制分割每个节点所需的最小观测数。

- `cp`:复杂度参数,用于在构建树时进行剪枝。

通过适当设置这些参数,我们可以控制决策树的深度和大小,防止过拟合,并提高模型的泛化能力。

```R

# 通过control参数调整决策树

tree_control <- tree.control(nobs = nrow(mydata), mincut = 5, minsize = 10, mindev = 0.01)

tree_model_adjusted <- tree(y ~ x1 + x2, data = mydata, control = tree_control)

# 打印调整后的树结构

print(tree_model_adjusted)

```

### 2.3.2 树模型的评估和可视化

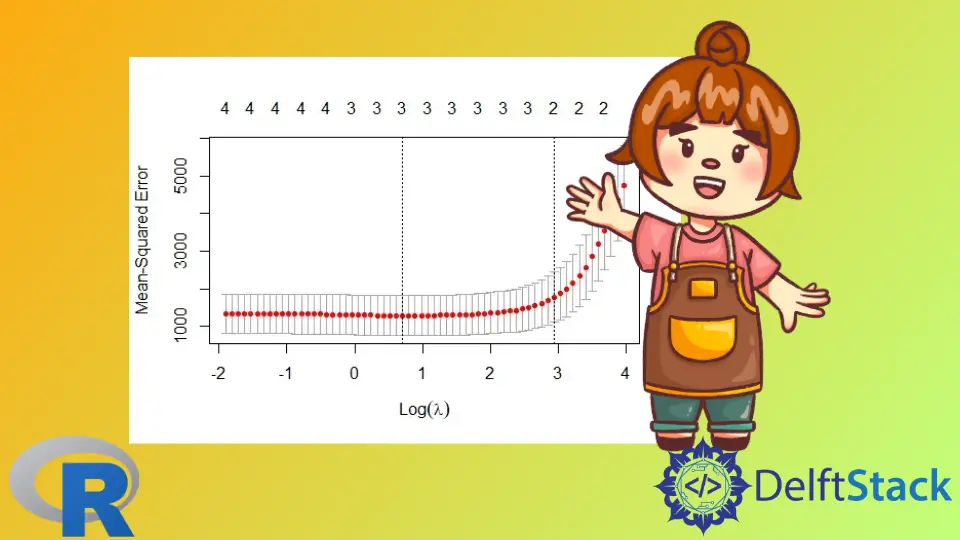

构建决策树模型之后,我们需要对其进行评估,以确保模型的性能满足需求。`tree`包提供了一些工具来评估模型:

```R

# 使用交叉验证评估模型

cv.tree_model <- cv.tree(tree_model, FUN = prune.tree, K = 10) # K折交叉验证

# 打印交叉验证结果

print(cv.tree_model)

# 根据交叉验证结果剪枝模型

pruned_tree_model <- prune.tree(tree_model, best = cv.tree_model$size[which.min(cv.tree_model$dev)])

```

通过交叉验证我们可以找到最佳的树大小,然后使用`prune.tree()`函数对模型进行剪枝。剪枝后的模型更加简洁,避免了过拟合问题。

评估模型的另一个重要步骤是可视化。通过可视化,我们可以更直观地了解决策树的结构,并根据树的分支情况调整模型。如前所述,`plot()`和`text()`函数联合使用可以绘制决策树的图形表示:

```R

# 可视化剪枝后的决策树

plot(pruned_tree_model)

text(pruned_tree_model, pretty = 0)

```

至此,我们已经了解了`tree`包的基础知识及其应用。接下来的章节将探讨如何将`tree`包与其他机器学习工具集成,以及在不同领域的扩展应用案例。

# 3. 与其他机器学习包的融合技巧

## 3.1 集成其他分类器

### 3.1.1 使用caret包进行模型集成

在机器学习中,模型集成是一种提升预测性能的常用策略。通过结合多个模型的预测结果来达到比单一模型更好的预测效果,是提升算法性能的有效途径之一。在R语言中,`caret`包提供了模型集成的工具,可以帮助我们方便地集成包括基于`tree`包构建的决策树在内的多种模型。

为了使用`caret`包进行模型集成,首先需要安装并加载`caret`包:

```r

install.packages("caret")

library(caret)

```

接着,使用`train`函数进行模型训练时,可以通过设置`method`参数来选择不同的模型。例如,如果我们想集成决策树和随机森林模型,可以设置`method = "rpart"`(使用`tree`包中的rpart方法)和`method = "rf"`(使用随机

0

0