R语言tree包学习资源大整理:书籍、网站与社区推荐

发布时间: 2024-11-02 03:45:32 阅读量: 23 订阅数: 47

cs-skill-tree:平时学习整理的笔记:evergreen_tree::evergreen_tree::evergreen_tree:

# 1. R语言tree包基础知识概述

## 简介

R语言作为一种强大的统计分析工具,在数据挖掘和机器学习领域中占据重要地位。tree包是R语言中用于构建决策树模型的常用包之一,它的核心功能是生成分类树和回归树模型,被广泛应用于数据分析和预测建模。

## tree包的作用

使用tree包可以实现对数据的分类和回归预测。在分类问题中,它可以帮助我们根据样本特征预测类别标签;而在回归问题中,可以预测数值型的响应变量。tree包操作简便,对新手友好,同时也具备足够的灵活性以适应高级用户的需求。

## 基本安装

要在R环境中安装tree包,只需执行以下命令:

```R

install.packages("tree")

```

安装完成后,通过加载tree包,我们就可以开始构建和分析决策树模型了。

```R

library(tree)

```

在接下来的章节中,我们将详细探讨tree包的理论框架、实践教程、高级应用以及学习资源推荐,以帮助读者更深入地了解和运用这一强大的数据分析工具。

# 2. R语言tree包的理论框架

### 2.1 tree包的算法原理

在数据科学领域,决策树作为一种强大的预测建模技术,广泛应用在分类和回归任务中。在R语言的tree包中,主要实现了两种著名的决策树算法:分类与回归树(CART)和递归分区(Recursive Partitioning)。理解这些算法背后的基本原理,对于有效地使用tree包至关重要。

#### 2.1.1 决策树的基本概念

决策树是一种图形化的表示方式,用来展示一个决策过程和各种可能的结果。它由节点和分支组成:节点表示一个属性上的判断或问题,分支表示判断结果或问题答案的可能走向。树的叶节点通常代表决策的最终结果,比如一个特定的类别或数值。

在R的tree包中,通常根据数据集中的特征(变量)构建决策树,然后用它来对新的数据实例进行分类或回归分析。它是一种非参数的监督学习方法,这意味着它不需要任何关于数据分布的假设。

#### 2.1.2 CART算法详解

CART算法是tree包中的默认算法。它构建的是一种二叉树,也就是说,每个内部节点都只有两个分支。这种算法通过二分递归分割数据集,每次选择一个最优特征,并且在这个特征上选择一个阈值,使得按照这个特征和阈值分割后,生成的两个数据子集尽可能“纯”。

这里的“纯”是指数据集中的目标变量值更加集中。例如,在分类问题中,“纯”可能意味着子集中所有数据实例都属于同一个类别。CART算法使用一种叫做基尼不纯度(Gini Impurity)的指标来衡量一个数据集的不纯度。

#### 2.1.3 决策树的构建过程

构建决策树通常包括以下步骤:

1. **特征选择**:选择最佳的分割特征和阈值。

2. **树的构建**:递归地根据选定的特征分割数据集,直到满足停止条件,例如达到最大深度或树的叶节点所含的最小样本数。

3. **剪枝**:为了避免过拟合,需要对生成的决策树进行剪枝,移除那些对预测结果贡献不大的分支。

在实际应用中,决策树的构建是一个复杂的过程,涉及到对算法的调整和优化。R的tree包简化了这一过程,允许用户通过简单的函数调用来构建和使用决策树模型。

### 2.2 tree包中的决策树类型

在分类和回归任务中,决策树模型存在不同类型。理解这些类型的差异对于在实际问题中选择恰当的模型具有重要意义。

#### 2.2.1 分类树与回归树的差异

- **分类树**:用于处理分类问题,输出结果是数据点所属的类别。例如,在垃圾邮件过滤中,分类树会将邮件分为“垃圾邮件”或“非垃圾邮件”两类。

- **回归树**:用于处理回归问题,输出结果是一个连续值。例如,在房价预测中,回归树将输出一个具体的数值作为预测的房价。

分类树的分割基于类别的分布,而回归树的分割基于数据点的数值分布。尽管分类和回归树的目标不同,但它们的构建过程非常相似,主要区别在于对不纯度度量的选择以及如何处理输出结果。

#### 2.2.2 常见决策树模型比较

不同的决策树模型有不同的特点和适用场景。比较常见的决策树模型包括:

- **CART**: 是一种二叉树模型,适用于分类和回归问题。

- **ID3/C4.5**: 这些模型主要用于分类问题,C4.5是ID3的改进版,能够处理连续特征和缺失数据。

- **Chi-squared Automatic Interaction Detection (CHAID)**: 特别适用于具有多个分类变量的问题,并且在市场细分和客户细分中很流行。

了解每种模型的优缺点,能够帮助我们根据实际问题选择最合适的方法。

### 2.3 tree包在数据分析中的应用

tree包的应用广泛,无论是处理分类问题还是回归问题,它都能提供一种直观且有效的解决方案。

#### 2.3.1 数据集的准备和预处理

在使用tree包之前,首先需要准备并预处理数据。这包括:

- **数据清洗**:去除重复记录、填充缺失值或删除含有缺失值的记录。

- **特征工程**:选择或构造有助于预测目标变量的特征。

- **数据转换**:对分类变量进行编码,例如使用独热编码(One-hot Encoding)。

- **标准化/归一化**:将数值特征缩放到一个标准范围内,便于算法处理。

在R中,可以使用基础函数如`na.omit()`处理缺失值,`model.matrix()`进行特征转换等。

#### 2.3.2 数据探索与特征选择

在开始构建模型之前,进行数据探索和特征选择是非常关键的一步。这可以帮助我们了解哪些特征对于预测目标变量最重要。

- **统计检验**:进行单变量分析,使用卡方检验、ANOVA等方法评估特征与目标变量之间的关系。

- **相关性分析**:计算特征间的相关系数,了解特征间的关系强度。

- **可视化**:利用箱线图、直方图等可视化方法观察特征的分布。

R中的`cor()`函数可以计算相关系数矩阵,`ggplot2`和`graphics`包可以用来创建各种统计图表。

通过对数据集进行彻底的探索和准备,我们可以优化决策树的性能,并得到更准确的预测结果。

# 3. R语言tree包的实践教程

## 3.1 安装和配置tree包

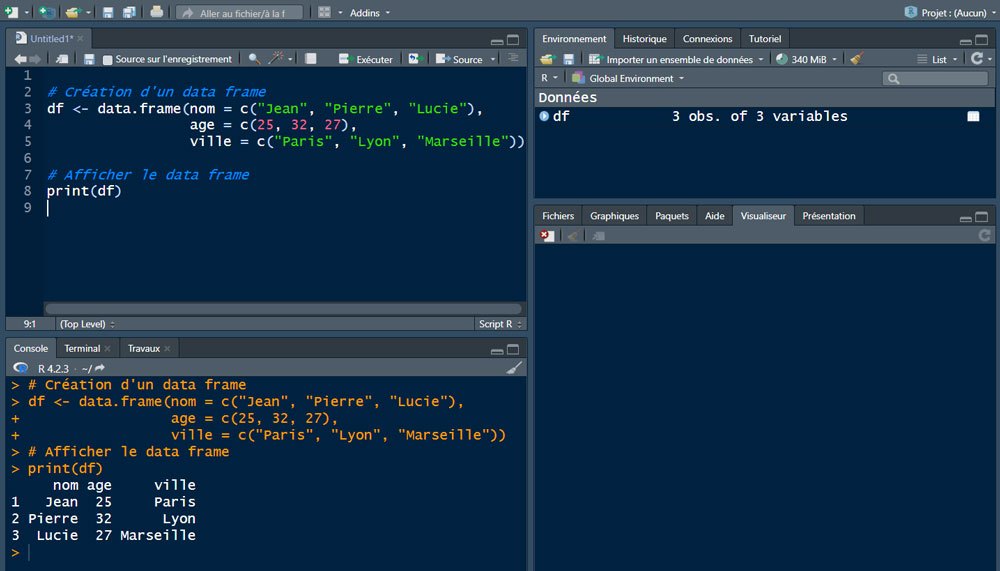

### 3.1.1 安装R语言环境

安装R语言是使用`tree`包的第一步。可以通过以下步骤在您的系统上安装R语言环境:

1. 访问R语言

0

0