【基础】python使用scapy进行网络抓包

发布时间: 2024-06-28 01:29:11 阅读量: 239 订阅数: 123

1. Scapy简介及安装

Scapy是一个强大的Python网络分析和操作工具包,它允许用户在网络层级上捕获、解析、修改和注入数据包。Scapy以其灵活性和可扩展性而闻名,使其成为网络安全专业人员、网络工程师和研究人员的理想选择。

安装Scapy

在大多数Linux发行版上,可以通过以下命令安装Scapy:

- sudo apt-get install scapy

对于Windows用户,可以通过以下步骤安装Scapy:

- 从官方网站下载Scapy安装程序。

- 运行安装程序并按照提示进行操作。

- 将Scapy添加到系统路径中(例如,在命令提示符中运行

set path=%path%;C:\Program Files\Scapy)。

2. Scapy抓包基础

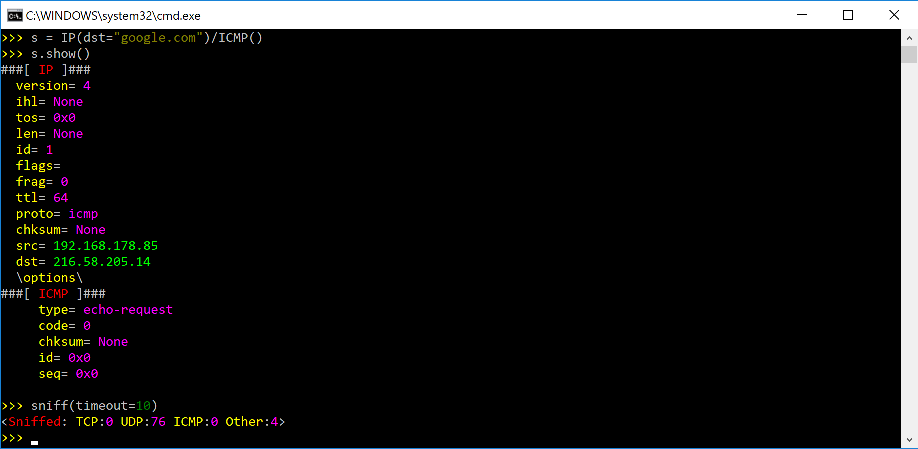

2.1 Scapy基本语法和API

Scapy是一个基于Python的网络数据包处理库,它提供了一组强大的API,用于创建、解析和操作网络数据包。Scapy的基本语法与Python类似,它使用对象表示网络数据包,并提供了一系列函数和方法来操作这些对象。

- >>> from scapy.all import *

- >>> packet = Ether()/IP()/TCP() # 创建一个简单的TCP数据包

- >>> packet.show() # 显示数据包的详细信息

Scapy还提供了一系列API,用于解析和操作网络数据包。这些API包括:

ls():列出数据包中可用的层getlayer():获取指定层的对象setlayer():设置指定层的对象dellayer():删除指定层payload():获取数据包的有效载荷

2.2 抓包过滤器

Scapy提供了强大的抓包过滤器,允许用户根据各种条件过滤网络流量。过滤器语法基于Berkeley Packet Filter (BPF),它使用布尔表达式来指定过滤条件。

- >>> sniff(filter="tcp and dst port 80") # 过滤TCP流量,目的端口为80

- >>> sniff(filter="arp and src host 192.168.1.1") # 过滤ARP流量,源主机为192.168.1.1

Scapy还支持更高级的过滤器,例如:

haslayer():检查数据包是否包含指定层load():检查数据包有效载荷是否包含指定字符串len():检查数据包长度是否满足指定条件

2.3 抓包数据的解析和处理

Scapy提供了各种方法来解析和处理抓包数据。这些方法包括:

summary():显示数据包的简要摘要hexdump():显示数据包的十六进制转储fields():显示数据包中所有字段的列表getfieldval():获取指定字段的值setfieldval():设置指定字段的值

- >>> packet = sniff()[0] # 捕获第一个数据包

- >>> packet.summary() # 显示数据包摘要

- >>> packet.hexdump() # 显示数据包十六进制转储

- >>> packet.fields() # 显示数据包字段列表

- >>> packet.getfieldval("IP.src") # 获取源IP地址

通过使用Scapy的API和过滤器,用户可以轻松地抓取、解析和处理网络流量,从而进行各种网络分析和安全任务。

3.1 流量重放和篡改

流量重放

流量重放是指将捕获的流量重新发送到网络中,以模拟特定事件或测试网络设备的响应。Scapy提供了sendp()函数来实现流量重放,其语法如下:

- def sendp(p, iface=None, count=1, inter=0, verbose=None, realtime=F

0

0