YOLOv5算法定制与扩展秘籍:根据需求定制算法,满足个性化需求

发布时间: 2024-08-15 03:15:43 阅读量: 34 订阅数: 23

# 1. YOLOv5算法概述

YOLOv5(You Only Look Once version 5)是一种单阶段目标检测算法,因其速度快、准确性高而闻名。它基于深度学习技术,使用单次前向传递来预测目标位置和类别。

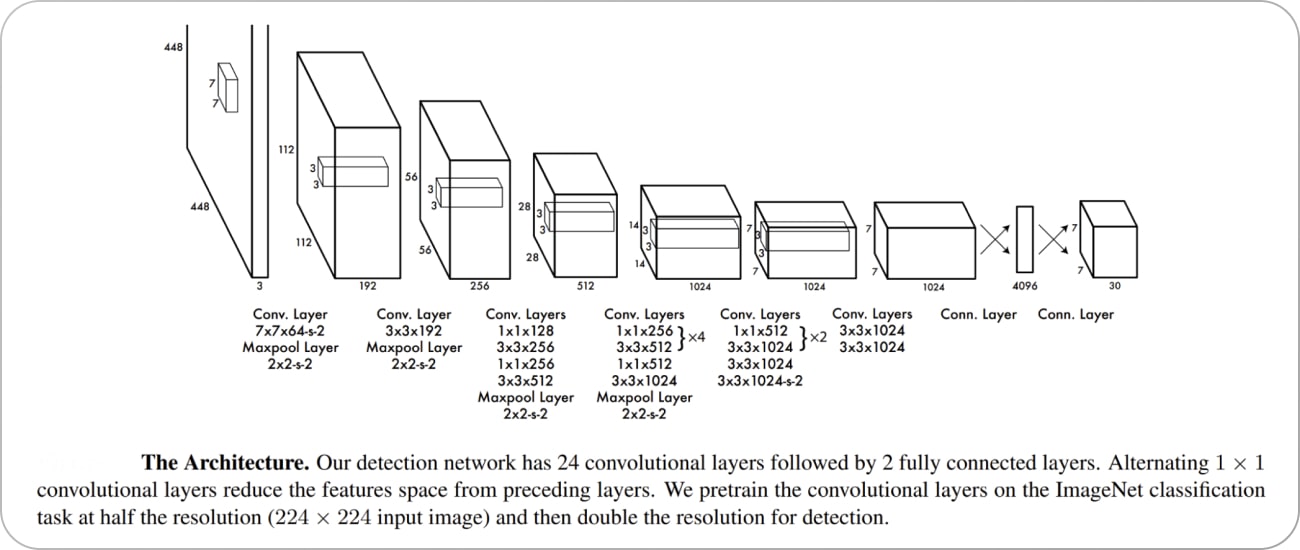

YOLOv5算法的架构采用了一个主干网络(Backbone),用于提取图像特征,以及一个检测头(Detection Head),用于预测边界框和类别概率。主干网络通常使用卷积神经网络(CNN),例如ResNet或CSPDarknet,而检测头则使用一系列卷积层和全连接层。

YOLOv5算法的训练过程涉及使用带注释的数据集,其中包含目标边界框和类别标签。算法学习将图像特征映射到预测的边界框和类别概率。通过最小化损失函数(通常是交叉熵损失和IOU损失的组合)来优化模型。

# 2. YOLOv5算法定制

YOLOv5算法作为一种先进的目标检测算法,提供了高度的可定制性,允许用户根据特定任务和资源约束对其进行定制。本章将深入探讨YOLOv5算法的定制策略,包括模型结构定制、损失函数定制和数据增强定制。

### 2.1 模型结构定制

模型结构定制涉及修改YOLOv5模型的架构,以满足特定的需求。主要有以下两种方法:

#### 2.1.1 网络层数和通道数的调整

网络层数和通道数是YOLOv5模型中两个关键的超参数。调整这些超参数可以改变模型的复杂度和容量。

- **网络层数:**增加网络层数可以提高模型的特征提取能力,但也会增加计算成本。减少网络层数可以减小模型大小和推理时间,但可能会降低模型的精度。

- **通道数:**通道数表示每个卷积层中卷积核的数量。增加通道数可以增强模型的特征表示能力,但也会增加模型大小和计算成本。减少通道数可以减小模型大小和推理时间,但可能会降低模型的精度。

#### 2.1.2 卷积核大小和步长的修改

卷积核大小和步长是卷积操作中的两个重要参数。调整这些参数可以改变模型对输入数据的处理方式。

- **卷积核大小:**卷积核大小表示卷积核中包含的像素数。较大的卷积核可以捕获更大的特征,但可能会丢失细节。较小的卷积核可以捕获更精细的特征,但可能会忽略全局信息。

- **步长:**步长表示卷积核在输入数据上移动的步长。较大的步长可以减少输出特征图的大小,但可能会丢失信息。较小的步长可以生成更大的输出特征图,但可能会增加计算成本。

### 2.2 损失函数定制

损失函数用于衡量模型预测与真实标签之间的差异。定制损失函数可以针对特定任务优化模型的训练过程。

#### 2.2.1 损失函数的选择和权重调整

YOLOv5算法使用复合损失函数,包括分类损失、定位损失和置信度损失。用户可以根据任务需求选择不同的损失函数并调整其权重。

- **分类损失:**衡量模型预测的类别与真实类别的差异。常见的分类损失函数包括交叉熵损失和二元交叉熵损失。

- **定位损失:**衡量模型预测的边界框与真实边界框之间的差异。常见的定位损失函数包括均方误差损失和IoU损失。

- **置信度损失:**衡量模型对预测边界框的置信度的准确性。常见的置信度损失函数包括二元交叉熵损失和Focal Loss。

#### 2.2.2 自适应损失函数的应用

自适应损失函数可以根据训练数据的分布动态调整损失函数的权重。这有助于解决类不平衡问题,其中某些类别的样本数量远少于其他类别。

- **Focal Loss:**Focal Loss是一种自适应损失函数,它降低了容易分类样本的权重,增加了难以分类样本的权重。

- **GIoU Loss:**GIoU Loss是一种自适应损失函数,它结合了IoU损失和广义IoU损失,可以更准确地衡量边界框的重叠程度。

### 2.3 数据增强定制

数据增强是一种技术,用于通过对训练数据进行转换和修改来增加数据集的多样性。定制数据增强策略可以针对特定任务提高模型的泛化能力。

####

0

0