编译器vs解释器:深入理解两者的根本区别

发布时间: 2024-09-23 22:28:33 阅读量: 91 订阅数: 39

# 1. 编译器和解释器概述

## 1.1 编译器与解释器的角色

编译器和解释器是现代计算机科学中的重要组件,它们将人类编写的源代码转化为计算机能理解的指令。编译器会将整个源代码一次性转换成机器代码,而解释器则逐行或逐块进行代码的解释和执行。

## 1.2 历史演进与应用背景

自编程语言诞生以来,编译器和解释器就随之发展。最初,早期的编程语言大多依赖解释执行。随着技术的进步,编译器成为了主流,因其执行速度快、效率高。解释器则在动态语言和交互式环境中占据一席之地。

## 1.3 编译器和解释器的优缺点

编译器的优点在于能够一次性生成高度优化的机器代码,而缺点是在编译过程中需要更多的资源和时间。相对地,解释器的优点是灵活且易于开发和调试,但缺点是执行速度较慢,对资源的消耗也较大。随着技术的发展,例如即时编译(JIT)技术的引入,这一界限越来越模糊。

# 2. 编译器的工作原理

## 2.1 编译器的定义和核心组成

### 2.1.1 前端分析:词法分析、语法分析

编译器的前端分析是源代码到中间表示形式(IR)的转换过程,它包括两个主要步骤:词法分析和语法分析。

#### 词法分析

词法分析器(Lexer)的工作是将源代码文本分解为一系列的标记(Tokens)。每个Token代表一个语法单元,如关键字、标识符、字面量、运算符等。它处理如下任务:

- 丢弃空白字符和注释

- 识别并报告词法错误

- 将字符序列转换成对应的Token

```python

# Python 词法分析示例

import re

def lexical_analysis(code):

tokens = re.findall(r'\b\w+\b', code)

return tokens

source_code = "int a = 10;"

tokens = lexical_analysis(source_code)

print("Tokens:", tokens)

```

在上述示例中,我们使用正则表达式来匹配代码中的单词,这简化了对Token的提取,但在实际的编译器中,词法分析器会更复杂,并处理更多种Token类型。

#### 语法分析

语法分析器(Parser)根据语法规则来分析Token流,生成抽象语法树(AST)。这个过程可以检测到更深层次的语法错误,并建立起程序的结构化表示。

```c

// C语言 语法分析过程伪代码

AST *parse_tokens(Token *tokens) {

// 实现基于特定语言语法规则的解析逻辑

// 生成并返回抽象语法树(AST)

}

```

AST是表示源代码语法结构的树状数据结构,编译器的后续阶段将基于这个结构来生成目标代码。

### 2.1.2 中间代码生成

中间代码生成是编译器的一个核心步骤,它将AST转换为一个独立于机器的中间表示(IR)。这种IR使得编译器能够进行跨平台的代码优化,并为最终的目标代码生成做准备。

#### IR的种类

IR可以是静态单赋值(SSA)形式,也可以是三地址代码等形式。IR的设计目标是:

- 便于进行代码优化

- 与目标硬件架构无关

- 便于从一种IR转换到另一种IR

```llvm

// LLVM IR 示例

define i32 @main() {

%1 = alloca i32

store i32 10, i32* %1

ret i32 0

}

```

在这个LLVM IR代码中,定义了一个名为`main`的函数,该函数返回一个整数。IR的设计使得后续可以基于此进行优化,并最终生成不同平台的目标代码。

## 2.2 编译过程详解

### 2.2.1 代码优化阶段

编译器中的代码优化是一个提高程序性能的过程。优化可以在不同级别进行,包括IR级别、寄存器级别、指令级别等。

#### 优化的分类

- **局部优化**:仅考虑单个基本块内的指令。

- **全局优化**:考虑多个基本块或整个程序,以便做出更优的优化决策。

- **循环优化**:专门针对循环结构的优化,以提高循环效率。

- **机器无关优化**:在IR级别进行,与特定的硬件无关。

```c

// 代码优化的一个简单示例:常数折叠

// 优化前的IR

%1 = add i32 3, 4

%2 = mul i32 %1, 5

// 优化后的IR

%2 = mul i32 8, 5

```

在这个例子中,`%1`的计算是不必要的,因为3和4的和是一个常数。优化器会进行常数折叠,直接用常数替换不必要的运算。

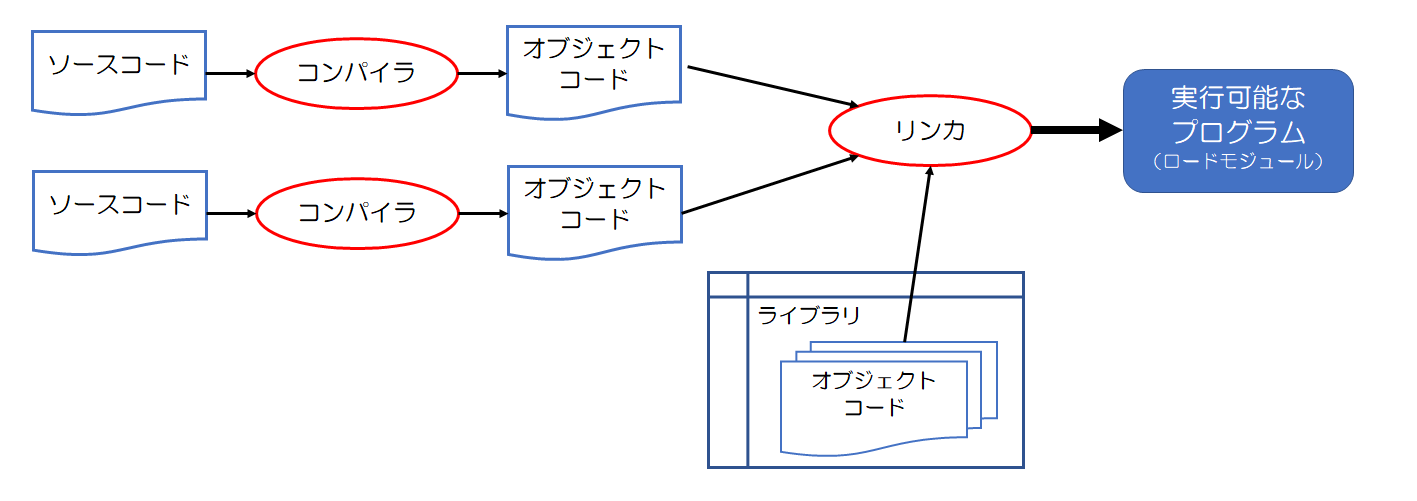

### 2.2.2 目标代码生成与链接

目标代码生成是将优化后的IR转换为机器代码的过程。链接是将编译得到的目标代码文件与其他库文件合并,形成最终可执行文件的步骤。

#### 目标代码生成

目标代码生成过程通常涉及寄存器分配和指令选择等步骤。寄存器分配涉及确定哪些变量应该存储在CPU寄存器中以加快访问速度,而指令选择则是从目标机器的指令集中选择指令来实现IR指令。

```c

// 汇编代码示例,对应于某种指令集架构

mov eax, 10 ; 将值10加载到EAX寄存器

add eax, 20 ; 将值20加到EAX寄存器的当前值上

```

#### 链接

链接器负责解决程序中的符号引用,即程序代码中出现的所有函数和变量的外部引用。链接器会将这些引用与库文件或其他目标文件中的定义匹配,并产生可执行文件。

```sh

# 链接命令示例(假设链接器名为ld)

ld -o output_file input_file.o -llibrary

```

在上述命令中,`-o output_file`指定输出文件的名称,`input_file.o`是目标文件,`-llibrary`指定链接的库文件。

## 2.3 编译器与操作系统的关系

### 2.3.1 编译器如何与硬件交互

编译器需要与硬件平台的特性交互,以便生成高效且兼容的机器代码。例如,处理器的指令集架构(ISA)、寄存器数量和类型、缓存结构以及总线速度等都会影响编译过程。

#### 指令集架构(ISA)

编译器需要针对特定的ISA生成代码。ISA定义了处理器能理解和执行的指令集。例如,x86架构的ISA与ARM架构的ISA有着明显的区别。

```c

// 指令集架构的代码示例

// x86架构汇编指令

mov eax, [esi] ; 将ESI寄存器指向的内存地址中的数据移动到EAX寄存器

// ARM架构汇编指令

ldr r0, [r1] ; 将R1寄存器指向的内存地址中的数据加载到R0寄存器

```

### 2.3.2 操作系统的角色和影响

操作系统提供了软件运行的基础环境,并管理资源。它在编译器和目标代码之间扮演着中间层的角色。操作系统处理内存管理、文件系统访问、进程调度等功能。

#### 内存管理

操作系统的内存管理单元(MMU)对编译器生成的代码有直接影响。编译器必须考虑到虚拟内存和物理内存之间的映射关系,并处理内存的分配和回收。

```c

// 假设的内存分配示例代码

void *allocate_memory(size_t size) {

return mmap(NULL, size, PROT_READ | PROT_WRITE,

MAP_PRIVATE | MAP_ANONYMOUS, -1, 0);

}

```

在该示例中,`mmap`函数是POSIX标准中的一个系统调用,用于分配内存。

通过以上内容,我们详细探讨了编译器工作的核心原理,从词法语法分析到代码优化,再到目标代码生成与链接,以及编译器如何与硬件和操作系统交互。这为理解编译器的复杂性和其在现代软件开发中的作用提供了坚实的基础。

# 3. 解释器的工作机制

解释器在现代编程语言的执行中扮演着核心的角色。不同于编译器,解释器逐行或逐块地分析代码,并在运行时即时执行指令。本章将深入探讨解释器的工作原理,分类,执行过程,以及它们与运行时环境的交互。

## 3.1 解释器的基本概念和分类

解释器在编程语言执行机制中占据独特地位。不同于将整个程序转化为机器代码的编译器,解释器在程序执行时即时地将源代码翻译成可执行的指令。这种运行时翻译带来了灵活性和跨平台性,但也通常以牺牲性能为代价。

### 3.1.1 直译式和即时编译式解释器

解释器根据执行方式不同,主要分为直译式(Interpreted)和即时编译式(JIT, Just-In-Time)两种类型。

#### 直译式解释器

直译式解释器在执行程序时,逐条读取源代码,然后解释执行,不产生中间形式的目标代码。这种方式的优点在于其跨平台性,因为源代码在不同的目标平台可以被重新解释执行。Python和Rub

0

0