迁移学习在自动驾驶中的前沿:感知、规划与决策,开启智能驾驶新时代

发布时间: 2024-08-21 17:09:10 阅读量: 61 订阅数: 43

基于深度学习的自动驾驶感知算法研究

# 1. 迁移学习在自动驾驶中的概述**

迁移学习是一种机器学习技术,它可以利用在特定任务上训练过的模型,来解决其他相关但不同的任务。在自动驾驶领域,迁移学习具有巨大的潜力,因为它可以帮助自动驾驶系统从现有知识中学习,并快速适应新的环境和任务。

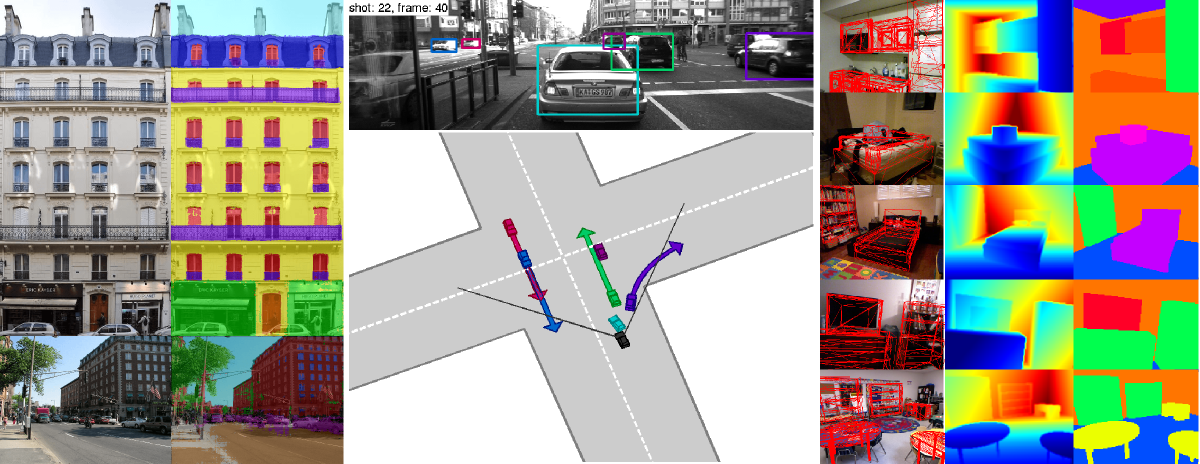

迁移学习在自动驾驶中的应用主要集中在感知、规划和决策任务上。在感知任务中,迁移学习可以用于图像识别、目标检测、语义分割和深度估计。在规划任务中,迁移学习可以用于路径规划、决策和运动规划。在决策任务中,迁移学习可以用于行为决策、预测和驾驶行为建模。

迁移学习在自动驾驶中的主要优势包括:减少数据需求、提高模型性能、加快训练速度和提高适应性。通过利用预训练模型,自动驾驶系统可以从大量标记数据中学习,即使在目标任务中只有少量标记数据可用。迁移学习还可以帮助自动驾驶系统泛化到新的环境和场景,从而提高其鲁棒性和安全性。

# 2. 感知任务中的迁移学习

### 2.1 图像识别与目标检测

#### 2.1.1 领域自适应方法

领域自适应旨在将源域(具有标注数据)中训练的模型迁移到目标域(数据分布不同且没有标注)。在图像识别和目标检测任务中,领域自适应方法通过对齐源域和目标域的特征分布来减轻分布差异。

一种常见的领域自适应方法是**对抗性域适应(ADA)**。ADA训练一个对抗性域分类器,该分类器试图区分源域和目标域的特征。同时,训练一个目标分类器,该分类器在联合特征空间中执行图像识别或目标检测任务。通过最小化对抗性域分类器的损失,模型学习对齐源域和目标域的特征分布。

```python

import torch

import torch.nn as nn

class DomainAdversarialLoss(nn.Module):

def __init__(self):

super(DomainAdversarialLoss, self).__init__()

self.domain_classifier = nn.Linear(1024, 2) # 1024为特征维度,2为源域和目标域

def forward(self, features, labels):

# 特征对齐

domain_logits = self.domain_classifier(features)

domain_loss = nn.CrossEntropyLoss()(domain_logits, labels)

# 目标任务

target_logits = ... # 目标分类器的逻辑

return domain_loss, target_logits

```

#### 2.1.2 弱监督学习技术

弱监督学习利用大量未标注数据和少量标注数据来训练模型。在图像识别和目标检测任务中,弱监督学习技术通过从未标注数据中挖掘伪标签或利用图像级标注来增强模型性能。

一种常见的弱监督学习技术是**伪标签**。伪标签通过使用训练好的模型对未标注数据进行预测来生成伪标签。然后,模型在伪标签和少量标注数据上联合训练。通过迭代更新伪标签,模型可以从未标注数据中学习有用的知识。

```python

import torch

import torch.nn as nn

class PseudoLabelLoss(nn.Module):

def __init__(self):

super(PseudoLabelLoss, self).__init__()

self.confidence_threshold = 0.9 # 伪标签置信度阈值

def forward(self, features, unlabeled_images):

# 预测未标注图像的伪标签

pseudo_logits = self.model(unlabeled_images)

max_probs, pseudo_labels = torch.max(pseudo_logits, dim=1)

# 过滤置信度低的伪标签

mask = max_probs > self.confidence_threshold

pseudo_labels = pseudo_labels[mask]

# 计算伪标签损失

pseudo_label_loss = nn.CrossEntropyLoss()(pseudo_logits, pseudo_labels)

return pseudo_label_loss

```

### 2.2 语义分割与深度估计

#### 2.2.1 多任务学习框架

多任务学习旨在通过同时训练多个相关的任务来提高模型性能。在语义分割和深度估计任务中,多任务学习框架利用任务之间的相关性来增强模型对不同场景的理解。

一种常见的多任务学习框架是**联合语义分割和深度估计(JSDE)**。JSDE模型同时执行语义分割和深度估计任务。通过共享卷积层和特征提取器,模型可以从两个任务中学习互补信息。

```python

import torch

import torch.nn as nn

class JointSemanticSegmentationAndDepthEstimation(nn.Module):

def __init__(self):

super(JointSemanticSegmentationAndDepthEstimation, self).__init__()

self.shared_encoder = ... # 共享的卷积层和特征提取器

self.segmentation_head = ... # 语义分割头

self.depth_estimation_head = ... # 深度估计头

def forward(self, images):

# 特征提取

features = self.shared_encoder(images)

# 语义分割

segmentation_logits = self.segmentation_head(f

```

0

0