Hadoop集群性能提升:块大小调整的实战演练

发布时间: 2024-10-29 01:00:09 阅读量: 24 订阅数: 32

基于springboot的酒店管理系统源码(java毕业设计完整源码+LW).zip

# 1. Hadoop集群性能概述

在大数据技术生态中,Hadoop是作为存储和处理海量数据的关键性分布式计算平台。它通过其核心组件HDFS(Hadoop Distributed File System)和MapReduce实现了高度的可扩展性和容错性,是处理大规模数据集的基础设施。Hadoop集群性能的优化不仅涉及硬件和网络配置,还包括对集群内部参数的精细调整,比如HDFS的块大小。这一设置对于数据的读写效率、存储利用率以及计算任务的性能都有直接或间接的影响。本章旨在为读者提供一个关于Hadoop集群性能的概览,为后续深入探讨块大小的调整打下基础。

# 2. Hadoop块大小理论基础

## 2.1 Hadoop块大小的作用

### 2.1.1 块大小与HDFS存储的关系

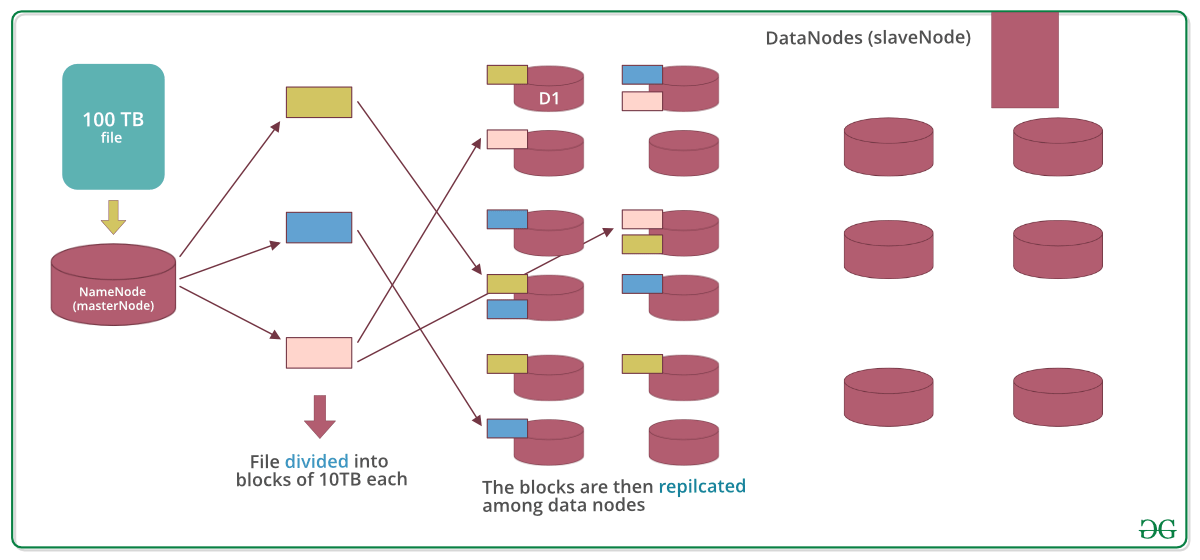

在Hadoop分布式文件系统(HDFS)中,文件被分割成一系列的块(block),默认情况下,每个块的大小是128MB。块的大小是HDFS存储和访问数据的关键因素之一,对系统的整体性能有着直接的影响。

块作为数据存储的基本单位,关系到数据在HDFS上的分布方式。当数据被上传到HDFS时,文件被切分成块,这些块以冗余的方式存储在不同的DataNode上。这种设计使得Hadoop能够实现高效的并行处理和容错能力。块的大小越大,可以减少NameNode的元数据压力,因为每个文件只需要更少的块来表示。然而,如果块过大,可能导致数据倾斜问题,即某些DataNode上的块数量远多于其他节点,影响系统均衡。

### 2.1.2 块大小对MapReduce性能的影响

MapReduce是Hadoop的主要编程模型,用于处理大规模数据集。块的大小直接影响MapReduce作业的执行效率。合适的块大小可以确保Map任务的工作负载均衡,同时避免不必要的网络传输。

假设块大小过小,将会导致Map任务的数量增多,这可能会带来两个主要问题:首先,过多的Map任务意味着更多的任务调度开销,降低整体效率;其次,大量的Map任务在完成时会向同一个Reduce任务传输中间数据,增加了网络负载。反之,如果块大小设置得过大,单个Map任务处理的数据量就会增加,这可能会导致单点处理瓶颈,并且降低了系统的容错能力。

## 2.2 调整块大小的理论依据

### 2.2.1 数据访问模式分析

调整块大小之前,了解数据的访问模式是非常重要的。数据访问模式指的是数据的读取和写入的频率、模式和速度。例如,对于读取密集型的数据,更大的块可能更合适,因为这样可以减少NameNode的元数据操作,并且单个Map任务可以处理更多的数据,提高整体的I/O吞吐量。

对于写入密集型的应用,可能需要考虑更小的块,以减少因错误导致的数据重写。此外,如果数据经常被部分更新,小块可以提供更好的灵活性,因为只需要重写数据的一部分而不是整个块。因此,数据访问模式的不同,对于决定调整块大小是非常关键的。

### 2.2.2 网络带宽与I/O吞吐量考量

在调整Hadoop块大小时,网络带宽和I/O吞吐量也是重要的考量因素。块大小决定了数据在DataNode之间传输的大小,进而影响网络带宽的使用情况。如果块设置得太小,那么网络传输的数据包数量会增加,这可能成为网络带宽的瓶颈,进而降低数据处理的效率。

另一方面,如果块大小设置得过大,虽然可以减少网络传输的次数,但是如果数据块在处理时需要跨节点移动,那么就会增加网络的负载和延迟。此外,I/O吞吐量也会受到影响,因为更大的块意味着在有限的I/O带宽下,每次能够传输的数据量更大,但同样也要保证磁盘能够处理这种增加的数据量。

调整块大小之前,需要评估现有的网络带宽和I/O吞吐量,确保系统的其他部分可以适应块大小的调整,从而达到最佳的系统性能。如果资源不足,可能需要进行硬件升级或者在块大小调整的同时,优化其他系统配置以达到平衡。

# 3. 块大小调整前的准备工作

在深入探讨如何调整Hadoop集群中的块大小之前,本章节将会介绍一些关键的准备步骤。这些步骤是成功调整块大小并确保集群性能得到优化的前提。准备工作包括对系统性能的评估,以及对集群现有配置的详细检查。只有全面了解了当前集群的状态,才能合理地调整块大小,避免潜在的问题,并确保调整后的性能提升。

## 3.1 系统性能评估

评估系统性能是一个关键的步骤,它能帮助我们了解当前集群的工作状况,以及是否有必要调整块大小。这一部分会深入分析集群中硬件资源的使用情况,以及在现有块大小设置下的集群性能。

### 3.1.1 硬件资源分析

评估硬件资源包括但不限于以下几点:

- **CPU资源:** 使用工具如`top`或`htop`来监控集群中每个节点的CPU使用情况。

- **内存使用:** 通过`free -m`命令来查看各节点内存的使用量,确保内存资源充足。

- **磁盘I/O:** 利用`iostat`工具来监控磁盘的读写速度,评估磁盘性能是否成为瓶颈。

- **网络带宽:** 使用网络监控工具如`iperf`,来测试网络的传输速度,确保网络带宽满足集群通信需求。

进行硬件资源分析的目的是确保硬件资源在调整块大小后能够得到充分且合理的利用,同时也能及时发现并解决可能存在的硬件性能瓶颈。

### 3.1.2 现有块大小

0

0