MapReduce大文件处理指南:从理论到实践的完整路径

发布时间: 2024-11-01 13:32:59 阅读量: 3 订阅数: 7

# 1. MapReduce框架概述

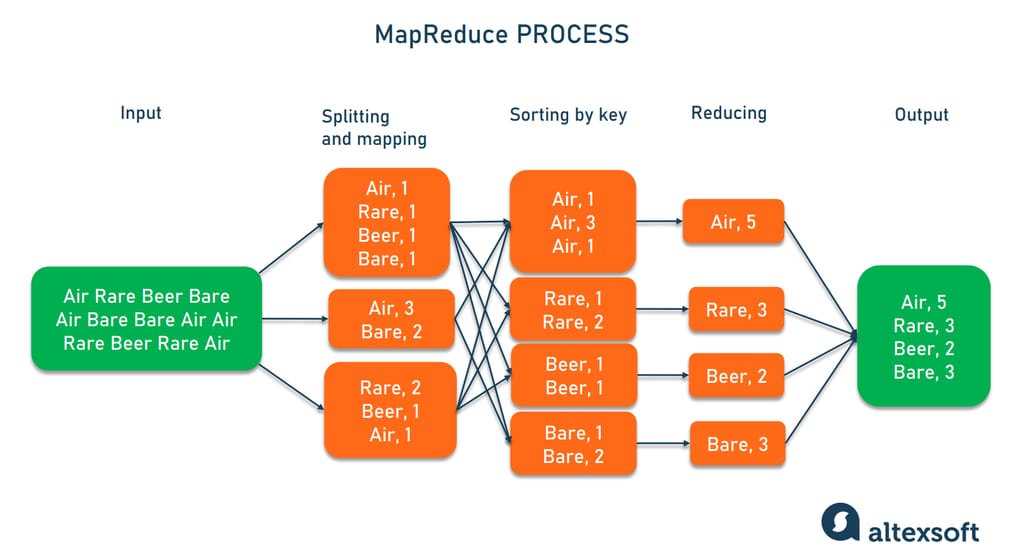

MapReduce是一种编程模型,用于处理大规模数据集的并行运算。最初由Google提出,后来成为Apache Hadoop的核心组件。该模型将任务分为Map(映射)和Reduce(归约)两个阶段,通过这种方式,MapReduce能够将复杂的计算分布到多个节点上进行处理。

Map阶段负责数据的分割和初步处理,它接收输入数据,并将它们转换成一系列中间键值对。Reduce阶段则对这些中间数据进行汇总和进一步处理,从而得出最终结果。

这种分而治之的策略使得MapReduce非常适合于执行大规模的批量数据处理任务,尤其是在需要水平扩展和高容错性的场景中,MapReduce框架的优势更为明显。在深入探讨MapReduce大文件处理之前,理解其核心原理和工作流程是必不可少的。

# 2. MapReduce大文件处理基础

## 2.1 分析大文件的挑战

### 2.1.1 大文件对MapReduce的影响

在处理大数据时,大文件带来的影响不容忽视。它们在存储和处理时都会对MapReduce框架提出更高的要求。由于MapReduce的任务调度基于分块处理,单一大文件可能会导致Map阶段的单个任务负载异常高,从而成为整个作业处理的瓶颈。这种现象通常被称为数据倾斜,它会严重拖慢整个MapReduce作业的执行速度。

大文件还可能导致网络I/O瓶颈。在分布式计算环境中,数据块需要在节点间传输,如果文件过大,传输时间将显著增加,这不仅影响作业的执行速度,而且增加了故障恢复的时间成本。此外,对于存储系统而言,大文件意味着更多连续存储空间的占用,这可能导致存储设备出现热点问题,即存储设备某些区域频繁读写,加速设备磨损。

### 2.1.2 大文件处理的常见问题

处理大文件时常见的问题包括但不限于:

- **节点间负载不均衡**:大文件可能导致Map任务的负载不均衡,一些节点处理的数据量远大于其他节点。

- **内存不足**:如果Map任务试图一次性加载大文件的大部分或全部数据到内存中,可能引起内存溢出错误。

- **性能瓶颈**:大文件的处理和传输往往耗时较长,成为整个MapReduce作业的性能瓶颈。

- **数据安全和备份问题**:大文件占用更多存储空间,增加了备份的难度和成本,且单点故障可能导致巨大数据损失。

为了应对这些挑战,MapReduce框架需要具备高效的大文件处理能力,这通常包括优化Map任务的分配策略、提高数据处理和传输的效率,以及增强系统的容错能力。

## 2.2 MapReduce编程模型详解

### 2.2.1 Map函数的工作原理

Map函数是MapReduce编程模型的核心,负责处理输入数据并生成中间键值对。对于每个输入数据块,Map函数会执行用户定义的Map任务,将数据转换成一系列中间键值对输出。

Map函数的工作原理可以简化为以下几个步骤:

1. **读取输入**:读取一个或多个输入数据块,通常是存储在HDFS上的文件。

2. **解析数据**:对数据块进行解析,根据应用逻辑提取键值对。

3. **应用用户函数**:将提取的键值对作为输入传递给用户定义的Map函数。

4. **输出中间键值对**:Map函数处理键值对后,输出中间键值对。

Map函数的输出将作为Reduce函数的输入。

```java

// 一个简单的Java Map函数示例

public static class MyMapClass extends Mapper<KEYIN, VALUEIN, KEYOUT, VALUEOUT> {

public void map(KEYIN key, VALUEIN value, Context context)

throws IOException, InterruptedException {

context.write(key, value);

}

}

```

### 2.2.2 Reduce函数的工作原理

Reduce函数负责对Map函数输出的中间键值对进行合并处理。它按照键对所有的中间值进行归并操作,生成最终的结果输出。

Reduce函数的执行过程包含以下步骤:

1. **接收中间键值对**:从Map任务中接收到按键排序的键值对序列。

2. **分组**:将相同键的所有值归组在一起。

3. **应用用户函数**:用户定义的Reduce函数被应用于每个键及其对应的值组。

4. **输出最终结果**:Reduce函数处理完毕后,输出最终的键值对结果。

```java

// 一个简单的Java Reduce函数示例

public static class MyReduceClass extends Reducer<KEYOUT, VALUEOUT, KEYOUT, VALUEOUT> {

public void reduce(KEYOUT key, Iterable<VALUEOUT> values, Context context)

throws IOException, InterruptedException {

// 对所有的values进行合并操作

for(VALUEOUT val : values) {

context.write(key, val);

}

}

}

```

### 2.2.3 分区、排序和分组机制

MapReduce框架在Map函数和Reduce函数之间提供了分区、排序和分组机制:

- **分区(Partitioning)**:Map任务的输出会被发送到不同的Reduce任务进行处理,分区函数决定了每个键值对应该发送到哪个Reduce任务。通常,这个分区函数基于键的哈希值来决定。

- **排序(Sorting)**:每个分区内的键值对会被排序。排序操作确保了相同键的值彼此相邻,为后续的Reduce处理提供方便。

- **分组(Grouping)**:排序后的键值对会被分组,即具有相同键的所有值被组合在一起,形成一个值的列表,供Reduce函数进行处理。

这些机制确保了Map函数和Reduce函数之间的无缝协作,并为数据处理提供了高度的并行性。

```mermaid

graph LR

A[Map任务输出] -->|分区| B[Partitioning]

B -->|排序| C[Sorting]

C -->|分组| D[Grouping]

D -->|键值对| E[Reduce任务处理]

```

## 2.3 大文件处理策略

### 2.3.1 拆分大文件

对于大文件,最直接的处理策略是将大文件拆分为多个小文件。这种做法可以减少单个Map任务的负载,从而提高整体处理的并发度。拆分操作可以通过Hadoop的`split`命令或者编程时手动设置输入格式来实现。

拆分大文件时,需要考虑以下因素:

- **拆分逻辑**:应根据数据的逻辑结构来拆分文件,例如,按时间戳、用户ID或事务ID进行拆分。

- **拆分大小**:拆分得到的小文件不宜过小,以免造成过多的文件元数据开销;也不宜过大,以避免单个Map任务负载过重。

### 2.3.2 合并小文件

处理完拆分后的多个小文件后,可能会留下大量的小文件。这些小文件会导致HDFS上的小文件问题,例如:

- **大量文件句柄**:每个小文件都需要一个文件句柄,过多的文件句柄会导致NameNode的内存使用压力大增。

- **性能开销**:小文件处理需要更多的定位和寻址时间,且文件元数据管理成本高。

合并小文件通常涉及到额外的MapReduce作业,可以使用一个简单的MapReduce程序将小文件合并为大文件,或者将它们归档到一个Hadoop归档文件(HAR)中。

### 2.3.3 数据本地性优化

数据本地性是提高MapReduce作业性能的关键因素。理想情况下,Map任务应该尽可能在数据所在的节点执行,以减少网络传输开销。Hadoop通过数据本地性调度器来优化这一点。

数据本地性包括以下三种类型:

- **理想本地性(Node Local)**:数据和Map任务在同一节点。

- **机架本地性(Rack Local)**:数据和Map任务在同一个机架的不同节点。

- **非本地性(Off Switch)**:数据和Map任务不在同一个机架,需要跨网络传输。

优化数据本地性需要在作业提交时考虑:

- **数据分布**:HDFS应合理分布数据块,以提高本地性。

- **资源分配**:ResourceManager和NodeManager应优化任务调度,优先考虑数据本地性。

利用数据本地性优化,可以显著减少MapReduce作业的执行时间,提高数据处理效率。

# 3. MapReduce大文件处理实践

## 3.1 Hadoop生态系统中的工具使用

### 3.1.1 使用HDFS进行文件管理

Hadoop分布式文件系统(HDFS)是处理大规模数据集的理想选择,它提供了高吞吐量的数据访问,适合运行在廉价的硬件上。在处理大文件时,HDFS的容错性和扩展性尤为关键。

#### 关键特性:

- **NameNode**:管理文件系统的命名空间,并维护整个文件系统的元数据。NameNode记录每个文件中各个块所在的DataNode节点。

- **DataNode**:在集群的节点上存储实际的数据块,并处理文件系统客户端的读写请求。

- **Block**:HDFS将大文件分割成固定大小的块(默认128MB),并跨多个DataNode进行存储,以实现数据冗余。

#### 操作步骤:

1. **上传大文件到HDFS**:

```bash

hadoop fs -put localfile /user/hadoop/hDFSdir

```

2. **查看文件块信息**:

```bash

hadoop fsck /user/hadoop/hDFSdir/file -files -blocks -locations

```

3. **优化大文件的存储**:通过调整`dfs.block.size`参数来设定块的大小,可以根据数据的特性进行调整以减少管理开销。

4. **自动化数据平衡**:使用`hadoop balancer`命令来平衡集群中各个DataNode的数据分布,减少数据倾斜。

### 3.1.2 利用Pig和Hive进行数据处理

Pig和Hive是构建在Hadoop之上的高层次的数据处理工具,它们提供了类似SQL的接口来处理大数据。

#### Pig Latin:

- **数据流语言**:Pig Latin是一种数据流语言,允许用户进行复杂的数据转换。

- **用户定义函数(UDF)**:Pig可以通过UDF来扩展其功能,比如进行自定义的数据解析和转换。

#### 示例代码:

```pig

A = load 'input.txt' as (line:chararray);

B = foreach A generate flatten(TOBAG(split(line, ' '))) as word;

C = group B by word;

D = foreach C generate group, COUNT(B) as count;

store D into 'wordcount.txt';

```

#### Hive:

- **数据仓库工具**:Hive用于在Hadoop集群上进行数据摘要、查询和分析。

- **QL查询语言**:Hive QL与SQL相似,但进行了优化以适应大数据。

#### 示例代码:

```sql

CREATE TABLE IF NOT EXISTS employee (

id INT,

name STRING,

salary DOUBLE,

department STRING

)

ROW FORMAT DELIMITED

FIELDS TERMINATED BY ','

STORED AS TEXTFILE;

INSERT OVERWRITE TABLE employee

SELECT id, name, salary, department

FROM employee

WHERE salary > 50000;

```

在上述代码中,我们定义了一个表结构,并展示了如何导入数据和执行基本的查询操作。

## 3.2 优化MapReduce作业性能

### 3.2.1 资源管理和调度优化

在Hadoop集群中,资源管理和任务调度是决定MapReduce性能的关键因素。YARN(Yet Another Resource Negotiator)是Hadoop 2.x引入的资源管理平台,它可以动态地分配集群资源。

#### 关键组件:

- **ResourceManager (RM)**:负责整个集群的资源管理和调度。

- **NodeManager (NM)**:在集群的每个节点上运行,管理单个节点上的资源。

- **ApplicationMaster (AM)**:为每个应用程序运行一个实例,负责与ResourceManager协商资源,并监控任务的执行。

#### 优化策略:

- **队列管理**:合理配置队列资源限制,根据不同的用户或应用需求设置优先级和资源配额。

- **调度器选择**:选择适合应用

0

0