【深度解析Hive数据模型】:揭秘表、分区与桶的内部工作原理

发布时间: 2024-10-26 01:54:56 阅读量: 33 订阅数: 34

# 1. Hive数据模型简介

Hive是构建在Hadoop之上的数据仓库工具,允许使用类似于SQL的语言(HiveQL)查询和管理大规模数据集。在处理传统关系数据库管理系统(RDBMS)操作时,Hive通过MapReduce来实现数据的转换和查询,特别适合用于数据分析和批处理操作。

## 1.1 Hive数据模型的基本概念

Hive的数据模型与传统数据库有所不同,它将数据存储在分布式文件系统(如HDFS)中,并提供了表、分区和桶等概念来管理这些数据。

```sql

CREATE TABLE default.my_table (id int, name string)

ROW FORMAT DELIMITED

FIELDS TERMINATED BY ','

STORED AS TEXTFILE;

```

在上面的HiveQL命令中,我们创建了一个名为`my_table`的表,其中包括两列:`id`和`name`。我们指定了字段分隔符为逗号,并且数据存储格式为文本文件。

## 1.2 Hive数据模型的核心组件

Hive数据模型的核心组件包括:

- **表(Tables)**:是Hive数据模型的基础单元,用于存储数据。Hive中的表可以包含多种数据格式,如文本、ORC、Parquet等。

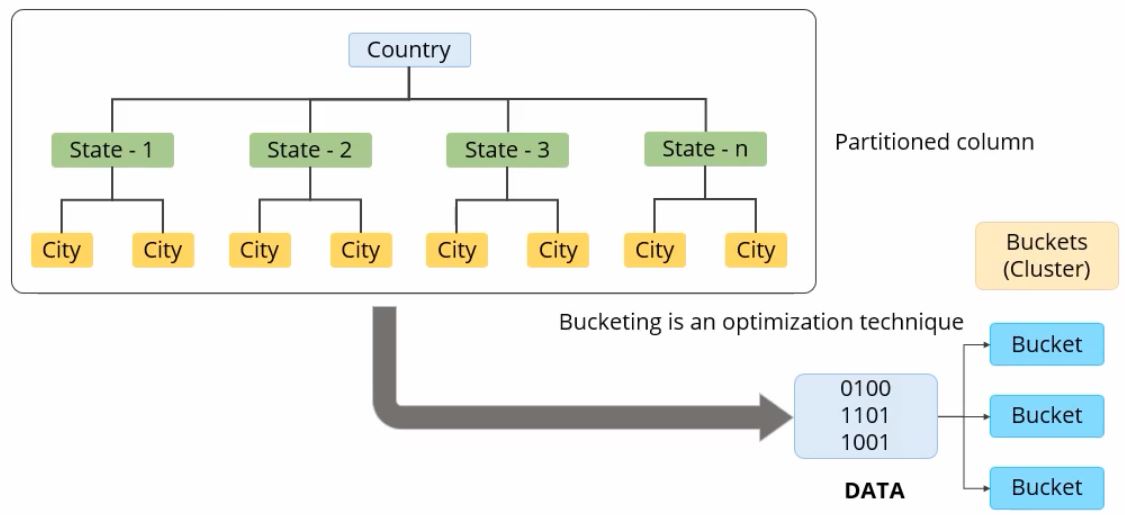

- **分区(Partitions)**:用于将数据分隔成更小的逻辑部分,便于管理和查询。

- **桶(Buckets)**:一种更细粒度的数据分割方式,常用于抽样查询和并行处理。

通过这些组件,Hive允许用户以一种高效、易于理解的方式处理大规模数据集。在下一章,我们将深入探讨Hive表的内部工作机制,并通过实际操作来展示如何在Hive中进行数据管理。

# 2. Hive表的内部工作机制

Hive表是Hive数据仓库的基础单元,它允许用户以类似传统关系型数据库表的方式存储和查询数据。Hive表的内部工作机制涉及了数据的存储、查询处理以及表属性的管理等多个方面。为了深入理解Hive表的工作原理,我们将从概念模型开始,到表的操作实践,再到优化策略,进行逐步深入的探讨。

## 2.1 Hive表的概念模型

在概念层面,Hive表与传统数据库表十分相似,但是它的存储机制与数据处理方式有本质的区别。理解Hive表的概念模型是深入学习Hive数据模型的关键。

### 2.1.1 表的逻辑结构与物理存储

在Hive中,表的逻辑结构是用户定义的元数据,包括列名、列类型等信息。Hive表的物理存储则是位于HDFS上的数据文件。Hive内部使用列式存储格式来存储数据,这允许更高效的数据读取,尤其是在进行列裁剪(Column Pruning)时。

Hive表通常会指定一种存储格式,如RCFile、ORC或Parquet,这些格式对存储效率和查询性能都有显著的影响。存储格式的选择取决于数据的特性以及查询需求。例如,如果查询经常涉及大量数据的聚合操作,那么ORC格式可能是更好的选择,因为它在存储和处理数据时可以提供较高的压缩率和查询性能。

### 2.1.2 表数据的存储格式与压缩技术

Hive表数据的存储格式决定了数据是如何在文件系统上存储的。Hive支持多种存储格式,每种格式都有其特点和适用场景。例如:

- **RCFile (Record Columnar File)**:一种行组存储格式,它将数据以行组为单位进行存储,每个列的数据在文件中连续存储。

- **ORC (Optimized Row Columnar)**:一种高度优化的列式存储格式,能够提供更高的压缩率和更快的查询性能。

- **Parquet**:一种面向分析型业务的列式存储格式,支持压缩和编码方案,可以有效减少磁盘I/O操作。

压缩技术能够减小文件的存储空间,提高数据读写效率。Hive支持多种压缩编码,比如Snappy、GZIP等。在Hive中使用压缩技术,可以显著减少数据的存储空间占用,并在查询时减少磁盘I/O操作。

## 2.2 Hive表的操作实践

Hive表的操作实践涉及到创建表、加载数据、表属性管理以及数据插入等。这些操作是Hive表数据处理的基础。

### 2.2.1 创建表与管理表属性

创建Hive表首先需要定义表的元数据信息。例如,定义表结构、指定存储格式和压缩技术等。创建表的基本语法如下:

```sql

CREATE TABLE IF NOT EXISTS table_name(

column1_name data_type1,

column2_name data_type2,

...

)

ROW FORMAT DELIMITED

FIELDS TERMINATED BY ','

STORED AS TEXTFILE;

```

在上述示例中,我们创建了一个名为`table_name`的表,其中包含了`column1_name`和`column2_name`两列。`ROW FORMAT DELIMITED`指定了行分隔符,`FIELDS TERMINATED BY ','`指定了字段分隔符,`STORED AS TEXTFILE`指定了数据存储格式为文本格式。

此外,表属性的管理也是Hive表操作的一个重要方面,包括调整存储格式、压缩编码以及更改表的其他配置参数等。通过使用`ALTER TABLE`语句可以更改表的属性:

```sql

ALTER TABLE table_name SET TBLPROPERTIES('serialization.format' = ',');

```

上述语句将`table_name`表的序列化格式设置为逗号分隔。

### 2.2.2 加载数据与表的数据插入

加载数据到Hive表中通常是通过`LOAD DATA`语句实现的,该语句允许用户将文件系统上的数据快速移动到Hive表中。

```sql

LOAD DATA INPATH '/user/data/input' INTO TABLE table_name;

```

这个命令将HDFS上的`/user/data/input`目录下的数据加载到`table_name`表中。

此外,还可以使用`INSERT`语句将数据从一个Hive表插入到另一个表中,或者使用查询结果来填充表数据:

```sql

INSERT OVERWRITE TABLE table_name SELECT * FROM source_table WHERE condition;

```

上面的`INSERT`语句通过从`source_table`选择满足`condition`条件的数据来填充`table_name`表。

## 2.3 Hive表的优化策略

Hive表的优化是提高查询性能的关键步骤。优化可以包括调整表的存储格式、压缩技术,以及通过分区和索引来加快查询速度。

### 2.3.1 分区与分区剪枝优化

分区是Hive中用于提高查询效率的重要机制。分区表允许用户将数据按照某个或某些列的值进行逻辑分区,这样可以只查询特定分区的数据,从而减少查询时需要处理的数据量。

例如,如果一个表按照日期进行分区,查询时只需要访问特定日期的分区即可,这样可以显著提高查询效率。

分区剪枝是Hive优化查询时的一项技术,它能够排除掉不包含查询条件数据的分区。例如,如果查询条件是`WHERE date >= '2023-01-01'`,那么Hive就会剪枝掉所有`date`字段值小于`2023-01-01`的分区,避免了不必要的数据扫描。

### 2.3.2 索引与表统计信息的维护

在Hive中创建索引可以加快查询的速度,尤其是对于大表的查询。索引通常是基于某些列的值来创建的,这样查询引擎就可以更快地定位到这些列值对应的数据块。需要注意的是,索引的维护是需要额外开销的,因此在创建索引之前需要权衡其带来的查询性能提升是否值得额外的维护成本。

Hive表统计信息是查询优化器进行查询计划制定时的关键输入。统计信息包括表的行数、各个列的基数、数据分布等信息。通过定期收集统计信息,查询优化器可以生成更优的查询计划,从而提高查询效率。使用`ANALYZE TABLE`语句可以更新表的统计信息:

```sql

ANALYZE TABLE table_name COMPUTE STATISTICS;

```

执行上述命令后,Hive会收集`table_name`表的统计信息,用于后续查询的优化。

以上就是Hive表的工作机制的详细介绍,下一章节我们将会深入探讨Hive分区的原理与实践,继续深入Hive的数据模型领域。

# 3. Hive分区的深入解析

## 3.1 Hive分区的基本原理

### 3.1.1 分区的逻辑含义与物理布局

在Hive中,分区(Partition)是一个表中的数据的逻辑划分,它允许用户将数据组织到不同的目录中,这些目录基于数据的某个字段(通常是日期)的值。逻辑上,分区相当于为表添加了一个额外的列,而不改变数据的存储结构。

物理上,Hive表中的数据通常存储在HDFS的目录中。当表被分区时,每个分区的数据会被存储在不同的子目录下。例如,如果有一个分区字段是`date`,那么数据可能会被保存在类似于`/user/hive/warehouse/mytable/date=2023-01-01`的目录中。这样的设计允许Hive在查询时仅扫描与查询条件相关的分区目录,大大减少了查询的数据量,提高了查询效率。

```mermaid

graph LR

A[分区表] -->|物理存储| B(/user/hive/warehouse/mytable/)

B -->|按分区键组织| C(/user/hive/warehouse/mytable/date=2023-01-01/)

B -->|按分区键组织| D(/user/hive/warehouse/mytable/date=2023-01-02/)

```

### 3.1.2 分区与数据的读取效率

分区的主要优势在于能够提高数据的读取效率。当Hive执行查询时,它只读取涉及的特定分区,而不是整个表。这种基于分区的数据过滤,减少了需要处理的数据量,减少了I/O操作,从而加速了查询。

例如,如果一个表按`date`字段分区,那么查询`SELECT * FROM mytable WHERE date='2023-01-01'`时,Hive只扫描`/user/hive/warehouse/mytable/date=2023-01-01/`目录下的数据。如果没有分区,Hive就需要扫描整个表的数据,效率明显降低。

## 3.2 分区策略的实现与管理

### 3.2.1 分区键的选择与数据分布

选择合适的分区键是实现分区策略的关键。分区键应该能够最大程度地减少数据扫描的范围,并且在查询中经常被用于过滤。通常,分区键选择如下:

- 时间戳:如果数据更新具有时间顺序性,按时间戳分区是一个常见选择。

- 高基数列:通常是指具有大量不同值的列,如用户ID等。

如果分区键选择不当,可能会出现数据分布不均,导致数据倾斜的问题。比如,如果大部分数据都集中在某个特定的分区键值下,那么查询时将不得不扫描大部分的数据,这违背了分区的初衷。

### 3.2.2 动态分区与分区管理的最佳实践

动态分区是Hive的一个重要特性,允许根据查询中的条件动态地创建分区,这对于数据的批量加载非常有用。然而,如果不对动态分区进行适当管理,可能会导致分区数过多,从而增加元数据的负担和查询时间。

最佳实践包括:

- 对动态分区进行限值,如`hive.exec.dynamic.partition=true`和`hive.exec.dynamic.partition.mode=nonstrict`。

- 限制单次查询产生的分区数量,使用`hive.limit партитионов`设置一个阈值。

- 定期清理不常用的分区,使用`ALTER TABLE mytable DROP IF EXISTS PARTITION (date='2022-01-01')`来删除。

## 3.3 分区相关高级特性

### 3.3.1 分桶表与分区的交互作用

分桶(Bucketing)是Hive的另一个特性,它将表数据进一步划分为更小的数据片段,称为“桶”。分桶可以与分区一起使用,对分区表进行更细粒度的控制。一个分桶表的每个分区都是一个分桶表,这允许在分区的基础上进一步优化数据的分布和查询性能。

例如,一个按`date`分区,按`user_id`分桶的表将允许我们更有效地进行数据抽样和join操作。抽样可以限定在一个特定的桶内进行,join操作可以只涉及相关桶中的数据,减少不必要的数据处理。

### 3.3.2 分区数据的备份与恢复策略

分区数据的备份与恢复是数据管理的重要方面。在Hive中,由于分区数据是存储在特定的目录下,备份和恢复操作可以通过简单的复制和移动目录来完成。

备份可以通过复制分区目录到备份位置来实现,例如:

```bash

hadoop fs -cp /user/hive/warehouse/mytable/date=2023-01-01/ /backup/mytable/date=2023-01-01/

```

恢复分区数据涉及将备份的数据移动回原位置:

```bash

hadoop fs -mv /backup/mytable/date=2023-01-01/ /user/hive/warehouse/mytable/date=2023-01-01/

```

这些操作需要在Hive以外的文件系统级别进行,Hive不会自动处理备份和恢复。

在本章节中,我们深入探讨了Hive分区的原理和实现,包括分区对数据读取效率的影响,分区键选择的策略,以及动态分区的管理和最佳实践。此外,我们还探讨了分桶表与分区的交互作用,以及分区数据的备份与恢复策略。这些都是确保Hive表高效运行的关键因素,对于Hive的优化和管理至关重要。

# 4. ```

# 第四章:Hive桶的高级用法

Hive中的桶(Bucket)是数据组织的一种方式,与分区相似,但在底层实现和用途上有所不同。通过对数据进行分桶,可以在后续的查询和分析过程中获得更高效的性能,尤其是在执行JOIN操作时,数据的均匀分布可以大幅减少Map端处理的数据量,从而降低处理时间。

## 4.1 桶的概念与应用场景

### 4.1.1 桶的基本原理及作用

桶的概念基于将数据根据某个字段的哈希值划分到不同的文件中。通常,这个字段是表的一个或多个列,用于确保数据在桶之间均匀分布。桶的数量在创建表时就已经确定,不能在表创建后更改。

与分区相比,桶的目的是将数据划分成更小、更均匀的部分,以优化Map端的聚合操作。在分布式计算环境中,均匀分布的数据可以减少不同节点之间数据传输的开销,提升查询效率。

### 4.1.2 桶表在数据倾斜优化中的角色

数据倾斜是指数据在分布式系统中分布不均的现象,这是导致查询性能不佳的主要原因之一。桶表的创建就是为了解决这一问题。通过将数据预先分散到多个桶中,可以保证Map任务处理的数据量相对均衡,减少单个任务的处理压力,从而优化整体查询性能。

## 4.2 桶表的设计与操作

### 4.2.1 桶的分布算法与表设计技巧

桶的分布是基于哈希值的,通常Hive提供了一个`CLUSTERED BY`子句来指定分桶的字段和桶的数量。设计桶表时,关键在于选择合适的字段作为桶键,这个字段应该是查询中经常作为JOIN键或WHERE条件的列。

桶的数量也是重要的设计参数。太少的桶可能无法提供足够的数据划分,而太多则可能导致Map端处理过度分散。通常桶的数量设置为集群中核心数的倍数是一个好的实践,以便充分利用集群资源。

### 4.2.2 桶表数据的抽样查询与管理

桶表除了可以用来优化JOIN操作,还可以用于高效的数据抽样查询。Hive提供了`TABLESAMPLE`语句来查询特定比例的数据,这对于数据探索、生成统计摘要或进行数据分析非常有用。

管理桶表和普通Hive表的指令几乎相同,但是在数据加载(LOAD)和数据插入(INSERT)时,需要考虑桶的存在。例如,在加载数据到桶表时,应该使用`INSERT OVERWRITE TABLE ... SELECT * FROM ...`这样的语句来确保数据可以按照桶的分布重新组织。

## 4.3 桶表的数据处理优化

### 4.3.1 桶表在JOIN操作中的优化效果

在执行JOIN操作时,如果参与JOIN的表都是按相同字段分桶,那么可以使用Map端的合并JOIN,这是效率最高的JOIN方式。Hive在Map端直接对对应桶中的数据进行合并JOIN,避免了数据在各个节点之间的传输,极大地提高了JOIN操作的性能。

### 4.3.2 桶表的Map端聚合实践

除了JOIN操作外,桶表在Map端聚合查询中也发挥着重要作用。当查询涉及到GROUP BY时,桶表的均匀分布可以使聚合操作更加高效。Hive可以通过采样桶表中的数据来估算聚合结果的大小,这有助于优化内存使用并减少执行时间。

要实现Map端聚合,可以使用Hive的`DISTRIBUTE BY`和`SORT BY`子句来控制数据的分布和排序,使得相同键值的数据在同一个桶中或在Map任务的同一个输出中,从而实现局部聚合。

## 小结

本章深入探讨了Hive桶的高级用法,桶作为一种数据分片技术,对于优化Hive查询和数据处理操作具有显著效果。通过合理设计和操作桶表,可以有效缓解数据倾斜问题,提升JOIN操作和数据聚合的性能,同时还能实现高效的数据抽样。理解并运用好Hive的桶技术,对于构建高性能的大数据分析系统至关重要。

```

# 5. Hive数据模型的实战案例

在这一章节中,我们将深入探讨Hive数据模型在真实大数据场景中的应用,并结合实际案例进行故障诊断与调优。此外,我们还将探讨Hive数据模型的创新方向和在数据湖环境中的潜在角色。通过这些内容,读者可以更好地理解如何在生产环境中应用和优化Hive数据模型,并展望其未来发展。

## 5.1 大数据场景下的Hive应用

### 5.1.1 海量数据的表设计与分区优化

在处理海量数据时,如何设计Hive表和优化分区是至关重要的。这里我们可以具体操作并分析一个案例:

假设我们有一个日志数据表`access_logs`,数据量达到TB级别。在这个场景中,我们关注用户访问时间作为分区键,因为它可以显著地减少查询时的数据扫描量。

```sql

CREATE TABLE access_logs (

user_id STRING,

log_time TIMESTAMP,

ip_address STRING,

action STRING

)

PARTITIONED BY (dt STRING)

ROW FORMAT DELIMITED

FIELDS TERMINATED BY ','

STORED AS TEXTFILE;

```

分区优化的关键在于合理地选择分区键和分区数。例如,如果我们每天产生大量日志,那么以日期`dt`作为分区键是一个不错的选择。此外,需要留意分区数不要过多,以防止过多的小分区影响执行计划的优化。

### 5.1.2 分桶技术在多维分析中的应用

分桶技术是Hive中用于提高大数据集查询效率的一种方法。通过对数据进行更细粒度的分割,我们可以进行更有效的多维分析。

```sql

CREATE TABLE user_profiles (

user_id STRING,

age INT,

gender STRING,

occupation STRING,

income STRING

)

CLUSTERED BY (user_id) INTO 1024 BUCKETS;

```

在上述例子中,我们创建了一个分桶表`user_profiles`,其中`user_id`作为分桶键。在进行多维分析时,可以针对特定的桶进行查询,这样可以减少数据扫描量,提高查询效率。

## 5.2 Hive数据模型的故障诊断与调优

### 5.2.1 常见性能瓶颈与解决方案

在使用Hive进行大数据处理时,性能瓶颈通常出现在数据倾斜、不合理的表设计、查询优化等方面。

- **数据倾斜**:在分布式计算中,某些节点处理的数据量远远大于其他节点,导致处理时间不均衡。解决方案可以是使用分桶技术进行更均匀的数据分配,或者对倾斜严重的列应用随机前缀和采样。

- **不合理的表设计**:表设计不合理会导致数据冗余、查询效率低下。设计时应该关注存储格式的选择、是否需要分区和分桶等。

### 5.2.2 优化案例分析:从慢查询到性能飞跃

通过一个实际案例来展示如何诊断和调优Hive查询性能。假设我们有一个查询操作,最初执行时间非常长。通过查看执行计划和监控数据,我们发现以下几个问题:

- 查询中的Join操作导致了数据倾斜。

- 表中存在过多的小文件,增加了NameNode的负担。

- 使用了全表扫描,没有有效利用索引。

对此,我们采取以下优化措施:

- 对数据进行预处理,以减少倾斜。

- 定期执行`hadoop fs -均衡器`命令,合并小文件。

- 对常用于查询的列建立索引。

## 5.3 面向未来的Hive数据模型创新

### 5.3.1 新型数据模型的探索与实验

随着技术的发展,越来越多的新型数据模型被提出和应用。Hive作为大数据处理的老牌工具也在不断进化。例如,Hive-on-Spark引入了Spark作为执行引擎,大大提高了处理速度。Hive LLAP(Live Long and Process)则通过提供即时查询服务,减少了执行时间。

### 5.3.2 Hive在数据湖中的角色与未来发展

数据湖是一个集中存储企业数据的系统,其中包含原始数据和处理过的数据。Hive在数据湖中扮演着数据整合和查询分析的关键角色。Hive可以与存储在数据湖中的数据无缝集成,无论是结构化数据还是半结构化数据,都可以使用Hive进行高效的查询和处理。

未来,Hive将继续向更开放、更灵活、更高效的方向发展,以满足不断增长的数据处理需求。这包括改进数据存储格式、优化查询引擎、引入机器学习等高级功能。

这一章节的实战案例,不仅为读者提供了Hive在大数据场景下的应用思路,还展示了如何解决遇到的问题,并对Hive的未来发展进行了展望。通过这些内容,我们可以更好地理解Hive数据模型的强大能力以及其不断演进的特性。

0

0