YOLO数据集预处理秘籍:5个步骤优化数据质量,提升模型性能20%

发布时间: 2024-08-16 13:06:31 阅读量: 47 订阅数: 34

# 1. YOLO数据集预处理概述**

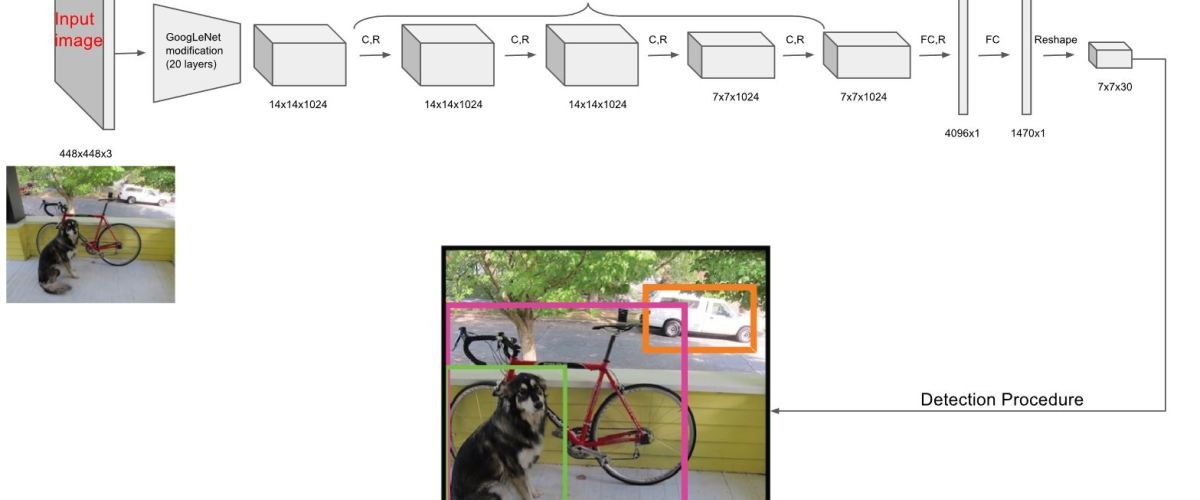

YOLO(You Only Look Once)是一种流行的实时目标检测算法。为了训练和评估YOLO模型,需要对数据集进行预处理。数据预处理是将原始数据转换为适合模型训练和评估的格式的过程。它涉及一系列技术,包括数据清洗、筛选、增强和优化。

数据预处理对于YOLO模型的性能至关重要。它可以提高模型的准确性和鲁棒性,并减少训练时间。通过去除噪声、增强数据的多样性以及优化数据格式,数据预处理可以帮助模型更好地学习数据的底层模式。

# 2. 数据预处理理论基础**

## 2.1 数据预处理的重要性

数据预处理是机器学习和深度学习流程中至关重要的一步,它可以显著提高模型的性能和训练效率。数据预处理的主要目的是将原始数据转换为适合模型训练和分析的形式。

**数据预处理的优势:**

* **提高模型准确性:**预处理可以去除噪声、异常值和不一致性,从而提高模型训练数据的质量。

* **减少训练时间:**预处理可以优化数据格式,使其更易于模型处理,从而减少训练时间。

* **增强泛化能力:**预处理可以增强数据的多样性,使模型能够更好地泛化到未见数据。

* **提高可解释性:**预处理可以揭示数据的潜在模式和关系,提高模型的可解释性。

## 2.2 常用数据预处理技术

**数据清洗和筛选**

* **异常值处理:**识别和处理异常值,例如极值或缺失值。

* **数据类型转换:**将数据转换为适合模型训练的类型,例如将文本数据转换为数值数据。

**数据增强**

* **图像缩放和裁剪:**调整图像大小并裁剪出感兴趣的区域。

* **图像翻转和旋转:**通过翻转和旋转图像,增加数据多样性。

* **随机采样:**从原始数据中随机选择子集,以创建更具代表性的训练集。

**特征工程**

* **特征选择:**选择与目标变量最相关的特征,以提高模型性能。

* **特征缩放:**将特征值归一化或标准化,以改善模型训练的稳定性。

* **降维:**使用主成分分析 (PCA) 或奇异值分解 (SVD) 等技术,减少特征空间的维度。

**代码示例:**

```python

# 数据清洗和筛选:处理异常值

import numpy as np

data = np.array([1, 2, 3, 4, 5, 100])

data[data > 10] = np.nan # 将异常值替换为 NaN

# 数据增强:图像缩放和裁剪

import cv2

image = cv2.imread('image.jpg')

resized_image = cv2.resize(image, (224, 224)) # 缩放图像

cropped_image = resized_image[0:224, 0:224] # 裁剪图像

# 特征工程:特征选择

from sklearn.feature_selection import SelectKBest, chi2

X = np.array([[1, 2, 3], [4, 5, 6], [7, 8, 9]])

y = np.array([0, 1, 0])

selector = SelectKBest(chi2, k=2).fit(X, y)

selected_features = X[:, selector.get_support()] # 选择前两个最相关的特征

```

**逻辑分析:**

* 数据清洗和筛选:`np.nan` 用于表示缺失值,通过将异常值替换为 `np.nan`,可以防止它们对模型训练产生负面影响。

* 数据增强:`cv2.resize()` 用于缩放图像,`cv2.resize()` 用于裁剪图像,通过缩放和裁剪图像,可以增加数据的多样性。

* 特征工程:`SelectKBest` 用于选择与目标变量最相关的特征,`chi2` 用于计算特征和目标变量之间的卡方统计量,通过选择最相关的特征,可以提高模型性能。

# 3.1 数据清洗和筛选

#### 3.1.1 异常值处理

异常值是指与数据集中其他值显著不同的数据点。它们可能由测量错误、数据输入错误或异常事件引起。异常值的存在会对模型训练产生负面影响,因此需要进行处理。

处理异常值的方法有以下几种:

- **删除异常值:**如果异常值明显错误或与数据集无关,则可以将其删除。

- **替换异常值:**可以用数据集中其他值的平均值、中值或众数来替换异常值。

- **修剪异常值:**可以将异常值修剪到一定阈值以内,以减少其对模型的影响。

#### 3.1.2 数据类型转换

数据类型转换是指将数据从一种数据类型转换为另一种数据类型。在 YOLO 数据集中,图像通常以 `uint8` 格式存储,而标签则以 `float32` 格式存储。在训练模型之前,需要将图像数据转换为 `float32` 格式,以匹配标签的数据类型。

```python

import numpy as np

# 加载图像

image = cv2.imread("image.jpg")

# 将图像转换为 float32 格式

image = image.astype(np.float32)

```

### 3.2 数据增强

数据增强是一种通过对现有数据进行转换和修改来创建新数据的方法。它可以帮助增加数据集的大小和多样性,从而提高模型的泛化能力。

#### 3.2.1 图像缩放和裁剪

图像缩放和裁剪是两种常用的数据增强技术。缩放可以改变图像的大小,而裁剪可以从图像中提取一个子区域。通过组合使用这两种技术,可以创建各种不同大小和宽高比的图像。

```python

import cv2

# 缩放图像

image = cv2.resize(image, (416, 416))

# 裁剪图像

image = cv2.random_crop(image, (416, 416))

```

#### 3.2.2 图像翻转和旋转

图像翻转和旋转可以创建图像的镜像和旋转版本。这有助于提高模型对不同方向和视角的鲁棒性。

```python

import cv2

# 水平翻转图像

image = cv2.flip(image, 1)

# 旋转图像

image = cv2.rotate(image, cv2.ROTATE_90_CLOCKWISE)

```

# 4. 数据预处理优化技巧

### 4.1 并行化处理

在数据预处理过程中,并行化处理可以显著提高效率,尤其是当数据集规模较大时。并行化处理将任务分解为多个子任务,并同时在多个处理器或内核上执行这些子任务。

**方法:**

* 使用多线程或多进程技术。

* 利用云计算平台或分布式计算框架(如Spark、Hadoop)。

**代码示例:**

```python

import multiprocessing

def preprocess_image(image_path):

# 预处理图像的函数

# 创建一个进程池

pool = multiprocessing.Pool(processes=4)

# 将图像路径列表映射到预处理函数

results = pool.map(preprocess_image, image_paths)

# 关闭进程池

pool.close()

pool.join()

```

**参数说明:**

* `image_paths`: 图像路径列表

* `processes`: 进程数

**逻辑分析:**

此代码使用多进程并行化图像预处理。它创建了一个进程池,指定了进程数。然后,它将图像路径列表映射到预处理函数,并使用 `map()` 方法在进程池中并行执行这些函数。最后,它关闭进程池并等待所有进程完成。

### 4.2 数据增强策略优化

数据增强策略的优化可以提高模型的泛化能力,并减少过拟合。以下是一些优化策略:

**随机性:**

* 随机应用数据增强操作,如旋转、裁剪和翻转。

* 使用随机种子以确保可重复性。

**多样性:**

* 使用多种数据增强操作,以创建更多样化的训练数据。

* 调整增强操作的参数(如旋转角度、裁剪大小)以增加多样性。

**自适应性:**

* 根据数据集和模型的特性动态调整数据增强策略。

* 使用强化学习或贝叶斯优化等技术来优化增强参数。

**表格:数据增强策略优化技巧**

| 技巧 | 描述 |

|---|---|

| 随机性 | 随机应用数据增强操作,确保可重复性 |

| 多样性 | 使用多种数据增强操作,增加多样性 |

| 自适应性 | 根据数据集和模型特性动态调整策略 |

**流程图:数据增强策略优化流程**

```mermaid

graph LR

subgraph 随机性

A[随机应用增强操作] --> B[确保可重复性]

end

subgraph 多样性

C[使用多种增强操作] --> D[增加多样性]

end

subgraph 自适应性

E[动态调整策略] --> F[优化增强参数]

end

A --> C --> E

B --> D --> F

```

# 5. 数据预处理评估

数据预处理评估是评估预处理过程有效性的关键步骤。它有助于确定预处理是否成功改善了模型的性能,并为进一步优化提供指导。

### 5.1 数据质量评估

数据质量评估旨在评估预处理后的数据的质量。它包括以下方面:

- **数据完整性:**确保数据没有缺失值或损坏。

- **数据一致性:**检查数据是否符合预期的格式和约束。

- **数据分布:**分析数据的分布,以识别异常值或偏差。

### 5.2 模型性能评估

模型性能评估是评估预处理对模型性能影响的关键指标。它包括以下方面:

- **精度:**衡量模型预测的准确性。

- **召回率:**衡量模型识别所有相关实例的能力。

- **F1 分数:**精度和召回率的加权平均值。

### 评估步骤

数据预处理评估通常遵循以下步骤:

1. **定义评估指标:**确定要评估的数据质量和模型性能指标。

2. **收集评估数据:**保留一部分数据用于评估,以避免过度拟合。

3. **应用预处理:**将预处理过程应用于评估数据。

4. **训练模型:**使用预处理后的数据训练模型。

5. **评估模型性能:**使用评估指标评估模型的性能。

6. **比较结果:**将预处理后的模型性能与预处理前进行比较。

### 评估示例

以下代码示例演示了如何使用 scikit-learn 库评估模型性能:

```python

from sklearn.metrics import accuracy_score, recall_score, f1_score

# 评估数据

X_test, y_test = ... # 加载评估数据

# 预处理数据

X_test_preprocessed = ... # 应用预处理

# 训练模型

model = ... # 加载或训练模型

# 使用预处理后的数据预测

y_pred = model.predict(X_test_preprocessed)

# 计算评估指标

accuracy = accuracy_score(y_test, y_pred)

recall = recall_score(y_test, y_pred)

f1 = f1_score(y_test, y_pred)

# 打印评估结果

print("Accuracy:", accuracy)

print("Recall:", recall)

print("F1 score:", f1)

```

通过比较预处理前后的评估结果,可以评估数据预处理的有效性。如果预处理后模型性能得到改善,则表明预处理过程成功地提高了数据的质量。

# 6.1 数据预处理流程

YOLO数据集预处理流程一般遵循以下步骤:

1. **数据收集:**收集原始数据集,包括图像和标签文件。

2. **数据清洗和筛选:**去除损坏、重复或异常的数据。

3. **数据增强:**应用图像缩放、裁剪、翻转和旋转等技术增强数据集。

4. **数据归一化:**将图像像素值归一化为[0, 1]范围,以提高模型训练稳定性。

5. **数据分割:**将数据集分割为训练集、验证集和测试集,以评估模型性能。

## 6.2 工具和库推荐

以下工具和库可用于YOLO数据集预处理:

- **OpenCV:**用于图像处理和增强。

- **NumPy:**用于数据操作和数组处理。

- **Pandas:**用于数据清洗和筛选。

- **Scikit-learn:**用于数据预处理和特征工程。

- **YOLOv5:**包含数据预处理和增强功能的YOLO模型训练框架。

0

0