数值计算精要:MATLAB数学建模中的高精度计算和科学建模基石

发布时间: 2024-06-07 04:00:27 阅读量: 89 订阅数: 38

# 1. MATLAB基础与数值计算**

MATLAB是一种强大的技术计算语言,广泛应用于工程、科学和金融领域。它提供了丰富的函数库和工具箱,用于数值计算、数据分析和建模。

MATLAB的基础数据类型包括标量、向量和矩阵。标量是单个数值,向量是一组按顺序排列的数值,矩阵是按行和列组织的数值集合。MATLAB提供了广泛的运算符,用于执行算术、逻辑和关系运算。

MATLAB还提供了强大的数值计算功能。它支持高精度计算,并提供了处理舍入误差、截断误差和方法误差的技术。MATLAB还提供了求解线性方程组、特征值问题和微分方程的函数。

# 2. 高精度计算与误差分析

### 2.1 数值计算的误差来源

数值计算中不可避免地存在误差,主要来源于以下三个方面:

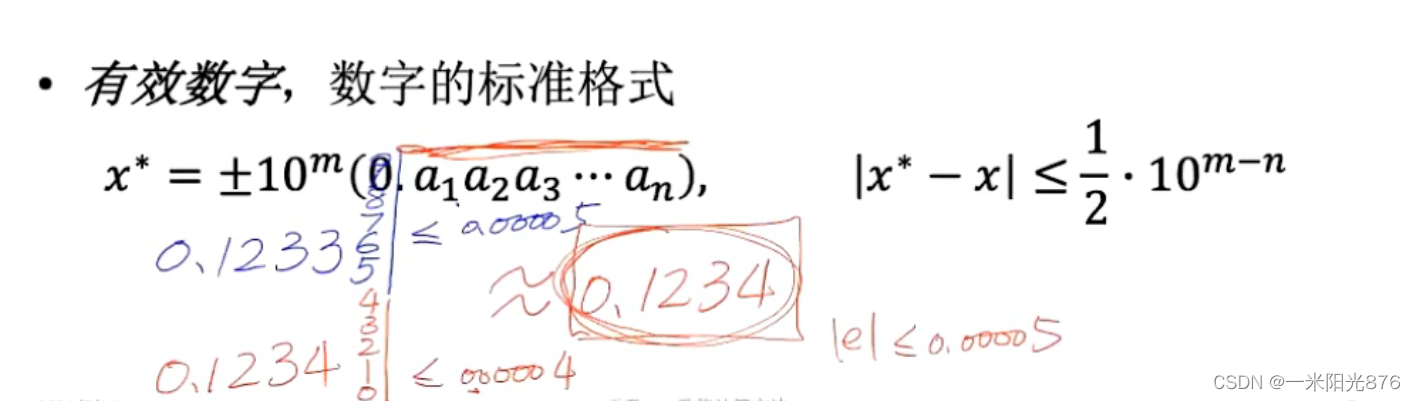

#### 2.1.1 舍入误差

舍入误差是由于计算机无法精确表示所有实数,而必须将其近似为有限精度的浮点数时产生的。例如,十进制数 0.1 在计算机中可能被表示为 0.10000000149011612,导致舍入误差为 1.49011612e-10。

#### 2.1.2 截断误差

截断误差是由于计算机无法执行无限次迭代或运算,而必须在有限步长或精度下终止计算时产生的。例如,求解积分时,使用数值积分方法(如梯形法或辛普森法)会产生截断误差,因为这些方法只计算积分区间内有限个点的值。

#### 2.1.3 方法误差

方法误差是由于所使用的数值方法本身的固有缺陷而产生的。例如,欧拉法求解微分方程时,由于方法的局部截断误差,会导致随着步长的增加而积累较大的误差。

### 2.2 高精度计算技术

为了提高数值计算的精度,可以使用以下技术:

#### 2.2.1 浮点数的表示和运算

浮点数是计算机表示实数的一种方式,由尾数、阶码和符号组成。尾数表示小数部分,阶码表示指数部分,符号表示正负。浮点数的精度受尾数的位数限制,位数越多,精度越高。

MATLAB 中提供了多种浮点数类型,如 single、double 和 long double,精度依次提高。可以使用 `whos` 命令查看变量的浮点数类型。

```matlab

>> a = 1.234567890123456789;

>> whos a

Name Size Bytes Class Attributes

a 1x1 8 double

```

#### 2.2.2 间隔算法

间隔算法使用间隔(两个实数构成的区间)来表示数值,而不是使用单个浮点数。区间表示了数值的可能取值范围,可以有效地减少舍入误差的影响。

MATLAB 中提供了 `intval` 函数来创建间隔对象。

```matlab

>> a = intval('1.234567890123456789');

>> disp(a)

1.234567890123456789e+00 +/- 0.000000000000000000e+00

```

#### 2.2.3 符号计算

符号计算使用符号(如变量、函数)来表示数学表达式,而不是使用数值。符号计算可以避免舍入误差和截断误差,但计算速度可能较慢。

MATLAB 中提供了 Symbolic Math Toolbox,可以进行符号计算。

```matlab

>> syms x;

>> f = x^2 + 2*x + 1;

>> sim

```

0

0