HDFS联邦与NameNode HA架构演进:实战案例与最佳实践

发布时间: 2024-10-28 15:01:39 阅读量: 34 订阅数: 45

ysoserial-master.zip

# 1. HDFS联邦与NameNode HA架构概述

在大数据时代,分布式存储系统是数据存储解决方案的核心。Hadoop分布式文件系统(HDFS)作为 Apache Hadoop 的核心组件之一,以其高可靠性、高吞吐量和高效存储,为存储海量数据提供了支持。然而,随着数据量的爆炸性增长,传统的 HDFS 架构在性能与可扩展性上遇到了瓶颈。因此,HDFS 联邦(Federation)和 NameNode 高可用性(HA)架构应运而生,旨在解决大规模集群管理中的问题。

在本章中,我们将首先从宏观角度探讨 HDFS 联邦与 NameNode HA 架构的初衷与概念,理解其诞生的背景和基本原理。随后,我们将逐步深入探讨它们如何通过独特的技术手段解决传统 HDFS 架构面临的问题,并为用户带来更加灵活、稳定、可扩展的大数据存储环境。

接下来的章节将详细分析联邦架构下的元数据管理、部署配置、实践应用案例以及 NameNode HA 的深入实践,最终总结出最佳实践并展望未来架构的演进路线。通过本系列文章的介绍,读者将对 HDFS 联邦与 NameNode HA 架构有全面的认识,并能够根据自身需求进行合理的实践部署。

# 2. HDFS联邦的理论基础

### 2.1 HDFS联邦架构概念解析

#### 2.1.1 HDFS联邦的诞生背景

HDFS联邦的出现是为了应对传统Hadoop分布式文件系统(HDFS)所面临的可扩展性瓶颈。随着数据量的爆炸性增长,单点命名节点(NameNode)架构的HDFS无法有效地横向扩展。原因在于NameNode负责维护整个文件系统的元数据,包括文件到数据块的映射和访问权限等,而随着元数据量的增加,单个NameNode的内存容量和处理能力成为限制因素。因此,为了在保持高可用性的同时实现水平扩展,HDFS联邦架构应运而生。

#### 2.1.2 联邦架构与传统架构的比较

在HDFS联邦架构中,多个NameNode协同工作,每个NameNode管理一部分命名空间,并且可以有多个数据节点(DataNode)与之对应。相比之下,传统架构中仅有一个NameNode,所有客户端操作都需要与单一的NameNode进行通信,这导致了潜在的瓶颈和单点故障问题。联邦架构通过引入多个NameNode和跨NameNode的命名空间联邦,使得系统在理论上可以无限扩展,同时提高了整体的容错能力。

### 2.2 NameNode高可用性原理

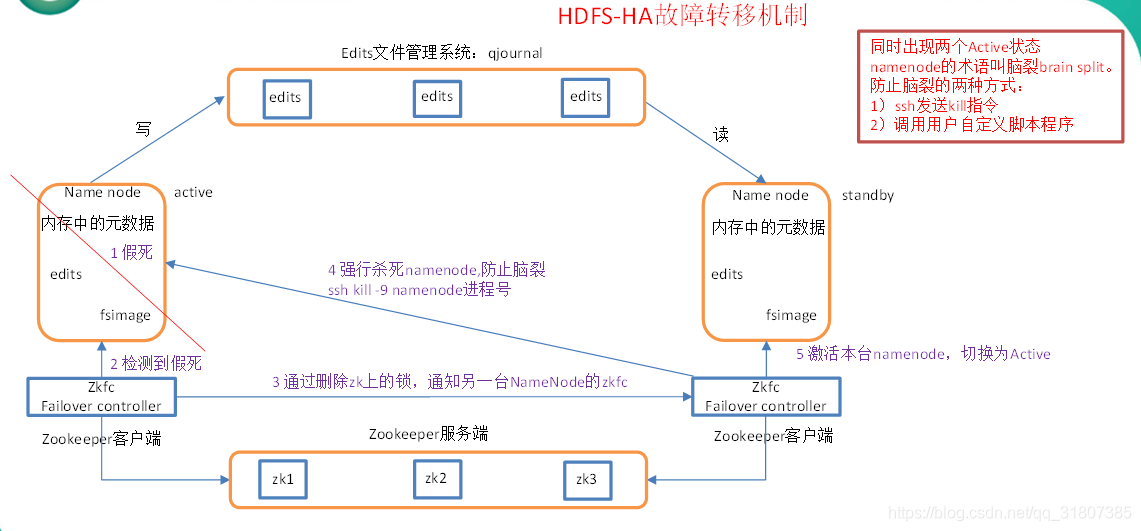

#### 2.2.1 NameNode故障转移机制

故障转移机制是HDFS联邦中实现NameNode高可用的关键。在联邦架构下,每个NameNode都拥有一个热备份节点,当主节点发生故障时,热备份节点可以迅速接管其工作,从而保证服务的连续性。故障转移通常涉及到状态的同步、命名空间的切换和客户端的重定向等过程。这个过程需要精心设计以确保数据一致性且对客户端透明。

#### 2.2.2 热备份NameNode的实现原理

热备份NameNode是通过一种称为“共享存储”的机制实现的。在HDFS联邦中,每个主NameNode和热备份NameNode都连接到一个共享存储系统,这个共享存储系统保存了文件系统的元数据。在正常工作状态下,主NameNode写入元数据到共享存储,并且这些更新会被热备份节点实时读取,从而保持状态同步。当主NameNode出现故障时,热备份节点会接管共享存储,并继续提供服务。

### 2.3 联邦架构下的元数据管理

#### 2.3.1 元数据分片管理

在联邦架构中,元数据被划分为不同的分片,每个分片由一个NameNode管理。元数据分片管理是通过Zookeeper这样的分布式协调服务来实现的,确保各个分片的一致性和协调。这种分片策略使得系统能够并行处理多个命名空间,并且可以针对不同的工作负载对特定的命名空间进行扩展。

#### 2.3.2 元数据服务的扩展性与可靠性

元数据服务的扩展性是通过增加NameNode节点来实现的,每个节点管理一部分元数据,使得HDFS联邦能够在不牺牲性能的情况下处理更大的数据集。而元数据服务的可靠性则通过多种机制来保证,包括元数据的定期备份、NameNode间的状态同步等。为了进一步提高可靠性,HDFS联邦支持跨机房部署NameNode节点,从而提供容灾能力。

### 2.4 HDFS联邦的理论基础总结

HDFS联邦通过引入多个NameNode来解决传统HDFS在可扩展性上的瓶颈,为大数据存储提供了新的思路。HDFS联邦架构允许数据节点(DataNode)跨多个命名空间工作,提高了系统的整体性能和容错能力。同时,联邦架构下的元数据分片管理和高可用性原理为大数据存储的安全性和可靠性提供了保障。然而,HDFS联邦的部署和维护相较于传统架构更为复杂,需要对各个组件的功能有深入的理解。接下来,我们将深入探讨HDFS联邦的部署与配置过程。

# 3. HDFS联邦的部署与配置

HDFS联邦的部署与配置是将HDFS联邦架构从理论转化到实际应用中的关键步骤。在这一章节中,我们将详细介绍如何准备环境、安装组件、规划集群,并通过定制配置文件来启动和监控HDFS联邦集群。这一切都是为了确保HDFS联邦能在各种工作负载下提供高可用性、扩展性和稳定性。

## 环境准备与组件安装

在部署HDFS联邦之前,需要充分考虑和准备环境和组件。硬件的选择会直接影响集群的性能和可靠性,而软件组件的版本选择则关系到集群的兼容性和安全性。

### 硬件环境要求

HDFS联邦的硬件环境要求比较严格,主要是为了保证数据处理和存储的高性能以及系统的高可用性。以下是推荐的硬件配置:

- **服务器**: 至少3台服务器,用于搭建NameNode和DataNode节点。每台服务器建议配置双路CPU、64GB内存、SSD硬盘等。

- **网络**: 高速网络连接,至少千兆以太网,如果是大数据量处理和高并发读写,则推荐万兆以太网。

- **存储**: 根据实际需求,DataNode节点应配置足够的存储空间。通常使用RAID技术或分布式存储系统保证数据的安全性。

### 软件组件版本选择

对于HDFS联邦的软件组件版本,需要保证稳定性和兼容性,推荐如下:

- **Hadoop**: 选择适合HDFS联邦的稳定版本,例如Apache Hadoop 3.x。

- **操作系统**: Linux发行版,如CentOS或Ubuntu,确保内核版本和操作系统补丁是最新的。

## 部署步骤详解

部署HDFS联邦需要经过细致的规划和步骤,每一步都要确保正确无误,避免出现配置错误导致的集群运行问题。

### 集群规划与节点分配

在部署前,首先要做好集群规划。这包括:

- **节点角色分配**: 通常

0

0