【保障元数据安全的关键技术】:HDFS NameNode元数据备份全解析

发布时间: 2024-10-28 15:28:49 阅读量: 9 订阅数: 15

# 1. HDFS NameNode元数据概述

## HDFS NameNode元数据概念

Hadoop Distributed File System (HDFS) 是一个高度容错的系统,设计用于部署在廉价硬件上。HDFS 使用 NameNode 和 DataNode 架构来管理文件系统状态和存储数据。在 HDFS 中,元数据是指关于文件系统对象的数据,如文件和目录的权限、所有权、属性以及文件和数据块的映射信息。NameNode 负责存储和管理这些关键的元数据信息,它在 HDFS 中发挥着至关重要的作用。

## NameNode的元数据管理

NameNode 对 HDFS 的性能和可靠性至关重要。它维护了整个文件系统的命名空间,记录了每个文件中各个块所在的 DataNode 信息。由于元数据包含了整个文件系统的状态,因此 NameNode 的故障可能会导致数据丢失或服务中断。为了减少这种风险,HDFS 引入了 Secondary NameNode 和 Checkpoint Node 来定期合并编辑日志和文件系统的元数据镜像,以此来减轻主 NameNode 的压力并提供元数据的备份。

## 元数据的重要性与挑战

元数据对于 HDFS 的运行至关重要,它确保了数据的快速检索和文件系统的高效管理。然而,随着存储容量的增加和数据量的增长,管理海量元数据变得更加复杂。这要求系统不仅要有高效的元数据存储机制,还要有强大的备份和恢复策略来应对 NameNode 故障等紧急情况。接下来的章节将深入探讨元数据备份的必要性、技术和优化策略,以及监控和未来的发展趋势。

# 2. 元数据备份的必要性分析

### 2.1 HDFS的工作原理及其挑战

Hadoop Distributed File System (HDFS) 是一个高度容错的系统,用于存储大量数据。通过廉价的商用硬件构成分布式环境,HDFS可以提供高吞吐量的数据访问,并适合那些有大数据集的应用程序。HDFS 使用主从架构,其中包含两个主要组件:NameNode和DataNode。

#### NameNode的角色和职责

NameNode是HDFS的主节点,它管理文件系统命名空间和客户端对文件的访问。它负责维护文件系统树及整个HDFS集群中的文件元数据,如文件和目录信息、每个文件的块列表等。NameNode还负责处理客户端的读写请求,以及将数据块放置在哪些DataNode上等决策。

NameNode的职责虽大,但它并不存储实际的数据,只存储元数据。这就意味着,如果NameNode发生故障,整个HDFS集群将变得不可用。集群中所有数据的位置信息将丢失,导致无法访问任何文件。

```mermaid

graph TD;

NN[NameNode] -->|管理元数据| NS[命名空间]

NN -->|控制数据块分布| DN[DataNodes]

DN -->|存储实际数据| Data[数据]

```

上图展示了NameNode如何与DataNode交互来管理元数据和控制数据块分布。数据本身存储在DataNode上,而NameNode持有所有数据的索引信息。

#### NameNode故障对元数据的影响

NameNode故障将直接影响整个集群的可用性。没有有效的元数据备份,数据丢失的风险将大幅提高。HDFS的高容错性设计使得DataNodes能够容忍单点故障,但NameNode的单点故障是灾难性的,因为数据定位信息不可用。

### 2.2 元数据安全的风险评估

元数据存储了文件系统的结构和文件内容的索引信息,因此它是HDFS中最脆弱的部分。对元数据的安全风险进行评估是设计备份策略前的一个重要步骤。

#### 硬件故障的风险

硬件故障是HDFS环境中经常遇到的威胁。硬盘故障、网络问题或电源故障都可能导致NameNode停止运行。这些情况下的硬件故障直接威胁到元数据的安全,因为NameNode通常只在内存中保存元数据状态,而没有持久化备份。

#### 软件故障的风险

软件故障也是一大风险。比如程序bug、配置错误或者错误的操作指令都可能导致NameNode的损坏。在没有备份的情况下,这可能意味着需要人工介入,并且可能会丢失一些元数据。

#### 恶意攻击的风险

随着网络攻击手段的不断进步,恶意攻击成为新的安全挑战。攻击者可能会针对NameNode发起服务拒绝攻击(DDoS),甚至试图破坏或篡改元数据。

### 2.3 备份策略的重要性

制定有效的备份策略是降低上述风险、确保数据安全的关键。

#### 数据完整性和可用性的平衡

备份策略需要在数据的完整性、备份的频率和资源消耗之间取得平衡。备份策略需要定期进行,以防止数据丢失,但同时也要保证对生产环境的影响最小化。

#### 备份策略的制定原则

备份策略应该易于执行、能够快速恢复,并且最小化数据丢失的风险。应该包括定期检查备份的完整性,以及确保备份能够被有效地存储和恢复。

```mermaid

flowchart LR

A[NameNode] -->|数据完整性| B[备份策略]

B -->|可用性| C[备份频率]

C -->|资源消耗| D[执行备份]

D -->|验证| E[备份完整性]

E -->|快速恢复| F[恢复策略]

```

上图展示了备份策略设计的几个关键要素和它们之间的关系。在设计备份策略时,需要考虑到所有这些要素,确保备份的可靠性同时减少对系统的影响。

# 3. HDFS NameNode元数据备份技术

Hadoop分布式文件系统(HDFS)是构建于廉价硬件上的大规模分布式存储系统。它主要由NameNode和DataNode两个部分组成,其中NameNode负责管理整个文件系统的元数据。元数据的完整性和稳定性直接影响到整个HDFS系统的稳定运行。因此,深入了解HDFS NameNode元数据的备份技术至关重要。本章节将详细解读HDFS NameNode元数据的备份技术,并提供实践操作。

## 3.1 内置备份机制详解

HDFS为NameNode元数据的备份提供了内置机制,包括镜像文件的自动备份与Checkpoint机制。

### 3.1.1 镜像文件的自动备份

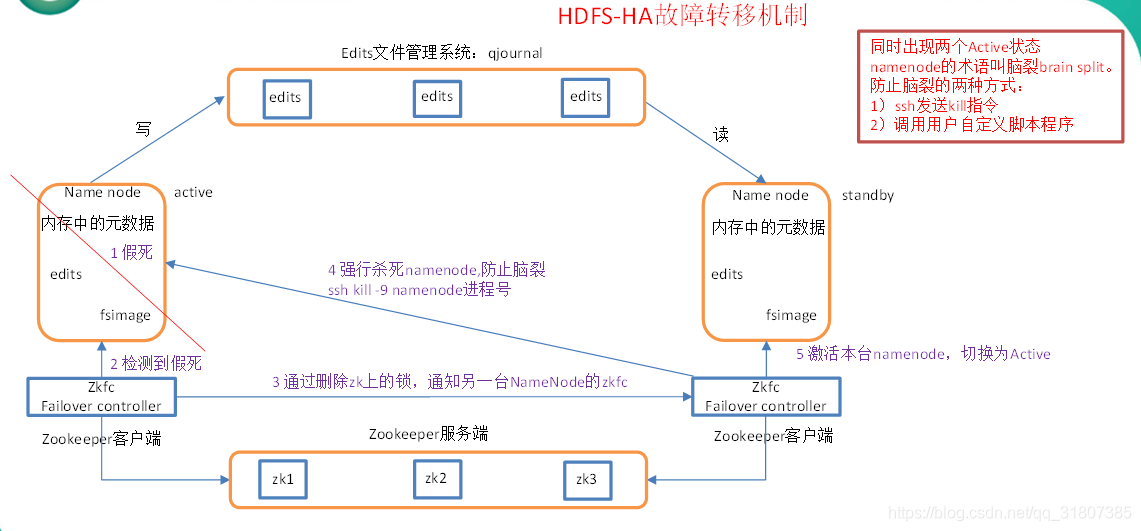

HDFS通过在多个DataNode上维护多个相同数据的副本,实现了数据的高可用性。其中,NameNode的元数据也采用了这种模式进行备份。通过配置多个NameNode,一个作为活动的主NameNode,另一个作为备用的Standby NameNode,主NameNode在运行时会将数据镜像自动同步到Standby NameNode中。这种自动备份机制确保了当活动NameNode发生故障时,可以迅速切换到Standby NameNode,保证了系统的高可用性。

### 3.1.2 Checkpoint机制

Checkpoint是Name

0

0