YARN数据本地性优化:网络开销降低与计算效率提升技巧

发布时间: 2024-10-26 05:12:11 阅读量: 2 订阅数: 3

# 1. YARN数据本地性概述

在现代大数据处理领域中,YARN(Yet Another Resource Negotiator)作为Hadoop生态系统的核心组件之一,负责对计算资源进行管理和调度。在大数据分布式处理的过程中,数据本地性(Data Locality)是一个关键概念,它指的是计算任务尽可能在存储有相关数据的节点上执行,以减少数据在网络中的传输,提高处理效率。

**数据本地性的重要性**:

数据本地性直接关系到整个系统的I/O效率和处理速度。理想情况下,数据本地性级别越高,数据传输和等待时间越少,系统的整体性能和效率就越高。这对于需要处理海量数据的分布式计算环境尤为重要。

**YARN与数据本地性**:

YARN通过其灵活的资源管理能力,可以对数据本地性进行优化。了解YARN是如何在作业调度时考虑数据本地性,以及如何通过优化配置和策略来提高数据本地性级别,是本文探讨的重点。

通过后续章节的深入分析,我们会逐步揭开YARN数据本地性的神秘面纱,探讨如何在实际应用中进行有效的优化和改进。

# 2. YARN数据本地性原理与理论

## 2.1 YARN架构与资源管理

### 2.1.1 YARN架构基本组成

Apache YARN (Yet Another Resource Negotiator) 是Hadoop 2.0的核心组件,它将资源管理和作业调度/监控分离开,提供了一个可扩展的系统来调度和管理计算资源。YARN架构主要由以下几个组件构成:

- **ResourceManager (RM)**:负责整个系统的资源管理和分配。它包含两个主要组件:调度器(Scheduler)和应用程序管理器(ApplicationMaster)。

- **NodeManager (NM)**:每个计算节点上的守护进程,负责监控容器(Container)的资源使用情况(如CPU、内存、磁盘、网络)以及容器的生命周期管理。

- **ApplicationMaster (AM)**:负责管理单个应用程序的执行,并与ResourceManager协商资源,跟踪节点上的任务进度。

- **Container**:是YARN中的资源抽象,封装了某个节点上的多维度资源(比如CPU,内存),应用程序在Container内执行,而Container是由ResourceManager中的调度器分配的资源池。

```mermaid

graph LR

A[ResourceManager] -->|资源请求| B[NodeManager]

B -->|资源分配| C[ApplicationMaster]

C -->|任务运行| D[Container]

D --> E[任务执行]

```

### 2.1.2 资源调度机制解析

YARN中的资源调度由ResourceManager负责,它分为两个主要部分:调度器(Scheduler)和应用程序管理器(ApplicationManager)。调度器根据资源需求和集群资源状态来调度Container,但是它不负责Container内部任务的执行,这是ApplicationMaster的角色。

调度器本身不执行任务,也不监视或跟踪应用的状态,这些由ApplicationMaster完成。调度器主要有以下几个关键点:

- **容量调度器(Capacity Scheduler)**:允许共享集群资源,并将资源分配给多个队列,每个队列可以设置最小和最大资源容量,还可以设置资源使用的优先级。

- **公平调度器(Fair Scheduler)**:旨在确保所有应用公平地使用资源,通过动态调整分配给应用的资源来减少资源空闲时间。

```mermaid

graph LR

A[ResourceManager] -->|调度决策| B[调度器]

B -->|资源分配| C[NodeManager]

C -->|资源使用| D[ApplicationMaster]

D -->|任务请求| B

```

## 2.2 数据本地性的定义与分类

### 2.2.1 数据本地性的种类

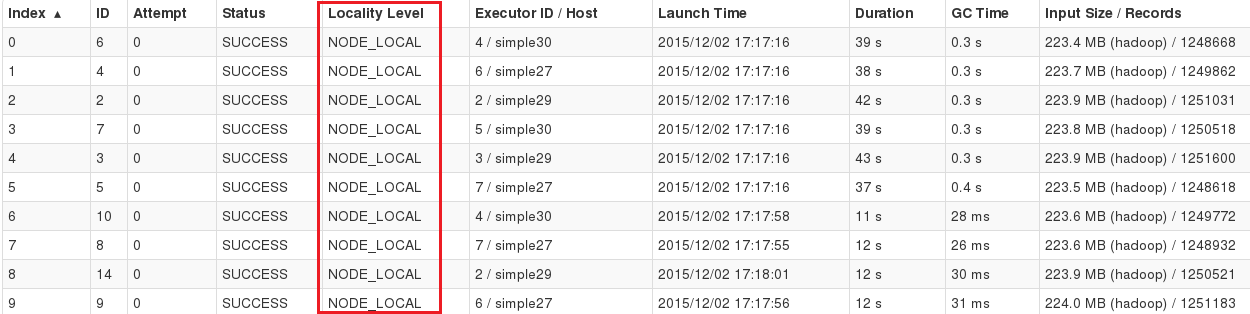

数据本地性是YARN处理数据的关键概念之一,它描述了计算任务和数据存储位置之间的关系,一般分为以下几种类型:

- **机架本地性(Rack-local)**:任务在与存储数据相同机架的机器上运行,这是最常见的数据本地性类型。

- **节点本地性(Node-local)**:任务在与存储数据相同的节点上运行,这是数据本地性中最优的情况。

- **无本地性(Non-local)**:任务在既不与数据所在机架也不与数据所在节点相同的节点上运行。

### 2.2.2 影响数据本地性的因素

数据本地性受多种因素影响,了解这些因素可以帮助我们更好地优化YARN集群的性能:

- **数据分布**:数据块的分布不均或不恰当的数据副本放置,都会影响本地性。

- **任务调度**:ResourceManager的调度策略,如容量调度器和公平调度器,会影响任务的本地性。

- **网络拥塞**:网络中的高负载可能会延迟数据传输,进而影响到任务的本地性。

- **集群配置**:YARN和Hadoop的配置参数(如副本因子、心跳间隔等)也会影响本地性。

## 2.3 网络开销与计算效率的关系

### 2.3.1 网络开销的计算模型

在网络开销的计算模型中,我们通常考虑以下几个主要因素:

- **数据传输量**:任务所需读写的数据量越大,网络开销就越高。

- **网络带宽**:可用的网络带宽决定了数据传输速率,影响网络延迟。

- **集群规模**:集群规模的增大可能会增加网络通讯的复杂性和成本。

```mermaid

graph LR

A[数据传输量] -->|影响因素| B[网络开销]

B -->|影响| C[计算效率]

C -->|受制于| D[集群规模]

```

### 2.3.2 网络开销对效率的影响分析

高网络开销会降低集群的计算效率,造成资源浪费,我们可以通过优化数据本地性来减少网络开销。例如:

- **优化数据副本策略**:通过合理的数据副本策略来减少跨机架或跨节点的数据读取。

- **提高数据本地性级别**:尽可能让计算任务在数据所在的机架或节点上执行,从而减少数据传输。

- **使用高速网络**:在集群硬件配置上,使用高速网络可以显著提高数据处理速度。

- **合理调度任务**:ResourceManag

0

0