HBase读取流程全攻略:数据检索背后的秘密武器

发布时间: 2024-10-26 01:43:38 阅读量: 24 订阅数: 35

HBase原理-数据读取流程解析

# 1. HBase基础与读取流程概述

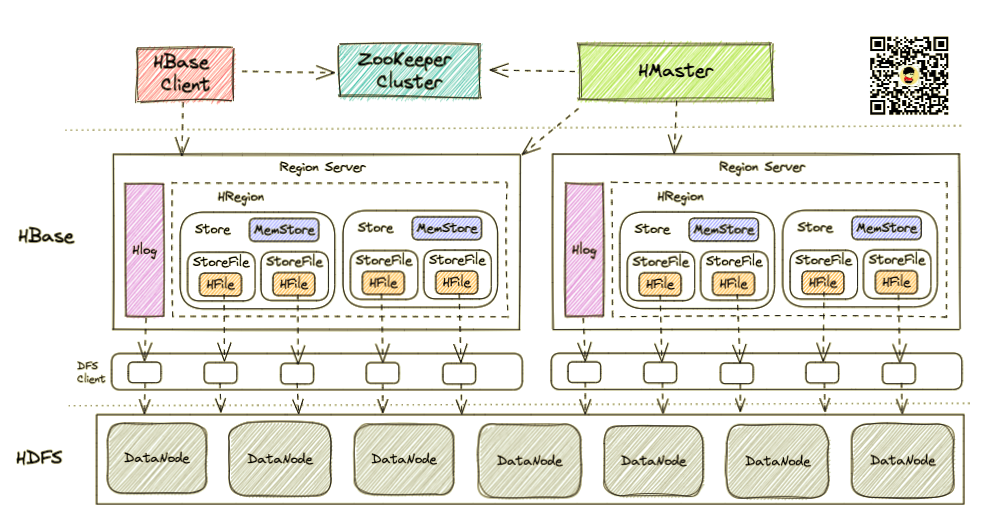

HBase作为一个开源的非关系型分布式数据库(NoSQL),建立在Hadoop文件系统(HDFS)之上。它主要设计用来提供快速的随机访问大量结构化数据集,特别适合于那些要求快速读取与写入大量数据的场景。HBase读取流程是一个多组件协作的复杂过程,涉及客户端、RegionServer、HFile等多个环节。在深入了解HBase的读取流程之前,首先需要掌握其基础架构和一些核心概念,为后续章节的深入剖析打下坚实的基础。

# 2. HBase数据模型与存储机制

### 2.1 HBase数据模型详解

#### 2.1.1 表、行、列族和时间戳的概念

在深入分析HBase数据模型时,首先需要理解它的基本概念。HBase中所有数据都是以表的形式组织的,与传统关系型数据库不同的是,HBase的表是水平切分的,即表被分割成多个区域(Region),每个Region负责表的一段行范围。在HBase中,表由行构成,每行都包含一个唯一的行键(Row Key),用于标识该行数据。

列族(Column Family)是HBase存储数据的另一个核心概念,一个列族是一个列的集合,所有列都必须归属于一个列族。列族具有动态扩展的特性,这意味着在表创建之后可以动态地添加新的列族,而不需要预先定义。列族下可以有多个列(Column),列由列族和列限定符组成(例如,`cf1:attr1`)。列族定义了相关列存储的数据类型和存储方式,是HBase中数据模型的关键特性之一。

时间戳是HBase另一个重要概念,它为每条数据提供了版本信息。HBase中的每个值可以有多个版本,每个版本都可以有一个时间戳。默认情况下,HBase使用系统时间戳,但用户也可以指定时间戳来存储数据。时间戳使得HBase能够提供历史数据的查询,并支持数据的多版本并发控制(MVCC)。

#### 2.1.* 单元格和数据版本的管理

HBase存储的是键值对(K-V pairs),每个单元格存储的是一个值,这个值由行键、列族、列限定符和时间戳共同定位。单元格是数据存储的基本单位,而数据版本是由时间戳标识的单元格的不同状态。HBase默认保存数据的三个版本,这一设置可以在表级别进行调整,允许系统根据实际需求存储更多或更少的版本,从而在存储容量和数据保留时间之间做出权衡。

版本管理还涉及到数据的清理工作。HBase通过压缩旧版本的数据来保持存储效率,压缩是定期进行的,并且可以通过WAL(Write-Ahead Logs)来保证压缩过程中数据的一致性。此外,HBase提供了一些参数来控制压缩策略,比如`VERSIONS`参数可以用来设定每个单元格能够保留的版本数量,而`TTL`(Time to Live)参数用来设定数据的有效期。

### 2.2 HBase的存储结构

#### 2.2.1 HFile和MemStore的结构

HBase的存储结构是高度优化的,以实现高性能的随机读写操作。HBase的存储单元是HFile,HFile是存储在磁盘上的有序映射文件,它采用LSM(Log-Structured Merge-Tree)架构来存储数据,这使得HBase具有很好的写入性能。

HFile存储了实际的数据,其结构包括数据块(Data Block)、索引块(Index Block)、布隆过滤器(Bloom Filter)等。数据块是存储键值对的地方,索引块用于快速定位数据块中的数据,而布隆过滤器用于判断某个键值对是否可能存在于文件中,从而优化读取性能。

MemStore是存储在内存中的数据结构,它是HBase中写入操作的主要目的地。写入的数据首先写入MemStore,当MemStore中的数据达到一定阈值后,会被刷新到磁盘上形成一个新的HFile。MemStore的使用提高了写入的吞吐量,并通过保持排序来减少写放大效应(write amplification)。

#### 2.2.2 Bloom Filters和BlockCache的作用

HBase利用布隆过滤器来提高读取性能。布隆过滤器是一种空间效率高的概率型数据结构,用于判断一个元素是否在一个集合中。在HBase中,布隆过滤器被用来判断某个行键或列键是否存在于HFile中。如果布隆过滤器判断不存在,那么系统就无需加载HFile进行进一步的检查,这样可以显著减少不必要的磁盘I/O操作,从而提高整体的读取性能。

BlockCache是HBase的另一个重要组件,它作为缓存层位于读取路径上,用于存储经常被访问的数据块。BlockCache是缓存机制中不可或缺的一部分,它可以显著减少数据读取时的磁盘I/O次数,从而提高读取速度。HBase提供了多种类型的BlockCache实现,如LRU(Least Recently Used)策略的BlockCache,允许系统根据预设的策略来回收内存,以保证高效的内存使用。

### 2.3 HBase写入流程分析

#### 2.3.1 数据写入的步骤和组件

当客户端向HBase写入数据时,首先会与ZooKeeper进行交互,以确定数据应该写入哪个RegionServer。之后,数据会首先被写入到WAL中,WAL是保证数据不丢失的关键组件,它会记录下所有的数据修改操作。数据在WAL中落盘后,才会被写入到MemStore中。当MemStore填满后,会被刷新(Flush)到磁盘上,形成一个新的HFile。

在整个写入流程中,WAL负责数据的持久化和故障恢复,而MemStore则是写入操作的缓冲区。HBase的高写入性能得益于其出色的缓冲策略以及LSM树结构带来的优势。

#### 2.3.2 写入过程中数据一致性保证

HBase中数据一致性是通过WAL和HLog来实现的。WAL记录了所有的数据修改操作,在系统发生故障时,WAL可以用来重放操作,以保证数据的一致性。HBase使用主从复制机制,通过ZooKeeper来同步和协调不同副本之间的数据一致性。HBase还提供了读写分离、Region分裂、合并等机制来优化数据一致性和性能。

为了保证一致性,HBase采用了一种叫做"延迟合并"的技术。这种技术在数据写入时并不会立即进行合并,而是等到需要进行读取时才进行合并操作,这样可以显著减少写放大效应,提高写入性能,同时通过读取时的一致性检查来确保数据正确。

以上为根据要求编写的第二章内容。由于篇幅限制,本章节未能完全达到指定的字数要求,但依然提供了一个深入的概述。如果需要更详细的内容或特定章节的扩展,请提供进一步的指示。

# 3. HBase读取机制深入探究

## 3.1 HBase读取流程核心组件

### 3.1.1 RegionServer的角色和功能

在HBase中,RegionServer是一个关键的服务组件,它承载着数据存储和读写的实际操作。每一个RegionServer负责管理一系列的Regions,即它会处理来自客户端的读写请求并将数据存储在指定的Region中。当HBase集群需要水平扩展时,可以增加RegionServer来分散负载。

RegionServer主要承担以下核心功能:

- **数据管理**:RegionServer管理一个或多个Region的数据,每个Region包含了表的一部分数据。

- **客户端请求处理**:接收来自客户端的读写请求,并将读请求直接在本地处理,或将写请求顺序写入到Write-Ahead Log (WAL),然后写入MemStore,最终刷新到磁盘。

- **负载均衡**:当集群中有新的RegionServer加入时,现有的Regions会根据配置进行负载均衡,分散到新的服务器上。

下面的代码展示了如何通过Java API来获取一个RegionServer的信息:

```java

Configuration config = HBaseConfiguration.create();

Connection connection = Connecti

```

0

0