【存储成本优化】:HBase数据压缩技术的深入剖析

发布时间: 2024-10-26 01:15:45 阅读量: 40 订阅数: 35

果壳处理器研究小组(Topic基于RISCV64果核处理器的卷积神经网络加速器研究)详细文档+全部资料+优秀项目+源码.zip

# 1. HBase数据压缩技术概述

在现代大数据的存储管理中,如何有效利用存储资源,同时确保数据的快速读写和高效访问,一直是技术研究与实践应用的热点。HBase作为Apache基金会旗下的一款开源的、分布式的、面向列的NoSQL数据库管理系统,它采用列式存储架构,并特别适用于处理大量数据的随机读写操作。随着数据量的不断增长,数据压缩技术作为优化存储空间利用率的关键手段,在HBase中的应用变得日益重要。

HBase的数据压缩技术允许用户通过选择合适的压缩算法,降低磁盘空间的占用以及I/O操作的次数,从而提升系统的整体性能。压缩技术不仅涉及算法和编码效率的比较,更重要的是压缩与解压缩过程对系统性能的影响,以及如何在保持高压缩率的同时,最小化对读写操作性能的负面影响。

本章将简要介绍HBase数据压缩技术的基本概念和背景,为读者进一步深入理解后续章节的压缩理论基础、实践应用以及优化策略提供基础。通过对数据压缩的基本知识和应用价值的理解,我们能够更好地掌握HBase在不同业务场景下压缩技术的应用,并对其产生的性能影响有更全面的认识。

# 2. HBase压缩的理论基础

## 2.1 HBase数据存储模型

### 2.1.1 HBase表结构和存储机制

HBase作为Apache下的一个开源非关系型分布式数据库,它存储数据采用的是列式存储模型,这一点有别于传统的关系型数据库。HBase表由行、列族和时间戳组成,每个表的行在存储时都是以RowKey为排序依据进行存储,这使得相同的RowKey的数据在物理上是相邻的,便于快速检索。

HBase的表在物理存储上是分散存储在HFile中的,HFile是HBase存储模型的基础,它遵循Bigtable的设计,使用LSM树(Log-Structured Merge-Tree)来组织数据,这个结构由内存中的MemStore和磁盘上的多个HFile组成。当写入的数据首先被放入MemStore中,当MemStore达到一定的大小,就会被刷新(flush)到磁盘上,成为不可变的HFile。

### 2.1.2 数据模型和压缩的关系

数据压缩对HBase数据模型的影响主要体现在存储效率和读写性能上。由于数据是列式存储的,同一列族下的数据在物理上是连续存储的,这为数据压缩提供了良好的基础,因为相同的数据类型和模式往往具有更好的压缩率。例如,一列中存储的都是数字或者都是字符串,这样数据的冗余度就会增加,进而使得压缩算法的效果更加明显。

### 2.1.3 HBase存储模型优化实践

为了更好的理解和利用HBase的存储模型,我们可以进行一系列优化实践:

1. 优化RowKey设计,确保合理的数据分布和访问模式。

2. 选择合适的列族设计,通过列族来进一步优化压缩。

3. 合理配置MemStore和HFile的大小,避免频繁的flush操作影响性能。

4. 监控HBase的存储空间使用情况,及时调整数据压缩策略。

## 2.2 压缩算法原理

### 2.2.1 常见压缩算法对比

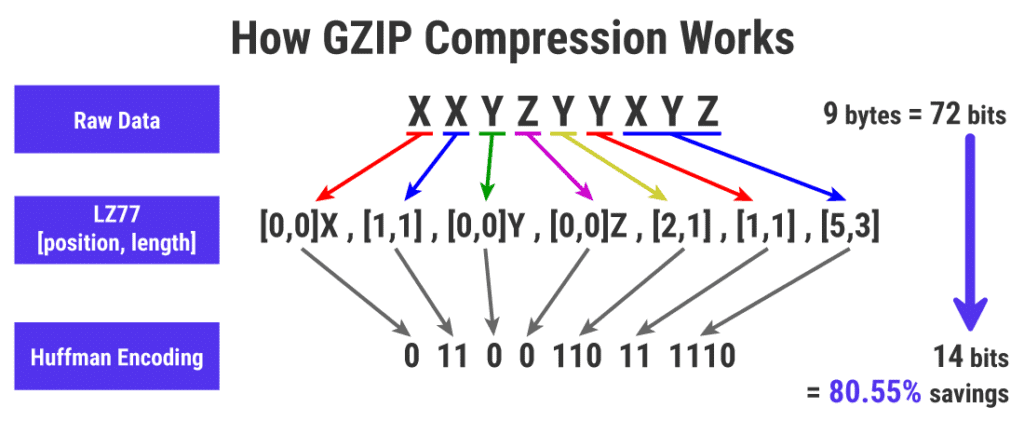

在数据压缩领域中,多种压缩算法各有优劣,适用于不同的场景。在HBase中,常见的压缩算法包括GZIP、LZ4、Snappy等。这些算法各自有不同的压缩比和压缩解压缩速度,从压缩比来看,GZIP较高但压缩解压缩速度相对较慢,LZ4和Snappy则在压缩比和速度上寻找平衡,相对更快。

- **GZIP**:基于Deflate算法,是一种使用广泛的压缩算法,具有较高的压缩率,但是压缩和解压缩速度较慢。

- **LZ4**:追求速度的压缩算法,适用于需要快速压缩和解压缩的场景。

- **Snappy**:由Google开发,同样注重速度,但压缩率低于GZIP和LZ4。

### 2.2.2 压缩算法的选择依据

选择合适的压缩算法主要依据以下几点:

1. **压缩与解压缩速度**:对于实时性要求较高的应用,应优先考虑速度较快的算法。

2. **压缩率**:对于存储成本敏感的应用,应该优先选择压缩率较高的算法。

3. **资源消耗**:评估内存和CPU的消耗,避免压缩过程对系统性能产生过大影响。

4. **应用场景**:根据实际的业务需求和使用场景来决定使用哪种压缩算法。

在HBase中,除了直接使用这些压缩算法外,还可以根据实际的数据特点和使用场景,自定义压缩算法,以获得更优的性能。

## 2.3 压缩对性能的影响

### 2.3.1 压缩率与读写性能的权衡

在使用数据压缩时,必须考虑到压缩率与读写性能之间的权衡关系。压缩算法在提高存储效率的同时,也增加了CPU的计算开销,这会在一定程度上影响读写操作的速度。

- 压缩率越高,意味着相同的数据所占的空间越小,可以提高存储效率,减少存储成本。

- 但是,数据压缩和解压缩过程需要额外的CPU资源,会对读写性能造成影响。例如,使用GZIP压缩算法时,压缩率高,读写性能下降也会比较明显。

因此,在实际应用中,需要根据业务的实际需求,选择适合的压缩算法和压缩级别,达到性能和存储成本的平衡。

### 2.3.2 压缩与解压缩的时间成本

压缩算法的选择会影响到压缩和解压缩过程中的时间成本。时间成本包含两部分:一是数据写入时的压缩时间,二是数据读取时的解压缩时间。时间成本的计算公式可以表示为:

```mermaid

graph TD

A[数据写入] -->|压缩| B[压缩时间]

C[数据读取] -->|解压缩| D[解压缩时间]

B --> E[存储或传输]

D --> F[数据使用]

```

其中,压缩时间和解压缩时间取决于所选压缩算法的效率和数据的特点。时间成本的控制至关重要,尤其是在对延迟敏感的业务场景中,时间成本过高可能会导致服务的响应时间变长,影响用户体验。

在HBase中,可以通过以下方法来优化压缩与解压缩的时间成本:

1. **选择适合的压缩算法**:根据业务特点和性能要求选择适合的压缩算法。

2. **适当调整压缩级别**:在保证压缩效果的前提下,适当降低压缩级别可以减少时间成本。

3. **增加计算资源**:通过增加CPU资源来平衡压缩解压缩对性能的影响。

4. **异步压缩解压缩**:将压缩解压缩操作异步化,避免阻塞数据的读写操作。

## 2.4 HBase数据压缩实践案例

### 2.4.1 HBase压缩实践案例分析

实践案例是理解HBase数据压缩技术应用的关键。通过分析实际应用中的案例,能够更直观地了解压缩技术在HBase中的表现及其优化策略。

例如,某互联网公司使用HBase存储用户行为数据,数据量庞大且更新频繁。为了提高存储效率,他们选择了LZ4压缩算法。最初,由于没有进行足够的性能测试,直接应用默认的压缩参数导致系统在高并发写入时性能下降。

通过后续的测试,调整了压缩参数,并采用异步压缩的方式进行优化,成功地在保证性能的前提下提高了存储效率。这个案例表明,在实际应用中进行充分

0

0