HBase负载均衡技术:集群性能优化的关键步骤

发布时间: 2024-10-26 01:33:35 阅读量: 36 订阅数: 47

hbase负载均衡算法分析

# 1. HBase负载均衡技术概述

在分布式存储系统的世界里,负载均衡是确保系统稳定运行和高效处理数据请求的关键技术之一。HBase,作为Apache软件基金会的顶级项目和Hadoop生态系中的一员,专为处理大数据而设计。它在面临高并发、大数据量读写请求时,对负载均衡的需求尤为迫切。本章将介绍HBase负载均衡的基本概念,目的是为了搭建一个稳定且高效的HBase集群环境,为后续深入探讨架构、监控和优化打下坚实的基础。我们首先从负载均衡的定义开始,逐步引入HBase负载均衡的特殊性和应用场景,帮助读者建立起关于这一技术的基础认识。

# 2. ```

# 第二章:HBase集群基础架构和工作原理

## 2.1 HBase集群架构解析

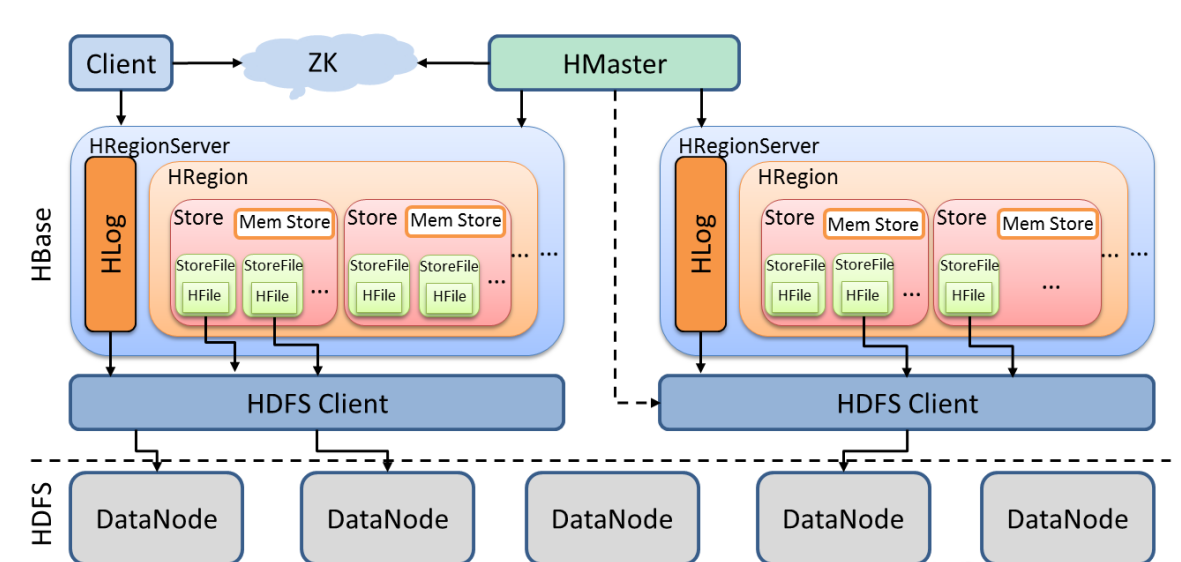

### 2.1.1 RegionServer的角色和工作模式

RegionServer是HBase集群中的核心组件之一,它负责管理和存储数据。每个RegionServer可以管理多个Region,即数据表的子集。每个Region是数据的水平切片,它包含了一部分行的范围。RegionServer的主要工作模式包括:

- 服务请求:RegionServer响应来自客户端的读写请求。

- 数据管理:RegionServer负责数据的存储、检索和更新。

- Region分裂:当Region变得太大时,RegionServer会负责将其分割为更小的Region。

- 故障恢复:在RegionServer发生故障时,它会重新加入集群,并恢复数据服务。

RegionServer通过其WAL(Write-Ahead Log)来确保数据的持久性和恢复能力。WAL是先写入磁盘的日志,用于记录所有的更新操作,这样即使在系统崩溃后也能保证数据不丢失。

在HBase集群中,数据是按列族(Column Family)进行存储的。每个列族可以拥有自己的存储策略,包括数据块大小和压缩算法等。

### 2.1.2 HMaster的作用和协调机制

HMaster是HBase集群的另一个核心组件,它的主要职责是集群的管理和维护。HMaster负责以下任务:

- 表管理:创建、删除和修改表结构等。

- Region管理:监控RegionServer的状态,分配Region给可用的RegionServer。

- 负载均衡:监控集群负载,执行负载均衡操作。

- 数据恢复:在RegionServer失败的情况下,HMaster负责故障转移和数据恢复。

HMaster与RegionServer之间的协调主要依靠ZooKeeper来完成。ZooKeeper是一个高可用的分布式协调服务,它可以管理集群的状态信息,保证集群配置的一致性和同步。

HMaster在启动时会从ZooKeeper中读取集群状态,并在运行过程中持续更新。当HMaster发现RegionServer宕机时,它会尝试进行故障转移,并在新的RegionServer上恢复故障Region的数据。

## 2.2 HBase数据分布机制

### 2.2.1 Region的划分和管理

HBase通过Region的概念实现了数据的动态水平切分。每个表默认被水平切分成一个或多个Region,每个Region包含一定范围的行(由行键起始和终止决定)。随着表数据的增长,Region可以自动分裂成更小的Region。Region的管理涉及以下几个关键方面:

- Region定位:客户端通过元数据表(.META.)来确定所需数据所在的RegionServer。

- Region分配:HMaster负责Region的分配给RegionServer。

- Region迁移:为了负载均衡,HMaster可以将Region从一个RegionServer迁移到另一个。

### 2.2.2 数据倾斜问题和影响

数据倾斜是指数据在集群中的分布不均匀,导致某些RegionServer上的负载远高于其他节点。数据倾斜对集群性能有以下影响:

- 性能瓶颈:负载高的RegionServer可能会成为性能瓶颈,影响整个集群的性能。

- 磨损不均:倾斜的数据分布会导致硬件磨损不均,一些节点可能提前需要替换。

- 维护困难:倾斜的数据分布使得集群的维护和扩容变得更加困难。

处理数据倾斜问题通常涉及重新设计数据模型、引入预分区或调整集群的配置参数等方法。

## 2.3 HBase性能监控和分析

### 2.3.1 性能监控的关键指标

为了保证HBase集群的健康和性能,监控是必不可少的。一些关键的性能监控指标包括:

- 请求延迟:客户端请求的响应时间,包括读写延迟。

- 吞吐量:集群每秒处理的请求数量。

- RegionServer状态:监控RegionServer的负载、可用性和故障情况。

- 资源使用情况:包括CPU、内存和磁盘I/O的使用情况。

除了这些基础指标,我们还可以监控特定的内部指标,如WAL写入延迟、MemStore占用等。

### 2.3.2 性能瓶颈的诊断方法

当监控系统报告性能问题时,我们需要诊断瓶颈的根源。以下是一些常用的诊断方法:

- 使用HBase自带的JMX接口或WebUI来查看实时性能指标。

- 分析GC日志和堆栈跟踪来查找潜在的内存问题。

- 分析HBase日志文件,查找异常或错误信息。

- 利用HBase shell命令,如`status`、`balance_switch`、`CompactScanner`等来诊断问题。

对于复杂的性能问题,可能需要结合多个监控工具和日志信息综合分析。

通过本章节的介绍,我们了解了HBase集群的基础架构,包括RegionServer和HMaster的角色,以及数据的分布机制和性能监控的关键指标。在后续的章节中,我们将深入探讨负载均衡的理论基础和实践操作,以及如何处理HBase集群中的数据倾斜和故障处理问题。

```

# 3. HBase负载均衡理论基础

## 3.1 负载均衡的目标和要求

### 3.1.1 响应时间和吞吐量的优化目标

在分布式系统中,响应时间是衡量系统性能的一个重要指标,它指的是从客户端发出请求到接收到响应的这段时间。对于HBase而言,响应时间的优化意味着减少查询和写入操作的延迟,从而提升用户体验和系统的实时性。实现这一目标通常需要解决以下几个关键问题:

- **数据局部性**:确保客户端请求能够尽可能地被路由到存储数据的服务器上,减少网络延迟和跨RegionServer的数据传输。

- **RegionServer的负载均衡**:通过合理分配数据和请求,避免某些RegionServer过载,而另一些却处于空闲状态。

- **缓存利用**:高效利用内存缓存,比如BlockCache,减少磁盘I/O操作。

优化吞吐量通常与提高数据处理能力相关。对于写入操作,需要确保数据可以快速持久化到HBase,减少写入延迟。对于读取操作,需要快速从HBase中检索数据。提高吞吐量的方法可能包括:

- **并行处理**:通过增加RegionServer的数量,提高数据的并行处理能力。

- **I/O优化**:优化磁盘读写操作,比如使用SSD硬盘替代传统的机械硬盘。

### 3.1.2 资源利用率的最大化

HBase集群的资源利用率最大化包括了CPU、内存、磁盘和网络等资源的高效使用。理想情况下,

0

0