【R语言效率王】:data.table在数据处理中的极致应用

发布时间: 2024-11-10 03:41:56 阅读量: 41 订阅数: 23

R语言中基于dplyr和data.table的数据筛选与汇总技术详解

# 1. data.table基础与优势概述

在现代数据科学和大数据分析领域中,R语言凭借其强大的包生态系统,尤其是`data.table`包的引入,为数据处理带来了革命性的变化。`data.table`是一种用于数据操作和分析的高效R包,它的设计目标是快速读取、处理和返回结果,特别适合于大型数据集的处理。

`data.table`的核心优势在于其高效性,这得益于它高度优化的内存使用和数据存储机制。它通过特定的数据结构以及内部实现的高效算法,能够比传统的`data.frame`执行更加复杂的数据操作,同时保持极高的速度和较低的内存消耗。这一优势在处理上百万甚至上亿行数据时尤其突出。

此外,`data.table`还提供了简洁、易于理解的语法,使得数据科学家可以以更少的代码行来表达复杂的数据操作。在学习使用`data.table`的过程中,你会发现它将简洁和速度完美地融合在了一起,从而为数据处理工作流程带来简洁、高效的优化。在接下来的章节中,我们将深入探讨`data.table`的具体应用及其优化策略,帮助读者更好地掌握这一强大工具。

# 2. data.table的数据结构与操作

在第一章中,我们探讨了data.table包在R语言中的基础地位和它带来的优势,为数据处理提供了新的高效方法。现在,我们将深入到data.table的实际应用中,探讨它的数据结构、操作方式以及如何实现高效数据处理的技巧。

## 2.1 data.table基础语法

### 2.1.1 创建和初始化data.table对象

data.table是一个R语言的数据框架的变体,用于高效地处理大数据集。它被设计为高度优化且易于使用的数据框架,特别适用于复杂的数据操作任务。

在R中创建一个data.table对象的基本方法是使用`data.table()`函数。例如,创建一个包含随机数的数据表:

```r

library(data.table)

dt <- data.table(

x = rnorm(10),

y = rnorm(10),

z = 1:10

)

```

这里,`rnorm`函数生成了一些随机数据,`1:10`创建了一个从1到10的序列。通过`data.table()`函数,我们把这些数据整合成了一个data.table对象。

### 2.1.2 data.table的特有属性和方法

data.table对象继承了data.frame的所有属性,但提供了一些额外的功能和更高效的处理方法。data.table的特有属性包括高效的数据分组和子集创建操作。

对于data.table的特有方法,`setkey`是一个重要函数。它允许我们设置data.table的键,这在后续的快速筛选和连接操作中至关重要:

```r

setkey(dt, z)

```

这行代码设置了`dt`的键为`z`列。在设置键后,许多操作会变得更加快速,例如按照`z`列的值进行筛选和排序。

## 2.2 高效的数据筛选与子集创建

data.table包提供了一系列简洁而强大的数据筛选和子集创建方法,这些方法在大数据处理中表现出色。

### 2.2.1 通过键值对进行快速筛选

在设置了键之后,我们可以利用键值对快速筛选出对应的子集:

```r

subset <- dt[J(5)]

```

这里使用`J()`函数和键`z`的值5来筛选出所有`z`值为5的行。

### 2.2.2 利用条件表达式筛选数据

data.table也支持使用条件表达式来筛选数据,这与data.frame中的用法类似,但执行速度更快:

```r

subset <- dt[x > 0 & y > 0]

```

这行代码筛选出所有`x`和`y`值都大于0的行。

### 2.2.3 分组和聚合操作

data.table的分组和聚合操作是通过特殊的语法完成的,如使用`by = .(column)`语法对数据进行分组,并进行聚合计算:

```r

result <- dt[, .(mean_x = mean(x), mean_y = mean(y)), by = .(z)]

```

这里,我们对`x`和`y`列求均值,并按照`z`列的值分组。

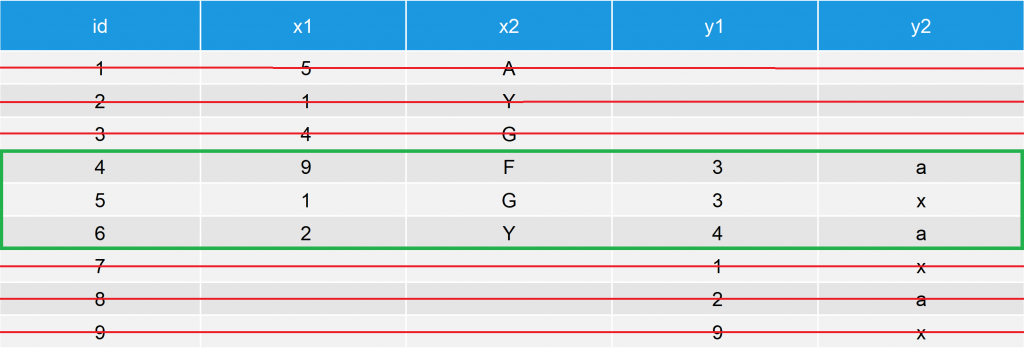

## 2.3 数据合并与重塑

data.table也提供了便捷的数据合并和重塑功能,允许用户高效地连接数据并根据需要调整数据表结构。

### 2.3.1 基于键值的连接操作

与SQL中的JOIN类似,data.table允许基于键值进行数据连接操作:

```r

dt2 <- data.table(z = 1:10, a = rnorm(10))

dt[dt2, on = "z"]

```

这行代码将`dt2`数据表按照`z`列连接到`dt`数据表上,类似于SQL中的内连接。

### 2.3.2 熔化和转置数据表

data.table提供了`melt`函数用于将数据表从宽格式转为长格式,以及`dcast`函数用于从长格式转为宽格式:

```r

# 熔化操作示例

melted <- melt(dt, id.vars = "z", measure.vars = c("x", "y"), variable.name = "variable", value.name = "value")

# 转置操作示例

dcasted <- dcast(melted, z ~ variable)

```

这里,我们首先将`dt`数据表中除`z`之外的列“熔化”成长格式的数据表,然后将其“转置”回宽格式。

通过本章的介绍,我们已经了解了data.table的基础语法和一些高效的数据操作技巧。在下一章中,我们将把这些技巧应用于实际的大数据处理场景中,深入探讨data.table在实践中的应用和优化。

# 3. data.table实践应用

## 3.1 大数据集的快速读写

### 3.1.1 从不同数据源导入数据

在处理大规模数据集时,能够快速地从不同的数据源导入数据是一个核心能力。`data.table`提供了多种方法来导入数据,包括但不限于CSV、JSON、数据库和其他格式。使用`fread`函数是导入数据的首选方法,因为它专为速度而优化。下面是一个使用`fread`导入CSV数据的例子:

```R

library(data.table)

# 从CSV文件导入数据

dt <- fread(input = "data.csv")

```

`fread`函数通过自动识别输入文件的分隔符、列名和数据类型,极大地方便了用户。如果需要指定分隔符,可以通过`sep`参数来实现。此外,对于大型CSV文件,`fread`支持并行读取,它能够自动检测机器的核心数并进行多线程读取,进一步提高读取速度。

### 3.1.2 高效的数据存储操作

当数据处理完成之后,将数据高效地存储也是一个重要的环节。`data.table`支持多种输出格式,包括CSV、RDS和其他二进制格式。对于数据集的快速存储,可以使用`fwrite`函数:

```R

# 将data.table对象保存为CSV文件

fwrite(x = dt, file = "output.csv")

```

`fwrite`是`fread`的写入等价物,它同样提供了高度优化的写入速度,并能智能地处理诸如转义字符等细节。如果需要保存为二进制格式,可以使用`saveRDS`函数来保存单个`data.table`对象,而`save`函数则适用于保存多个对象。

## 3.2 高级数据处理技巧

### 3.2.1 滚动窗口统计

在时间序列分析或金融数据分析中,滚动窗口统计是一种常见的需求。`data.table`能够高效地处理这类操作。这里以计算过去7天的平均值为例:

```R

library(data.table)

# 假设dt是一个已经按日期排序的data.table对象

dt[, rolling_avg := shift(frollmean(value, 7), fill = FALSE), by = group_id]

```

在上面的代码中,`frollmean`函数被用来计算滚动窗口平均值,`shift`函数则用于将结果向下移动一行,以便将计算出的平均值与相应的日期对齐。`by = group_id`参数表示我们按`group_id`分组进行计算。通过这种方式,我们能够有效地计算任何大小窗口的统计量。

### 3.2.2 多列操作与数据变换

`data.table`允许用户同时对多个列执行复杂的变换操作,这在数据预处理阶段非常有用。使用`.SD`和`.SDcols`参数可以实现这一功能:

```R

# 对dt中的特定列进行变换操作

cols_to_transform <- c("col1", "col2")

dt[, (cols_to_transform) := lapply(.SD, function(x) x^2), .SDcols = cols_to_transform]

```

在本例中,我们选取了`col1`和`col2`两列,并使用`lapply`函数应用了一个简单的变换(即计算每个元素的平方)。`.SD`代表“子数据集”,`lapply`对`.SD`中选定的每一列应用一个函数,实现批量操作。

## 3.3 性能优化实例

### 3.3.1 分组计算的优化

分组计算在数据分析中是一个常见的操作,尤其是在描述统计和数据聚合阶段。对于大数据集而言,分组计算往往成为性能瓶颈。`data.table`提供了`data.table`内置的优化聚合函数,如`sum`、`mean`、`median`等。借助`data.table`的优化功能,分组聚合操作可以非常高效:

```R

# 使用data.table进行分组计算

dt[, .(mean_value = mean(value), sum_value = sum(value)), by = group_id]

```

在上述代码中,`by = group_id`参数指示`data.table`按`group_id`字段进行分组,`.()`是`list()`的简写,用于收集聚合结果。这种方式比使用`dplyr`或`aggregate`函数的速度要快得多。

### 3.3.2 链式操作的性能测试与调整

链式操作是`data.table`的一个显著特点,它允许我们在单行代码中完成多个操作。然而,不当的链式操作可能导致性能下降。为了优化链式操作,需要测试不同操作顺序对性能的影响,并且可能需要手动调整以找到最佳执行路径:

```R

# 链式操作示例

dt[, value2 := value * 2][order(group_id, value)][, mean_value := mean(value), by = group_id]

```

上述代码中,我们首先计算了`value`的两倍并存储在`value2`列,然后按`group_id`和`value`进行排序,最后计算每个组的`value`平均值。在进行链式操作时,一般遵循从左到右的操作顺序,并按照执行成本从低到高的顺序进行分组操作,这样可以提高整体效率。

```mermaid

graph LR

A[开始链式操作] --> B[计算value2]

B --> C[按group_id和value排序]

C --> D[计算每个组的mean_value]

D --> E[结束链式操作]

```

使用`microbenchmark`等性能测试包对不同的操作顺序进行测试,可以帮助我们找到执行效率最高的代码顺序。优化链式操作是提高整体数据处理效率的关键步骤。

# 4. data.table进阶技巧与应用

## 4.1 非等值连接和自定义函数

### 非等值连接的技巧与场景

在数据处理中,等值连接是常见的操作,比如两个数据表根据相同字段的值进行合并。然而,在特定情况下,非等值连接则显得更为重要,它允许基于比较关系而不是相等关系来合并数据。这在处理区间数据、时间范围、阈值比较等场景中尤为常见。

使用data.table进行非等值连接,需要利用`F`前缀来指定条件表达式,`F`前缀表示该条件将在data.table的范围内进行计算。比如,在处理时间序列数据时,我们可能需要基于时间范围来合并数据表。

以下是一个非等值连接的示例代码:

```r

library(data.table)

# 创建两个data.table

DT1 <- data.table(id = c(1, 2, 3), start_date = as.Date(c("2021-01-01", "2021-02-01", "2021-03-01")), end_date = as.Date(c("2021-03-31", "2021-04-30", "2021-05-31")))

DT2 <- data.table(id = c(1, 3), date = as.Date(c("2021-03-15", "2021-05-15")))

# 使用非等值连接来找出DT2中日期落在DT1区间内的记录

result <- DT1[DT2, on = .(id, start_date <= date, end_date >= date), which = TRUE]

```

### 集成自定义函数的高级应用

data.table的真正力量不仅体现在对数据的快速操作上,还体现在能够将其与其他R函数或自定义函数无缝集成的能力上。这为数据处理提供了极大的灵活性和扩展性。

假设我们需要根据数据表中的特定计算来定义一个自定义函数,并希望在data.table上执行该函数进行数据变换。下面的代码段展示了如何在data.table中创建并应用自定义函数:

```r

# 定义一个自定义函数,用于计算每行的特定列之和

my_sum <- function(...) Reduce("+", list(...))

# 创建data.table

DT <- data.table(a = 1:4, b = 5:8, c = 9:12)

# 应用自定义函数计算a和b列的和,并将结果添加为新列

DT[, d := my_sum(a, b)]

```

在这个案例中,自定义函数`my_sum`使用了`Reduce`函数来迭代性地对传入的多个参数(这里是列a和b)进行加法操作。然后,我们直接在data.table上使用`:=`操作符将结果添加为新列。

## 4.2 多线程并行处理

### data.table的并行计算框架

data.table从1.9.6版本开始引入了多线程支持,它使用R的OpenMP接口(在支持OpenMP的系统上),允许用户进行并行计算,从而充分利用现代多核处理器的性能。data.table的并行计算主要通过`setDTthreads`函数来控制,它允许用户设置在操作中使用的线程数。

下面是一个简单的例子来说明如何设置并行线程进行数据操作:

```r

library(data.table)

# 设置并行线程数

setDTthreads(4) # 可以根据系统核心数进行调整

# 创建一个大的data.table

big_dt <- data.table(matrix(rnorm(1e8), ncol = 5))

# 进行并行操作,比如计算所有行的和

sum_result <- big_dt[, lapply(.SD, sum), .SDcols = 1:5]

```

在这里,我们首先设置了data.table使用的线程数为4,然后创建了一个包含1亿条记录的大数据表,并使用了`lapply`函数来进行并行计算。

### 实际案例中的多线程应用

在实际应用中,多线程并行处理可以显著提高大规模数据集上的处理速度。比如,在数据合并、分组聚合等操作中,由于这些操作本质上是可并行化的,因此可以实现性能的飞跃。

下面是一个模拟的复杂数据处理场景,在其中我们尝试使用data.table的多线程能力来优化性能:

```r

# 假设我们有一个巨大的数据集,需要进行复杂的计算

# 这里我们创建一个很大的data.table,包含随机数据

large_dt <- data.table(

id = rep(1:100000, each = 100),

value = rnorm(1e7)

)

# 我们需要对每个id进行分组计算均值和标准差

system.time({

result <- large_dt[, .(mean = mean(value), sd = sd(value)), by = id]

})

```

在这个例子中,我们首先创建了一个大型的data.table,并对其进行了分组聚合计算。通过设置合适的线程数,我们可以观察到该操作的执行时间,从而评估并行处理对性能的影响。

## 4.3 实际案例分析与调优

### 复杂数据处理案例分析

在处理真实世界的数据时,经常会遇到需要将复杂逻辑应用到大规模数据集的情况。data.table因其高效性和灵活性,成为处理这类问题的理想选择。

以下是一个复杂数据处理案例,假设我们正在分析销售数据,需要从海量的交易记录中计算每个产品的销售总额,并为每个产品生成一个基于销售额排名的评级:

```r

# 假设我们有一个销售数据的data.table

sales_dt <- data.table(

product_id = sample(1:1000, 1e6, replace = TRUE),

amount = rnorm(1e6)

)

# 分组计算每个产品的销售总额,并添加排名

sales_dt[, .(total_sales = sum(amount)), by = product_id][

, rank := frank(-total_sales, ties.method = "first"), by = product_id]

```

在这个案例中,我们首先计算每个产品的总销售额,然后基于销售额计算排名。通过使用data.table的链式操作,我们能以极高的效率完成这个过程。

### 性能调优的策略和实践

在数据处理中,性能优化是一个持续的过程。data.table提供了多个层面的优化策略,包括但不限于:数据预处理、查询逻辑优化、内存使用优化等。

首先,数据预处理是提高性能的关键一步。在使用data.table之前,合理的数据类型选择和数据结构优化可以显著提升性能。例如,对于经常用于连接操作的键,最好保持其为整数类型。

其次,查询逻辑的优化也非常重要。例如,通过避免在data.table的子集操作中使用非必要的列,或者避免在聚合操作中使用不必要的分组。

最后,内存使用优化主要涉及到对data.table大小的控制。data.table提供了一些参数,如`options(datatable.print.nrows=Inf)`来控制打印输出的行数,以减少内存使用。

```r

# 一些优化设置的例子

options(datatable.print.nrows=10) # 打印时限制行数以减少内存使用

options(datatable.optimize = 2) # 开启更高级的优化模式

```

通过这些策略和实践,我们可以系统地优化data.table在复杂数据处理中的性能表现。

# 5. 与其他R包的协同使用

data.table是R语言中一个非常强大的包,主要用于处理大数据集。然而,在实际的数据处理过程中,我们往往需要与其他的R包协同使用,以实现更复杂的操作和提高处理效率。本章将介绍data.table与其他几个常用R包的集成使用方法。

## 5.1 与tidyverse的集成

tidyverse是一个非常流行的R包集合,它提供了一系列用于数据科学任务的工具。data.table与tidyverse中的dplyr包有部分功能重合,但它们在处理数据集时各有优劣。

### 5.1.1 tidyverse生态系统概述

tidyverse提供了一种一致的、基于管道操作符的数据处理流程,使得代码更易于理解和维护。它包含多个专门处理数据、可视化和建模的包,如ggplot2、dplyr、tidyr等。tidyverse的管道操作符(%>%)允许我们以一种流式的方式编写代码,这与data.table的链式操作有异曲同工之妙。

### 5.1.2 data.table与dplyr的比较与结合

data.table强调速度和内存效率,适合处理大规模数据集;而dplyr则更注重代码的可读性和易用性。在实际操作中,我们可以根据需要选择适合的工具。

#### 使用data.table在tidyverse中的方式

```r

# 首先加载必要的包

library(tidyverse)

library(data.table)

# 使用data.table数据结构并应用dplyr函数

iris_dt <- as.data.table(iris)

iris_dt %>%

filter(Species == "setosa") %>%

mutate(Petal.Length = Petal.Length * 2) %>%

select(-Species)

```

这段代码首先将iris数据集转换为data.table对象,然后使用dplyr的管道操作符进行筛选、变换和选择操作。

## 5.2 处理时间序列数据

时间序列数据具有时间依赖性,普通的data.table操作可能不足以满足时间序列分析的特殊需求。

### 5.2.1 时间序列数据的特性

时间序列数据通常具有周期性、趋势性和季节性等特征,我们需要考虑这些因素来进行有效的分析。

### 5.2.2 data.table在时间序列分析中的应用

data.table为处理时间序列数据提供了强大的支持。例如,我们可以利用data.table的快速分组功能来计算时间窗口内的统计量。

```r

# 创建一个简单的示例数据表

ts_data <- data.table(date = as.Date("2023-01-01") + 1:10, value = rnorm(10))

# 计算每月的平均值

ts_data[, .(Monthly_Mean = mean(value)), by = .(year = year(date), month = month(date))]

```

这个例子展示了如何使用data.table的分组功能按年月分组计算平均值,适用于时间序列数据的处理。

## 5.3 大数据处理框架的结合

随着数据量的增加,单一的data.table可能不足以处理所有情况,这时候可以结合其他大数据处理框架一起使用。

### 5.3.1 与bigmemory、ff等包的交互

bigmemory和ff等包允许在R中处理大于内存的数据集,它们可以与data.table很好地协同工作。

```r

# 加载bigmemory包

library(bigmemory)

# 创建一个big.matrix对象

x <- as.big.matrix(matrix(rnorm(1e8), ncol = 10))

# 将big.matrix对象转换为data.table对象

x_dt <- as.data.table(x)

# 执行一些操作

x_dt[, sum(V1)]

```

这段代码展示了如何将big.memory包创建的大矩阵对象转换为data.table对象,并进行简单的求和操作。

### 5.3.2 大数据处理的混合策略

在处理大数据集时,我们可能需要一个混合策略,将数据存储在bigmemory、ff等包创建的数据结构中,并使用data.table进行高效的数据处理。

通过这些集成使用,我们不仅可以扩展data.table的功能,还能在处理大规模数据集时保持高效率和灵活性。未来,随着R社区的不断进步,我们可以预见data.table与其他包的协同使用将越来越丰富和高效。

0

0