【算法效率提升】:掌握反向传播的优化策略与技术

发布时间: 2024-09-05 15:17:50 阅读量: 95 订阅数: 31

Bkprop:使用反向传播和动量算法进行模式识别

# 1. 反向传播算法简介

在深度学习的世界里,反向传播算法(Backpropagation)是训练神经网络不可或缺的核心技术。通过计算损失函数关于网络参数的梯度,反向传播能够指导网络沿着减小误差的方向不断调整其内部的权重和偏置。这种机制保证了模型可以逐步优化并逼近期望的输出结果。

反向传播算法的出现,极大地促进了深度学习技术在图像识别、语音处理、自然语言理解和各种预测任务中的应用。理解它的工作原理和优化方法,对于希望在人工智能领域深耕的IT专家来说,是一项必备技能。

接下来的章节中,我们将从基础理论出发,逐步深入了解反向传播的数学原理、应用实践和优化策略,最终通过案例研究,探讨如何将这些知识应用于实际问题解决中。本章将为你搭建一个坚实的理论基础,为后续内容的深入展开奠定基础。

# 2. 理论基础与数学模型

## 2.1 神经网络的基本概念

### 2.1.1 激活函数的作用与选择

神经网络中的激活函数负责引入非线性因素,是实现复杂函数映射的关键。没有非线性的激活函数,无论神经网络有多少层,最终只能表示线性模型。激活函数的选择对模型的训练效率和拟合能力有直接影响。

一些常见的激活函数包括:

- Sigmoid函数:将输入压缩到(0,1)区间内,但由于其在两端容易饱和,可能导致梯度消失问题,现在较少用于隐藏层。

- Tanh函数:与Sigmoid类似,但输出以0为中心,理论上比Sigmoid更适合做激活函数。

- ReLU函数(Rectified Linear Unit):取输入的正值,其余置0。因其简洁性及在实践中表现出来的高效性而被广泛使用。

选取激活函数需要根据具体问题和网络结构来确定,例如在深度网络中,ReLU或者其变种(Leaky ReLU、ELU等)往往能提供更好的收敛速度。

### 2.1.2 权重与偏置的初始化方法

权重和偏置的初始化是神经网络训练的初始步骤,其好坏直接影响到模型训练的效率和性能。不当的初始化方法可能会导致梯度消失或梯度爆炸,使得网络难以训练。

常用的权重初始化方法有:

- 随机初始化:权重从一个特定的分布(如正态分布或均匀分布)中随机采样。

- Xavier初始化:通过调整方差来使得激活值在前向传播时的方差保持不变,有助于缓解梯度消失问题。

- He初始化:是基于ReLU激活函数特性调整的权重初始化方法,它使得激活值在使用ReLU时方差保持一致。

在实践中,Xavier初始化和He初始化因能有效处理深度网络训练初期的梯度问题而被广泛使用。

## 2.2 反向传播的数学原理

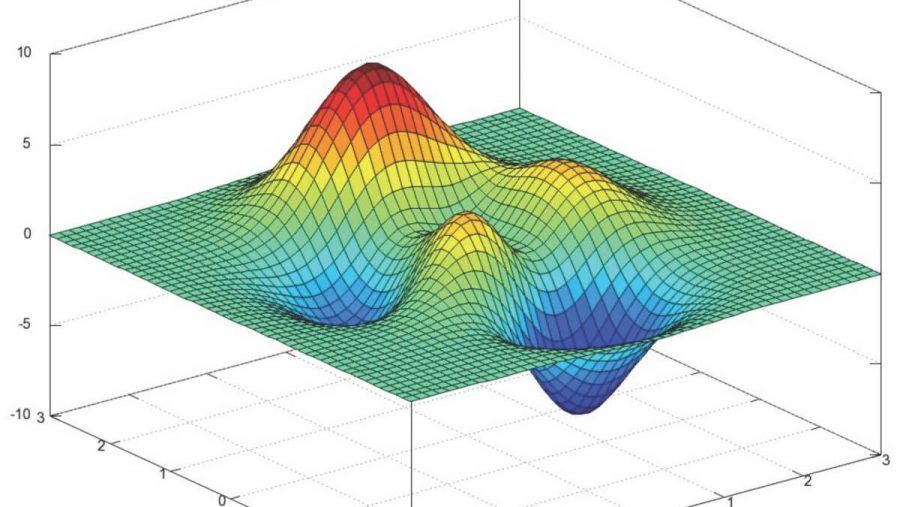

### 2.2.1 梯度下降法的原理

梯度下降法是一种优化算法,用于寻找损失函数的最小值。在神经网络训练中,目的是最小化网络预测值与真实值之间的差异,即损失函数。

梯度下降法通过迭代更新参数以下降的方式逐步接近最小损失。在每次迭代中,参数沿着损失函数梯度的反方向更新:

\[

w_{\text{new}} = w_{\text{old}} - \eta \frac{\partial L}{\partial w}

\]

其中,\( w \) 是网络参数,\( \eta \) 是学习率,\( L \) 是损失函数。

梯度下降法的变种包括批量梯度下降、随机梯度下降和小批量梯度下降等,它们在每次更新时使用的数据量不同。

### 2.2.2 损失函数的定义与优化目标

损失函数衡量的是模型预测值与实际值之间的差异。对于不同的问题,选择的损失函数也不同。在回归问题中通常使用均方误差(MSE)作为损失函数,而在分类问题中,常用的损失函数包括交叉熵损失。

交叉熵损失函数定义为:

\[

L(y, \hat{y}) = -\sum_{c=1}^{M} y_{c} \log(\hat{y}_{c})

\]

其中,\( y \) 是真实标签的独热编码,\( \hat{y} \) 是模型预测的概率分布。

优化目标通常是使得损失函数最小化,即找到一组参数,使得给定数据集上的损失函数值最小。在多层网络中,由于梯度下降是通过链式法则反向传播误差,因此可以求解出每一层参数的梯度,进而更新参数。

## 2.3 反向传播过程详解

### 2.3.1 前向传播与误差计算

前向传播是从输入层到输出层依次计算每个神经元的输出的过程。对于给定的输入数据,依次通过网络中每层的加权求和和激活函数计算,最终得到输出层的预测值。

误差计算是在前向传播完成后,根据损失函数计算预测值与真实值之间的误差。这个误差反映了当前模型对输入数据的预测准确度。

### 2.3.2 反向传播与权重更新

反向传播是在前向传播的基础上,从输出层向输入层逐层计算损失函数关于每个参数的梯度的过程。这个过程基于链式法则,可以计算出每个参数对最终损失的贡献度。

权重更新则是在计算出梯度之后,按照梯度下降法或其变体更新网络中的每个参数:

\[

w_{\text{new}} = w_{\text{old}} - \eta \frac{\partial L}{\partial w}

\]

其中,\( \eta \) 是学习率,\( L \) 是损失函数,\( \frac{\partial L}{\partial w} \) 是损失函数关于参数 \( w \) 的梯度。

这个过程不断迭代进行,直到模型收敛或达到预定的迭代次数。

接下来,我们将继续深入探讨优化策略的实践应用以及如何在实际中应用这些理论知识。

# 3. 优化策略的实践应用

## 3.1 常见的优化算法

### 3.1.1 SGD、Adam与RMSprop的对比

随机梯度下降(SGD)、自适应矩估计(Adam)和RMSprop是深度学习中最常用的优化算法。在实践中,它们各有优势和劣势,合理选择和使用它们对模型的收敛速度和最终性能有着至关重要的影响。

**SGD**是最基础的优化算法之一,它的基本思想是沿着随机梯度方向进行参数更新。尽管SGD简单易实现,但其收敛速度较慢且容易陷入局部最优解。SGD的参数更新公式如下:

```python

# 参数更新代码块,SGD方法

for i in range(max_iter):

gradients = compute_gradients(data, parameters)

parameters = parameters - learning_rate * gradients

```

其中,`compute_gradients`函数负责计算梯度,`learning_rate`是学习率。SGD在大规模数据集上可能表现不佳,因为它不考虑前一步的梯度信息。

**Adam**是SGD的一个扩展,它结合了动量(Momentum)和RMSprop的思想。Adam在参数更新时考虑了历史梯度的一阶矩估计(均值)和二阶矩估计(未中心化的方差),能够自动调整学习率。因此,它通常比SGD更有效,且对超参数的选择更鲁棒。

```python

# 参数更新代码块,Adam方法

for i in range(max_iter):

gradients, v, r = compute_adam_update(data, parameters, v, r)

parameters = parameters - learning_rate * v / (sqrt(r) + epsilon)

```

这里,`v`和`r`分别是梯度的一阶矩估计和二阶矩估计,`epsilon`是为了避免除以零而添加的很小的常数。

**RMSprop**是另一种适应性学习率优化算法,它通过调整学习率来解决SGD的缺点。RMSprop维护了一个梯度的移动平均的平方值,并通过这个值来调整学习率。

```python

# 参数更新代码块,RMSprop方法

for i in range(max_iter):

gradients, s = compute_rmsprop_update(data, parameters, s)

parameters = parameters - learning_rate * gradients / (sqrt(s) + epsilon)

```

其中,`s`是梯度平方的移动平均值。

### 3.1.2 动量法与自适应学习率的结合应用

动量法(Momentum)是一种优化技术,通过引入“动量”概念来加速SGD在相关方向上的进展,并抑制震荡。动量法通常和自适应学习率算法如Adam、RMSprop结合起来,进一步提升优化效果。

动量法在更新参数时会考虑上一次梯度的方向,这样做的好处是当梯度的方向在多次迭代中保持不变时,参数更新的步长会增大,从而加快收敛速度。

```python

# 参数更新代码块,结合动量法和自适应学习率算法

for i in range(max_iter):

gradients = compute_gradients(data, parameters)

v = momentum * v + (1 - momentum) * gradients # 动量计算

parameters = parameters - learning_rate * v / (sqrt(r) + epsilon) # 结合Adam或RMSprop

```

在这里,`momentum`是动量超参数,用于控制上一次梯度方向上的更新量所占的比重。结合动量法与自适应学习率的优化算法,如Adam和RMSprop,往往能够在保持快速收敛的同时,获得更稳定的训练过程和更好的模型性能。

## 3.2 正则化技术

### 3.2.1 L1与L2正则化的原理及效果

正则化是防止模型过拟合的重要技术手段。在神经网络中,L1和L2正则化通过在损失函数中添加一个额外的惩罚项来降低模型复杂度。

**L1正则

0

0