【R语言优化算法大比拼】:nlminb与其他函数的性能对决

发布时间: 2024-11-06 10:48:49 阅读量: 46 订阅数: 37

# 1. R语言优化算法概述

在数据分析和统计模型中,优化算法扮演着至关重要的角色。R语言作为一门专注于统计分析和图形表示的编程语言,提供了丰富的优化函数库,帮助开发者高效地解决各种最优化问题。从简单的参数估计到复杂的机器学习模型训练,优化算法都是其中不可或缺的一环。本章节将概述R语言中的优化算法,并探讨其在不同应用场景中的重要性与影响。我们将从基础概念出发,逐步深入到各种优化技术与应用场景,让读者能够全面了解R语言优化算法的强大功能和潜力。接下来的章节将对特定的优化函数,如`nlminb`,进行详细解析,并在实际案例中分析其性能与应用。

# 2. nlminb函数详解

在本章节中,我们将深入解析R语言中一个强大的优化函数:nlminb。首先探讨nlminb的基本原理和用法,随后深入到其内部机制,包括梯度下降法和BFGS算法,最后与R语言中的其他优化函数进行比较分析,以展示nlminb的独特优势和局限性。

## 2.1 nlminb的基本原理与用法

### 2.1.1 算法的数学背景

nlminb函数用于解决非线性最小化问题,其中目标函数可以是非线性的,且可能包含线性或非线性约束。此函数采用的是一种基于梯度的优化算法,它试图找到使得目标函数值最小化的参数向量。

非线性最小化问题的一般形式可以表示为:

\[

\text{minimize} \quad f(\mathbf{x})

\]

\[

\text{subject to} \quad \mathbf{g}(\mathbf{x}) \leq \mathbf{0}, \quad \mathbf{h}(\mathbf{x}) = \mathbf{0}

\]

其中,\(f(\mathbf{x})\) 是需要最小化的目标函数,\(\mathbf{g}(\mathbf{x})\) 是不等式约束向量,而 \(\mathbf{h}(\mathbf{x})\) 是等式约束向量。nlminb通过调整参数向量 \(\mathbf{x}\) 来寻找目标函数的最小值。

### 2.1.2 函数参数的解析

nlminb函数在R语言中的基本语法如下:

```R

nlminb(start, objective, gradient = NULL, hessian = NULL,

control = list(), hessianCtrl = list(), ...)

```

- `start` 是一个数值向量,表示优化问题的初始解。

- `objective` 是一个函数或函数名称,用于计算目标函数值。

- `gradient` 是一个函数或函数名称,用于计算目标函数的梯度(一阶导数)。

- `hessian` 是一个函数或函数名称,用于计算目标函数的海森矩阵(二阶导数矩阵)。

- `control` 是一个列表,包含控制优化过程的参数,例如容忍误差、最大迭代次数等。

- `hessianCtrl` 是一个列表,包含计算海森矩阵时的控制参数。

- `...` 允许向优化函数传递其他额外参数。

### 2.1.3 算法的限制与优化

nlminb函数在处理具有复杂约束或需要高精度解的问题时可能会有局限性。算法的收敛速度和稳定性高度依赖于初始参数的选择和梯度/海森矩阵的质量。如果初始值选择不当,算法可能会陷入局部最小值而非全局最小值。

为优化nlminb的性能,可以采取以下措施:

- 调整`control`参数中的容忍误差和最大迭代次数。

- 对目标函数、梯度和海森矩阵进行精确计算,避免数值错误。

- 采用适当的初始化技术,如使用`optim`函数的结果作为`nlminb`的起始点。

## 2.2 nlminb的内部机制

### 2.2.1 梯度下降法的原理

梯度下降法是一种通过迭代过程寻找函数最小值的方法。其基本思想是利用目标函数的梯度(导数)来确定搜索方向,即沿着梯度的反方向(即负梯度方向)进行参数更新,以此来逐步逼近函数的最小值。

算法的迭代公式如下:

\[

\mathbf{x}_{n+1} = \mathbf{x}_n - \alpha_n \nabla f(\mathbf{x}_n)

\]

其中,\(\mathbf{x}_{n+1}\) 是第 \(n+1\) 次迭代后的解,\(\alpha_n\) 是步长,\(\nabla f(\mathbf{x}_n)\) 是在 \(\mathbf{x}_n\) 处的梯度。

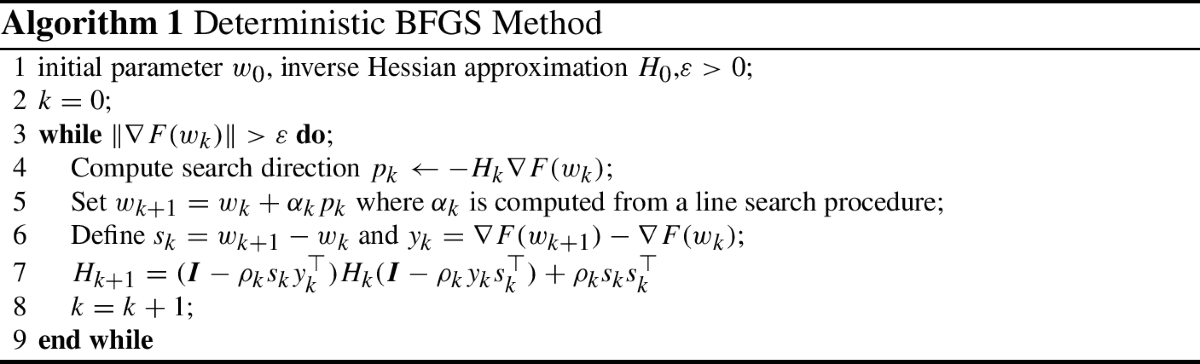

### 2.2.2 BFGS算法简介

Broyden-Fletcher-Goldfarb-Shanno (BFGS) 算法是一种在无约束优化问题中广泛使用的准牛顿法。它的基本思想是用迭代过程中近似的海森矩阵 \(B\) 来避免直接计算海森矩阵本身,从而减少计算量。

BFGS算法的每次迭代包括以下几个步骤:

- 计算目标函数的梯度 \(\nabla f(\mathbf{x})\)。

- 计算搜索方向 \(\mathbf{p} = -B^{-1} \nabla f(\mathbf{x})\)。

- 通过线搜索找到一个合适的步长 \(\alpha\),使得 \(f(\mathbf{x} + \alpha \mathbf{p})\) 达到最小。

- 更新参数向量 \(\mathbf{x}\) 和近似海森矩阵 \(B\)。

### 2.2.3 自适应步长的调整策略

在使用BFGS算法时,选择合适的步长是关键。自适应步长调整策略可以根据函数的局部特性来动态调整步长,以提高算法的稳定性和收敛速度。

R语言中的nlminb函数会根据内置的逻辑来自动调整步长,但用户也可以通过`control`参数来手动控制步长的选取。一个典型的自适应步长调整策略是回溯线搜索(backtracking line search),它会基于函数值的减少来调整步长。

## 2.3 nlminb与其他优化函数的比较

### 2.3.1 与optim函数的对比

`optim` 是R语言中最基本的优化函数,它提供了多种优化算法,如Nelder-Mead、Powell、CG、BFGS和L-BFGS-B等。与`optim`相比,`nlminb`在处理大规模问题时表现得更为高效,特别是在有约束条件的情况下。

### 2.3.2 与optimx函数的对比

`optimx` 是一个高级的优化函数,它封装了`optim`、`nlminb`以及其他多个优化函数。`optimx`提供了统一的接口来调用不同的优化算法,并能够比较它们的性能,从而选择最佳的算法。

### 2.3.3 与R其他包的优化函数对比

R语言中有许多其他包也提供了优化功能,如`bbmle`、`minqa`等。这些包中的优化函数通常是对`optim`或`nlminb`功能的补充,提供了额外的算法或更精细的控制选项。用户可以根据问题的特定需要选择最适合的函数。

## 2.4 本章节内容总结

通过本章节的探讨,我们已经对nlminb函数有了全面的认识,从基本原理、参数解析,到内部机制以及与其他优化函数的比较。nlminb作为一个强大的优化工具,在实际应用中能够有效解决复杂的优化问题,特别是在存在约束条件的情况下。然而,在选择和使用时,也需要注意其潜在的局限性,并适时采用其他优化函数或策略进行优化。在下一章节中,我们将深入到nlminb的性能实战,通过实际案例和性能测试来进一步展示其在解决实际问题时的强大能力。

# 3. nlminb性能实战

## 实际案例分析

### 3.1.1 线性回归模型的参数估计

在统计建模和数据分析中,线性回归模型是一种广泛使用的方法,用于描述变量之间的线性关系。在R语言中,使用nlminb进行线性回归参数估计提供了一个高效且灵活的解决方案。考虑一个简单的一元线性回归模型:

\[ y_i = \beta_0 + \beta_1 x_i + \epsilon_i \]

其中,\( y_i \) 是响应变量,\( x_i \) 是解释变量,\( \beta_0 \) 和 \( \beta_1 \) 是需要估计的参数,而 \( \epsilon_i \) 是误差项。

以下是一个使用nlminb函数进行线性回归参数估计的代码示例:

```R

# 定义线性模型函数

linear_model <- function(beta, x, y) {

y_pred <- beta[1] + beta[2] * x

residuals <- y - y_pred

return(sum(residuals^2))

}

# 给定数据集

x <- c(1, 2, 3, 4, 5)

y <- c(2, 4, 6, 8, 10)

# 初始参数猜测

beta_start <- c(0, 0)

# 优化nlminb

nlminb_result <- nlminb(start = beta_start, objective = linear_model, x = x, y = y)

# 输出结果

beta_estimates <- nlminb_result$par

print(beta_estimates)

```

在这个例子中,`linear_model` 函数计算了给定参数 \( \beta \) 下的残差平方和,这是我们要最小化的目标函数。`nlminb` 函数接受初始参数猜测,并通过迭代方法寻找最小化目标函数的参数值。

参数的解析和逻辑分析:

- `start` 参数指定了优化过程的起始点,对于线性回归,我们从零开始,这是一个合理的起点。

- `objective` 函数是目标函数,我们定义为残差平方和。

- `x` 和 `y` 分别是模型的解释变量和响应变量。

- `nlminb` 函数通过迭代优化过程找到最优参数 \( \beta \)。

### 3.1.2 非线性模型的拟合与优化

非线性模型在实践中同样重要,尤其是在描述复杂的自然和社会现象时。nlminb函数也能被用于非线性模型的参数估计,如逻辑回归或其他非线性关系模型。下面是一个逻辑回归的参数估计示例:

```R

# 定义逻辑回归模型函数

logistic_model <- function(beta, x) {

predicted_prob <- 1 / (1 + exp(- (beta[1] + beta[2] * x)))

return(-sum(log(predicted_prob) + (1 - y) * log(1 - predicted_prob)))

}

# 给定数据集,y为二元结果

x <- c(1, 2, 3, 4, 5)

y <- c(0, 0, 1, 1, 1)

# 初始参数猜测

beta_start <- c(0, 0)

# 优化nlminb

nlminb_result <- nlminb(start = beta_start, objective = logistic_model, x = x, y = y)

# 输出结果

beta_estimates <- nlminb_result$par

print(beta_estimates)

```

在这个例子中,`logistic_model` 函数计算了给定参数 \( \beta \) 下的负对数似然,这是我们希望最小化的目标函数。逻辑回归中使用了S形函数(sigmoid function),用于拟合二元结果变量。

参数的解析和逻辑分析:

- `predicted_prob` 是预测的概率,计算为 \( \frac{1}{1 + e^{-(\beta_0 + \beta_1 x)}} \)。

- 目标函数是负对数似然,需要最大化似然函数,但nlminb是最小化函数,因此我们需要最小化负对数似然。

- `y` 是二元结果变量,其中 `0` 和 `1` 代表不同类别的结果。

## 性能测试与结果评估

### 3.2.1 性能测试的方法论

性能测试是验证优化算法效率的关键手段,尤其是在面对大数据集或者计算资源有限时。为了评估nlminb的性能,需要制定一个全面的方法论,包括测试的数据准备、优化过程的监控和结果的分析。

在R中,性能测试通常涉及以下步骤:

1. 数据集的生成或选取,以模拟真实使用情况。

2. 选择合适的性能指标,如优化时间、收敛速度等。

3. 运行优化函数并记录性能指标。

4. 使用统计方

0

0