【nlminb深度解析】:解决R语言复杂优化问题的策略

发布时间: 2024-11-06 10:52:51 阅读量: 64 订阅数: 21

# 1. R语言优化问题概述

优化问题是数学中的一个核心领域,它涉及到寻找最优解以最大化或最小化特定目标函数的过程。在R语言中,优化问题的处理尤为重要,因为R作为一个强大的统计语言,经常被用于数据分析、模型拟合以及预测等领域,这些任务都可能涉及到复杂的优化过程。

R语言提供了一系列函数和包,专门用于解决各种类型的优化问题。其中nlminb函数是R中用于解决非线性最小化问题的一个重要工具。它利用了先进的数值优化技术,可以在给定一组约束条件下寻找函数的最小值。nlminb不仅可以处理单个目标函数,还可以适应于更复杂的多目标优化问题。

优化问题在R中的应用领域非常广泛,从统计模型的参数估计到经济学中的市场均衡分析,再到生物学中的种群动态模型,nlminb都能找到用武之地。本章将为读者概述R语言中优化问题的基本概念、重要性及其在实际应用中的潜力,为后续章节更深入的探讨nlminb函数的应用和优化策略打下基础。

# 2. nlminb函数的原理与应用

## 2.1 nlminb函数的数学基础

### 2.1.1 优化问题的数学模型

优化问题在数学中被广泛研究,是寻求在一组给定的约束条件下,使得某个目标函数取得极小值或极大值的过程。数学模型通常可以表示为:

\begin{align*}

& \min_{\mathbf{x}} f(\mathbf{x}) \\

& \text{subject to} \\

& g_i(\mathbf{x}) \leq 0, \quad i = 1, \dots, m \\

& h_j(\mathbf{x}) = 0, \quad j = 1, \dots, p

\end{align*}

其中,$f(\mathbf{x})$ 是我们要最小化的目标函数,$\mathbf{x}$ 是一个向量,代表决策变量,$g_i(\mathbf{x})$ 和 $h_j(\mathbf{x})$ 分别表示不等式约束和等式约束。

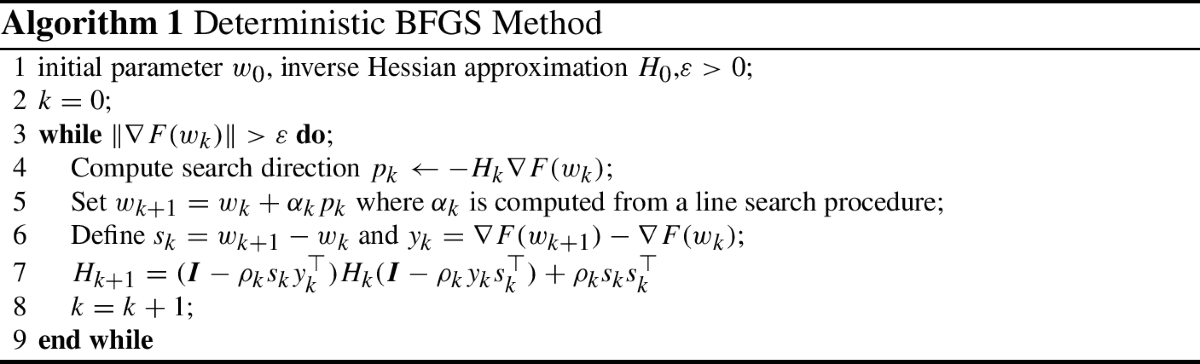

### 2.1.2 梯度下降与拟牛顿法

梯度下降是一种常用的优化算法,通过迭代逐步找到最小值。其基本思想是沿着函数梯度的反方向移动,直到达到极小值点。梯度下降的一个主要问题是容易陷入局部最小值,并且对于大规模问题收敛速度较慢。

拟牛顿法则是一种加速梯度下降的算法,它使用目标函数的梯度信息,通过迭代来近似Hessian矩阵(二阶导数矩阵),以更精确地逼近目标函数的最小值。拟牛顿法包括DFP法、BFGS法等多种变体,它们通过不同的方式来更新近似Hessian矩阵,以提高优化效率。

## 2.2 nlminb函数的使用方法

### 2.2.1 函数参数介绍

在R语言中,`nlminb` 是一个实现拟牛顿法的函数,其主要参数包括:

- `start`: 参数向量的初始值。

- `objective`: 定义目标函数的函数,接受参数向量并返回目标函数值。

- `gr`: 定义目标函数梯度的函数,可选参数,如果没有提供,函数会尝试通过数值方法进行估计。

- `control`: 列表,用于控制优化过程,如设定收敛条件、限制迭代次数等。

- `...`: 其他参数传递给目标函数和梯度函数。

### 2.2.2 实例演示:简单优化问题

下面是一个使用`nlminb`进行简单优化问题的示例:

```r

# 定义目标函数

objective <- function(x) {

return((x[1] - 1)^2 + (x[2] - 2)^2)

}

# 定义梯度函数

gr <- function(x) {

return(c(2*(x[1] - 1), 2*(x[2] - 2)))

}

# 使用nlminb进行优化

result <- nlminb(start=c(0,0), objective=objective, gr=gr)

print(result$par) # 打印优化后的参数值

print(result$fval) # 打印目标函数的最小值

```

### 2.3 nlminb在R中的典型应用

#### 2.3.1 统计模型参数估计

在统计模型中,参数估计通常涉及到最大化对数似然函数或者最小化负对数似然函数。`nlminb` 可以用来寻找使得模型对数似然函数达到最大化的参数值。例如,在多元回归分析中,我们可能会有一个带有多个参数的线性模型,通过最小化残差平方和来估计这些参数。

```r

# 假设数据

x <- matrix(rnorm(100), 10, 10)

y <- rnorm(10)

# 定义负对数似然函数作为优化的目标函数

neg_log_likelihood <- function(beta) {

fitted_y <- x %*% beta

sum((y - fitted_y)^2) # 均方误差

}

# 使用nlminb进行最小化

beta_est <- nlminb(start=rep(0, 10), objective=neg_log_likelihood)

print(beta_est$par) # 打印优化后的参数估计值

```

#### 2.3.2 经济模型的优化

经济模型,如投入产出分析、效用最大化问题,通常也会转化为数学上的优化问题。在R中使用`nlminb`,可以对这些经济模型进行求解。

```r

# 假设一个简单的效用最大化问题

utility_function <- function(x) {

return(-x[1] * x[2]) # 负号表示我们实际要最大化目标函数

}

# 限制条件

subject_to <- function(x) {

return(c(x[1] + x[2] - 10, # x1 + x2 = 10

-x[1] + x[2] - 2)) # -x1 + x2 = 2

}

# 使用nlminb进行优化

result <- nlminb(start=c(1,1), objective=utility_function, lower=c(0,2), upper=c(10,8), control=list(fnscale=-1))

print(result$par) # 打印优化后的参数值

print(result$fval) # 打印目标函数的最大值

```

通过上述示例,我们可以看到`nlminb`函数不仅适用于简单的数值优化问题,也能够处理统计模型和经济模型中的优化问题。这展示了`nlminb`在R中的强大应用潜力。

# 3. 复杂优化问题的理论基础

在实际应用中,复杂优化问题经常出现,这要求我们不仅仅掌握基础的优化理论,更要深入理解非线性优化问题、多目标优化问题以及混合整数非线性规划等高级主题。本章节将深入探讨这些复杂问题的理论基础,以助于读者更好地理解和应用nlminb函数解决实际问题。

## 3.1 非线性优化问题的特点

### 3.1.1 局部最优与全局最优

在非线性优化问题中,局部最优解是指在问题解空间的局部区域内,找不到比当前解更好的解。然而,全局最优解是指在整个解空间中,没有任何其他解比当前解更优。对于复杂优化问题,局部最优解和全局最优解之间存在显著差异。

局部最优问题的关键在于找到一种有效的方法跳出局部最优陷阱,避免优化算法停滞在次优解处。常见的技术包括随机重启、模拟退火、遗传算法等启发式搜索策略,这些策略可以提升算法逃离局部最优解的概率。

### 3.1.2 约束条件对优化的影响

约束条件是复杂优化问题的另一个关键特征,它能够极大地影响优化结果。约束可以是等式约束、不等式约束或者变量的边界限制。在存在约束的优化问题中,目标函数的最优值只能在满足所有约束条件的可行解集合中寻找。

处理约束条件通常有两种方法:第一种是将约束内嵌到目标函数中,通过惩罚或障碍法转化为无约束问题;第二种则是采用专门的约束优化算法,如序列二次规划(Sequential Quadratic Programming, SQP)或有效集法(Active Set Method)等。

## 3.2 多目标优化问题

### 3.2.1 Pareto效率与前沿

多目标优化问题涉及多个相互冲突的目标函数。Pareto效率是指在多目标优化问题中,不存在另一个可行解使得所有目标同时得到改善。一个解如果满足Pareto效率,则被称为Pareto最优解。

Pareto前沿是指所有Pareto最优解构成的解集合,在给定的多个目标之间进行权衡选择。Pareto前沿通常是一个曲面或曲线,表示在各个目标之间达到平衡的可能性。

### 3.2.2 多目标优化的求解策略

多目标优化问题的求解策略通常分为两类:一类是基于标量化方法,将多目标优化问题转化为单目标优化问题;另一类是基于Pareto前沿的方法,如遗传算法或模拟退火等启发式算法。

标量化方法通过定义一个或多个标量函数,将多目标问题简化为单目标问题。这种方法简单直观,但往往需要决策者提供关于目标之间相对重要性的信息。基于Pareto前沿的方法可以提供一组折中的解,决策者可以在事后根据具体情况进行选择,这种方式能更好地捕捉到多目标之间的权衡关系。

## 3.3 混合整数非线性规划

### 3.3.1 离散变量的处理方法

混合整数非线性规划(MINLP)问题是一种含有连续变量和离散变量的优化问题。处理离散变量的关键在于整数规划技术,例如分支定界法(Branch-and-Bound),能够确保找到全局最优解。

另一种常用的处理方法是使用松弛变量,将问题转化为非线性规划(NLP)问题。然而,这种方法可能导致解的质量下降,并且需要额外的逻辑约束来确保问题解的可行性。

### 3.3.2 求解混合整数非线性规划问题的算法

求解MINLP问题的算法可以分为精确算法和近似算法。精确算法如分支定界法和切割平面法(Cutting Plane Method),能够提供全局最优解,但计算成本往往较高。近似算法如启发式算法和元启发式算法(如遗传算法、蚁群算法),虽然计算速度快,但只能保证找到近似最优解。

在实际应用中,选择适当的算法需要平衡算法的求解质量和计算效率。对于大规模MINLP问题,近似算法通常是更加可行的选择,尤其是在解的质量与求解时间需要折中时。

在接下来的章节中,我们将

0

0