【Python线程通信全解】:threading库中队列与信号量的高级应用

发布时间: 2024-10-02 09:21:59 阅读量: 17 订阅数: 19

# 1. Python线程通信概述

随着多核处理器的普及,多线程编程成为提高程序性能的有效方式之一。Python由于其简洁的语法和强大的标准库支持,在多线程通信方面提供了丰富的工具和机制。本章将对Python中的线程通信进行概述,帮助读者建立起线程间协作与通信的基本概念。

线程通信是实现线程之间数据交换和状态同步的一种方法。在Python中,线程通信不仅包括数据的共享,还涉及到了解线程的同步问题。由于多线程在执行过程中会相互影响,因此必须谨慎处理好线程间的通信,以避免出现竞态条件或死锁等并发问题。

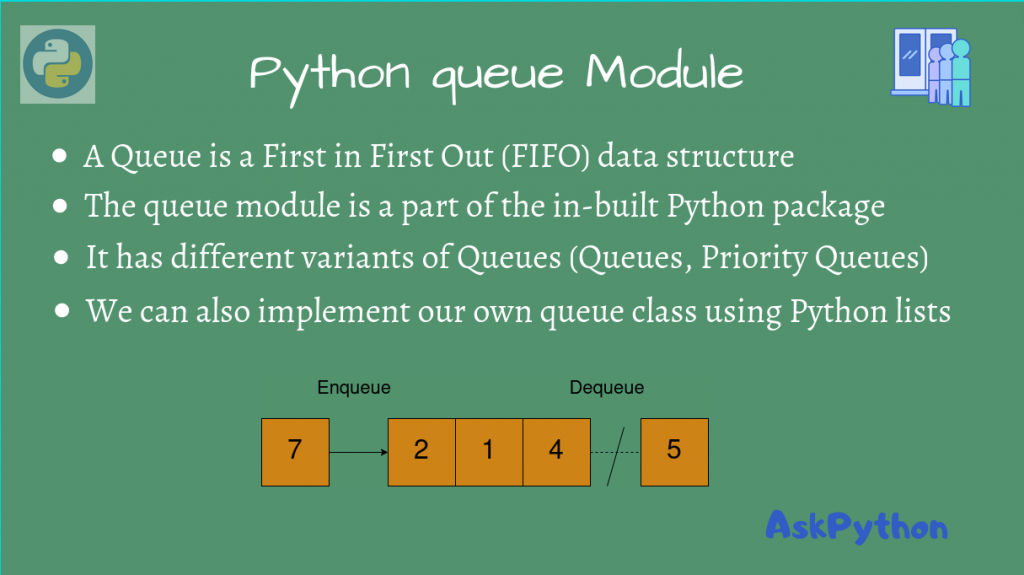

Python的`threading`模块提供了线程的基本实现和线程间同步的原语。除此之外,`queue`模块为线程安全的数据队列通信提供了支持。本文将从这些基础知识点出发,逐步深入探讨Python线程通信的实现机制,并给出实际应用案例。

# 2. 线程同步机制基础

## 2.1 线程间通信的需求和挑战

在多线程程序设计中,线程间通信(IPC)是保证程序正确运行和高效协作的关键。当多个线程需要共享资源和交换信息时,合理的通信机制可以避免竞态条件和数据不一致的问题。

线程间通信的需求主要源于以下几个方面:

- 共享资源访问控制:多个线程需要访问和修改共享资源,如何保证操作的原子性和一致性是通信需求之一。

- 协同工作:线程之间需要根据任务的进度来协作,一个线程完成任务后通知其他线程继续进行。

- 数据流控制:在生产者-消费者模型中,生产者线程生产数据,消费者线程消费数据,需要合理控制数据流的生产和消费速率。

线程间通信面临的挑战包括:

- 竞态条件:当多个线程访问共享资源时,如果没有适当的同步机制,可能会导致结果不可预测。

- 死锁:线程因为资源竞争而无限期地阻塞等待,导致程序僵死。

- 饥饿:某些线程因优先级较低或其他线程的频繁访问而长时间无法获取资源。

- 性能开销:同步机制可能会引入额外的执行开销,影响程序性能。

## 2.2 线程同步的基本概念

### 2.2.1 互斥锁(Mutex)

互斥锁是实现线程同步的一种简单机制,它提供了一种互斥访问共享资源的方式。任何时刻,只有一个线程可以持有互斥锁,其他线程试图获取已锁的互斥锁将会被阻塞,直到锁被释放。

互斥锁使用的关键点在于锁的获取和释放,通常采用`acquire()`方法来获取锁,使用`release()`方法释放锁。锁的获取和释放必须成对出现,以避免死锁的发生。

```python

import threading

lock = threading.Lock()

def thread_function(name):

lock.acquire()

try:

print(f"Thread {name}: Has lock")

# 模拟处理任务

finally:

print(f"Thread {name}: Releasing lock")

lock.release()

thread_1 = threading.Thread(target=thread_function, args=(1,))

thread_2 = threading.Thread(target=thread_function, args=(2,))

thread_1.start()

thread_2.start()

thread_1.join()

thread_2.join()

```

在上述代码中,我们创建了一个互斥锁`lock`,并定义了两个线程`thread_1`和`thread_2`。每个线程尝试获取锁并执行任务。由于互斥锁的特性,即使两个线程同时尝试获取锁,也只有拿到锁的线程会继续执行,另一个线程将等待,直到锁被释放。

### 2.2.2 条件变量(Condition Variable)

条件变量是一种线程同步机制,它允许一个或多个线程等待,直到它们被另一个线程通知。条件变量通常与锁一起使用,以确保在等待条件变量时共享资源的互斥访问。

使用条件变量时,线程首先需要获得一个与之关联的锁,然后等待条件变量。当线程处于等待状态时,它会释放锁,这样其他线程就可以修改共享资源并通知条件变量,唤醒等待的线程。

```python

import threading

condition = threading.Condition()

shared_resource = 0

def producer():

global shared_resource

with condition:

shared_resource += 1

print(f"Produced: {shared_resource}")

condition.notify()

def consumer():

global shared_resource

with condition:

while shared_resource == 0:

condition.wait()

print(f"Consumed: {shared_resource}")

producer_thread = threading.Thread(target=producer)

consumer_thread = threading.Thread(target=consumer)

producer_thread.start()

consumer_thread.start()

producer_thread.join()

consumer_thread.join()

```

在这个例子中,我们使用`Condition`对象来协调生产者和消费者的行为。生产者增加资源并通知条件变量,消费者等待条件变量,并在资源可用时消费资源。

## 2.3 线程间共享数据的问题

### 2.3.1 共享数据引发的竞态条件

当多个线程同时访问和修改共享数据时,如果多个线程的执行顺序会影响最终数据的结果,则称这种情况为竞态条件。

解决竞态条件的关键在于避免共享数据的无保护访问,可以使用互斥锁来强制线程以互斥方式访问共享资源,保证同一时刻只有一个线程可以修改数据。

### 2.3.2 使用锁来保护共享资源

保护共享资源最直接的方式是使用锁。当一个线程开始访问共享资源前,它需要获取锁。如果锁已经被其他线程获取,那么该线程将进入等待状态,直到锁被释放。

锁可以有效避免竞态条件,但需要合理设计,以避免死锁、饥饿等同步问题。设计时需要考虑以下几点:

- 锁的粒度:锁的粒度越细,线程并行度越高,但管理锁的成本也相应增加。

- 锁的顺序:当多个锁需要被不同线程获取时,应该有一个全局统一的获取顺序,以避免死锁。

- 锁的超时:在获取锁时设置超时机制,可以有效避免饥饿问题。

```python

import threading

lock = threading.Lock()

shared_resource = 0

def thread_function(name):

global shared_resource

for _ in range(10):

lock.acquire()

try:

shared_resource += 1

finally:

lock.release()

print(f"{name}: {shared_resource}")

thread_1 = threading.Thread(target=thread_function, args=("Thread-1",))

thread_2 = threading.Thread(target=thread_function, args=("Thread-2",))

thread_1.start()

thread_2.start()

thread_1.join()

thread_2.join()

```

在上述代码中,我们用互斥锁`lock`来保护`shared_resource`这个共享资源。通过这种方式,我们可以确保即使两个线程同时运行,共享资源的更新也是安全的,从而避免了竞态条件。

通过本章节的介绍,我们了解了线程同步机制的基础知识,包括互斥锁和条件变量的使用,以及共享数据的保护策略。这些概念是实现线程间有效通信和协作的基石,为下一章使用queue模块实现线程安全通信奠定了基础。

# 3. 使用queue模块实现线程安全通信

## 3.1 queue模块基本使用方法

### 3.1.1 创建队列实例

`queue`模块是Python标准库中的一个模块,它为线程间通信提供了一个线程安全的队列类,主要包括`Queue`, `LifoQueue`, `PriorityQueue`等。创建队列实例是实现线程安全通信的第一步。

以下是一个如何创建队列实例的例子:

```python

from queue import Queue

# 创建一个队列实例,maxsize是队列的最大容量

q = Queue(maxsize=0)

```

`Queue`的构造函数`__init__`定义了多个参数,`maxsize`是队列中可以存放的最大项数。如果`maxsize`小于或等于0,队列大小无限制。`qsize()`方法可以返回队列的大致大小。但是,不要依赖这个方法来获取准确的队列大小,因为当其他线程正在修改队列时,队列大小可能会在不停变化。

### 3.1.2 队列操作的基本原则

队列实例创建后,可以使用其提供的方法进行数据的存取。`put()`方法用于将数据项放入队列,而`get()`方法用于从队列中取出数据项。当队列满了时,`put()`方法会阻塞,直到有空间可用。相反,当队列为空时,`get()`方法会阻塞,直到有数据可用。

```python

# 往队列放入数据

q.put('data')

# 从队列取出数据

item = q.get()

```

此外,还可以使用`put_nowait()`和`get_nowait()`方法,这两个方法不会阻塞,如果操作不能立即执行,它们会抛出`Full`或`Empty`异常。

队列还提供了一系列用于监视和检查队列状态的方法,如`empty()`和`full()`。例如:

```python

# 检查队列是否为空

isEmpty = q.empty() # 返回布尔值

# 检查队列是否已满

isFull = q.full() # 返回布尔值

```

队列的使用原则是遵循生产者-消费者模型,生产者将任务放入队列,而消费者从队列取出任务并执行。这样可以有效地解耦生产者和消费者,使它们可以独立地工作。

## 3.2 队列在生产者-消费者模型中的应用

### 3.2.1 生产者线程的设计和实现

生产者线程通常负责生成数据并将其放入队列。它的基本任务是调用队列的`put()`方法将任务加入队列。为了实现这个功能,我们通常会将生产者封装在一个无限循环中,不断地产生新的任务并放入队列。

下面是一个简单的生产者线程实现示例:

```python

import threading

from queue import Queue

# 定义任务函数

def producer_task(q):

while True: # 生产者运行的无限循环

item = produce_data() # 假设此函数生成数据项

q.put(item) # 将数据放入队列

print(f"Produced: {item}")

# 创建队列实例

q = Queue()

# 创建生产者线程

producer = threading.Thread(target=producer_task, args=(q,))

# 启动生产者线程

producer.start()

```

在这个示例中,`produce_data`是一个假设的函数,它的任务是生成数据项并返回。生产者线程每次循环都会调用这个函数,并将结果放入队列。

### 3.2.2 消费者线程的设计和实现

消费者线程从队列中取出数据项并处理。它的核心功能是使用队列的`get()`方法从队列中取出数据,并执行相应的操作。

下面是一个简单的消费者线程实现示例:

```python

import threading

from queue import Queue

# 定义处理任务的函数

def consumer_task(q):

while True:

```

0

0