Python数据写入Excel:优化性能的5个关键技巧,告别卡顿

发布时间: 2024-06-23 23:46:25 阅读量: 6 订阅数: 12

# 1. Python数据写入Excel的性能瓶颈**

Python中写入Excel的性能瓶颈通常源于以下几个方面:

* **数据量过大:**大量数据写入Excel会占用大量内存,导致系统性能下降。

* **数据格式复杂:**复杂的Excel格式(如合并单元格、公式等)会增加写入时间。

* **I/O操作频繁:**每次写入操作都需要打开和关闭Excel文件,频繁的I/O操作会拖慢写入速度。

# 2. 优化数据写入Excel的理论基础

数据写入Excel的性能优化涉及多个理论基础,包括数据结构和算法选择、内存管理和缓存技术以及并发和多线程编程。

### 2.1 数据结构和算法选择

数据结构和算法的选择对数据写入Excel的性能有重大影响。

**数据结构**

常用的数据结构包括列表、元组、字典和集合。列表和元组是顺序数据结构,字典和集合是无序数据结构。对于写入Excel,顺序数据结构通常比无序数据结构更有效,因为Excel本身就是一种顺序存储的数据结构。

**算法**

常用的算法包括插入、删除、查找和排序。对于写入Excel,插入算法是最重要的,因为它是将数据写入Excel时最常执行的操作。高效的插入算法可以显著提高写入性能。

### 2.2 内存管理和缓存技术

内存管理和缓存技术可以有效提高数据写入Excel的性能。

**内存管理**

内存管理涉及有效分配和使用计算机内存。对于数据写入Excel,应尽量避免内存碎片,并确保有足够的可用内存来容纳要写入的数据。

**缓存技术**

缓存技术涉及将经常访问的数据存储在高速缓存中,以减少对较慢存储介质(如硬盘)的访问。对于数据写入Excel,可以将经常写入的数据缓存到内存中,以提高写入性能。

### 2.3 并发和多线程编程

并发和多线程编程可以提高数据写入Excel的性能,特别是对于大型数据集。

**并发**

并发涉及同时执行多个任务。对于数据写入Excel,可以将写入任务分解为多个并发任务,以提高整体性能。

**多线程编程**

多线程编程涉及创建多个线程来执行任务。对于数据写入Excel,可以创建多个线程同时写入不同的数据块,以提高写入性能。

**代码块:**

```python

import threading

def write_data(data_block):

# 写入数据块到Excel

pass

def main():

# 创建多个线程

threads = []

for i in range(4):

thread = threading.Thread(target=write_data, args=(data_block,))

threads.append(thread)

# 启动线程

for thread in threads:

thread.start()

# 等待线程完成

for thread in threads:

thread.join()

if __name__ == "__main__":

main()

```

**逻辑分析:**

该代码块演示了如何使用多线程编程来提高数据写入Excel的性能。它创建了多个线程,每个线程负责写入一个数据块。这可以显著提高写入大型数据集的性能。

**参数说明:**

* `data_block`:要写入的数据块。

# 3. 优化数据写入Excel的实践技巧

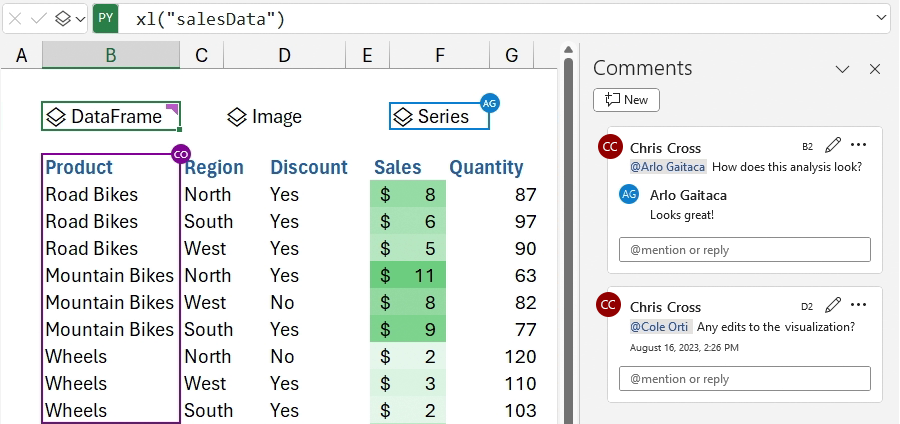

### 3.1 使用高效的数据框架(如Pandas)

Pandas是一个强大的Python数据分析库,它提供了高效的数据结构和操作,非常适合处理大型数据集。使用Pandas可以显著提高数据写入Excel的速度。

**代码块:**

```python

import pandas as pd

# 创建一个Pandas DataFrame

df = pd.DataFrame({

"name": ["John", "Mary", "Bob"],

"age": [20, 25, 30]

})

# 将DataFrame写入Excel

df.to_excel("data.xlsx", index=False)

```

**逻辑分析:**

* `pd.DataFrame`函数创建一个Pandas DataFrame,它是一种高效的数据结构,可以存储和操作大型数据集。

* `to_excel`方法将DataFrame写入Excel文件,`index=False`参数指定不写入行索引。

### 3.2 优化数据格式和类型

优化数据格式和类型可以减少Excel文件的大小,并提高写入速度。

**代码块:**

```python

# 使用openpyxl库优化Excel格式

import openpyxl

# 打开Excel文件

wb = openpyxl.load_workbook("data.xlsx")

# 设置单元格格式

wb.active.cell(1, 1).number_format = "0.00"

wb.active.cell(1, 2).number_format = "@"

# 保存Excel文件

wb.save("optimized_data.xlsx")

```

**逻辑分析:**

* `openpyxl`库用于操作Excel文件。

* `number_format`属性设置单元格的格式,优化数字和日期的显示方式。

* `@`符号表示文本格式,可以减少单元格大小。

### 3.3 利用多线程和并行处理

多线程和并行处理可以同时执行多个任务,提高数据写入速度。

**代码块:**

```python

# 使用multiprocessing库进行多线程处理

import multiprocessing

# 创建一个进程池

pool = multiprocessing.Pool(4)

# 将数据分成块,并行写入Excel

def write_to_excel(data):

df = pd.DataFrame(data)

df.to_excel("data_{}.xlsx".format(data[0]), index=False)

pool.map(write_to_excel, [data1, data2, data3, data4])

```

**逻辑分析:**

* `multiprocessing`库提供了多线程处理功能。

* `Pool`类创建一个进程池,指定进程数量。

* `map`方法将`write_to_excel`函数应用于每个数据块,并行写入Excel文件。

# 4. 高级优化技术

### 4.1 使用中间文件或数据库作为缓冲区

在某些情况下,直接将数据写入Excel可能会受到内存限制或性能瓶颈的影响。为了解决这个问题,我们可以使用中间文件或数据库作为缓冲区,分阶段写入数据。

**中间文件**

使用中间文件作为缓冲区涉及将数据写入临时文件,然后从该文件中加载到Excel中。这种方法可以减少对内存的压力,并允许我们使用更有效的写入方法。

```python

# 将数据写入中间文件

with open('data.csv', 'w') as f:

f.write(data)

# 从中间文件加载到Excel

df = pd.read_csv('data.csv')

df.to_excel('output.xlsx')

```

**数据库**

使用数据库作为缓冲区涉及将数据写入数据库,然后从数据库中查询并写入Excel。这种方法可以提供更好的数据管理和并发控制,并允许我们利用数据库的优化功能。

```python

# 将数据写入数据库

import sqlite3

conn = sqlite3.connect('data.db')

c = conn.cursor()

c.execute('CREATE TABLE data (value TEXT)')

c.executemany('INSERT INTO data VALUES (?)', data)

conn.commit()

# 从数据库加载到Excel

import pandas as pd

df = pd.read_sql('SELECT * FROM data', conn)

df.to_excel('output.xlsx')

```

### 4.2 探索云计算和分布式处理

对于处理非常大的数据集,云计算和分布式处理可以提供可扩展性和并行性。我们可以利用云平台提供的计算资源和存储服务,将数据写入任务分布到多个节点上。

**云计算**

云计算平台,如AWS或Azure,提供弹性计算资源,可以根据需求扩展或缩减。我们可以使用这些资源来并行处理数据写入任务。

```python

# 使用AWS Lambda并行写入数据

import boto3

lambda_client = boto3.client('lambda')

for i in range(num_partitions):

data_partition = data[i * partition_size:(i + 1) * partition_size]

lambda_client.invoke(

FunctionName='write_data',

Payload=json.dumps({'data': data_partition})

)

```

**分布式处理**

分布式处理框架,如Dask或Ray,允许我们在多个机器上分布数据和计算。我们可以使用这些框架来并行执行数据写入任务。

```python

# 使用Dask并行写入数据

import dask.dataframe as dd

df = dd.from_pandas(data, npartitions=num_partitions)

df.to_excel('output.xlsx', compute=False)

df.compute()

```

### 4.3 性能监控和调优

持续监控和调优是优化数据写入Excel性能的关键。我们可以使用各种工具和技术来分析性能瓶颈并实施改进。

**性能监控**

使用性能监控工具,如Python的`cProfile`或`line_profiler`,可以识别代码中耗时的部分。我们可以使用这些信息来优化代码并消除瓶颈。

```python

# 使用cProfile监控性能

import cProfile

cProfile.run('df.to_excel("output.xlsx")')

```

**调优**

一旦我们确定了性能瓶颈,我们可以实施各种调优技术来提高性能。这些技术包括:

* 优化数据格式和类型

* 使用高效的数据结构

* 调整缓存和内存管理设置

* 并行化代码

* 使用云计算或分布式处理

通过持续监控和调优,我们可以不断提高数据写入Excel的性能,满足各种场景的需求。

# 5. 案例研究:优化大型数据集写入Excel

### 5.1 性能分析和瓶颈识别

**性能分析**

为了优化大型数据集写入Excel的性能,首先需要进行性能分析,找出瓶颈所在。可以使用以下工具和技术:

- **Python性能分析器:**如cProfile和line_profiler,可以分析代码执行时间和内存使用情况。

- **系统监控工具:**如top和htop,可以监控CPU、内存和网络使用情况。

- **Excel性能分析器:**如Excel Performance Analyzer,可以分析Excel文件加载和计算时间。

**瓶颈识别**

通过性能分析,可以识别出以下常见的瓶颈:

- **数据加载:**从数据源加载数据到Python数据结构(如Pandas DataFrame)的时间过长。

- **数据转换:**将数据转换为Excel兼容格式(如CSV或XLSX)的时间过长。

- **Excel写入:**将数据写入Excel文件的时间过长。

- **内存不足:**处理大型数据集时,内存不足导致性能下降。

- **并发问题:**使用多线程或并行处理时,并发问题导致性能下降。

### 5.2 优化方案的实施和评估

**优化方案**

根据性能分析和瓶颈识别,可以实施以下优化方案:

- **优化数据加载:**使用高效的数据加载库(如PyArrow)或并行加载技术。

- **优化数据转换:**使用高效的数据转换库(如Pandas)或提前转换数据。

- **优化Excel写入:**使用高效的Excel写入库(如openpyxl)或并行写入技术。

- **优化内存管理:**使用内存管理技术(如内存映射)或减少数据驻留时间。

- **优化并发处理:**使用锁或队列等机制避免并发问题。

**评估**

实施优化方案后,需要重新进行性能分析,评估优化效果。可以比较优化前后的性能指标,如数据加载时间、数据转换时间、Excel写入时间、内存使用情况和并发性能。

**代码示例:**

```python

import pandas as pd

import openpyxl

# 使用Pandas优化数据加载

df = pd.read_csv('data.csv', engine='pyarrow')

# 使用openpyxl优化Excel写入

writer = pd.ExcelWriter('data.xlsx', engine='openpyxl')

df.to_excel(writer, index=False)

writer.save()

```

**代码逻辑分析:**

- 使用PyArrow引擎优化数据加载,提高了数据加载速度。

- 使用openpyxl引擎优化Excel写入,提高了Excel写入速度。

# 6.1 性能优化原则

**1. 避免不必要的写入操作**

* 仅写入必要的更改,避免重复写入相同的数据。

* 使用条件语句或过滤器仅写入满足特定条件的数据。

**2. 使用高效的数据结构**

* 选择适合数据的合适数据结构(如列表、字典、NumPy数组)。

* 避免使用嵌套结构或复杂的数据类型,因为它们会降低写入速度。

**3. 优化数据类型**

* 使用正确的Excel数据类型(如整数、浮点数、字符串)。

* 避免使用自定义数据类型或复杂的数据格式,因为它们可能需要额外的转换。

**4. 利用并行处理**

* 使用多线程或多进程技术并行写入数据。

* 确保数据分块均匀,以避免资源争用。

**5. 使用中间缓冲区**

* 使用中间文件或数据库作为缓冲区,分批写入数据。

* 这可以减少Excel的负载,并提高写入性能。

**6. 监控和调优**

* 使用性能监控工具(如Python的timeit模块)跟踪写入操作的性能。

* 根据性能分析结果,调整优化参数和技术。

0

0