【HDFS数据一致性难题】:分析、解决方案与最佳实践

发布时间: 2024-10-29 11:44:50 阅读量: 33 订阅数: 41

基于云计算的大数据挖掘内涵及解决方案研究.docx

# 1. HDFS数据一致性概念解析

## 1.1 数据一致性的定义

数据一致性是分布式系统中的核心概念之一,它保证了在多个节点之间共享和复制数据时,所有节点上的数据副本能够及时更新并且保持一致。对于Hadoop分布式文件系统(HDFS)而言,数据一致性尤为重要,因为它支撑着海量数据存储与处理的基础。

## 1.2 HDFS与数据一致性

在HDFS中,数据一致性不仅仅是技术实现的问题,它还关系到整个大数据生态系统的稳定性和可靠性。考虑到HDFS广泛应用于数据分析、机器学习、云计算等多个领域,数据一致性更是成为了评价其服务质量的关键指标。

## 1.3 数据一致性的重要性

确保数据一致性对于实现数据的正确读取、避免数据丢失或损坏至关重要。在HDFS中,数据一致性问题可能由硬件故障、网络问题、软件缺陷等多种因素引发。了解数据一致性在HDFS中的具体表现及其背后的原因,是优化系统性能和进行故障处理的基础。

# 2. HDFS数据一致性的理论基础

### 2.1 HDFS架构与数据复制机制

#### 2.1.1 HDFS的基本架构介绍

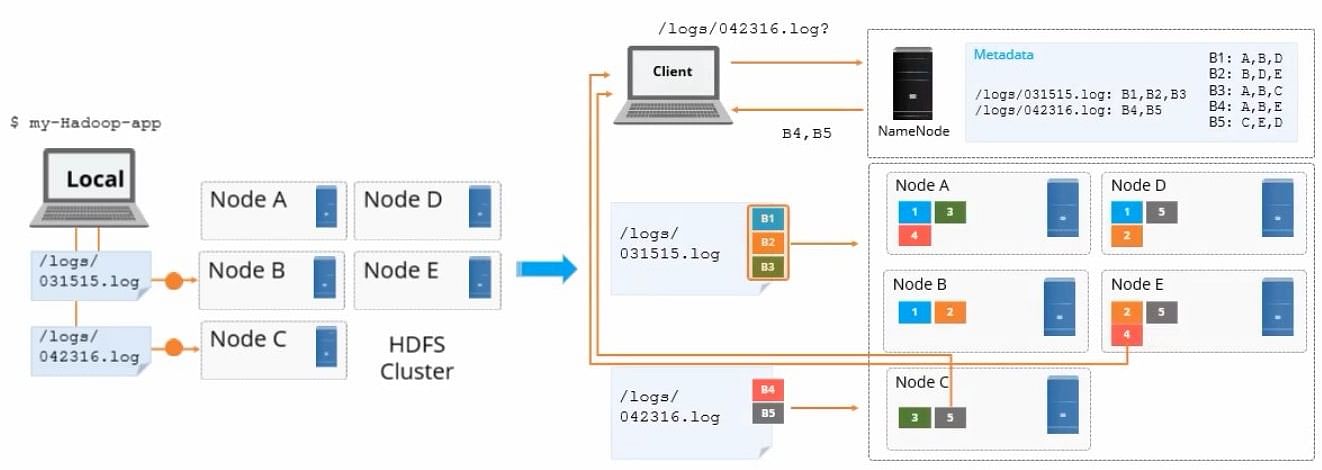

HDFS(Hadoop Distributed File System)是一个设计用来在普通硬件上运行的分布式文件系统,它具有高容错性的特点。HDFS的设计灵感主要来源于Google的GFS论文。它由一个NameNode(主节点)和多个DataNode(数据节点)组成。NameNode负责管理文件系统的命名空间和客户端对文件的访问,而DataNode则负责存储实际的数据。

- **NameNode**:NameNode是HDFS的主节点,它保存着文件系统的元数据,包括文件系统的目录结构、文件属性以及每个文件的块列表和块的位置信息。NameNode不存储实际的数据,仅存储文件系统的元数据,使得它成为系统中的单点故障点。

- **DataNode**:DataNode是存储数据的实际节点,它们分布在不同的机器上。每个文件被切分成一个或多个块,这些块被分配存储在不同的DataNode上。DataNode负责处理文件系统客户端的读写请求,并执行创建、删除和复制块的操作。

HDFS的这种架构设计允许它在处理大文件时表现出良好的性能,因为它通过并行操作分散的DataNode来读写数据块。然而,这种设计也导致了一些潜在的数据一致性问题。

#### 2.1.2 数据复制机制的工作原理

数据复制是HDFS保持数据可靠性和高可用性的关键机制。HDFS通过在多个DataNode上存储数据副本来防止数据丢失。默认情况下,HDFS为每个数据块保持三个副本(一个主副本和两个备副本),这些副本被分配在不同的物理机上以降低单点故障的风险。

- **数据块的自动复制**:当客户端向HDFS写入数据时,NameNode会为这些数据块分配DataNode,并将数据块复制到多个节点上。客户端与DataNode直接通信,将数据块推送到DataNode。

- **副本的选择与管理**:副本的放置策略是HDFS设计的关键部分,它考虑到了机架感知(rack-awareness)来尽量将数据副本分散到不同的机架上,以防止单一机架故障导致数据丢失。

- **数据复制的同步**:数据副本的同步不是实时发生的。HDFS采用了异步复制策略,这意味着写操作首先在主副本上完成,然后异步地将数据块复制到其他副本。这个过程可能会导致数据读取操作在某些时间点上读到过时的数据,这是HDFS一致性模型中的一个折衷。

### 2.2 HDFS数据一致性的理论模型

#### 2.2.1 一致性模型的定义与分类

一致性模型定义了系统如何在不同的操作之间保持数据的稳定性。在分布式系统中,一致性模型是非常重要的概念,它描述了多个进程观察到的数据值在发生更新操作时的行为。

- **强一致性**:每次操作后,所有进程看到的数据都是一致的。系统保证在执行任何更新操作后,对数据的任何后续访问都会返回该更新的结果。

- **弱一致性**:系统并不保证立即看到更新结果,但会在某个时间窗口后,保证最终所有的进程都会看到一致的数据。

- **因果一致性**:保证有因果关系的事件在任何进程中都是以相同的顺序被观察到的,而无因果关系的操作则没有顺序的保证。

HDFS作为一个分布式文件系统,其数据一致性模型通常更接近于弱一致性模型,这是因为它要权衡系统的可伸缩性和性能。

#### 2.2.2 HDFS中的数据一致性理论模型

HDFS的数据一致性模型基于其对客户端操作的响应和数据复制策略。HDFS保证:

- 在一个特定的DataNode上,数据块的副本是一致的。

- 在NameNode上,文件的元数据是一致的。

- 对于客户端的读操作,如果数据在读取之前已经由写操作更新,那么读操作最终会看到最新的数据。

尽管HDFS提供了数据一致性的保证,但它并不保证严格的一致性,尤其是在网络分区或者节点故障的情况下。HDFS侧重于可用性和容错性,而将一致性作为可配置的选项,以满足不同场景下的需求。

### 2.3 HDFS数据一致性问题的原因分析

#### 2.3.1 硬件故障与网络分区的影响

在分布式系统中,硬件故障和网络分区是引起数据一致性问题的常见因素。

- **硬件故障**:HDFS中的DataNode可能会因硬件故障突然宕机,导致存储在其上的数据块副本丢失。这种情况下,NameNode会检测到副本的丢失,并启动复制流程来恢复副本数量,但这个恢复过程并非瞬时完成,因此在这期间,系统上可能暂时出现数据一致性的问题。

- **网络分区**:网络分区(网络分裂)会导致集群被隔离成几个不连通的小网络,这可能会导致数据块副本之间的同步出现问题。一旦网络分区被修复,NameNode需要重新平衡数据块副本,以确保系统的一致性。

#### 2.3.2 软件缺陷与配置失误的问题探讨

软件缺陷,比如bug,可能会导致数据一致性的问题,尤其是在复杂的分布式环境下。

- **软件bug**:在Hadoop集群中运行的数据处理任务或者NameNode自身可能由于代码错误而产生不一致的数据状态。

- **配置失误**:不恰当的配置,比如副本数量的设置不当,数据压缩策略的误配置,都可能影响数据一致性。

另外,由于HDFS的更新操作并不是原子性的,数据块在复制过程中可能会出现不一致的状态。例如,数据块的写入可能只完成在部分副本上,此时如果发生故障,将会导致数据不一致。

总体来说,HDFS设计者必须在高可用性、高可靠性和数据一致性之间进行权衡。理解这些因素对于操作和优化HDFS集群至关重要。

# 3. HDFS数据一致性解决方案

## 3.1 HDFS数据恢复策略

在分布式文件系统中,数据的完整性和一致性是最基本的需求。为实现数据的恢复,HDFS提供了多种策略来处理可能出现的错误和数据损坏。

### 3.1.1 自动数据恢复机制

HDFS具备的自动数据恢复机制是其能够自我修复的重要特性。当系统检测到副本数量不足或块损坏时,会自动启动数据恢复过程,主要包括以下步骤:

1. **副本不足检测**:HDFS NameNode监控数据块的副本数量,一旦发现副本数量低于设定的最小阈值,就会启动数据复制过程。

2. **数据块修复**:如果副本丢失或者损坏,系统会自动从其他节点上复制数据块,直到达到预定的副本数。

3. **心跳机制**:DataNode定时向NameNode发送心跳信号,以便NameNode能够识别和处理失效的DataNode节点

0

0