HDFS数据校验跨版本解决方案:保障数据一致性与安全性

发布时间: 2024-10-29 19:41:33 阅读量: 20 订阅数: 19

# 1. HDFS数据校验的概念与重要性

## 1.1 HDFS数据校验的基本概念

Hadoop分布式文件系统(HDFS)作为大数据存储的重要组件,其数据完整性是保障大数据处理稳定性和可靠性的关键。数据校验是对存储在HDFS上的数据块进行的完整性验证,确保数据没有损坏或丢失,是维护大规模分布式存储系统稳定运行的必要手段。

## 1.2 数据校验的重要性

数据是整个大数据生态系统的基石。校验机制能够确保数据的完整性和一致性,在数据的复制、存储和访问过程中,防止由于硬件故障、网络问题、软件bug等原因导致的数据损坏。通过定期的校验操作,可以及时发现并修复这些问题,最大限度地保证数据的可靠性。

## 1.3 与数据完整性其他措施的关联

数据校验是数据完整性保障体系中的一部分,与HDFS提供的其他数据保护机制(如数据块的副本机制)共同工作。校验机制可以辅助副本管理,比如,在自动故障转移和负载均衡过程中,校验可以用来检测数据副本的质量,确保数据的高可用性。此外,良好的数据校验策略能够帮助系统管理员及时发现并处理潜在问题,从而保障整体数据环境的健康和安全。

# 2. HDFS数据校验的理论基础

Hadoop分布式文件系统(HDFS)作为大数据生态系统的核心组件,其数据的完整性和可靠性是确保数据处理和分析准确性的重要基础。在深入技术实践之前,掌握HDFS数据校验的理论基础是至关重要的。本章将详细解读HDFS架构原理、数据校验的必要性以及校验策略的比较分析。

## 2.1 HDFS架构原理

### 2.1.1 HDFS的基本组成

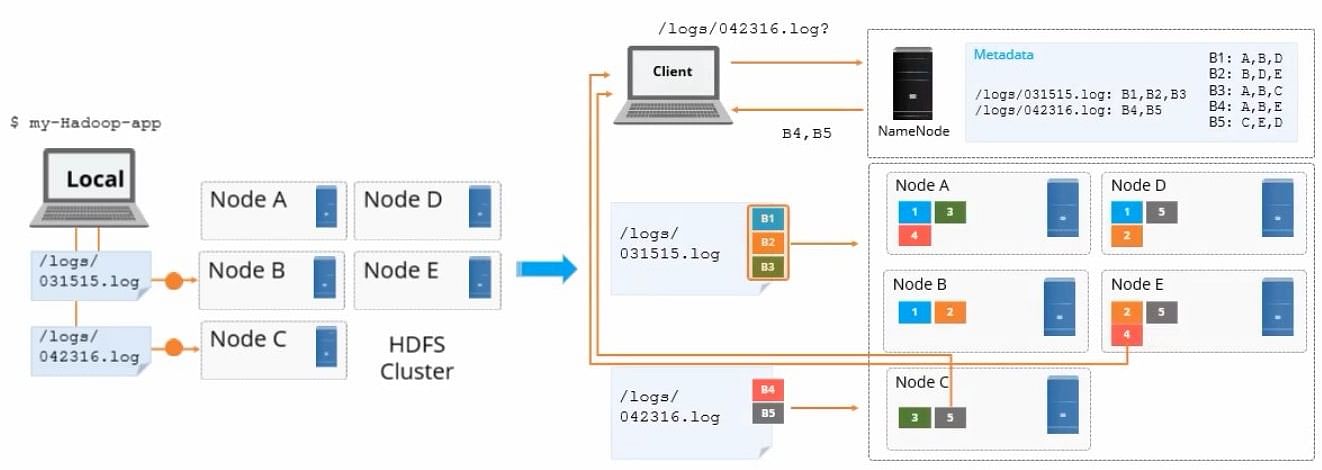

HDFS是Google文件系统(GFS)的开源实现,旨在部署在廉价硬件上提供高吞吐量的数据访问。HDFS的基本组成包括:

- **NameNode:** 负责管理文件系统的命名空间,维护文件系统树及整个树内所有文件和目录的元数据。NameNode是HDFS的关键组成部分,它记录了每个文件中各个块所在的DataNode节点。

- **DataNode:** 在HDFS集群中,DataNode负责存储实际数据。文件被切分成一系列的块,每个块由不同的DataNode存储。DataNode通常运行在集群中的各个服务器上。

### 2.1.2 数据块与副本机制

为了提高系统的容错性和可靠性,HDFS引入了数据块(Block)和副本(Replication)机制:

- **数据块:** 在HDFS中,文件被切分成大小固定的块,默认大小为128MB(Hadoop 2.x版本)或256MB(Hadoop 3.x版本)。这种块的分割允许大文件存储在多个DataNode上,从而实现负载均衡和数据冗余。

- **副本机制:** HDFS通过维护多个副本确保数据的高可用性。默认情况下,每个块有三个副本,分别存储在不同的DataNode上。副本的数量可以通过配置进行调整。

## 2.2 数据校验的必要性

### 2.2.1 保证数据一致性

在分布式系统中,由于硬件故障、网络问题或软件缺陷等多方面因素,数据可能会遭受损坏或丢失。数据校验的目的在于确保数据的一致性:

- **数据损坏检测:** 通过数据校验可以及时发现数据损坏,并采取措施进行修复或替换。

- **数据恢复:** 校验机制可以辅助系统在发生故障后,通过有效副本进行数据恢复,确保数据的完整性和可用性。

### 2.2.2 维护数据安全性

数据安全性是企业级应用中的核心要求,数据校验有助于维护数据的安全性:

- **防篡改:** 校验过程可以检测出非法篡改的数据块,保护数据不被恶意修改。

- **完整性检查:** 定期的校验可以验证数据存储的完整性,对于敏感数据尤为重要。

## 2.3 校验策略的比较分析

### 2.3.1 不同校验方法对比

在数据存储系统中,校验策略的选择对于系统的性能和可靠性有重要影响。常见的校验方法有:

- **校验和(Checksum):** 最常用的方法之一,通过计算数据块的校验和来验证数据的完整性。

- **哈希函数:** 对数据块进行哈希计算,生成固定长度的摘要值。任何数据块的微小变化都会导致摘要值显著不同。

- **数据签名:** 引入加密技术,对数据块进行签名,确保数据的不可否认性和完整性。

### 2.3.2 校验策略与应用场景

选择校验策略时需要考虑实际的应用场景:

- **读写频率:** 对于读写操作频繁的系统,选择高效的校验策略能够减少性能损耗。

- **数据敏感度:** 对于敏感数据,可能需要更为复杂的安全校验方法,如数据签名。

- **系统性能:** 系统的性能要求也是校验策略选择的重要考虑因素,需要在性能和安全性之间做出平衡。

通过深入理解HDFS架构原理以及数据校验的必要性,我们可以更合理地选择和应用不同的校验策略。在下一章中,我们将具体讨论HDFS数据校验的技术实践,包括校验工具的使用与实现、跨版本校验的挑战以及实践案例分析。

# 3. HDFS数据校验的技术实践

HDFS数据校验技术实践部分涉及工具使用、跨版本校验挑战以及实际案例分析,为Hadoop集群的数据完整性提供可靠保障。接下来的章节将深入探讨这些技术实践的具体方法、面临的挑战以及如何解决这些问题。

## 3.1 校验工具的使用与实现

校验工具的选用和实施是数据校验流程中的重要一环。在Hadoop生态系统中,可以采用多种工具进行数据校验。本小节会介绍原生Hadoop提供的校验命令和常用第三方校验工具的使用。

### 3.1.1 原生Hadoop校验命令

Hadoop本身提供了一些基本的文件系统操作命令,如`hdfs fsck`,用于检查文件系统健康状况和数据完整性。以下是一个使用`hdfs fsck`命令进行数据校验的示例:

```bash

hdfs fsck / -files -blocks -locations

```

此命令会对整个文件系统进行校验,并输出文件、数据块及它们的位置信息。输出信息会告诉我们哪些数据块是损坏的或者丢失的。

### 逻辑分析和参数说明

- `/` 表示要检查的文件系统根目录。

- `-files` 选项用于显示文件的检查结果。

- `-blocks` 选项用于显示数据块的检查结果。

- `-locations` 选项用于显示数据块所在的位置信息。

### 扩展说明

`hdfs fsck` 命令支持更多高级选项,可以深入地检查HDFS的健康状况。例如,`-move` 选项可以将损坏的数据块移动到HDFS的/lost+found目录中;`-delete` 选项则会删除损坏的文件。

### 3.1.2 第三方工具的选择和应用

除了原生的Hadoop命令之外,还有一些第三方工具如DistCp(分布式复制工具)和Apache Ant等可以用于HDFS数据校验。以下是一个使用DistCp进行数据校验的示例:

```bash

hadoop distcp hdfs://namenode1/path/to/dataset hdfs://namenode2/path/to/dataset -diff

```

这个命令会比较两个不同Hadoop集群中指定路径下的数据集,并输出不同之处。

### 逻辑分析和参数说明

- `hadoop distcp` 是DistCp工具的基本命令格式。

- 第一个参数 `hdfs://namenode1/path/to/dataset` 指定源HDFS路径。

- 第二个参数 `hdfs://nam

0

0