【神经网络优化器大比拼】:Adam, RMSprop在Python中的实战应用

发布时间: 2024-08-31 23:29:46 阅读量: 75 订阅数: 58

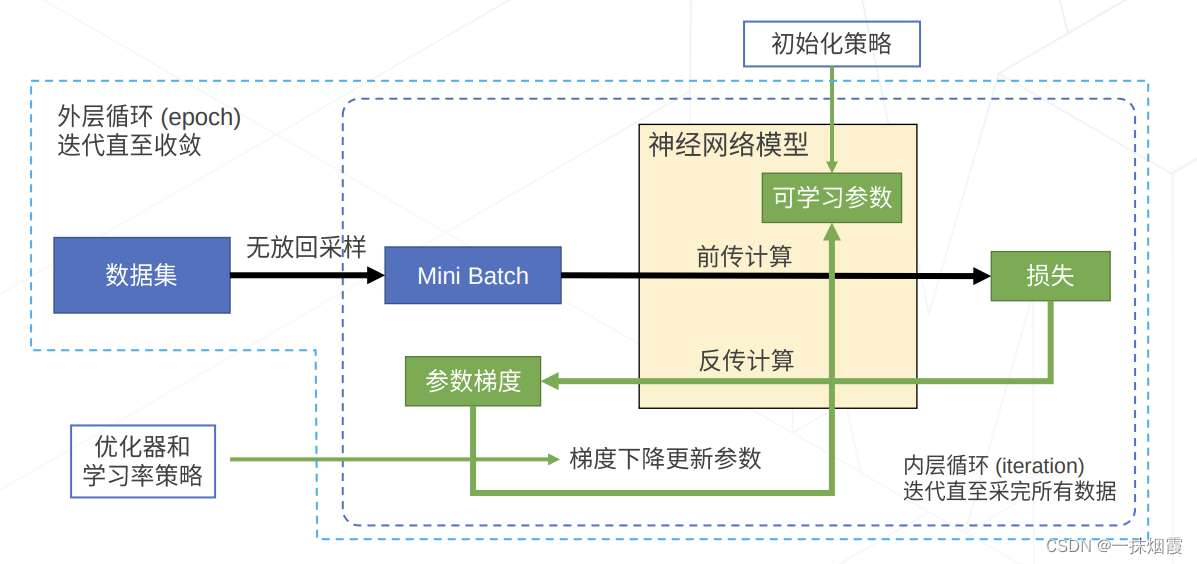

# 1. 神经网络优化器概述

神经网络优化器是深度学习领域不可或缺的工具,它通过迭代地调整网络中的参数来最小化损失函数,提高模型性能。优化器的选择和调优直接影响到模型的训练效率和最终性能。本章将简要介绍优化器的基本概念,为后续章节中对具体优化算法的深入分析和实现打下基础。

优化器的工作原理基于数学优化技术,最常见的是梯度下降法。在此方法中,参数更新方向为损失函数梯度的反方向,更新的步长由学习率决定。为了克服传统梯度下降的局限性,例如收敛速度慢和容易陷入局部最小值等问题,研究者们相继提出了如Adam和RMSprop等自适应学习率的优化算法。这些算法可以更好地处理非凸优化问题,加速收敛过程,提升模型训练的稳定性和效率。在下一章,我们将深入探讨这些优化算法的理论基础和工作机制。

# 2. 理解优化算法原理

## 2.1 优化算法的理论基础

### 2.1.1 梯度下降法简介

梯度下降法是最基础的优化算法之一,在机器学习和深度学习模型训练中占据核心地位。其核心思想是通过迭代的方式来寻找一个函数的最小值,这个函数通常代表着模型的损失函数,而损失函数则用于衡量模型预测值和实际值之间的差异。在每次迭代中,梯度下降法都会计算损失函数相对于模型参数的梯度(即导数),然后沿着这个梯度的反方向(梯度下降方向)更新参数,从而逐渐接近损失函数的最小值。

梯度下降法有几种不同形式,包括批量梯度下降、随机梯度下降(SGD)和小批量梯度下降。批量梯度下降每次迭代使用所有训练数据计算梯度;SGD则每次迭代只使用一个样本计算梯度,这会带来较高的方差但也有助于快速收敛;小批量梯度下降是批量梯度下降和SGD的折中,每次迭代使用一小批数据计算梯度,以平衡计算效率和收敛速度。

### 2.1.2 梯度下降法的局限性

尽管梯度下降法在优化问题中极为有效,但它存在一些局限性。首先,梯度下降法可能在非凸优化问题中陷入局部最小值,而不能找到全局最小值。其次,选择合适的学习率对于算法的收敛至关重要,学习率过大可能会导致算法无法收敛,而学习率过小则会使得训练过程变得缓慢。最后,梯度下降法在处理大规模数据集时可能会遇到困难,因为每次迭代更新需要计算整个数据集的梯度,这在计算上是不切实际的。

## 2.2 Adam优化器的机制解析

### 2.2.1 Adam优化器的工作原理

Adam(Adaptive Moment Estimation)是一种自适应学习率的优化算法,它整合了动量(Momentum)和RMSprop两种优化策略,通过计算梯度的一阶矩估计(即动量)和二阶矩估计(即未中心化的方差)来调整每个参数的学习率。这种算法旨在为每个参数找到一个合适的学习率,能够加速随机梯度下降在凸优化问题中的收敛速度,并在非凸优化问题中表现更好。

Adam优化器的工作流程大致可以分为以下几个步骤:

1. 初始化一阶和二阶矩估计的参数,通常是一维向量。

2. 在每次迭代中,计算损失函数关于参数的梯度。

3. 更新一阶矩估计和二阶矩估计,引入了两个超参数β1和β2来控制矩估计的衰减率。

4. 计算偏差校正后的矩估计。

5. 根据矩估计计算参数更新。

### 2.2.2 Adam的自适应学习率调整

Adam优化器中的自适应学习率调整是通过一阶矩估计(动量项)和二阶矩估计(RMS项)来实现的。动量项有助于加速优化过程,尤其是穿过凹槽时,而RMS项有助于自动调整学习率,使得算法能够对稀疏梯度和非平稳目标函数进行有效的优化。Adam还通过引入偏差校正项来进一步提高性能,这有助于在初始阶段对于一阶和二阶矩估计的偏倚进行校正。

## 2.3 RMSprop优化器的机制解析

### 2.3.1 RMSprop的工作原理

RMSprop(Root Mean Square Propagation)是一种自适应学习率的优化算法,主要解决自适应梯度算法(如AdaGrad)学习率过早和过量衰减的问题。RMSprop通过对梯度的平方进行指数移动平均来调整学习率,因此它能够在不同参数上使用不同的学习率,并且能够很好地适应学习率的缩放。

RMSprop的工作原理可以概括为以下几个步骤:

1. 初始化滑动平均的平方梯度估计(通常初始化为零向量)。

2. 在每次迭代中计算当前梯度的平方。

3. 更新滑动平均的平方梯度估计。

4. 利用更新后的滑动平均值来调整学习率。

### 2.3.2 RMSprop的梯度平方均值更新

RMSprop的核心是梯度平方均值(RMS)的更新策略。具体来说,在每一次迭代过程中,我们首先计算当前梯度的平方,然后使用这个平方值来更新之前的梯度平方的滑动平均值。通过这种方式,RMSprop能够自动地调整学习率,并且对学习率进行缩放,使其适合于每一个参数。RMSprop的一个重要优点是它避免了学习率单调递减的问题,并且能够加速收敛速度。

为了更好地理解RMSprop的工作原理,我们举一个简单的例子。假设我们的目标是找到函数f(x) = x^2的最小值,初始学习率为0.1,滑动平均的平方梯度初始值设为0,然后按照以下步骤迭代:

1. 对于当前的x值,计算梯度2x。

2. 更新滑动平均的平方梯度值,这里我们设β为0.9,即 `s = 0.9 * s + (1 - 0.9) * (2x)^2`。

3. 根据滑动平均的平方梯度值调整学习率,得到新的学习率:`lr = 0.1 / sqrt(s)`。

4. 更新x值:`x = x - lr * 2x`。

通过上述步骤,我们可以看到RMSprop如何动态地调整学习率来提高优化的效率。这种机制使得RMSprop特别适用于训练深度神经网络。

总结以上内容,第二章深入讨论了优化算法的理论基础及其机制解析。下一章节我们将从实践角度出发,介绍如何在Python中使用TensorFlow框架来实现Adam和RMSprop这两种优化器,并讨论如何在实际模型训练中应用它们。

# 3. 神经网络优化器的Python实现

#### 3.1 使用TensorFlow构建Adam优化器

##### 3.1.1 TensorFlow基础设置

TensorFlow是目前非常流行的开源机器学习库,特别在深度学习领域。在使用TensorFlow构建Adam优化器之前,需要先对TensorFlow进行基础设置。以下是一个简单的设置代码示例:

```python

import tensorflow as tf

# 设置TensorFlow的日志级别,可以避免一些不必要的信息输出

***pat.v1.logging.set_verbosity(***pat.v1.logging.ERROR)

# 定义一个常量,作为后续构建计算图的基础数据

constant_value = tf.constant(4.0)

```

在这个基础上设置中,我们首先导入了TensorFlow库,并使用`***pat.v1.logging.set_verbosity`方法设置了日志级别,将日志输出设置为ERROR级别,这意味着只有错误信息会被输出,其他级别的信息比如WARNING或者INFO将不会显示,这样可以在一定程度上避免控制台输出过多不必要的信息。

紧接着,我们定义了一个常量`constant_value`,它使用了`tf.constant`方法,创建了一个值为4.0的常量。这是TensorFlow中非常基础的操作,常量的创建是构建计算图中不可或缺的一步。在后续构建复杂的神经网络和优化器时,我们会用到更多的TensorFlow操作来构建计算图和执行各种计算任务。

##### 3.1.2 构建模型并应用Adam优化器

在TensorFlow中,构建一个简单的线性模型并应用Adam优化器的代码如下:

```python

import tensorflow as tf

import numpy as np

# 输入数据,这里我们使用一个简单的线性关系 y = 2x + 1

x_train = np.array([1, 2, 3, 4], dtype=np.float32)

y_train = np.array([3, 5, 7, 9], dtype=np.float32)

# 定义TensorFlow的计算图

X = ***pat.v1.placeholder(tf.float32, name='X')

Y = ***pat.v1.placeholder(tf.float32, name='Y')

# 定义模型参数

W = tf.Variable(tf.random.normal([1]), name='weight')

b = tf.Variable(tf.random.normal([1]), name='bias')

# 定义模型结构

pred = tf.add(tf.multiply(X, W), b)

# 定义损失函数

cost = tf.reduce_sum(tf.pow(pred - Y, 2)) / (2 * len(x_train))

# 定义学习率和优化器

learning_rate = 0.01

optimizer = ***pat.v1.train.AdamOptimizer(learning_rate).minimize(cost)

# 初始化所有变量

init = ***pat.v1.global_variables_initializer()

# 启动TensorFlow会话

***pat.v1.Session() as sess:

sess.run(init)

# 训练过程

for epoch in range(100):

for (x, y) in zip(x_train, y_train):

sess.run(optimizer, feed_dict={X: x, Y: y})

# 输出训练后的参数值

training_W, training_b = sess.run([W, b])

print(f"Trained weight: {training_W}, Trained bias: {training_b}")

```

在这段代码中,我们首先定义了输入数据`x_train`和`y_train`,它们分别表示输入特征和目标值。接着,我们定义了TensorFlow计算图中的placeholder节点`X`和`Y`,它们是用于后续输入训练数据的占位符。

然后,我们定义了模型的参数`W`(权重)和`b`(偏置),并使用了一个线性模型`pred = tf.add(tf.multiply(X, W),

0

0