【数据分析时间处理秘技】:Arrow库在数据处理中的实际应用

发布时间: 2024-10-06 16:42:46 阅读量: 17 订阅数: 25

# 1. Arrow库概述与时间数据的重要性

## 简介

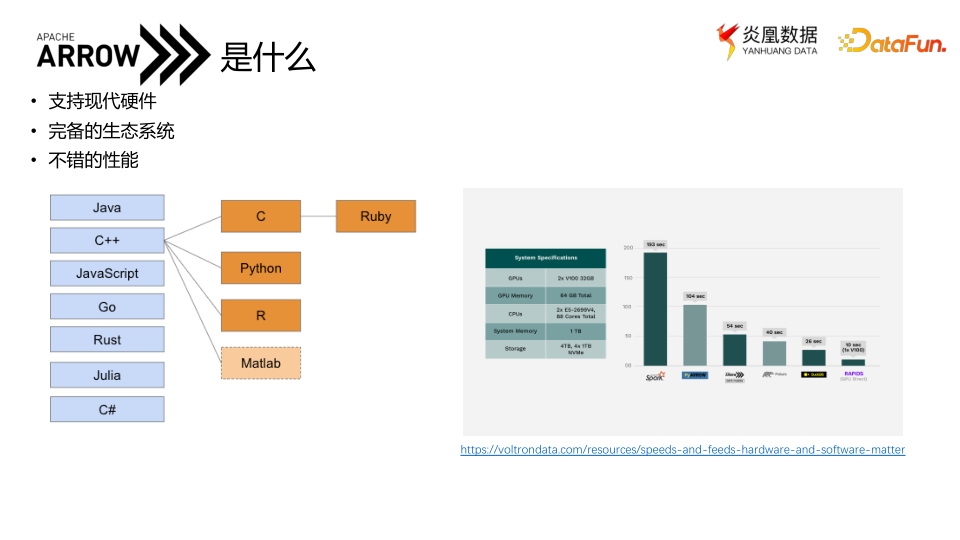

Apache Arrow是致力于提高大数据处理效率的开源项目,它为不同的计算系统之间提供了高效的数据交换格式。该库的核心在于定义了一种内存中列式存储的数据结构,可以被各种不同的编程语言所支持,以此来简化分析和处理大数据的过程。

## 时间数据的重要性

时间数据在数据分析和处理中扮演着至关重要的角色,它是排序和聚合的基础,同时也是计算时间间隔和周期的关键。例如,在金融分析、日志审计、实时监控以及预测模型构建中,准确处理时间数据对于提供洞察力和制定策略是必不可少的。

## Arrow库与时间数据

Arrow库为时间数据的存储和操作提供了优化的表示方法和功能,这包括支持多种时间单位(如纳秒、微秒等)、时间戳和时区的处理,以及提供了一套丰富的API来进行时间数据的转换和解析。通过利用Arrow库处理时间数据,开发者能够大幅提升性能,减少资源消耗,提高数据处理速度和准确性。

# 2. Arrow库的基础操作

### 2.1 时间数据类型简介

#### 2.1.1 时间数据在数据分析中的角色

时间数据在数据分析中的角色不可小觑。从交易记录到服务器日志,再到传感器数据,几乎所有的数据集中都包含时间戳或周期性的时间信息。这些信息是理解数据背后动态的关键,对于事件排序、趋势识别、周期性分析和预测建模至关重要。例如,金融领域利用时间序列数据预测股票价格,零售业分析顾客购买习惯随季节的变化,而在社交媒体数据分析中,时间戳帮助识别热门话题的生命周期。

#### 2.1.2 Arrow库对时间数据的表示方法

Arrow库通过定义统一的数据模型来表示时间数据,其核心是`Timestamp`类型,该类型包含时间单位(如纳秒、微秒等)和一个整数值来表示时间点。这不仅提升了数据处理速度,也减少了不同系统间的时间数据转换。此外,Arrow库支持多种时间单位,能够表示从毫秒精度的Unix时间戳到纳秒级别高精度时间戳。

### 2.2 Arrow库的基本时间处理功能

#### 2.2.1 时间戳的创建与转换

Arrow库提供了多种方法来创建时间戳,包括从字符串、Unix时间戳、以及其他时间结构创建。例如,创建一个特定日期的时间戳可以使用如下代码:

```python

import pyarrow as pa

from pyarrow import timestamp

# 创建时间戳

ts = timestamp("2023-01-01 12:00:00", unit="ms")

print(ts)

```

输出的时间戳将展示为一个整数值和时间单位。转换时间戳也极其简单,可以指定不同的单位来获得对应的表示:

```python

# 转换为秒单位

ts_seconds = timestamp(ts.value, unit="s")

print(ts_seconds)

```

#### 2.2.2 时间段与时区的处理

处理时间段时,Arrow库能够创建时间间隔(`Duration`),并支持加减运算来获得新的时间点。例如,如果需要计算某个时间点后5天的时间,可以使用如下代码:

```python

# 计算5天后的时间

ts = timestamp("2023-01-01 12:00:00", unit="ms")

duration = timestamp(5 * 24 * 60 * 60 * 1000, unit="ms") # 5天的毫秒数

future_ts = ts + duration

print(future_ts)

```

同时,Arrow库通过`Timezone`模块支持时区处理,确保时间数据的准确性和一致性。这在多地区操作的数据处理中非常有用,例如:

```python

from pyarrow import Timezone

# 创建时区对象并转换时间

timezone_ny = Timezone("America/New_York")

ts_ny = ts.to_timezone(timezone_ny)

print(ts_ny)

```

### 2.3 Arrow库的高级时间处理功能

#### 2.3.1 复杂时间周期的解析与生成

在处理复杂的周期性事件时,Arrow库允许用户定义和操作频率、周期等概念。例如,定义一个每日事件可使用如下代码:

```python

from pyarrow import frequency

# 每日频率定义

daily_frequency = frequency("D")

print(daily_frequency)

```

这允许进一步生成时间序列,或对时间序列进行重新采样。例如,生成一个月的每日事件列表:

```python

# 生成一个月的每日时间序列

start_date = timestamp("2023-01-01")

end_date = timestamp("2023-02-01")

date_range = start_date.arange(end_date, daily_frequency)

print(date_range)

```

#### 2.3.2 时区敏感性与时间格式化的高级选项

时区处理是时间数据处理中的一个重要部分。Arrow库不仅支持时区转换,还能够根据RFC 3339或其他标准格式化时间戳。这为生成标准、可读的时间格式提供了便利。例如,格式化时间为ISO 8601标准字符串:

```python

# 格式化时间戳为ISO 8601格式

iso_timestamp = ts.to_iso8601_string()

print(iso_timestamp)

```

对于时区敏感的格式化,可以使用以下代码:

```python

# 时区敏感的时间格式化

timezoneSensitiveFormat = ts.to_timestamp_string(timezone_ny)

print(timezoneSensitiveFormat)

```

这样处理后的时间数据对于国际化的应用场景尤其重要,能够确保各地用户看到的时间是准确对应的。

接下来,我们将深入了解Arrow库在数据清洗中的应用。

# 3. Arrow库在数据清洗中的应用

## 3.1 数据中的时间格式不一致问题

### 3.1.1 常见时间格式问题及其影响

在数据处理中,时间格式的不一致性是一个普遍存在的问题,它主要来源于数据收集过程中不同的数据源使用了不同的时间格式。例如,有的数据集可能使用"YYYY-MM-DD",而其他数据集可能使用"MM/DD/YYYY"。这些差异可能会导致在分析或合并数据时出现问题,尤其是当自动化工具或算法被用来处理数据时。

不一致的时间格式会直接影响数据清洗和预处理的效率,增加开发和维护的难度,甚至可能在数据分析和可视化阶段造成误导。例如,比较和排序不同格式的时间数据可能会返回错误的结果,进一步导致错误的业务决策。

### 3.1.2 使用Arrow库统一时间格式

Arrow库提供了强大的工具,可以简化时间数据格式的统一工作。Arrow的`Timestamp`类型能够容纳多种不同的时间格式,并且可以将这些格式转换为一种内部统一的表示方式。这减少了需要手动编写复杂的解析代码,提高了数据处理的效率。

下面是一个简单的例子,说明如何使用Arrow库来转换和统一时间数据格式:

```python

import pyarrow as pa

from pyarrow import Table

# 假设有一个时间数据列表,包含不同的时间格式

time_data = ["2023-01-01", "01/01/2023", "2023/01/01"]

# 创建一个时间字符串数组

time_array = pa.array(time_data)

# 转换为Arrow的Timestamp类型,指定统一的目标格式

time统一格式 = ***pute.strptime(time_array, format="%Y-%m-%d").cast(pa.timestamp("s"))

# 显示转换后的时间数组

print(time统一格式.to_pylist())

```

通过上述代码,Arrow库将不同格式的时间字符串统一转换成了以秒为单位的时间戳。这样,无论原始数据如何变化,都能保证时间数据在后续处理中的一致性。

## 3.2 处理时间序列数据

### 3.2.1 时间序列数据的重采样

时间序列数据通常需要进行重采样(resampling),以便能够按照特定的时间间隔进行分析和可视化。重采样涉及到将数据从原始时间频率转换到新的时间频率。

Arrow库提供了进行时间序列重采样的功能,这在金融市场分析、天气数据处理等时间依赖性分析中非常有用。下面的代码演示了如何对时间序列数据执行重采样:

```python

import pyarrow as pa

from pyarrow import Table, parquet

import pandas as pd

# 加载时间序列数据

table = parquet.read_table("timeseries_data.parquet")

# 转换为Pandas DataFrame进行操作

df = table.to_pandas()

# 使用Pandas的resample方法进行重采样

resampled_df = df.resample('

```

0

0