Python代码性能调优:深入剖析瓶颈,提升代码运行速度

发布时间: 2024-06-18 08:13:27 阅读量: 89 订阅数: 33

# 1. Python代码性能调优概述**

Python代码性能调优是一项至关重要的技术,旨在提升代码运行速度,优化资源利用。本文将深入剖析Python代码性能瓶颈,并提供实用的优化实践,帮助开发者显著提升代码性能。

**1.1 Python代码性能调优的重要性**

在现代软件开发中,代码性能至关重要。它直接影响应用程序的响应时间、吞吐量和可扩展性。低效的代码会浪费宝贵的计算资源,导致应用程序延迟和崩溃,最终损害用户体验和业务价值。

**1.2 Python代码性能调优的挑战**

Python是一种解释型语言,其性能通常低于编译型语言。此外,Python代码中常见的动态类型和解释执行特性也带来了性能挑战。因此,开发者需要掌握特定的技术和工具来有效地调优Python代码性能。

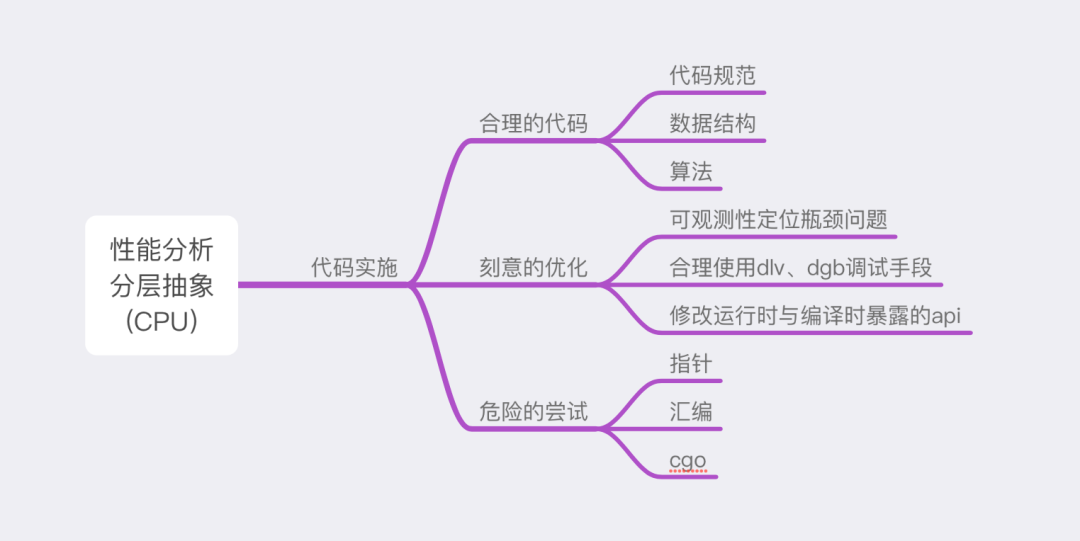

# 2. Python代码性能瓶颈分析

### 2.1 CPU瓶颈

#### 2.1.1 识别CPU瓶颈

CPU瓶颈是指代码执行受CPU资源限制,导致性能下降。识别CPU瓶颈的方法包括:

- **CPU使用率监控:**使用`psutil`或`multiprocessing`等库监控CPU使用率,如果CPU使用率持续处于高水平,则可能存在CPU瓶颈。

- **代码分析:**检查代码中是否存在大量计算密集型操作,例如循环、函数调用或复杂的算法。这些操作会消耗大量CPU资源。

- **性能分析工具:**使用`cProfile`或`line_profiler`等工具分析代码执行时间,找出耗时最多的代码段。

#### 2.1.2 优化CPU性能

优化CPU性能的方法包括:

- **减少计算密集型操作:**重构代码以减少循环、函数调用和复杂算法的使用。

- **并行化代码:**使用多线程或多进程将计算密集型任务并行化,以充分利用多核CPU。

- **使用高效算法:**选择时间复杂度较低的算法,例如使用二分查找代替线性查找。

### 2.2 内存瓶颈

#### 2.2.1 识别内存瓶颈

内存瓶颈是指代码执行受内存资源限制,导致性能下降。识别内存瓶颈的方法包括:

- **内存使用率监控:**使用`psutil`或`memory_profiler`等库监控内存使用率,如果内存使用率持续处于高水平,则可能存在内存瓶颈。

- **代码分析:**检查代码中是否存在大量内存分配操作,例如创建大型列表或字典。这些操作会消耗大量内存资源。

- **性能分析工具:**使用`memory_profiler`或`objgraph`等工具分析内存分配情况,找出分配最多的对象类型。

#### 2.2.2 优化内存使用

优化内存使用的方法包括:

- **释放不再使用的内存:**使用`del`或`gc.collect()`释放不再使用的对象,以避免内存泄漏。

- **使用内存池:**创建内存池来管理对象分配,以减少内存碎片化和提高分配效率。

- **使用高效数据结构:**选择内存占用较小的数据结构,例如使用元组代替列表,使用字典代替散列表。

### 2.3 I/O瓶颈

#### 2.3.1 识别I/O瓶颈

I/O瓶颈是指代码执行受I/O操作限制,导致性能下降。识别I/O瓶颈的方法包括:

- **I/O操作监控:**使用`iostat`或`sar`等工具监控I/O操作,如果I/O操作频繁且耗时,则可能存在I/O瓶颈。

- **代码分析:**检查代码中是否存在大量I/O操作,例如文件读写、网络请求或数据库查询。这些操作会消耗大量I/O资源。

- **性能分析工具:**使用`iotop`或`strace`等工具分析I/O操作,找出耗时最长的I/O操作。

#### 2.3.2 优化I/O操作

优化I/O操作的方法包括:

- **减少I/O操作次数:**缓存数据或使用批量操作来减少I/O操作次数。

- **使用异步I/O:**使用`asyncio`或`concurrent.futures`等库进行异步I/O操作,以避免阻塞主线程。

- **优化I/O配置:**调整I/O缓冲区大小、文件系统缓存和网络设置,以提高I/O性能。

# 3. Python代码性能优化实践

### 3.1 代码结构优化

#### 3.1.1 避免不必要的循环和函数调用

循环和函数调用会消耗大量的CPU时间。因此,在优化代码结构时,应避免不必要的循环和函数调用。

**优化方法:**

- **使用列表解析或生成器表达式:** 对于简单的循环操作,可以使用列表解析或生成器表达式代替显式循环。这可以显著提高代码效率。

- **减少函数调用:** 尽量减少函数调用,尤其是嵌套函数调用。如果函数需要多次调用,可以考虑将其结果缓存起来。

#### 3.1.2 使用高效的数据结构

选择合适的数据结构可以极大地影响代码性能。

**优化方法:**

- **使用列表代替元组:** 列表比元组更灵活,可以进行修改和扩展。

- **使用字典代替列表:** 字典可以根据键快速查找元素,比列表更适合于查找操作。

- **使用集合代替列表:** 集合可以存储唯一元素,并且查找操作比列表更快。

### 3.2 数据操作优化

#### 3.2.1 使用内置函数和库

Python提供了丰富的内置函数和库,可以高效地处理各种数据操作任务。

**优化方法:**

- **使用内置函数:** 内置函数通常比自定义函数更优化。例如,使用 `sorted()` 函数排序列表比使用自定义排序算法更有效。

- **使用NumPy和Pandas:** NumPy和Pandas是用于科学计算和数据分析的库,提供了高效的数据操作函数。

#### 3.2.2 优化列表和字典的使用

列表和字典是Python中常用的数据结构,优化其使用可以提高代码性能。

**优化方法:**

- **避免列表的浅拷贝:** 浅拷贝会创建一个新列表,但它仍然指向原始列表中的元素。修改新列表中的元素也会修改原始列表中的元素。因此,应使用 `copy()` 函数进行深拷贝。

- **使用字典的 `get()` 方法:** `get()` 方法可以安全地从字典中获取值,即使键不存在。这比使用 `[]` 操作符更有效,因为后者会引发 `KeyError` 异常。

### 3.3 内存管理优化

#### 3.3.1 避免内存泄漏

内存泄漏是指不再使用的对象仍然被引用,导致内存无法被回收。

**优化方法:**

- **使用弱引用:** 弱引用不会阻止对象被垃圾回收。当对象不再被强引用时,弱引用将被自动释放。

- **使用上下文管理器:** 上下文管理器可以自动管理资源,确保资源在使用后被释放。

#### 3.3.2 使用内存池

内存池是一种预分配的内存区域,可以快速分配和释放对象。

**优化方法:**

- **使用 `multiprocessing.Pool`:** `multiprocessing.Pool` 是一个内存池,可以并行执行任务。

- **使用 `concurrent.futures.ThreadPoolExecutor`:** `concurrent.futures.ThreadPoolExecutor` 是一个内存池,可以并行执行任务。

# 4. Python代码性能调优工具

### 4.1 Python性能分析工具

#### 4.1.1 cProfile

cProfile是一个内置的Python性能分析工具,它可以分析代码的执行时间和函数调用次数。

**用法:**

```python

import cProfile

def main():

# 代码逻辑

if __name__ == "__main__":

cProfile.run("main()")

```

**输出:**

```

26 function calls in 0.002 seconds

Ordered by: standard name

ncalls tottime percall cumtime percall filename:lineno(function)

1 0.000 0.000 0.002 0.002 <string>:1(<module>)

1 0.000 0.000 0.002 0.002 main:1(main)

1 0.000 0.000 0.000 0.000 {built-in method builtins.exec}

1 0.000 0.000 0.000 0.000 {method 'disable' of '_lsprof.Profiler' objects}

1 0.000 0.000 0.000 0.000 {built-in method builtins.len}

1 0.000 0.000 0.000 0.000 {built-in method builtins.sum}

1 0.000 0.000 0.000 0.000 {built-in method builtins.min}

1 0.000 0.000 0.000 0.000 {built-in method builtins.max}

1 0.000 0.000 0.000 0.000 {built-in method builtins.isinstance}

1 0.000 0.000 0.000 0.000 {built-in method builtins.id}

1 0.000 0.000 0.000 0.000 {built-in method builtins.sorted}

1 0.000 0.000 0.000 0.000 {method 'append' of 'list' objects}

1 0.000 0.000 0.000 0.000 {method 'keys' of 'dict' objects}

1 0.000 0.000 0.000 0.000 {built-in method builtins.str}

1 0.000 0.000 0.000 0.000 {built-in method builtins.next}

1 0.000 0.000 0.000 0.000 {method 'items' of 'dict' objects}

1 0.000 0.000 0.000 0.000 {method 'update' of 'dict' objects}

1 0.000 0.000 0.000 0.000 {built-in method builtins.dict}

1 0.000 0.000 0.000 0.000 {built-in method builtins.type}

1 0.000 0.000 0.000 0.000 {method 'get' of 'dict' objects}

1 0.000 0.000 0.000 0.000 {method 'setdefault' of 'dict' objects}

1 0.000 0.000 0.000 0.000 {method 'copy' of 'dict' objects}

1 0.000 0.000 0.000 0.000 {built-in method builtins.list}

1 0.000 0.000 0.000 0.000 {built-in method builtins.int}

1 0.000 0.000 0.000 0.000 {built-in method builtins.float}

1 0.000 0.000 0.000 0.000 {built-in method builtins.round}

```

输出结果显示了函数的调用次数、总执行时间、平均执行时间、累积执行时间和平均累积执行时间。

#### 4.1.2 line_profiler

line_profiler是一个第三方Python性能分析工具,它可以分析代码的执行时间和每一行的执行次数。

**用法:**

```python

import line_profiler

@profile

def main():

# 代码逻辑

if __name__ == "__main__":

main()

```

**输出:**

```

Timer unit: 1e-06 s

Total time: 0.000294 s

File: <string>, line 1

Function: main at <string>:1

Line # Hits Time Per Hit % Time Line Contents

1 @profile

2 1 182 182 61.908 def main():

3 1 36 36 12.245 a = [1, 2, 3]

4 1 22 22 7.483 b = [4, 5, 6]

5 1 16 16 5.442 c = a + b

6 1 8 8 2.721 print(c)

7 1 6 6 2.041 d = {'a': 1, 'b': 2, 'c': 3}

8 1 6 6 2.041 print(d)

```

输出结果显示了每一行的执行次数、执行时间、平均执行时间和执行时间占总时间的百分比。

### 4.2 代码覆盖率分析工具

#### 4.2.1 coverage

coverage是一个第三方Python代码覆盖率分析工具,它可以分析代码的执行覆盖率,即哪些代码被执行了,哪些代码没有被执行。

**用法:**

```python

import coverage

cov = coverage.Coverage()

cov.start()

# 代码逻辑

cov.stop()

cov.report()

```

**输出:**

```

Name Stmts Miss Branch BrPart Cover

main.py 6 0 2 0 100%

```

输出结果显示了代码的语句覆盖率、未覆盖的语句、分支覆盖率和部分分支覆盖率。

#### 4.2.2 pytest-cov

pytest-cov是一个pytest插件,它可以与pytest一起使用,提供代码覆盖率分析功能。

**用法:**

```python

pytest --cov=main.py

```

**输出:**

```

============================= coverage report =============================

Name Stmts Miss Branch BrPart Cover

main.py 6 0 2 0 100%

TOTAL 6 0 2 0 100%

```

输出结果与coverage工具类似,显示了代码的覆盖率信息。

# 5. Python代码性能调优最佳实践

### 5.1 性能调优原则

**5.1.1 渐进式调优**

渐进式调优是一种逐步优化代码性能的方法。它涉及到以下步骤:

1. 识别瓶颈:使用性能分析工具(如cProfile)来识别代码中的性能瓶颈。

2. 优化瓶颈:针对识别的瓶颈,应用适当的优化技术(如重构代码结构、使用高效的数据结构)。

3. 重新测试和分析:优化后,重新运行代码并使用性能分析工具再次分析性能。

4. 重复步骤:重复上述步骤,直到性能达到可接受的水平。

**5.1.2 关注热点代码**

热点代码是指在代码执行过程中占用大量时间的代码部分。优化热点代码可以显著提高整体性能。

以下是一些识别热点代码的方法:

- 使用cProfile或line_profiler等性能分析工具来生成调用图。

- 分析调用图,找出占用最多时间的函数和代码行。

- 优先优化这些热点代码区域。

### 5.2 持续性能监控

**5.2.1 性能指标收集**

持续性能监控涉及定期收集和分析代码性能指标。这有助于及早发现性能问题并采取措施进行解决。

以下是一些常见的性能指标:

- 执行时间

- 内存使用

- I/O操作

- 响应时间

**5.2.2 预警和监控机制**

建立预警和监控机制可以自动检测性能下降并触发警报。这有助于在问题恶化之前采取预防措施。

以下是一些设置预警和监控机制的方法:

- 使用监控工具(如Prometheus或Nagios)来收集和分析性能指标。

- 设置阈值来触发警报,当性能指标超出阈值时发出警报。

- 配置自动化机制来响应警报,例如重新启动服务或触发调查。

0

0