代码剖析与性能调优:Dask最佳实践,专家级技巧全解析

发布时间: 2024-09-29 22:51:02 阅读量: 9 订阅数: 32

# 1. Dask基础与数据结构

Dask是一个开源的Python库,用于并行计算。它能通过熟悉的接口扩展NumPy、Pandas和Scikit-Learn。Dask的主要优点之一是其简单的接口,这使得在多核处理器和计算机集群上实现并行计算和分布式计算变得容易。

## 1.1 Dask的核心概念

Dask包括两个主要的抽象:动态任务图(DAGs)和大数组(Bag)。DAGs允许并行计算,通过任务的图表示实现,而大数组则是用于处理大型数据集的数据结构。

## 1.2 Dask数据结构

Dask提供了多种数据结构,如数组、数据框(DataFrame)和袋(Bag),它们模仿了NumPy、Pandas和Python内置类型的行为。这些数据结构提供了延迟执行和并行操作,适合于处理大规模数据集。

## 1.3 数据操作与转换

Dask允许用户编写类似于Pandas和NumPy的代码来操作数据。这些操作不会立即执行,而是构建在任务图中,之后根据需要计算。Dask还提供了优化执行计划和缓存中间结果以提高性能的能力。

了解这些基础知识是使用Dask进行数据处理和分析的第一步。接下来的章节将进一步深入Dask的分布式计算原理以及如何优化Dask的性能。

# 2. Dask的分布式计算原理

### 2.1 Dask的并发模型

Dask的并发模型是其分布式计算框架的核心,它允许用户以一种直观和高效的方式编写并行代码。本节将深入探讨Dask任务图的构建与调度,以及延时计算和即时计算的机制,帮助读者更好地理解Dask如何管理并发任务。

#### 2.1.1 Dask任务图的构建与调度

Dask的任务图是一种用于表示计算任务及其依赖关系的数据结构。它由任务节点和依赖边构成,其中每个任务节点代表一个计算操作,依赖边表示不同任务间的依赖关系。这种图结构允许Dask进行任务的优化调度。

任务图的构建从用户定义的计算操作开始。例如,当用户创建一个Dask DataFrame时,每个列的计算都被转换成一个图中的节点。用户定义的函数和操作被应用到这些节点上,从而构建出包含所有计算步骤的完整图。

```python

import dask.dataframe as dd

# 创建一个Dask DataFrame作为示例

df = dd.read_csv('data.csv')

df['square'] = df['value'] ** 2

sum_result = df['square'].sum().compute()

```

在上面的例子中,`df['square'] = df['value'] ** 2` 这一行实际上是在Dask图中添加了两个节点:一个用于计算平方值,另一个用于存储结果。Dask在构建图时会识别出这些节点之间的依赖关系,并据此安排任务的执行顺序。

#### 2.1.2 Dask中的延时计算和即时计算

Dask支持两种计算模式:延时计算(Lazy Evaluation)和即时计算(Eager Evaluation)。延时计算可以推迟实际的计算操作,直到真正需要结果时才执行,这样可以优化计算过程,减少不必要的计算和内存使用。

即时计算则是当定义了计算任务之后立即执行,Python中的普通表达式就是这种类型的计算。Dask允许在任务图构建完毕后立即执行计算,这有助于调试和优化代码。

```python

# 延时计算示例

square = df['value'] ** 2

# 立即计算示例

immediate_result = square.head(5).compute()

```

在这个例子中,`square` 对象只包含了计算图的一部分,并没有执行实际的计算操作。而 `immediate_result` 则会触发Dask立即执行 `square` 中定义的任务,并计算出结果。

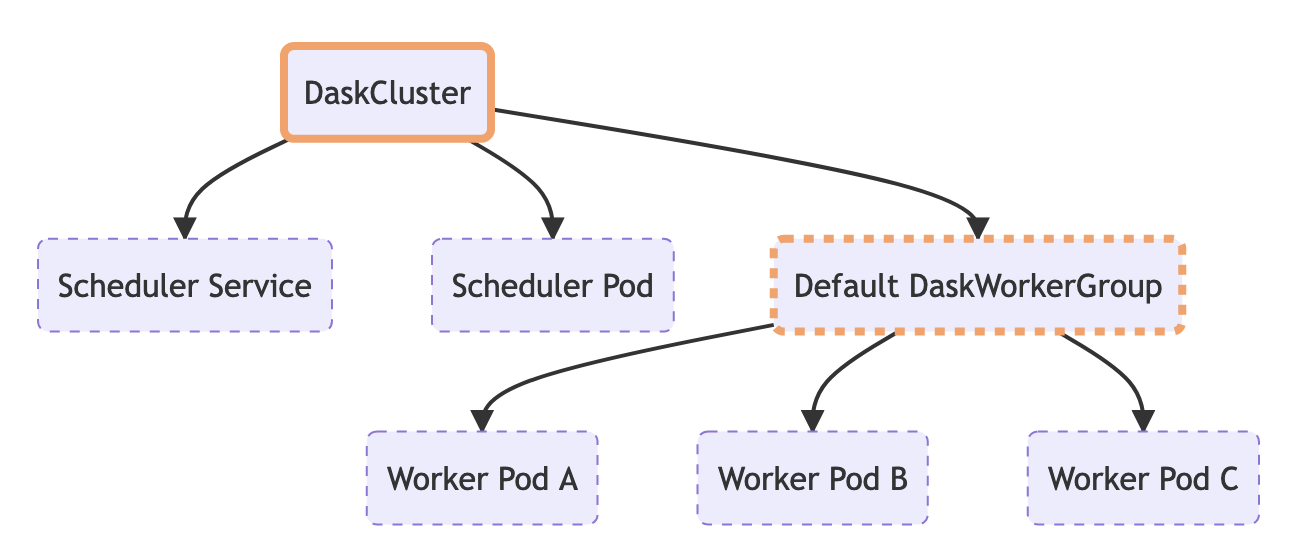

### 2.2 Dask集群的搭建与管理

Dask支持在不同的计算环境下运行,包括单机和分布式集群。理解Dask集群的搭建和管理对于优化资源使用和扩展计算能力至关重要。

#### 2.2.1 单机模式与分布式模式

在单机模式下,Dask利用多线程或单线程的方式在一台机器上执行计算任务。这种模式适用于小规模数据处理或者在开发阶段的本地测试。当任务依赖于单核或者I/O密集型时,单机模式的性能表现可能更好。

```python

from dask.distributed import Client, LocalCluster

# 创建本地Dask集群客户端

client = Client(LocalCluster())

```

分布式模式是Dask的主要运行方式,它可以将任务分布在多台机器的多个核心上执行。这种方式尤其适合于处理大规模数据集,能够充分利用集群的计算资源。

```python

from dask.distributed import Client

# 创建分布式Dask集群客户端

client = Client('***.***.*.***:8786')

```

#### 2.2.2 集群资源的动态管理与扩展

Dask集群的动态资源管理允许用户根据实际需要调整集群规模。例如,可以动态添加或删除工作节点来满足任务需求的变化。

```python

from dask.distributed import Nanny

# 动态添加一个工作节点

client.cluster.scale_up(1)

# 动态移除一个工作节点

client.cluster.scale_down(1)

```

在使用Dask时,合理地扩展集群资源可以显著提高计算性能和任务吞吐量。Dask社区已经开发了多种工具和方法来帮助用户进行集群的动态扩展。

### 2.3 Dask的内存管理与优化

Dask在处理大数据时会涉及到大量的内存管理问题。因此,合理地监控和控制内存使用,预防和解决内存泄漏是非常重要的。

#### 2.3.1 内存使用的监控与控制

Dask提供了丰富的内存监控工具,例如通过`dask-worker`进程的日志和Dask Dashboard可以实时查看内存使用情况。

```python

# Dask Dashboard地址,通过浏览器访问查看

client Dashboard link

```

通过监控内存使用情况,开发者可以及时调整任务的执行策略,比如通过调整分区大小、缓存策略等来优化内存使用。

#### 2.3.2 内存泄漏的预防与解决

内存泄漏是导致Dask集群性能下降的重要原因之一。为了预防内存泄漏,Dask建议开发者尽量避免在任务中创建闭包和外部变量引用,这可以降低Python垃圾回收机制的复杂性。

解决内存泄漏的一个有效方法是定期检查Dask的内存使用情况。当发现有异常时,可以利用Dask的诊断工具来定位问题。

```python

# 使用Dask诊断工具定位内存泄漏

client.diagnose()

```

Dask的内存管理是一个复杂而重要的议题,涉及到集群管理、性能调优和任务监控等多个方面。掌握这些知识点可以帮助开发者更有效地利用Dask进行大规模数据处理。

# 3. Dask编程高级技巧

Dask编程模型提供了比原生Python更为高级的抽象,使得用户可以在不牺牲性能的前提下,以更自然、更易于理解的方式编写并行代码。本章将深入探讨Dask的一些高级编程技巧,包括自定义分区函数、优化数据的读写操作以及与Python生态中其他知名库的集成。

## 3.1 Dask的自定义分区函数

### 3.1.1 分区策略的选择与实现

在分布式计算中,数据分区是一个核心概念,它涉及到如何在多个计算节点之间分布数据以实现负载均衡和高效计算。Dask允许用户根据需求自定义分区策略,从而更精确地控制数据的分布和处理过程。

```python

from dask.distributed import Client, progress

import dask.dataframe as dd

def custom_partition(df, partition

```

0

0