【R语言数据集划分】:用R语言高效进行数据集划分的技巧

发布时间: 2024-11-20 02:39:58 阅读量: 51 订阅数: 47

# 1. R语言数据集划分概述

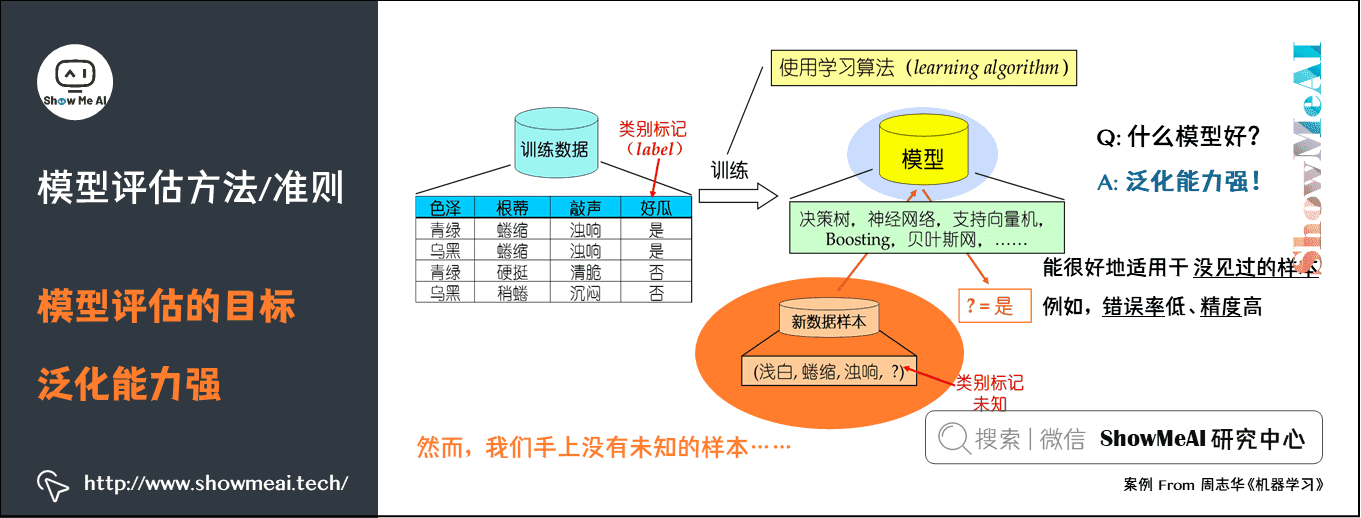

数据集划分是数据预处理中的关键步骤,它为分析和模型建立奠定了基础。在机器学习和统计分析中,数据集通常需要被分割为训练集和测试集。训练集用于模型的建立和调优,而测试集则用于评估模型的性能。

## 1.1 数据集划分的定义和重要性

划分数据集有助于减少模型的过拟合,提高模型的泛化能力。通过在未见过的数据上测试模型,我们能够更真实地评估其性能,从而对不同算法和模型参数进行比较和选择。

## 1.2 数据集划分的应用场景

在实际应用中,数据集划分不仅适用于小规模数据分析,而且对于大数据集的处理同样重要。数据集划分有助于分批处理数据,优化内存使用,并使得模型训练更加高效。

# 2. R语言数据集划分的理论基础

## 2.1 数据集划分的目的和意义

### 2.1.1 数据集划分的定义

数据集划分是机器学习和数据分析中的一项重要技术,它指的是将一个数据集分成两个或多个子集的过程。划分数据集的目的通常是为了训练模型和验证模型的有效性,常见的划分包括训练集、测试集和验证集。

训练集(Training Set):用于模型的学习,模型通过训练集来获得知识和规律。

测试集(Test Set):独立于模型训练过程,用于评估模型性能的样本集。

验证集(Validation Set):在模型训练过程中用于参数调整和模型选择。

数据集划分的定义不只是简单的数据分割,它涉及到对数据代表性、比例、独立性等因素的考量,以确保划分后的各个数据子集能有效地服务于整个数据分析或建模过程。

### 2.1.2 数据集划分的重要性

划分数据集的重要性体现在其对机器学习流程的影响,正确的划分策略能够显著提高模型的泛化能力和稳定性。

通过划分数据集,模型的性能评估变得更为客观。模型在一个集上学习,在另一个集上验证,可以有效避免过拟合,并评估模型对于未见数据的预测能力。

同时,数据集的划分也是交叉验证等技术实现的基础,有助于模型在不同的数据子集上多次训练和评估,提高模型的稳健性。

## 2.2 数据集划分的常用方法

### 2.2.1 划分依据和分类

数据集划分可以根据不同的依据进行分类,主要方法有:

- 随机划分(Random Partitioning):根据随机方式将数据分成训练集、测试集和验证集。

- 分层划分(Stratified Partitioning):确保划分后的各子集中,目标变量的分布比例与原始数据集中的分布比例相同。

- 时间序列划分(Time-based Partitioning):按照时间顺序划分,常用于时间序列数据。

### 2.2.2 不同方法的对比和适用场景

随机划分是最简单的方法,适用于数据量大且数据分布均匀的情况。分层划分适用于样本不平衡的情况,保证每个子集中的类别比例与整体数据集相似,有助于提高模型的泛化能力。时间序列划分则针对时间序列数据,以时间先后顺序为划分依据,防止数据泄露,保证模型的预测能力。

每种方法都有其特定的适用场景,选择合适的方法进行数据集划分是数据科学项目成功的关键一步。

## 2.3 数据集划分的评价指标

### 2.3.1 评价指标的选取原则

在进行数据集划分时,需要选取恰当的评价指标来衡量划分策略的效果。评价指标的选取原则主要包括:

- 相关性:指标应与问题目标紧密相关,能够反映模型性能。

- 简洁性:评价指标应直观易懂,便于理解和交流。

- 计算有效性:指标的计算过程应高效,适用于大规模数据集。

### 2.3.2 常见的评价指标和计算方法

常见的评价指标包括准确率(Accuracy)、精确率(Precision)、召回率(Recall)等。

准确率指模型正确预测的样本数占总样本数的比例。精确率指模型预测为正的样本中,实际为正的比例。召回率指实际为正的样本中,模型正确预测为正的比例。每个指标都有其应用场景,例如,在二分类问题中,准确率、精确率和召回率共同描述模型的预测能力。

```r

# 示例代码块:计算准确率、精确率和召回率

# 假设y_true为真实标签,y_pred为预测标签

y_true <- c(1, 1, 0, 1, 0)

y_pred <- c(1, 0, 0, 1, 0)

# 计算混淆矩阵

conf_matrix <- table(Predicted = y_pred, Actual = y_true)

# 计算准确率

accuracy <- sum(diag(conf_matrix)) / sum(conf_matrix)

# 计算精确率和召回率

precision <- conf_matrix[2, 2] / sum(conf_matrix[2, ])

recall <- conf_matrix[2, 2] / sum(conf_matrix[, 2])

# 输出计算结果

print(paste("Accuracy:", accuracy))

print(paste("Precision:", precision))

print(paste("Recall:", recall))

```

在实际应用中,可能还需要考虑其他更复杂的评价指标,如F1分数、ROC曲线下的面积(AUC)等,具体需要根据问题的性质和分析目标来确定。

# 3. R语言数据集划分的实践技巧

## 3.1 使用基础R函数进行数据划分

### 3.1.1 sample函数的应用

在R语言中,`sample`函数是用来随机抽取数据集中的子集的一个基础而强大的工具。它允许用户通过随机抽样来创建数据集的划分,这对于机器学习的训练集和测试集的划分是十分重要的。例如,如果你想将数据集随机分成80%的训练集和20%的测试集,可以按照以下方式使用`sample`函数:

```r

set.seed(123) # 设置随机数种子以保证结果可重复

indexes <- sample(1:nrow(data), size = 0.8 * nrow(data)) # 随机选取80%的数据索引

training_set <- data[indexes, ] # 选取训练集

testing_set <- data[-indexes, ] # 选取测试集

```

在上面的代码段中,`set.seed`函数用来初始化随机数生成器,以确保每次运行代码时抽取的结果是一致的。`nrow(data)`表示数据集的行数,`size = 0.8 * nrow(data)`表示我们要抽取数据集总数的80%。通过这种方式,我们可以方便地将数据集划分为训练集和测试集。

### 3.1.2 split函数的高级用法

`split`函数在R语言中用于基于某些标准或条件将数据集分割为子集。`split`函数通常与`lapply`函数结合使用,可以针对每个子集执行特定的操作,这在处理分组数据时非常有用。例如,如果你想根据某个因子变量将数据集分割成不同的子集,可以使用如下代码:

```r

# 假设df是数据框,factor_column是分组因子变量

subsets <- split(df, df$factor_column

```

0

0