【数据集划分的随机性】:如何影响模型准确性的8大因素

发布时间: 2024-11-20 02:55:53 阅读量: 7 订阅数: 6

# 1. 数据集划分与模型准确性的关系概述

在机器学习与数据分析的实践中,数据集的划分是构建有效模型的核心步骤之一。本章将概述数据集划分与模型准确性的关系,为理解后续章节内容打下基础。

## 1.1 数据集划分的目的和重要性

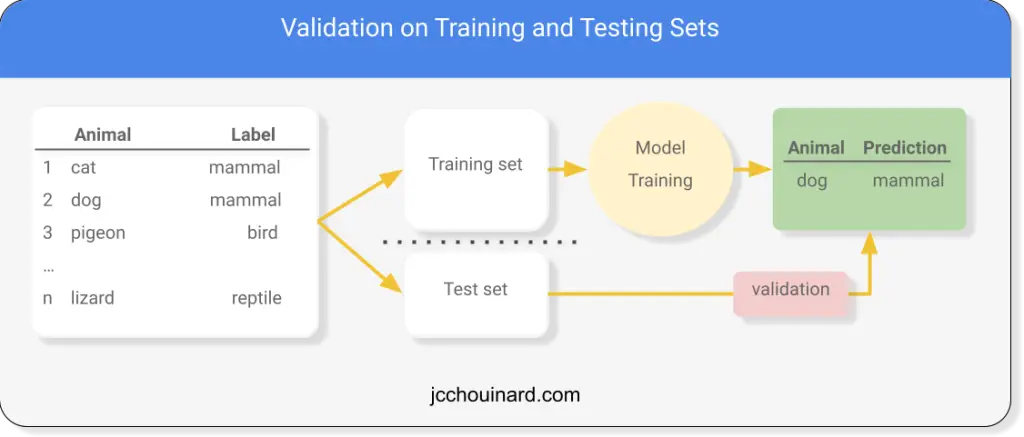

划分数据集的目的是为了在有限的数据条件下,更准确地评估模型的泛化能力。通过将数据分为训练集、验证集与测试集,可以分别用于模型的训练、参数调整和最终性能的评估。

## 1.2 数据集划分对模型性能的影响

数据集划分的质量直接影响模型的性能。不合理的划分可能导致模型在训练集上过拟合或在未知数据上表现不佳。因此,理解数据集划分与模型准确性的关系对于提升模型预测能力至关重要。

## 1.3 随机性的作用与挑战

引入随机性是为了确保模型训练过程的公平性和可重复性。但随机性也可能带来挑战,比如由于划分的不一致性导致模型性能评估的偏差。本章将探讨如何合理利用随机性来平衡模型性能与泛化能力。

# 2. 数据集划分的理论基础

### 2.1 数据集划分的基本概念

#### 2.1.1 训练集、验证集与测试集的定义

在机器学习和深度学习项目中,原始数据集按照特定的比例和策略被划分为训练集(Training Set)、验证集(Validation Set)和测试集(Test Set)三个部分。这样的划分对于模型的开发和评估至关重要。

- **训练集**:这部分数据被用于训练模型,即用来调整模型参数以最小化预测错误。

- **验证集**:在训练过程中,验证集用于模型性能的监控和调参。通过对验证集的预测,可以了解模型对未见过数据的泛化能力。

- **测试集**:测试集在整个模型训练过程结束后才被使用。它是用来进行最终评估的,提供对模型在实际应用中性能的估计。

#### 2.1.2 划分数据集的目的和重要性

划分数据集的主要目的是为了评估模型在新数据上的性能,避免过拟合,并且对模型进行有效的调参。划分数据集的步骤允许我们在构建模型的同时测试它的泛化能力。对模型进行交叉验证时,数据集的划分还可以确保评估的一致性和准确性。

### 2.2 随机性在数据集划分中的作用

#### 2.2.1 随机划分与模型泛化能力

数据集的随机划分是机器学习中的标准做法,它有助于确保训练集、验证集和测试集在统计上彼此独立,从而使模型可以在不同的数据集上都表现出良好的性能。

随机划分有助于:

- **减少偏差**:通过随机分配数据,我们可以确保每个集合都包含相似的数据分布,从而减少由于数据分布不均而导致的偏差。

- **评估泛化能力**:验证集和测试集中的数据在训练过程中是“未知”的,这可以用来评估模型对新数据的泛化能力。

#### 2.2.2 随机种子的设定及其影响

在随机划分数据集时,通常需要设定一个随机种子(Random Seed)。这有助于确保结果的可重复性。不同的随机种子会导致数据分配的不同,从而可能影响模型的训练和最终性能。

- **可重复性**:使用固定的随机种子,其他条件不变的情况下,每次划分数据集和训练模型后,可以得到一致的结果,这对于科学研究和模型调试至关重要。

- **实验控制**:通过改变随机种子,可以在不同的实验设置下评估模型的稳定性。

### 2.3 模型准确性与数据集划分策略

#### 2.3.1 不同划分策略的比较

数据集划分策略包括但不限于:简单的随机划分、分层划分、K折交叉验证等。每种策略都有其独特的特点和适用场景。

- **简单随机划分**:这是最基本的划分方式,其优点在于简单、快速,但可能导致某些类别的数据在不同的数据集中分布不均。

- **分层划分**:在分层划分中,数据集中的每个类别的比例在训练集、验证集和测试集中都保持一致。这种方式特别适用于类别不平衡的数据集。

- **K折交叉验证**:在K折交叉验证中,原始数据集被划分为K个子集。模型在K-1个子集上进行训练,在剩下的一个子集上进行测试。这个过程重复K次,每次使用不同的子集作为测试集。

#### 2.3.2 策略选择对模型性能的影响分析

选择适当的数据集划分策略对于获得模型的准确性和泛化能力至关重要。策略选择不当可能导致过拟合或欠拟合。

- **过拟合风险**:如果训练集包含的数据太少,模型可能无法捕捉到数据的真实分布,从而导致过拟合。

- **欠拟合风险**:如果验证集和测试集的比例过小,评估模型性能的置信度就会降低,可能导致欠拟合。

在接下来的章节中,我们将更深入地探讨随机性对模型准确性影响的实践分析,这将帮助我们更好地理解数据集划分策略的实际效果。

# 3. 随机性对模型准确性影响的实践分析

在数据科学领域,随机性是影响模型训练和预测准确性的重要因素之一。本章节通过实践分析,深入探讨了随机性如何影响模型的准确性,并对相关的影响因素进行了定量分析。我们将从实验设计、数据集准备、实验过程、结果对比和影响因素的定量分析五个方面进行探讨。

## 3.1 实验设计与数据集准备

### 3.1.1 实验目的和假设设定

为了评估随机性对模型准确性的具体影响,本实验的目的设定如下:

- 评估不同随机种子下模型性能的波动性。

- 探究数据集划分策略对随机性影响

0

0