金融计算新篇章:Scipy在风险评估与量化分析中的应用

发布时间: 2024-09-29 21:35:04 阅读量: 104 订阅数: 36

# 1. Scipy简介及在金融计算中的作用

## 1.1 Scipy概述

Scipy是一个开源的Python算法库和数学工具包,集成了众多科学计算的模块,是IT和金融领域数据分析不可或缺的工具。它能够提供高效的数学计算,涵盖了线性代数、优化、统计以及信号处理等多个方面的功能。利用Scipy可以完成从数据处理到复杂模型构建的整个流程。

## 1.2 Scipy在金融计算中的角色

在金融领域,准确和高效的数据处理与计算至关重要。金融数据通常涉及大量的数值运算,传统手工计算不仅效率低下,而且容易出错。Scipy的引入大幅提升了金融计算的速度和准确性,特别在投资组合优化、风险评估、定价模型以及时间序列分析等方面发挥了显著作用。

## 1.3 Scipy应用的实践案例

例如,在风险度量方面,Scipy可以帮助分析师计算投资组合的VaR(Value at Risk),进而指导风险管理和资产配置。在定价模型构建中,Scipy可用于模拟金融衍生品的定价,比如使用蒙特卡洛方法评估期权定价模型的合理性。这些案例说明Scipy不仅是金融工程师的得力助手,也是金融科技创新的重要推动力。

# 2. Scipy在风险评估中的应用

## 2.1 风险评估基础理论

### 2.1.1 风险评估的概念和重要性

风险评估是金融领域中一个不可或缺的环节,其核心目的在于识别潜在的不确定性和损失,并对其可能产生的影响进行量化。它是金融市场决策制定的基础,特别是在投资决策中,了解和评估所涉及的风险对于资产配置、风险管理策略制定以及投资组合的优化至关重要。

### 2.1.2 金融市场的风险类型

金融市场的风险可大致分为系统性风险和非系统性风险。系统性风险是指整个市场共同面临的风险,例如经济衰退、政策变动、自然灾害等因素。这种风险通常难以通过分散投资来规避。非系统性风险是与特定公司或行业相关的风险,通常可以通过投资组合的多样化来分散。

## 2.2 利用Scipy进行风险度量

### 2.2.1 常用风险度量指标

在金融市场中,衡量风险的常用指标包括标准差(Volatility)、贝塔系数(Beta)、VaR(Value at Risk)等。标准差衡量的是资产收益的波动性,贝塔系数衡量的是单个资产相对于整个市场的波动性,而VaR则是一种用来估计在正常市场条件下,给定置信水平下投资组合可能遭受的最大损失。

### 2.2.2 使用Scipy实现风险度量

Scipy库提供了一系列的统计工具,可以帮助我们计算上述风险度量指标。下面是一个使用Scipy计算标准差的示例代码:

```python

import numpy as np

from scipy import stats

# 假设我们有一组投资收益率数据

returns = np.array([0.01, -0.02, 0.03, 0.01, -0.01])

# 使用Scipy计算标准差

std_dev = np.std(returns)

print(f"投资收益率的标准差为: {std_dev}")

# 使用Scipy的stats库计算描述性统计

stats_result = stats.describe(returns)

print(stats_result)

```

在这个例子中,我们首先导入了必要的模块,然后定义了一个代表投资收益率的数组。使用`np.std`函数计算标准差,并使用`stats.describe`函数得到一个包含多种描述性统计结果的对象。这些统计结果可以为投资者提供关于风险的更全面视角。

## 2.3 风险管理策略与案例分析

### 2.3.1 风险分散与组合优化

风险管理的一个关键策略是通过投资组合的分散化来降低非系统性风险。根据马科维茨的现代投资组合理论,通过适当分配资产,可以在给定的风险水平下最大化收益,或在给定的收益水平下最小化风险。Scipy库中的优化函数可以帮助我们实现这一点。

### 2.3.2 实际案例中的Scipy应用

考虑一个简化版的案例,我们使用Scipy库中的`scipy.optimize`模块来优化一个包含两种资产的投资组合。目标是最小化组合的波动性(标准差),同时达到预期的收益率。

```python

from scipy.optimize import minimize

# 假设资产A和B的预期收益率分别为4%和6%,标准差为2%和3%

# 相关系数为0.5

cov_matrix = np.array([[0.02**2, 0.5 * 0.02 * 0.03], [0.5 * 0.02 * 0.03, 0.03**2]])

# 目标函数:最小化投资组合的方差(波动性)

def portfolio_variance(weights):

return np.dot(weights.T, np.dot(cov_matrix, weights))

# 约束条件:权重之和为1,以及每个资产的权重在0到1之间

constraints = [{'type': 'eq', 'fun': lambda x: np.sum(x) - 1},

{'type': 'ineq', 'fun': lambda x: x},

{'type': 'ineq', 'fun': lambda x: 1 - x}]

# 预期收益率为5%

expected_return = 0.05

# 目标是找到达到此收益率时的最小波动性

result = minimize(portfolio_variance, [0.5, 0.5], method='SLSQP', bounds=(0,1), constraints=constraints)

print(f"最小化波动性的资产分配为:资产A占比 {result.x[0]:.2f},资产B占比 {result.x[1]:.2f}")

```

在这个案例中,我们首先定义了一个目标函数,即投资组合的方差,然后定义了约束条件,以确保解的合理性。使用`minimize`函数进行优化,最终得到了在给定预期收益率下的最小波动性资产分配比例。通过此类优化,投资者可以更好地管理其投资组合中的风险。

# 3. Scipy在量化分析中的应用

量化分析是指使用数学模型和统计方法来分析金融市场的行为。它在投资管理、风险管理以及产品定价等多个金融领域中扮演着重要角色。量化分析师依赖于各种工具,其中Python语言及Scipy库因其强大的数学计算能力而广受欢迎。

## 3.1 量化分析基础概念

### 3.1.1 量化分析的定义和目的

量化分析通常是指应用统计学、数学以及计算机科学的原理对金融产品和市场行为进行分析的过程。其目的在于使用数据驱动的方法来制定交易决策,优化投资组合,管理风险,以及预测市场趋势。

### 3.1.2 量化模型的构建和评估

构建量化模型需要收集数据、选择合适的数学模型、开发算法,并通过历史数据对模型进行训练和测试。模型评估的标准通常包括准确性、稳健性、以及可执行性等方面。

## 3.2 利用Scipy构建量化模型

### 3.2.1 时间序列分析与预测

时间序列分析是量化分析中一个关键领域,用于预测未来的市场行为。Scipy库结合NumPy和Pandas,可以实现复杂的统计分析和时间序列处理。

```python

import numpy as np

import pandas as pd

from scipy import stats

# 示例:使用Scipy进行简单的线性回归分析

# 假设df是一个包含时间序列数据的DataFrame,且其中包含"target"和"time"两个字段

df = pd.DataFrame({

'time': np.arange(0, 100),

'target': np.random.normal(0, 1, 100)

})

# 构建线性模型

slope, intercept, r_value, p_value, std_err = stats.linregress(df['time'], df['target'])

# 输出回归参数

print(f"Slope: {slope}")

print(f"Intercept: {intercept}")

print(f"R-square: {r_value**2}")

```

以上代码展示了如何使用Scipy中的`linregress`函数来估计一个简单线性模型,并输出模型参数。这可以帮助我们预测时间序列在未来某一时刻的期望值。

### 3.2.2 金融衍生品定价模型

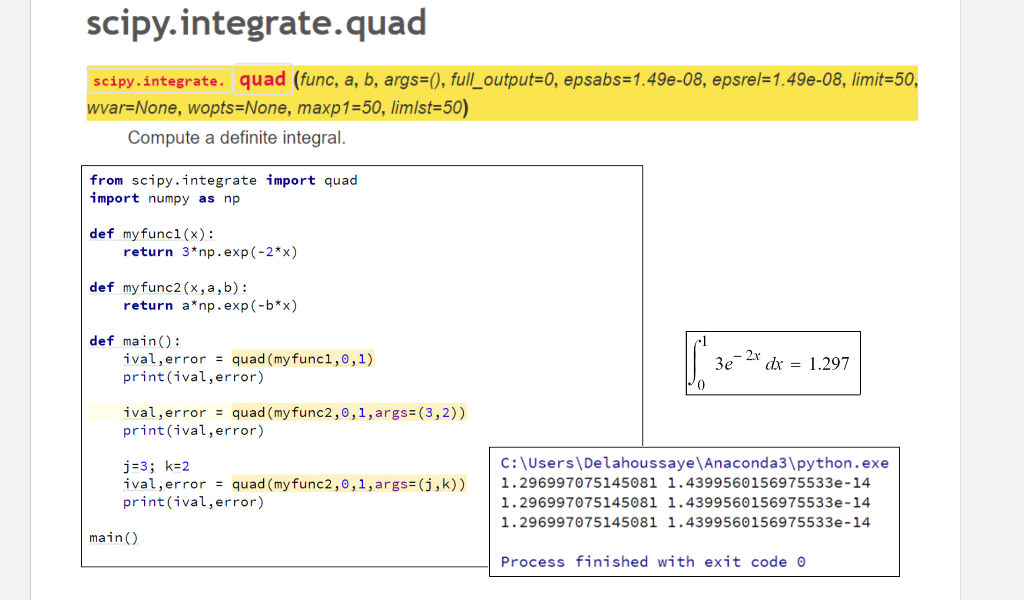

金融衍生品定价模型是量化分析的另一个关键应用领域,通常涉及复杂的随机过程和偏微分方程。Scipy中的`integrate`模块可以用于解决这类问题。

```python

from scipy.inte

```

0

0