信息搜集艺术全攻略:用Kali Linux精准定位目标与数据收集

发布时间: 2024-09-28 09:50:20 阅读量: 32 订阅数: 27

kali Linux运用字典来信息收集

# 1. 信息搜集艺术的理论基础

在信息时代的洪流中,信息搜集已不再是简单的数据堆砌,而是变成了一种艺术。本章将带你深入探讨信息搜集的理论基础,理解其重要性和在数据密集型社会中的核心作用。我们将从信息搜集的定义、其在不同领域的重要性,以及信息搜集过程中的基本原则和方法论入手,逐步构建起一个坚实的理论框架。此外,本章还会探讨信息的分类,包括显性信息和隐性信息,以及信息搜集过程中的数据来源和其真实性的验证方式。这将为你后续章节中掌握具体的工具和技巧,以及在法律伦理范畴内进行有效信息搜集打下坚实的基础。

# 2. Kali Linux入门与设置

### 2.1 Kali Linux的安装和配置

在当今IT安全领域,Kali Linux作为一款专注于安全评估和渗透测试的操作系统,几乎成为这一领域专业人士的标配。其灵活性、功能丰富的工具集,以及开源特性使其成为信息安全领域的宠儿。在本节中,将逐步引导读者完成Kali Linux的安装、基本配置与优化,为后续的安全测试工作打下坚实的基础。

#### 2.1.1 系统安装前的准备

在安装Kali Linux之前,首先要进行一些准备工作。这包括了解系统要求、准备安装介质、备份重要数据以及规划硬盘分区。Kali Linux对硬件要求不高,但至少需要20GB的硬盘空间,1GB的内存,以及一个可以引导的CD/DVD驱动器或者USB接口。

为了安装Kali Linux,需要从官方网站下载ISO映像文件,并使用工具如`dd`命令(对于Linux或macOS)或Rufus(对于Windows)来创建一个启动盘。务必确保下载了适合自己计算机架构的映像文件(例如64位或32位)。

#### 2.1.2 安装Kali Linux的步骤

安装Kali Linux实际上是一个相对简单的过程。以下是基本的安装步骤:

1. **启动安装介质**:重启计算机并从安装介质启动。

2. **选择安装语言和国家**:选择安装过程中使用的语言和时区。

3. **设置键盘布局**:选择合适的键盘布局。

4. **分区硬盘**:根据个人需求对硬盘进行分区,可以选择自动分区或手动分区。

5. **配置网络**:设置网络接口,包括有线和无线。对于无线网络,可能需要手动输入密码。

6. **安装引导加载器**:选择将Grub引导加载器安装在哪个硬盘上。

7. **设置主机名和用户信息**:定义你的计算机名称、域名、根密码等。

8. **软件选择**:选择默认安装的软件包,如果不确定,建议保留默认选择。

9. **完成安装**:最后,确认所有设置无误后,开始安装过程。

安装完成后,系统会提示你重新启动。从硬盘启动进入Kali Linux后,你将看到登录界面,至此Kali Linux的安装已经完成。

#### 2.1.3 基本系统配置与优化

首次登录系统后,推荐进行一些基本的系统配置与优化:

- **更新系统**:

```bash

sudo apt update && sudo apt upgrade -y

```

更新操作确保系统软件包是最新的。

- **安装额外软件包**:

```bash

sudo apt install kali-linux-large -y

```

这个命令会安装额外的工具和应用,以增强Kali的功能。

- **修改源**:

替换软件源为国内源,如阿里云或中科大,以加快软件包下载速度。

- **安装图形化界面**:

如果你更习惯图形界面,可以安装桌面环境,如:

```bash

sudo apt install kali-desktop-gnome -y

```

这会安装Gnome桌面环境。

- **网络配置**:

对于网络安全测试人员,配置多个网络接口和Wi-Fi嗅探工具是常见的需求。

- **性能优化**:

根据硬件配置,可能需要调整一些内核参数来优化系统性能。

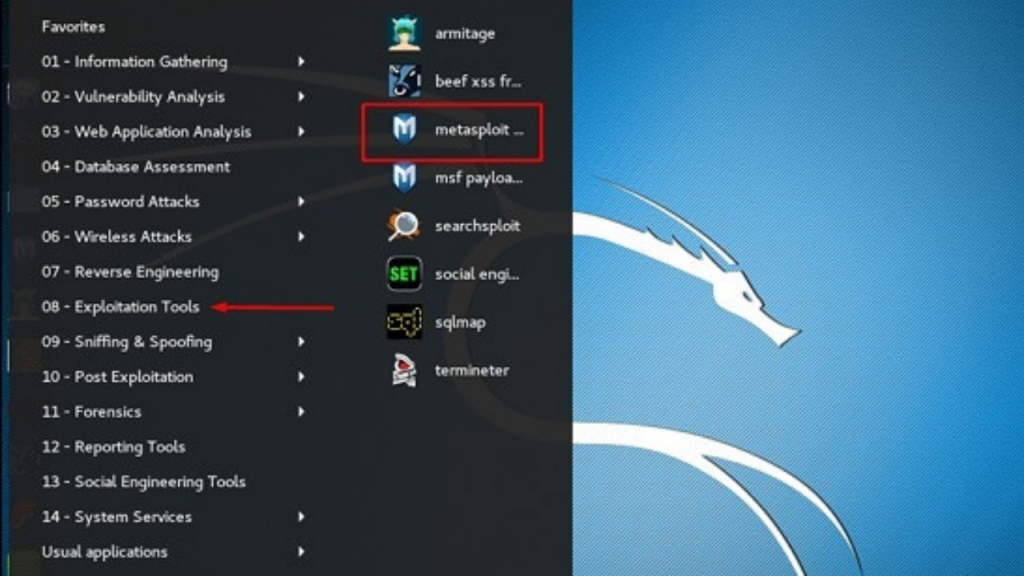

### 2.2 Kali Linux工具概览

Kali Linux集成了大量的安全和渗透测试工具,这些工具被组织成不同的类别,比如信息搜集、Web应用分析、漏洞分析、取证分析等。

#### 2.2.1 核心安全工具介绍

Kali Linux的核心工具包括但不限于以下几种:

- **Metasploit**:用于渗透测试的框架,用于开发和执行攻击。

- **Wireshark**:网络协议分析器,用于监控网络数据流。

- **Nmap**:网络扫描器,用于发现网络上的设备以及它们开放的端口。

- **Burp Suite**:Web应用程序分析工具,用于测试Web应用程序的安全性。

#### 2.2.2 工具分类和应用场景

Kali Linux提供的工具可以根据其功能被分类:

- **信息搜集工具**:如Harvest, Maltego等,用于收集目标的相关信息。

- **漏洞分析工具**:如OpenVAS, Nexpose Community等,用于发现系统安全漏洞。

- **密码破解工具**:如John the Ripper, Hashcat等,用于破解密码。

- **无线网络分析工具**:如Aircrack-ng, Reaver等,用于测试无线网络安全。

每种工具都有其特定的应用场景,作为安全测试人员,了解并掌握这些工具的使用对于提高测试效率和测试质量至关重要。

#### 2.2.3 高级工具的使用技巧

高级工具的使用技巧通常包括:

- **自定义脚本和工具的编写**:了解如何编写Bash或Python脚本来自动化重复性的任务。

- **集成使用多个工具**:将不同工具组合起来形成一个完整的测试流程,例如从Nmap开始发现服务,然后使用Metasploit进行漏洞利用。

- **深度定制工具配置**:调整工具参数以适应特定的测试环境,例如定制Wireshark的过滤规则来识别特定类型的网络流量。

接下来,我将深入探讨如何有效使用Kali Linux进行网络基础知识的学习和扫描技术的掌握,以及如何基于这些知识进行更为复杂的目标定位和数据收集。

# 3. 精准定位目标的技术与方法

在信息搜集的实战中,精准定位目标是至关重要的一步。无论是在合法合规的商业竞争情报收集,还是在防御性或攻击性的安全调查中,了解如何定位目标并高效搜集信息,能够极大提升工作效率并避免不必要的资源浪费。本章节将深入探讨信息搜集过程中目标定位的技术与方法,以及如何通过合法途径获取信息。

## 信息搜集的法律与伦理

在开始任何搜集行动之前,我们必须明确自身的法律与伦理界限。这一部分主要介绍在搜集信

0

0