【LRU缓存算法揭秘】:揭开缓存淘汰机制的奥秘

发布时间: 2024-08-25 21:46:35 阅读量: 23 订阅数: 25

# 1. LRU缓存算法简介

LRU(最近最少使用)缓存算法是一种广泛应用于计算机系统中的缓存管理策略。其核心思想是将最近最少使用的缓存数据淘汰,为新数据腾出空间。LRU算法通过维护一个有序列表或哈希表来记录缓存数据的访问时间,从而实现高效的淘汰操作。

# 2. LRU缓存算法的理论基础

### 2.1 缓存命中率与淘汰策略

缓存命中率是指从缓存中成功获取数据的比率。它反映了缓存的有效性,命中率越高,表明缓存越有效。

淘汰策略决定了当缓存已满时如何选择要淘汰的数据。常见的淘汰策略有:

- **先进先出 (FIFO)**:淘汰最早进入缓存的数据。

- **最近最少使用 (LRU)**:淘汰最近最少使用的数据。

- **最近最不经常使用 (LFU)**:淘汰最近使用频率最低的数据。

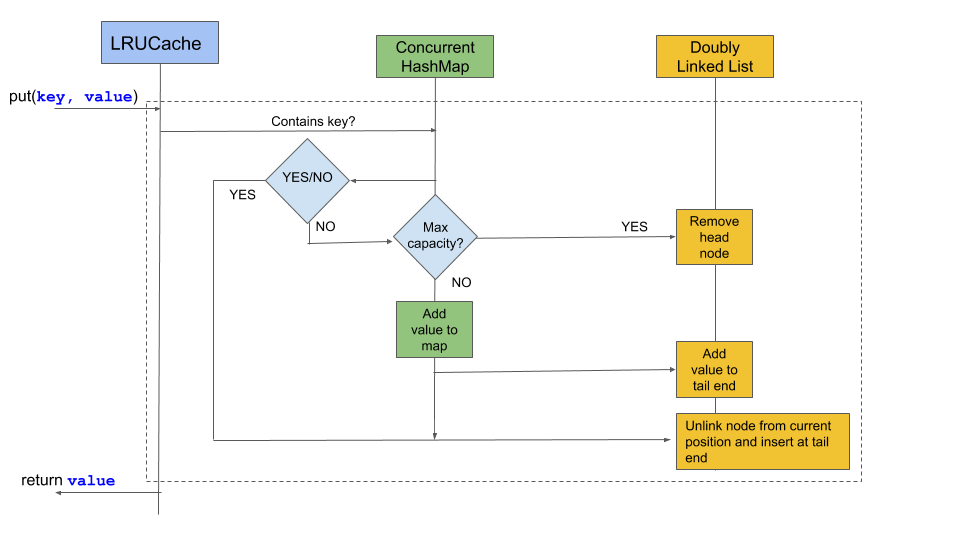

### 2.2 LRU算法的原理和实现

LRU算法是一种淘汰策略,它淘汰最近最少使用的数据。其原理是维护一个双向链表,其中每个节点代表一个缓存项。当数据被访问时,其对应的节点被移动到链表头部,而最近最少使用的节点被淘汰。

**实现:**

```python

class Node:

def __init__(self, key, value):

self.key = key

self.value = value

self.prev = None

self.next = None

class LRUCache:

def __init__(self, capacity):

self.capacity = capacity

self.cache = {}

self.head = Node(None, None)

self.tail = Node(None, None)

self.head.next = self.tail

self.tail.prev = self.head

def get(self, key):

if key in self.cache:

node = self.cache[key]

self.remove_node(node)

self.add_node(node)

return node.value

else:

return None

def put(self, key, value):

if key in self.cache:

self.remove_node(self.cache[key])

node = Node(key, value)

self.add_node(node)

if len(self.cache) > self.capacity:

self.remove_node(self.tail.prev)

def add_node(self, node):

node.next = self.head.next

self.head.next.prev = node

self.head.next = node

node.prev = self.head

self.cache[node.key] = node

def remove_node(self, node):

node.prev.next = node.next

node.next.prev = node.prev

del self.cache[node.key]

```

**逻辑分析:**

- `get` 方法:如果数据在缓存中,则将其移动到链表头部并返回其值。否则,返回 `None`。

- `put` 方法:如果数据已存在,则将其移动到链表头部。否则,创建一个新节点并将其添加到链表头部。如果缓存已满,则淘汰链表尾部的节点。

- `add_node` 方法:将节点添加到链表头部。

- `remove_node` 方法:从链表中删除节点。

# 3. LRU缓存算法的实践应用

### 3.1 LRU算法在操作系统中的应用

**虚拟内存管理**

LRU算法广泛应用于虚拟内存管理中,用于决定哪些内存页应该被换出到磁盘。当物理内存不足时,操作系统会使用LRU算法识别出最长时间未使用的内存页,并将它们换出到磁盘,为新加载的程序或数据腾出空间。

**文件系统缓存**

LRU算法也用于文件系统缓存中。当操作系统读取文件时,它会将文件数据缓存在内存中,以提高后续访问的速度。LRU算法可确保经常访问的文件数据保留在缓存中,而较少访问的数据则被淘汰。

### 3.2 LRU算法在数据库中的应用

**查询缓存**

LRU算法在数据库中用于缓存查询结果。当数据库收到一个查询时,它会首先检查缓存中是否有该查询的结果。如果存在,则直接返回缓存结果,从而减少数据库的查询时间。LRU算法可确保经常执行的查询结果保留在缓存中,而较少执行的查询结果则被淘汰。

**索引缓存**

LRU算法还用于索引缓存中。数据库索引是用于快速查找数据的结构。LRU算法可确保经常访问的索引保留在缓存中,从而提高数据库的查询性能。

#### 代码示例:LRU算法在Redis中的应用

```python

import collections

class LRUCache:

def __init__(self, capacity):

self.capacity = capacity

self.cache = collections.OrderedDict()

def get(self, key):

if key in self.cache:

value = self.cache.pop(key)

self.cache[key] = value

return value

else:

return None

def put(self, key, value):

if key in self.cache:

self.cache.pop(key)

self.cache[key] = value

if len(self.cache) > self.capacity:

self.cache.popitem(last=False)

```

**逻辑分析:**

此代码实现了LRU算法在Redis中的应用。`LRUCache`类初始化时,指定了缓存容量。`get`方法用于获取缓存中的值,如果存在,则将该值移到缓存的末尾,表示最近使用。`put`方法用于将键值对添加到缓存中,如果缓存已满,则淘汰最长时间未使用的键值对。

#### 表格:LRU算法在不同应用中的比较

| 应用 | 缓存对象 | 淘汰策略 |

|---|---|---|

| 操作系统 | 内存页 | LRU |

| 文件系统 | 文件数据 | LRU |

| 数据库 | 查询结果 | LRU |

| 数据库 | 索引 | LRU |

#### Mermaid格式流程图:LRU算法在操作系统中的应用

```mermaid

sequenceDiagram

participant User

participant Operating System

User->Operating System: Request data

Operating System->Operating System: Check cache

Operating System->Operating System: Cache hit?

no->Operating System: Load data from disk

yes->Operating System: Return data from cache

```

**流程图说明:**

此流程图描述了LRU算法在操作系统中的应用。当用户请求数据时,操作系统首先检查缓存中是否有该数据。如果存在,则直接返回缓存数据。如果不存在,则操作系统从磁盘加载数据并更新缓存。

# 4. LRU缓存算法的优化与扩展

### 4.1 LRU算法的变种:LFU和LRU-K

**LFU(Least Frequently Used)算法**

LFU算法与LRU算法类似,但它跟踪的是页面被访问的频率,而不是最近访问的时间。当缓存已满时,LFU算法会淘汰访问频率最低的页面。

**优点:**

* 对于经常访问的页面,LFU算法的命中率更高。

* 避免了LRU算法中可能出现的“Belady异常”问题(即最近访问的页面可能不是最常访问的页面)。

**缺点:**

* 需要维护每个页面的访问计数器,这会增加开销。

* 对于访问频率相近的页面,LFU算法的性能不如LRU算法。

**LRU-K算法**

LRU-K算法是LRU算法的扩展,它允许在淘汰页面时考虑最近K次访问。当缓存已满时,LRU-K算法会淘汰最近K次访问中访问次数最少的页面。

**优点:**

* 结合了LRU和LFU算法的优点,既考虑了最近访问时间,也考虑了访问频率。

* 避免了LRU算法中可能出现的“Belady异常”问题。

**缺点:**

* 需要维护每个页面的访问计数器,这会增加开销。

* K值的选择需要根据实际情况进行调整,否则可能会影响性能。

### 4.2 LRU算法的并行化和分布式实现

**并行化实现**

在多核处理器系统中,LRU算法可以并行化实现,以提高性能。并行化实现可以采用以下方法:

* **多队列LRU算法:**将缓存分成多个队列,每个队列由一个线程管理。当一个页面被访问时,它会被添加到相应的队列中。淘汰操作也在每个队列中并行进行。

* **锁分段LRU算法:**将缓存分成多个段,每个段由一个锁保护。当一个页面被访问时,它会被添加到相应的段中。淘汰操作在每个段中并行进行,但需要对段进行加锁。

**分布式实现**

在分布式系统中,LRU算法可以分布式实现,以支持大规模缓存。分布式实现可以采用以下方法:

* **一致性哈希LRU算法:**使用一致性哈希算法将页面映射到不同的缓存节点。每个缓存节点维护自己的LRU缓存,并负责处理映射到该节点的页面。

* **分布式LRU算法:**使用分布式数据结构(如Redis)来维护LRU缓存。每个缓存节点维护缓存的一部分,并与其他节点协作进行淘汰操作。

### 代码示例

**LFU算法的Python实现:**

```python

class LFUCache:

def __init__(self, capacity):

self.capacity = capacity

self.cache = {} # {key: (value, frequency)}

self.frequency_map = {} # {frequency: [keys]}

def get(self, key):

if key in self.cache:

value, frequency = self.cache[key]

self.update_frequency(key, frequency)

return value

return None

def put(self, key, value):

if self.capacity <= 0:

return

if key in self.cache:

self.update_frequency(key, self.cache[key][1])

self.cache[key] = (value, self.cache[key][1] + 1)

else:

if len(self.cache) == self.capacity:

self.evict_least_frequently_used()

self.cache[key] = (value, 1)

self.frequency_map[1] = [key]

def update_frequency(self, key, frequency):

self.frequency_map[frequency].remove(key)

if len(self.frequency_map[frequency]) == 0:

del self.frequency_map[frequency]

self.frequency_map.setdefault(frequency + 1, []).append(key)

def evict_least_frequently_used(self):

min_frequency = min(self.frequency_map.keys())

key = self.frequency_map[min_frequency].pop(0)

del self.cache[key]

```

**LRU-K算法的C++实现:**

```cpp

class LRUKCache {

public:

LRUKCache(int capacity, int k) : capacity(capacity), k(k) {

head = new Node(-1, -1);

tail = new Node(-1, -1);

head->next = tail;

tail->prev = head;

}

int get(int key) {

Node* node = find_node(key);

if (node == nullptr) {

return -1;

}

update_node(node);

return node->value;

}

void put(int key, int value) {

Node* node = find_node(key);

if (node != nullptr) {

update_node(node);

node->value = value;

return;

}

if (size == capacity) {

remove_least_recently_used();

}

Node* new_node = new Node(key, value);

add_node(new_node);

size++;

}

private:

struct Node {

int key;

int value;

Node* prev;

Node* next;

Node(int key, int value) : key(key), value(value), prev(nullptr), next(nullptr) {}

};

int capacity;

int k;

int size = 0;

Node* head;

Node* tail;

Node* find_node(int key) {

Node* curr = head->next;

while (curr != tail) {

if (curr->key == key) {

return curr;

}

curr = curr->next;

}

return nullptr;

}

void update_node(Node* node) {

Node* prev = node->prev;

Node* next = node->next;

prev->next = next;

next->prev = prev;

add_node(node);

}

void add_node(Node* node) {

Node* prev = tail->prev;

prev->next = node;

node->prev = prev;

node->next = tail;

tail->prev = node;

}

void remove_least_recently_used() {

Node* node = head->next;

int min_frequency = INT_MAX;

while (node != tail) {

if (node->key != -1) {

min_frequency = min(min_frequency, node->value);

}

node = node->next;

}

node = head->next;

while (node != tail) {

if (node->key != -1 && node->value == min_frequency) {

remove_node(node);

size--;

return;

}

node = node->next;

}

}

void remove_node(Node* node) {

Node* prev = node->prev;

Node* next = node->next;

prev->next = next;

next->prev = prev;

delete node;

}

};

```

# 5.1 缓存命中率和访问时间分析

LRU缓存算法的性能主要体现在缓存命中率和访问时间两个方面。

**缓存命中率**

缓存命中率是指从缓存中获取数据成功与否的比率。命中率越高,表明缓存的效率越高。

**访问时间**

访问时间是指从缓存中获取数据所花费的时间。访问时间越短,表明缓存的性能越好。

**分析方法**

为了分析LRU缓存算法的性能,可以采用以下方法:

1. **模拟测试:**使用模拟器或测试框架模拟缓存的实际运行情况,记录缓存命中率和访问时间数据。

2. **分析模型:**建立缓存的数学模型,推导出命中率和访问时间的理论表达式。

3. **实际测量:**在实际系统中部署缓存,并通过性能监控工具测量命中率和访问时间数据。

**影响因素**

影响LRU缓存算法性能的因素主要有:

- **缓存大小:**缓存越大,命中率越高,但访问时间可能较长。

- **淘汰策略:**不同的淘汰策略(如LRU、LFU)会影响命中率和访问时间。

- **数据访问模式:**数据的访问模式(如随机访问、顺序访问)也会影响命中率。

- **硬件架构:**缓存的硬件架构(如多级缓存、并行缓存)也会影响访问时间。

**优化策略**

为了优化LRU缓存算法的性能,可以采取以下策略:

- **调整缓存大小:**根据数据访问模式和系统资源合理调整缓存大小。

- **选择合适的淘汰策略:**根据数据访问模式选择合适的淘汰策略,如LRU、LFU等。

- **并行化和分布式实现:**对于大规模数据访问,可以采用并行化和分布式实现方式来提高访问性能。

0

0