【案例研究】:图像合成的黑科技:GAN在实际中的强大应用

发布时间: 2024-09-01 14:54:42 阅读量: 106 订阅数: 60

# 1. 图像合成与生成对抗网络(GAN)概述

## 1.1 GAN的诞生背景与定义

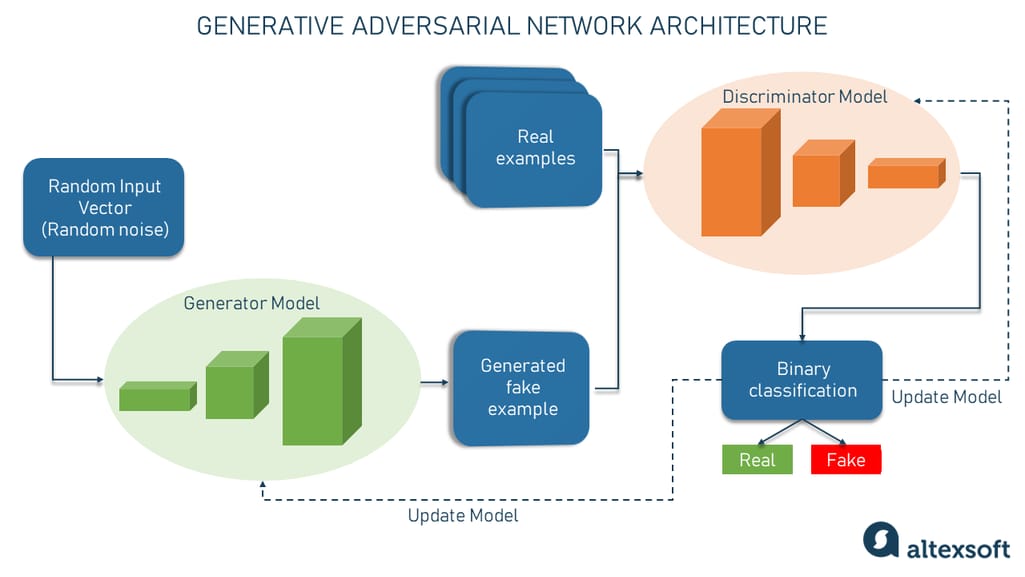

生成对抗网络(GAN)是由Ian Goodfellow于2014年提出的一种深度学习模型。它通过两个网络——生成器(Generator)和判别器(Discriminator)的对弈学习,实现生成逼真的数据分布。GAN在图像合成、视频生成、文本生成等多个领域展现出巨大潜力,成为目前最前沿的AI技术之一。

## 1.2 GAN的基本原理和架构

GAN的核心思想来源于博弈论中的零和游戏,生成器尝试生成尽量接近真实数据的样本,而判别器则尝试区分真实数据和生成的数据。这一过程迭代进行,使生成器不断学习以改进其生成的图像质量。

```python

# 示例:一个简单GAN的代码框架

class Generator:

# ...生成器定义...

class Discriminator:

# ...判别器定义...

# 训练GAN

for epoch in range(num_epochs):

# 生成器训练步骤

# 判别器训练步骤

```

## 1.3 GAN的应用范围与挑战

GAN不仅在图像合成上取得了巨大成功,还被广泛应用于风格迁移、图像修复、数据增强等领域。尽管如此,GAN的训练不稳定、模式崩溃以及评估标准的不完善等问题,仍然是研究人员亟待解决的挑战。

通过后续章节的深入分析,我们将探索如何在实际中应用GAN以及如何优化和改进这些模型,使之在各种应用中发挥更大的作用。

# 2. 生成对抗网络(GAN)的理论基础

生成对抗网络(GAN)是一种深度学习模型,其核心思想是通过对抗过程实现无监督学习。在GAN中,两个神经网络相互竞争,相互促进,最终共同进步。这一章节将探讨GAN的基本原理和架构,解读其关键技术和改进方法,并介绍评估GAN性能的标准和度量方法。

## 2.1 GAN的基本原理和架构

### 2.1.1 GAN的工作机制

GAN的工作机制非常独特,它由两个主要的神经网络组成:生成器(Generator)和判别器(Discriminator)。生成器负责生成尽可能接近真实数据的假数据,而判别器则负责尽可能准确地区分真实数据和假数据。在训练过程中,生成器和判别器相互对抗,生成器不断学习改进以生成更逼真的数据,而判别器则提升其辨识能力。通过这种对抗机制,GAN可以生成高质量的数据,用于图像合成、数据增强等多个领域。

### 2.1.2 GAN的主要组成部分:生成器与判别器

生成器的目标是创建出足以以假乱真的数据。它通常是一个卷积神经网络(CNN),通过反复调整网络权重,学会如何从随机噪声中生成复杂的数据分布。判别器则是一个二分类器,负责区分输入的数据是来自真实数据集还是生成器。在训练过程中,生成器和判别器交替进行训练,直到达到一个均衡状态,此时判别器无法区分真实数据和生成数据,而生成器则能够生成高质量的假数据。

## 2.2 GAN的关键技术和改进方法

### 2.2.1 损失函数与训练稳定性

在GAN的训练过程中,损失函数的选择对模型的稳定性和最终效果至关重要。原始的GAN使用交叉熵损失函数,但随着研究深入,出现了一系列改进的损失函数,如Wasserstein损失(WGAN)和感知损失(Perceptual Loss)。WGAN通过引入Wasserstein距离,减少了训练过程中的模式崩溃问题,使得GAN的训练更加稳定。感知损失则利用预训练的卷积神经网络来度量图像内容的质量,从而提高生成图像的逼真度。

### 2.2.2 条件GAN与模式崩溃问题

条件GAN(Conditional GAN,CGAN)在原始GAN的基础上引入了条件变量,允许根据给定的条件信息生成特定类别的数据。例如,在图像合成中,条件信息可以是标签、文本描述或其他图像,使得生成的图像不仅逼真,而且符合给定的条件。模式崩溃(Mode Collapse)是GAN训练过程中可能遇到的一个问题,即生成器产生有限数量的输出,不能覆盖所有可能的数据模式。通过引入条件信息,可以有效缓解模式崩溃问题。

### 2.2.3 深入理解GAN的变体

自从GAN被提出以来,它的变体层出不穷,每一项改进都在特定领域内取得了显著成果。DCGAN(Deep Convolutional Generative Adversarial Networks)是首个将卷积神经网络应用于GAN的成功案例,它引入了卷积层和反卷积层,显著提升了图像生成的质量和速度。Progressive GAN进一步提升了图像的分辨率和质量,通过逐渐增加网络深度的方式训练GAN,使得模型能够生成高分辨率的图像。此外,StyleGAN通过引入风格控制,让生成的图像具有不同的风格和特征。

## 2.3 GAN的评估标准和度量方法

### 2.3.1 定性和定量的评估指标

GAN模型的评估可以通过定性和定量两种方式进行。定性评估通常依赖于人工观察和主观评价,观察生成的图像是否真实,是否有意义。而定量评估则需要依据客观指标,比如Inception Score(IS)和Fréchet Inception Distance(FID)。IS用于衡量生成图像的多样性和质量,FID则是通过计算真实图像和生成图像特征分布的距离来评估模型性能。

### 2.3.2 不同应用中GAN的评估策略

在不同的应用领域中,GAN的评估策略也有所差异。在图像合成中,除了上述的IS和FID之外,还可以使用图像重建的精确度、内容的一致性等指标。在医疗成像领域,评估标准会更加注重模型对病理特征的识别和再现能力。而在艺术创作中,模型的创意性和新颖性也是重要的评估因素。

[下节预告]

第三章:GAN在图像合成中的实践应用

3.1 图像到图像的翻译(Pix2Pix)

3.1.1 Pix2Pix的基本流程

3.1.2 Pix2Pix的应用案例分析

3.2 无监督学习的图像合成

3.2.1 CycleGAN和其创新点

3.2.2 无监督学习下的风格转换

3.3 超分辨率和图像增强

3.3.1 SRGAN和ESRGAN的原理和效果

3.3.2 图像去噪和超分辨率的实际应用

# 3. GAN在图像合成中的实践应用

在这一章节中,我们将深入了解生成对抗网络(GAN)在图像合成领域的多种应用实践,并探讨其实践中的具体技术细节。我们会从Pix2Pix这一图像到图像的翻译技术开始,进一步探讨无监督学习下的图像合成,以及超分辨率和图像增强技术。每一部分都将通过案例分析和详细的技术讨论,展现GAN在图像合成应用中的实际效果和应用潜力。

## 3.1 图像到图像的翻译(Pix2Pix)

### 3.1.1 Pix2Pix的基本流程

Pix2Pix模型是GAN在图像到图像翻译方面的一个经典应用。其基本流程首先是准备一对成对的图像数据作为训练集。比如,在建筑图像的风格转换中,训练集会包含一组包含原始建筑照片和相应线稿的成对图像。

在训练过程中,Pix2Pix模型使用一个卷积神经网络(CNN)作为生成器,来将输入的图像(例如线稿)翻译成目标图像(例如相应的建筑照片)。同时,另一个网络作为判别器,来区分生成的图像和真实的图像。通过交替的优化过程,生成器逐渐学习如何产生越来越逼真的图像,而判别器则学习越来越精确地识别真假。

### 3.1.2 Pix2Pix的应用案例分析

一个典型的Pix2Pix应用案例是对卫星图像进行街道视图的转换。在这个案例中,生成器将卫星图像转换为等效的街道视图,而判别器则判断这些街道视图是否与真实街道视图一致。通过大量的训练数据,生成器能够学会模拟真实的街道布局和纹理,从而为城市规划和地图制作提供有力的辅助。

以下是一个简化的代码示例,展示了如何使用PyTorch框架实现一个基本的Pix2Pix模型:

```python

import torch

import torch.nn as nn

class Pix2PixGenerator(nn.Module):

def __init__(self):

super(Pix2PixGenerator, self).__init__()

# Define layers in generator

self.conv1 = nn.Conv2d(in_channels=1, out_channels=64, kernel_size=4, stride=2, padding=1)

# ... (更多的卷积层和其他层定义)

self.conv2 = nn.Conv2d(in_channels=64, out_channels=1, kernel_size=4, stride=2, padding=1)

def forward(self, x):

x = torch.relu(self.conv1(x))

# ... (通过多个卷积层的正向传播)

x = torch.tanh(self.conv2(x))

return x

# 实例化生成器并进行前向传播

generator = Pix2PixGenerator()

output_image = generator(input_image)

```

在这个例子中,`Pix2PixG

0

0