Python遗传算法的并行计算:提高性能的最新技术与实现指南

发布时间: 2024-11-17 13:32:45 阅读量: 65 订阅数: 49

Python遗传算法简介-世界,您好!

# 1. 遗传算法基础与并行计算概念

遗传算法是一种启发式搜索算法,模拟自然选择和遗传学原理,在计算机科学和优化领域中被广泛应用。这种算法在搜索空间中进行迭代,通过选择、交叉(杂交)和变异操作,逐步引导种群进化出适应环境的最优解。并行计算则是指使用多个计算资源同时解决计算问题的技术,它能显著缩短问题求解时间,提高计算效率。当遗传算法与并行计算结合时,可以处理更为复杂和大规模的优化问题,其并行化的核心是减少计算过程中的冗余和依赖,使得多个种群或子种群可以独立进化,然后同步或异步地共享信息。在这一章中,我们将从理论和概念层面深入了解遗传算法和并行计算的基础知识,为后续章节的实践和技术实现打下坚实基础。

# 2. Python遗传算法的理论基础

## 2.1 遗传算法的主要构成和运行原理

### 2.1.1 种群初始化和个体表示

在遗传算法中,每个个体通常表示为一个解的编码,这个编码可以是二进制串、整数串、实数串或其他形式的字符串。种群的初始化是遗传算法开始的一步,种群的大小通常由问题的复杂性来决定,种群中的个体越多样,算法越可能搜索到全局最优解。

初始化种群时,需要遵循一定的策略来确保种群的多样性。例如,可以使用随机初始化方法,其中每个个体的基因是随机生成的。另一种方法是利用问题领域的知识来设计初始种群,以期提高搜索效率。

代码块演示随机初始化一个种群的Python代码示例:

```python

import numpy as np

# 假设问题解空间是实数空间,定义一个个体的长度

gene_length = 10

# 定义种群大小

population_size = 100

# 随机初始化种群

def initialize_population(size, length):

return np.random.rand(size, length)

# 示例初始化

initial_population = initialize_population(population_size, gene_length)

```

在这段代码中,我们使用`numpy`库创建了一个初始种群,其中每个个体是一个长度为`gene_length`的实数数组。对于每个基因,我们使用`np.random.rand()`函数生成一个0到1之间的随机浮点数。这仅仅是一个初始化方法的示例,根据问题的不同,个体的表示方法和初始化方法也会相应变化。

### 2.1.2 选择、交叉和变异操作

遗传算法通过模拟自然选择过程进行优化。选择(Selection)、交叉(Crossover)和变异(Mutation)是遗传算法的三个基本操作。

选择操作用来模拟“适者生存”的原则,即更适应环境的个体有更高的几率被选中,以产生后代。常见的选择方法有轮盘赌选择、锦标赛选择等。轮盘赌选择根据个体适应度与其在总种群中适应度之比来分配选择概率,适应度越高的个体被选择的可能性越大。

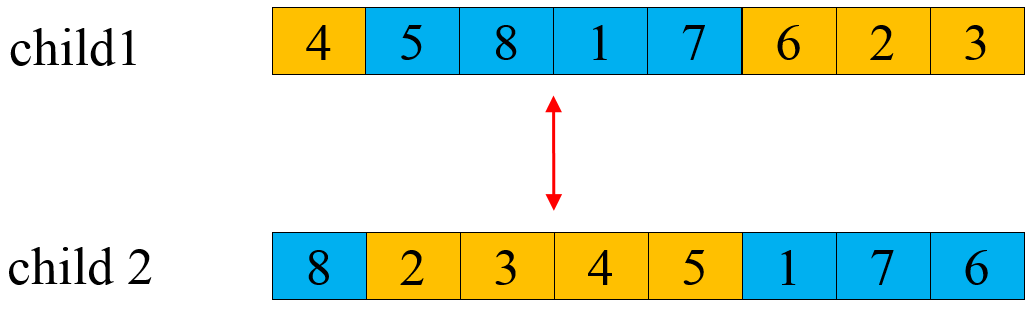

交叉操作是模拟生物基因交叉重组的过程,它是遗传算法中产生新个体的主要方式。交叉操作通常发生在一对选中的个体之间,通过交换它们的部分基因来产生后代。例如,在二进制编码的情况下,单点交叉操作就是随机选择一个交叉点,然后在这一点上交换两个个体的基因串。

变异操作则是模拟基因突变,是引入新基因并维持种群多样性的手段。变异通常是随机地改变个体中的一个或多个基因,这可以防止算法早熟收敛于局部最优解。变异概率需要精心设置,以平衡探索和开发。

代码块展示轮盘赌选择和单点交叉操作的Python代码示例:

```python

# 轮盘赌选择

def roulette_wheel_selection(population, fitness):

total_fitness = sum(fitness)

selection_probs = [f/total_fitness for f in fitness]

selected_indices = np.random.choice(range(len(population)), size=len(population), p=selection_probs)

return population[selected_indices]

# 单点交叉

def single_point_crossover(parent1, parent2):

crossover_point = np.random.randint(1, len(parent1)-1)

child1 = np.concatenate((parent1[:crossover_point], parent2[crossover_point:]))

child2 = np.concatenate((parent2[:crossover_point], parent1[crossover_point:]))

return child1, child2

# 示例

selected_parents = roulette_wheel_selection(initial_population, fitness)

child1, child2 = single_point_crossover(selected_parents[0], selected_parents[1])

```

在这段代码中,我们首先通过`fitness`数组表示每个个体的适应度,然后使用轮盘赌选择方法选择了两个个体。接着,我们定义了`single_point_crossover`函数,它执行单点交叉操作产生两个后代。这只是一个简单的示例,实际操作中需要对每个个体进行交叉操作以产生新的种群。

## 2.2 遗传算法的性能评估与优化

### 2.2.1 收敛性分析

收敛性是指遗传算法在有限的迭代次数内能够稳定地找到问题的最优解或近似最优解的特性。评估遗传算法的收敛性需要从迭代过程中的最优解质量、种群的多样性以及算法的稳定性等方面进行分析。

在分析过程中,通常会记录每一代的最好适应度值,并绘制适应度值随迭代次数变化的曲线图。理想情况下,随着迭代次数的增加,适应度曲线应该趋于平稳,并接近问题的最优解。如果适应度曲线出现大幅波动,可能意味着算法的收敛性不佳,或者在搜索过程中出现了早熟收敛的情况。

代码块展示收敛性分析的Python代码示例:

```python

import matplotlib.pyplot as plt

# 假设这是迭代过程中记录的最优适应度值列表

best_fitness = [0.2, 0.4, 0.6, 0.7, 0.9, 0.85, 0.87, 0.86, 0.88]

# 绘制收敛性曲线

plt.plot(best_fitness, label='Best Fitness per Generation')

plt.title('Convergence Analysis of Genetic Algorithm')

plt.xlabel('Generation')

plt.ylabel('Best Fitness Value')

plt.legend()

plt.show()

```

在这个示例中,我们使用`matplotlib`库绘制了适应度曲线图,通过观察曲线的趋势,可以大致判断算法的收敛情况。当然,在实际应用中,需要结合具体问题和适应度计算方法来评估收敛性。

### 2.2.2 参数调优策略

遗传算法的性能高度依赖于其参数设置,包括种群大小、交叉概率、变异概率、选择策略等。适当的参数设置是获得优秀解的关键。参数调优通常需要根据具体问题和经验进行。

一个常见的参数调优策略是使用网格搜索(Grid Search)来探索参数组合。通过设置参数值的范围,可以尝试多个不同的组合,然后根据算法在一定次数迭代后的解的质量来选择最佳参数组合。

此外,还可以使用更先进的参数调优方法,如贝叶斯优化、遗传算法等,这些方法可以更有效地在参数空间中搜索最优解。

代码块展示一个简单的网格搜索参数调优Python代码示例:

```python

from sklearn.model_selection import GridSearchCV

from sklearn.svm import SVC

# 假设我们有一个分类问题,使用SVM分类器进行参数调优

param_grid = {

'C': [0.1, 1, 10],

'gamma': ['scale', 'auto'],

'kernel': ['rbf', 'linear']

}

svc = SVC()

grid_search = GridSearchCV(svc, param_grid, cv=5)

grid_search.fit(X_train, y_train)

print("Best parameters set found on development set:")

print(grid_search.best_params_)

```

在这个示例中,我们使用`sklearn.model_selection`中的`GridSearchCV`方法对支持向量机(SVM)分类器的参数进行了网格搜索。通过这种方式,我们可以找到一组在交叉验证集上表现最佳的参数,进而应用于遗传算法的参数调优过程中。

## 2.3 理论与实践的结合:案例分析

### 2.3.1 问题定义与目标函数构建

在实践中,应用遗传算法解决具体问题的第一步是定义问题并构建目标函数。目标函数是一个评价个体适应度的标准,它会根据问题的具体要求来计算某个个体的适应度值。

例如,在旅行商问题(TSP)中,目标函数是计算旅行路径的总长度,算法的目标是找到一条总长度最短的路径。又如,在函数优化问题中,目标函数可能是某个数学函数,需要找到该函数的最大值或最小值。

代码块展示一个简单的优化问题目标函数构建的Python代码示例:

```python

# 目标函数示例:一个简单的二次函数优化问题

def objective_function(x):

return x**2 + 10*sin(5*x) + 1

# 绘制目标函数图像

x_values = np.linspace(-10, 10, 100)

y_values = [objective_function(x) for x in x_values]

plt.plot(x_values, y_values)

plt.xlabel('x')

plt.ylabel('Objective Function Value')

plt.title('Example Objective Function')

plt.show()

```

在这个示例中,我们定义了一个二次函数作为目标函数。通过绘制这个函数的图像,我们可以直观地看到函数的形态,并确定寻找最优解的大致方向。在实际应用中,目标函数可能更为复杂,并需要考虑问题的约束条件。

### 2.3.2 案例实践与结果讨论

案例实践是将遗传算法应用到特定问题中,进行实际的解算,并对结果进行分析。通过实践,可以检验算法的性能,包括它对问题的适应性、求解的准确性、运行的效率等。

在实际案例中,首先需要根据问题定义初始化种群,并选择合适的遗传算法参数。然后,通过迭代过程对种群进行选择、交叉和变异操作,逐步演化出更优秀的解。

执行完毕后,需要对算法得到的结果进行评估,分析其是否满足问题要求。结果评估可以基于目标函数值,也可以是问题其他相关的评估指标。

案例结果讨论则需要分析算法在实践中的表现,例如,在收敛速度、求解质量、运行时间等方面的表现,并根据分析结果给出可能的改进建议。

代码块演示遗传算法求解一个简单优化问题的Python代码示例:

```python

# 遗传算法求解目标函数的Python代码示例

from deap import algorithms, base, creator, tools, gp

# 定义目标函数

creator.create("FitnessMax", base.Fitness, weights=(1.0,))

creator.create("Individual", list, fitness=creator.FitnessMax)

# 注册遗传算法的操作

toolbox = base.Toolbox()

toolbox.register("expr", gp.genHalfAndHalf, pset=gp.PrimitivesSet("MAIN", 1), min_=1, max_=2)

toolbox.register("individual", tools.initIterate, creator.Individual, toolbox.expr)

toolbox.register("population", tools.initRepeat, list, toolbox.individual)

toolbox.register("compile", ***pile, pset=gp.PrimitivesSet("MAIN", 1))

# 适应度函数

def evalSymbReg(individual):

func = ***pile(expr=individual)

# 假设我们的目标函数为x^4 + x^3 + x^2 + x

return sum(func(x) for x in [-1, -0.5, 0, 0.5, 1]),

toolbox.register("evaluate", evalSymbReg)

toolbox.register("select", tools.selTournament, tournsize=3)

toolbox.register

```

0

0