预测区间的优化:损失函数的选择与调整

发布时间: 2024-11-25 05:31:40 阅读量: 22 订阅数: 43

# 1. 预测区间与损失函数概述

在机器学习和统计建模中,预测区间和损失函数是两个核心概念。预测区间提供了一种衡量预测不确定性的方式,而损失函数则用于评估模型预测与实际数据之间的差异。

## 1.1 预测区间的概念与意义

预测区间是指一个预测值可能落在某个范围内的概率区间。比如在金融市场的未来价格预测中,预测区间可以告诉我们,股票价格在明天有95%的概率会落在100到110元之间。创建准确的预测区间对于理解模型预测的可靠性和准确性至关重要,尤其是在需要风险评估和决策支持的场合。

## 1.2 损失函数的角色与重要性

损失函数是衡量模型预测误差大小的数学表达式,它对模型训练和优化具有指导作用。通过最小化损失函数,模型能够学习到从输入数据到输出数据的映射关系,从而提高预测的准确度。在预测区间上下文中,损失函数可以用来评估预测区间的质量,如区间宽度与包含真实值的概率之间的平衡。

# 2. ```

# 第二章:损失函数的基础理论

损失函数,作为机器学习与统计学中的核心概念,承担着评估模型预测误差的重要角色。它不仅能够量化模型的预测准确性,而且是模型优化过程中的关键部分。本章将深入探讨损失函数的定义、常见类型、以及如何在不同的应用场景中进行选择。

## 2.1 损失函数的定义和作用

### 2.1.1 预测误差的量化方法

预测误差是指模型预测值与实际观测值之间的差异。准确量化这种误差对于评估模型性能至关重要。损失函数通过数学公式将这种差异转换为一个可度量的数值,从而反映出模型预测的准确程度。从数学的角度来看,损失函数是定义在预测值与真实值之间的非负实值函数,它能够输出一个“损失”值,用以衡量模型的预测效果。

一个常见的预测误差量化方法是均方误差(MSE),其计算公式为:

```math

MSE = \frac{1}{n}\sum_{i=1}^{n}(y_i - \hat{y_i})^2

```

其中,\(y_i\) 表示第 \(i\) 个观测值,\(\hat{y_i}\) 表示第 \(i\) 个预测值,\(n\) 是样本总数。MSE 损失函数的一个主要特点是它对大误差的惩罚更大,因为它平方了误差项。

### 2.1.2 损失函数在模型优化中的角色

在模型训练过程中,损失函数的值通常被用作优化算法的指导信号。优化算法的目的是调整模型参数以最小化损失函数的值。这一过程通常称为“最小化损失”。

以梯度下降算法为例,模型参数的更新公式为:

```math

\theta_{\text{new}} = \theta_{\text{old}} - \alpha \frac{\partial}{\partial \theta} \text{Loss}(\theta)

```

这里,\(\theta\) 表示模型参数,\(\alpha\) 是学习率,\(\frac{\partial}{\partial \theta} \text{Loss}(\theta)\) 是损失函数相对于参数 \(\theta\) 的梯度。通过这种梯度下降的方法,模型可以逐步调整参数,直到损失函数的值达到一个可接受的最小值。

## 2.2 常见损失函数类型

### 2.2.1 平方损失函数与回归分析

平方损失函数,即上文提到的均方误差(MSE),是最常用的损失函数之一,尤其适用于回归分析。它能够有效地反映出预测值与真实值之间的差异。然而,平方损失函数对于异常值较为敏感,因为较大的误差会被平方,从而对总损失产生较大影响。

### 2.2.2 对数损失函数与分类问题

对于分类问题,尤其是二分类问题,常用的是对数损失函数(log loss),也称为交叉熵损失。对数损失函数的公式如下:

```math

\text{Log Loss} = -\frac{1}{n}\sum_{i=1}^{n} [y_i \cdot \log(\hat{y_i}) + (1-y_i) \cdot \log(1-\hat{y_i})]

```

其中,\(y_i\) 表示第 \(i\) 个样本的真实标签,\(\hat{y_i}\) 表示模型对该样本预测为正类的概率。对数损失函数不仅衡量预测的准确性,还反映了预测的概率分布与真实分布之间的差异程度。由于它是基于概率的,因此对于分类任务具有良好的性能。

### 2.2.3 绝对损失函数与稳健回归

绝对损失函数(absolute loss)或称为L1损失,其公式为:

```math

\text{Absolute Loss} = \frac{1}{n}\sum_{i=1}^{n}|y_i - \hat{y_i}|

```

与平方损失相比,绝对损失对异常值更稳健,因为损失函数对大的误差惩罚相对较小。绝对损失函数在某些稳健回归分析中尤其有用。

## 2.3 损失函数的选择原则

### 2.3.1 适用性分析与模型类型匹配

选择损失函数时,首先需要考虑模型的类型以及预期解决的问题。例如,在回归问题中,平方损失函数通常是首选,因为它能够反映出预测值与真实值之间的精确差异。在二分类问题中,对数损失函数是常见的选择,因为它能够有效地处理概率预测问题。

### 2.3.2 损失函数的数学性质对优化的影响

损失函数的数学性质在优化过程中也起到关键作用。例如,损失函数的凸性可以保证优化算法能够找到全局最小值。非凸损失函数可能会导致优化算法陷入局部最小值,而非最优解。因此,在实际应用中,需要根据问题的特性以及优化算法的限制来选择合适的损失函数。

## 2.4 损失函数与性能指标的关系

损失函数值越小,通常意味着模型性能越好。然而,损失函数的值并不是评估模型性能的唯一指标。有时,我们需要额外的性能指标来更全面地评估模型。例如,在分类问题中,除了使用损失函数值外,还可以使用准确率、召回率、F1分数等指标。这些指标能够提供关于模型分类性能的不同方面的信息,而损失函数则提供了一个整体的优化目标。

## 2.5 损失函数的调整与实际应用

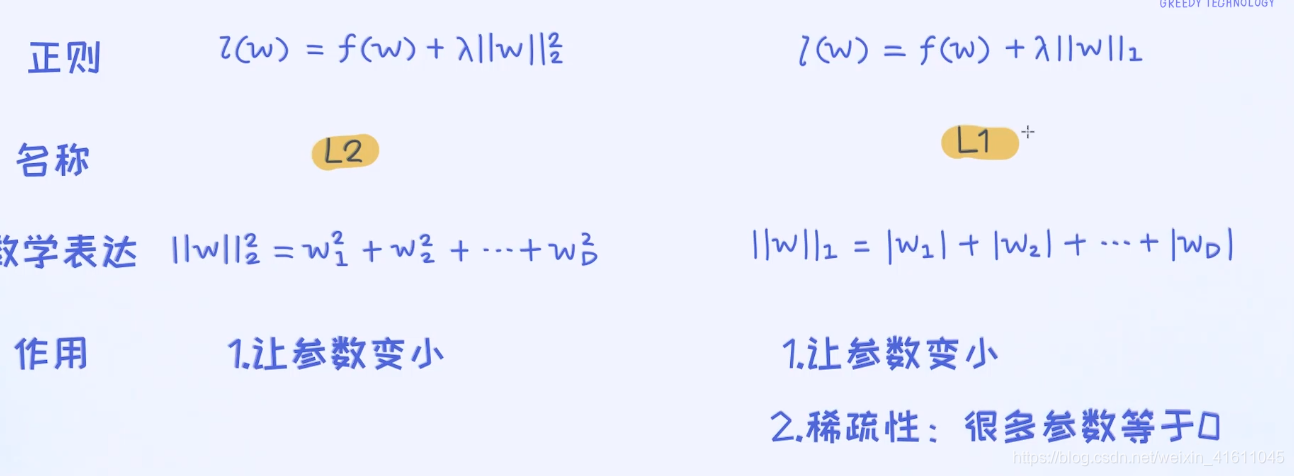

在实际应用中,损失函数可能需要根据数据的特点和问题的需求进行调整。例如,对于不平衡数据集,可以使用加权损失函数,给予少数类更高的权重,以优化模型对于少数类的预测能力。此外,还可以采用正则化项来避免模型过拟合,常见的正则化方法包括L1正则化和L2正则化。

在接下来的章节中,我们将深入探讨如何根据不同的应用场景,优化和选择合适的损失函数,以及在真实世界中的应用案例。

```

# 3. 优化损失函数的策略与实践

在第二章中,我们已经了解了损失函数的基础理论,包括其定义、作用以及一些常见类型。接下来,我们将探讨如何优化损失函数以提高机器学习模型的性能。本章将深入介绍损失函数的调整方法、组合策略以及迭代与评估的方法。

## 3.1 损失函数的调整方法

在模型训练过程中,通过调整损失函数来改善模型性

0

0