高级矩阵理论:特征值与向量全面分析

发布时间: 2024-12-05 02:06:34 阅读量: 49 订阅数: 39

《矩阵特征值与特征向量的定义与性质》教学设计.pdf

参考资源链接:[《矩阵论》第三版课后答案详解](https://wenku.csdn.net/doc/ijji4ha34m?spm=1055.2635.3001.10343)

# 1. 矩阵理论基础概述

在数学与计算机科学的交叉领域中,矩阵理论为处理和解决各种线性问题提供了强大的工具。矩阵不仅被广泛应用于代数、几何和物理学问题的建模和求解,也是数据科学、机器学习和图像处理等前沿技术的基石。理解矩阵理论的基本概念,诸如矩阵的类型、运算以及矩阵的秩和迹等,是掌握更复杂数学概念和算法的前提。

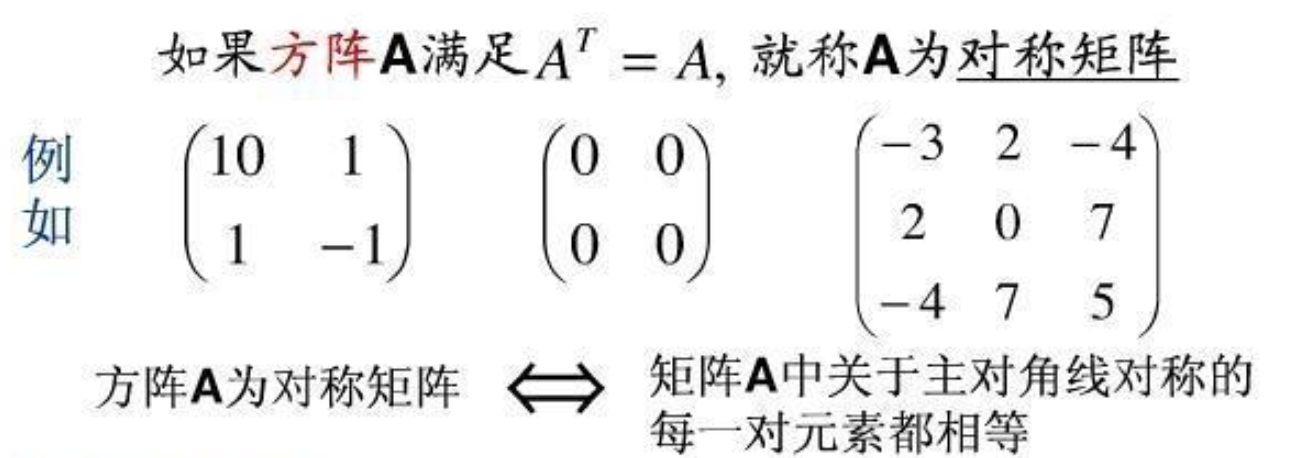

矩阵被定义为一个按照长方阵列排列的复数或实数集合,它能够表示线性变换以及系统方程组。在第一章中,我们将从最基础的矩阵定义和分类开始,逐步探讨矩阵的加法、乘法、转置和逆矩阵等操作,为读者构建坚实的理论基础。通过引入向量空间和线性变换的概念,本章节将阐述矩阵在表达数学关系中的中心作用,为进一步探索矩阵在特征值分析中的角色打下基础。

# 2. 特征值与特征向量的数学原理

### 2.1 特征值与特征向量定义

#### 2.1.1 特征值的几何意义

特征值和特征向量是线性代数中的核心概念,它们在众多数学和工程问题中发挥着重要作用。特征值的几何意义可以这样理解:给定一个线性变换,该变换将一个向量映射到另一个向量。如果存在一个非零向量,经过这个变换后,向量的方向不变,只是长度发生了变化,那么这个长度变化的因子就是特征值,而这个向量则称为对应于该特征值的特征向量。

为了更直观地理解,可以考虑一个简单的几何变换。例如,在二维空间中,一个矩阵可以表示一个线性变换,比如旋转或缩放。特征向量是那个在变换后方向不变的向量,而特征值表示了变化的倍数。

以二维空间的变换为例,一个典型的缩放变换可以表示为矩阵A:

```

A = | λ 0 |

| 0 λ |

```

其中λ是特征值,它可以是任意实数。在这个情况下,任何非零向量(x, y)都是特征向量,因为它们在变换后仍然指向相同的方向,只是被拉伸或压缩了λ倍。

特征值的几何意义不仅限于二维空间,它在高维空间中同样适用。在更高维度中,特征值和特征向量提供了一个理解复杂变换本质的视角,使我们能够识别出变换的不变量。

#### 2.1.2 特征向量的确定方法

确定特征向量的一个直观方法是基于特征值的定义。考虑一个n×n的矩阵A,我们要找到一个非零向量v,使得Av=λv,其中λ是一个标量,称作特征值。要找到这样的向量v,我们需要解一个非平凡的线性方程组(A - λI)v = 0,其中I是单位矩阵。

这个线性方程组只有在系数矩阵(A - λI)是奇异的,即行列式det(A - λI) = 0时才有非零解。求解这个方程组的过程实际上就是求解一个n阶多项式方程的根,即特征多项式。这个方程也被称为矩阵A的特征方程。

为了求解特征向量,我们首先需要计算出特征值λ,这通常需要解一个多项式方程。一旦特征值确定,我们可以将其代入线性方程组(A - λI)v = 0,并使用高斯消元法、克拉默法则或其他数值方法来解出特征向量v。

例如,对于一个简单的3×3矩阵,我们首先计算特征多项式并找到其根。假设我们已经找到了一个特征值λ1,我们现在可以将这个值代入到(A - λ1I)v = 0,并解出对应于λ1的特征向量v1。

计算特征向量通常是一个数值过程,涉及线性代数软件或编程语言中的库函数。在实际操作中,我们会用这些工具来避免繁琐的手工计算。

### 2.2 特征值的计算方法

#### 2.2.1 解析法求特征值

解析法是求解特征值的一种直接方法,通常涉及解特征多项式。这种方法适用于小规模矩阵,因为解析地求解特征多项式在计算上是可行的。对于一个n×n矩阵A,其特征值是特征方程:

```

det(A - λI) = 0

```

的解,其中I是n×n的单位矩阵。一旦解出特征值λ,我们就可以通过代入A - λI = 0来求对应的特征向量。对于低维矩阵,解析法可以手动计算,但对于高维矩阵,通常需要借助计算机软件。

解析法的局限性在于特征多项式可能难以解析地求解,尤其是当矩阵的维数增加时。高维矩阵的特征多项式求解需要复杂的数值算法,比如牛顿法或者格子法,这些方法都超出了手工计算的范畴。

### 2.2.2 近似计算与数值方法

对于大规模矩阵,解析法往往不切实际,因此数值方法成为求解特征值问题的关键。一种常见的方法是幂法(Power Method),它特别适用于计算绝对值最大的特征值。幂法的基本思路是迭代地进行矩阵-向量乘法,并归一化得到的向量。具体步骤如下:

1. 选择一个初始非零向量v₀。

2. 计算Av₀。

3. 将Av₀归一化,得到新的特征向量估计v₁。

4. 重复步骤2和3,直到收敛。

当这个过程收敛时,Av的颜色方向将趋近于对应于绝对值最大特征值的特征向量,而Av除以这个特征值将给出该特征值的近似值。

此外,还有其他高级数值方法,如雅可比方法、QR算法和奇异值分解(SVD),它们可以用于计算更广泛的特征值问题。这些方法通常实现在数学库中,如LAPACK、MKL和CuBLAS等。这些库提供了高效的算法实现,可以处理大规模矩阵的特征值计算,广泛应用于科学计算和工程领域。

### 2.3 特征向量的性质分析

#### 2.3.1 特征向量的基本性质

特征向量具有几个重要的基本性质,这些性质对于理解特征值和特征向量在矩阵分析中的角色至关重要。

首先,如果v是一个特征向量,那么对于任何非零标量α,αv也是一个特征向量。这意味着特征向量并不唯一,但是它们在方向上是相同的。

其次,对于同一个特征值,所有对应的特征向量构成一个子空间。这个子空间被称为特征向量空间或特征空间。例如,在2维空间中,如果两个特征向量与同一个特征值相关联,那么这两个向量将位于同一直线上。

最后,不同的特征值对应的特征向量空间是正交的,这意味着如果两个特征值不同,那么它们对应的特征向量将是线性无关的。这一性质在理解矩阵对角化以及求解线性系统的稳定性和动态行为方面非常重要。

这些性质对于理解线性变换的本质及其对空间的影响至关重要,它们为计算和应用提供了理论基础。

#### 2.3.2 特征向量与矩阵的变换关系

特征向量与矩阵的变换关系揭示了特征向量在描述矩阵作用时的重要性。当我们对一个特征向量进行线性变换时,结果还是一个同方向的向量,只是长度可能发生了变化。这个性质允许我们通过特征向量来简化矩阵操作,特别是当涉及到矩阵的对角化过程时。

矩阵对角化的目标是找到一个可逆矩阵P,使得P⁻¹AP是一个对角矩阵,其对角线上的元素是A的特征值。这意味着如果A是对角化的,那么A的作用可以通过对角矩阵简单地描述,其中每个特征值乘以相应的特征向量的坐标,从而极大地简化了对矩阵的理解和计算。

在实践中,对角化可以用于快速求解线性微分方程组,分析线性动态系统的稳定性,以及在数值分析中对大规模矩阵进行高效的特征值计算。特征向量的概念在计算机图形学、量子力学、经济学和网络理论等许多其他领域中也非常重要。

# 3. 特征系统在矩阵分析中的应用

## 3.1 特征值分解的理论与应用

### 3.1.1 对角化与特征值分解

特征值分解是矩阵理论中的一个核心概念,它允许我们将一个方阵分解为几个特定矩阵的乘积,其中包含矩阵的特征值和特征向量。特别地,对角化是特征值分解的一个重要应用,它涉及将矩阵转换为对角形式,这样可以极大地简化矩阵的幂运算和矩阵方程的求解。

在对角化的过程中,我们寻找一个可逆矩阵 \( P \) 和一个对角矩阵 \( D \),使得原矩阵 \( A \) 可以表示为 \( A = PDP^{-1} \),其中 \( D \) 的对角元素是 \( A \) 的特征值,而 \( P \) 的列向量是对应的特征向量。

在实现对角化时,一个关键的步骤是验证矩阵 \( A \) 是否可对角化。若 \( A \) 有 \( n \) 个线性无关的特征向量(\( n \) 为矩阵 \( A \) 的阶数),则 \( A \) 是可对角化的。

### 3.1.2 应用示例:线性系统的稳定性分析

一个典型的应用是对线性动力系统的稳定性进行分析。考虑一个线性动力系统,其状态空间模型可以表示为 \( \mathbf{x}(k+1) = A\mathbf{x}(k) \),其中 \( \mathbf{x}(k) \) 是在时间 \( k \) 的状态向量,\( A \) 是系统矩阵。

通过对 \( A \) 进行特征值分解,我们可以确定系统的稳定性。对于离散时间系统,如果矩阵 \( A \) 的所有特征值的模都小于 1,那么系统是稳定的,状态向量 \( \mathbf{x}(k) \) 将随着时间的推移趋于零向量。相反,如果存在至少一个特征值的模大于 1,系统是不稳定的。

## 3.2 特征系统的数值方法

### 3.2.1 数值算法概述

特征值问题的数值解法在工程和科学计算中极为重要,尤其是在大规模矩阵的特征值分析中。常用的算法包括幂法、反幂法、雅可比法和QR算法等。这些算法在实现时通常使用迭代方法,以处理大规模和稀疏矩阵。

在选择适当的算法时,我们需考虑矩阵的特

0

0