多任务学习的评估与度量:指标、方法和陷阱,助你准确评估模型性能

发布时间: 2024-08-22 12:53:48 阅读量: 16 订阅数: 14

# 1. 多任务学习评估的理论基础

多任务学习 (MTL) 是一种机器学习范式,它通过同时学习多个相关任务来提高模型性能。MTL 评估是衡量 MTL 模型有效性的关键步骤,它提供了对模型泛化能力、鲁棒性和可解释性的见解。

MTL 评估的理论基础建立在几个关键概念之上:

* **任务相关性:**MTL 假设不同任务之间存在相关性,这可以利用来提高模型性能。

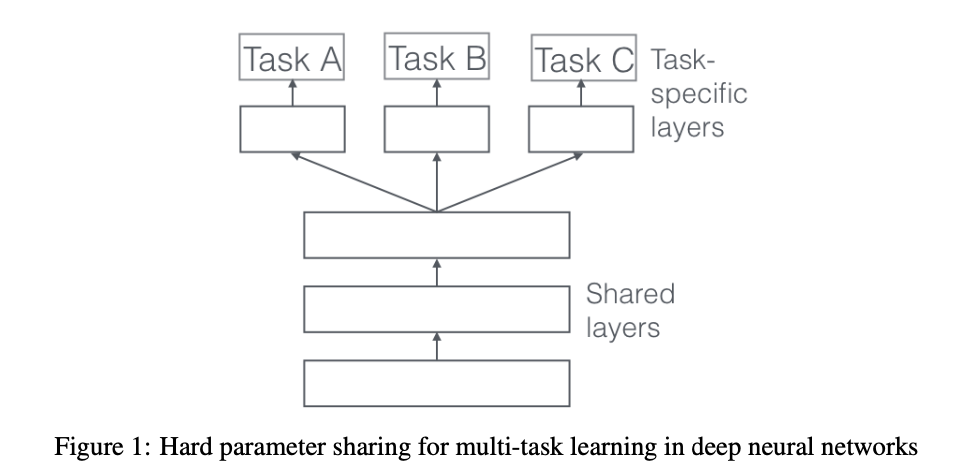

* **知识共享:**MTL 模型通过在任务之间共享表示和参数,从多个任务中学习。

* **正则化:**MTL 通过鼓励模型学习共同模式来正则化学习过程,这有助于提高泛化能力。

# 2. 多任务学习评估指标

多任务学习评估指标是衡量多任务学习模型性能的关键指标。这些指标可以分为两大类:准确性指标和鲁棒性指标。

### 2.1 准确性指标

准确性指标衡量模型预测的准确性,包括以下指标:

#### 2.1.1 精度

精度(Precision)衡量模型预测为正例的样本中,实际为正例的比例。

```python

precision = TP / (TP + FP)

```

- TP:真正例(预测为正例且实际为正例)

- FP:假正例(预测为正例但实际为负例)

#### 2.1.2 召回率

召回率(Recall)衡量模型预测为正例的样本中,实际为正例的比例。

```python

recall = TP / (TP + FN)

```

- FN:假负例(预测为负例但实际为正例)

#### 2.1.3 F1-score

F1-score是精度和召回率的调和平均值,综合考虑了精度和召回率。

```python

f1_score = 2 * (precision * recall) / (precision + recall)

```

### 2.2 鲁棒性指标

鲁棒性指标衡量模型对不同条件下的稳定性和泛化能力,包括以下指标:

#### 2.2.1 泛化能力

泛化能力衡量模型在未知数据上的预测性能。通常使用交叉验证或独立测试集评估泛化能力。

#### 2.2.2 稳定性

稳定性衡量模型在不同训练集或超参数设置下的预测结果的一致性。

#### 2.2.3 可解释性

可解释性衡量模型预测结果的可理解性和可解释性。这对于理解模型的行为和识别潜在的偏差非常重要。

### 2.3 多任务学习评估指标选择

选择合适的评估指标取决于具体的多任务学习任务和目标。一般来说,对于分类任务,准确性指标(如精度、召回率、F1-score)是首选。对于回归任务,可以考虑均方误差(MSE)或平均绝对误差(MAE)。

### 2.4 评估指标的局限性

需要注意的是,评估指标可能存在局限性。例如,精度和召回率在数据集不平衡的情况下可能具有误导性。泛化能力评估可能受到训练集和测试集分布差异的影响。因此,在使用评估指标时,需要考虑其局限性并结合其他评估方法来获得更全面的模型性能评估。

# 3. 多任务学习评估方法

### 3.1 定量评估方法

0

0