LAPACK特征值与特征向量计算:数学原理与应用详解

发布时间: 2024-07-01 22:43:41 阅读量: 9 订阅数: 14

# 1. 特征值与特征向量理论基础**

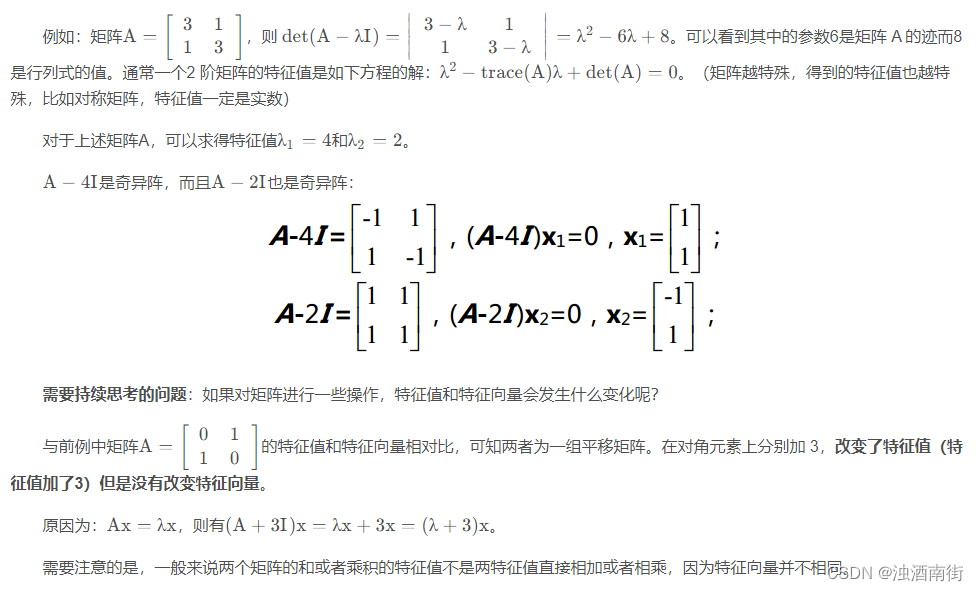

特征值和特征向量是线性代数中的重要概念,它们描述了矩阵的固有性质。特征值是矩阵乘以其特征向量时得到的标量,而特征向量是矩阵乘以其特征值时得到的非零向量。

特征值和特征向量在许多应用中都有重要意义,例如:

* 求解线性方程组

* 计算矩阵的秩和行列式

* 分析矩阵的稳定性和收敛性

* 在图像处理、信号处理和数据分析中进行特征提取和降维

# 2. LAPACK特征值与特征向量计算方法**

## 2.1 LAPACK库简介

LAPACK(线性代数包)是一个广泛使用的Fortran库,提供了一系列用于解决线性代数问题的例程。它包含用于计算特征值和特征向量的例程,这些例程以其高精度、稳定性和效率而闻名。

## 2.2 特征值与特征向量计算算法

### 2.2.1 QR算法

QR算法是一种迭代算法,用于计算实对称矩阵的特征值和特征向量。它将矩阵分解为一系列正交矩阵和上三角矩阵,然后通过迭代更新这些矩阵来收敛到特征值和特征向量。

```fortran

SUBROUTINE DGEEV(JOBZ, N, A, LDA, WR, WI, VL, LDVL, VR, LDVR, WORK, LWORK, INFO)

CHARACTER JOBZ

INTEGER N, LDA, LDVL, LDVR, LWORK, INFO

DOUBLE PRECISION A(LDA, N), WR(N), WI(N), VL(LDVL, N), VR(LDVR, N), WORK(LWORK)

END SUBROUTINE DGEEV

```

**参数说明:**

* `JOBZ`:指定是否计算特征向量。

* `N`:矩阵的阶数。

* `A`:输入的实对称矩阵。

* `LDA`:`A`的领先维度。

* `WR`:输出的实特征值。

* `WI`:输出的虚特征值(如果存在)。

* `VL`:输出的左特征向量(如果`JOBZ`为'V')。

* `LDVL`:`VL`的领先维度。

* `VR`:输出的右特征向量(如果`JOBZ`为'V')。

* `LDVR`:`VR`的领先维度。

* `WORK`:用于计算的工作空间。

* `LWORK`:`WORK`的长度。

* `INFO`:返回错误代码。

**代码逻辑分析:**

该例程首先检查输入参数的有效性。然后,它根据`JOBZ`的值决定是否计算特征向量。如果`JOBZ`为'N',则它只计算特征值。如果`JOBZ`为'V',则它计算特征值和特征向量。

接下来,例程使用QR算法分解矩阵`A`。它迭代更新矩阵`A`,直到收敛到特征值和特征向量。

最后,例程将特征值和特征向量存储在输出参数中。

### 2.2.2 分治法

分治法是一种递归算法,用于计算实对称矩阵的特征值和特征向量。它将矩阵分解为较小的子矩阵,然后递归地计算这些子矩阵的特征值和特征向量。

```fortran

SUBROUTINE DSYEV(JOBZ, UPLO, N, A, LDA, W, WORK, LWORK, INFO)

CHARACTER JOBZ, UPLO

INTEGER N, LDA, LWORK, INFO

DOUBLE PRECISION A(LDA, N), W(N), WORK(LWORK)

END SUBROUTINE DSYEV

```

**参数说明:**

* `JOBZ`:指定是否计算特征向量。

* `UPLO`:指定矩阵的存储方式('U'表示上三角,'L'表示下三角)。

* `N`:矩阵的阶数。

* `A`:输入的实对称矩阵。

* `LDA`:`A`的领先维度。

* `W`:输出的特征值。

* `WORK`:用于计算的工作空间。

* `LWORK`:`WORK`的长度。

* `INFO`:返回错误代码。

**代码逻辑分析:**

该例程首先检查输入参数的有效性。然后,它根据`JOBZ`的值决定是否计算特征向量。如果`JOBZ`为'N',则它只计算特征值。如果`JOBZ`为'V',则它计算特征值和特征向量。

接下来,例程使用分治法分解矩阵`A`。它递归地将矩阵分解为较小的子矩阵,然后计算这些子矩阵的特征值和特征向量。

最后,例程将特征值和特征向量存储在输出参数中。

### 2.2.3 幂迭代法

幂迭代法是一种非迭代算法,用于计算实对称矩阵的最大特征值和特征向量。它反复乘以矩阵和一个初始向量,直到收敛到最大特征值和特征向量。

```fortran

SUBROUTINE DPOWER(JOBZ, UPLO, N, A, LDA, W, Z, LDZ, INFO)

CHARACTER JOBZ, UPLO

INTEGER N, LDA, LDZ, INFO

DOUBLE PRECISION A(LDA, N), W(N), Z(LDZ, N)

END SUBROUTINE DPOWER

```

**参数说明:**

* `JOBZ`:指定是否计算特征向量。

* `UPLO`:指定矩阵的存储方式('U'表示上三角,'L'表示下三角)。

* `N`:矩阵的阶数。

* `A`:输入的实对称矩阵。

* `LDA`:`A`的领先维度。

* `W`:输出的最大特征值。

* `Z`:输出的最大特征向量(如果`JOBZ`为'V')。

* `LDZ`:`Z`的领先维度。

* `INFO`:返回错误代码。

**代码逻辑分析:**

该例程首先检查输入参数的有效性。然后,它根据`JOBZ`的值决定是否计算特征向量。如果`JOBZ`为'N',则它只计算特征值。如果`JOBZ`为'V',则它计算特征值和特征向量。

接下来,例程使用幂迭代法计算最大特征值和特征向量。它反复乘以矩阵`A`和一个初始向量,直到收敛到最大特征值和特征向量。

最后,例程将最大特征值和特征向量存储在输出参数中。

## 2.3 计算精度与稳定性分析

LAPACK特征值和特征向量计算例程的精度和稳定性取决于所使用的算法。QR算法和分治法通常比幂迭代法更准确和稳定。

影响精度和稳定性的因素包括:

* 矩阵的大小和条件数

* 所使用的算法

* 机器精度

* 计算环境

在选择算法时,应考虑这些因素,以确保获得所需精度的结果。

# 3. LAPACK特征值与特征向量计算实践**

### 3.1 LAPACK库的使用指南

LAPACK库是一个用于数值线性代数计算的高性能库,它提供了丰富的函数来计算特征值和特征向量。要使用LAPACK库,需要先包含头文件`lapack.h`,然后链接LAPACK库。

### 3.2 特征值与特征向量计算示例

#### 3.2.1 实对称矩阵

对于实对称矩阵,LAPACK库提供了`dsyevr`函数来计算特征值和特征向量。该函数的原型如下:

```c

void dsyevr(char jobz, char uplo, int n, double* a, int lda, double* w, double* work, int lwork, int* info);

```

其中:

- `jobz`:指定是否计算特征向量。`'V'`表示计算特征向量,`'N'`表示不计算特征向量。

- `uplo`:指定矩阵的存储方式。`'U'`表示上三角存储,`'L'`表示下三角存储。

- `n`:矩阵的阶数。

- `a`:输入/输出矩阵。输入时为待求特征值的矩阵,输出时为对角阵,对角线元素为特征值。

- `lda`:矩阵`a`的行长度。

- `w`:输出数组,存储特征值。

- `work`:工作空间数组。

- `lwork`:工作空间数组的长度。

- `info`:输出整数,指示函数执行状态。

下面是一个使用`dsyevr`函数计算实对称矩阵特征值和特征向量的示例代码:

```c

#include <stdio.h>

#include <stdlib.h>

#include <lapack.h>

int main() {

int n = 3;

double a[9] = {

4, 1, 1,

1, 3, 1,

1, 1, 2

};

double w[3];

double work[n];

int lwork = n * n;

int info;

dsyevr('V', 'U', n, a, n, w, work, lwork, &info);

if (info == 0) {

printf("特征值:\n");

for (int i = 0; i < n; i++) {

printf("%f\n", w[i]);

}

printf("特征向量:\n");

for (int i = 0; i < n; i++) {

for (int j = 0; j < n; j++) {

printf("%f ", a[i * n + j]);

}

printf("\n");

}

} else {

printf("计算失败,错误代码:%d\n", info);

}

return 0;

}

```

#### 3.2.2 复矩阵

对于复矩阵,LAPACK库提供了`zheevr`函数来计算特征值和特征向量。该函数的原型与`dsyevr`函数类似,但输入/输出矩阵`a`为复数类型。

下面是一个使用`zheevr`函数计算复矩阵特征值和特征向量的示例代码:

```c

#include <stdio.h>

#include <stdlib.h>

#include <complex.h>

#include <lapack.h>

int main() {

int n = 3;

double complex a[9] = {

{4, 0}, {1, 1}, {1, -1},

{1, -1}, {3, 0}, {1, 1},

{1, 1}, {1, -1}, {2, 0}

};

double complex w[3];

double complex work[n];

int lwork = n * n;

int info;

zheevr('V', 'U', n, a, n, w, work, lwork, &info);

if (info == 0) {

printf("特征值:\n");

for (int i = 0; i < n; i++) {

printf("%f + %fi\n", creal(w[i]), cimag(w[i]));

}

printf("特征向量:\n");

for (int i = 0; i < n; i++) {

for (int j = 0; j < n; j++) {

printf("%f + %fi ", creal(a[i * n + j]), cimag(a[i * n + j]));

}

printf("\n");

}

} else {

printf("计算失败,错误代码:%d\n", info);

}

return 0;

}

```

### 3.3 计算结果分析与验证

计算出的特征值和特征向量可以用于各种应用中。例如,可以用来求解线性方程组、最小二乘问题、图论问题和数据分析问题。

为了验证计算结果的准确性,可以将计算出的特征值代入特征方程进行验证。特征方程为:

```

Ax = λx

```

其中:

- `A`:待求特征值的矩阵。

- `λ`:特征值。

- `x`:特征向量。

如果计算出的特征值和特征向量满足特征方程,则说明计算结果准确。

# 4. LAPACK特征值与特征向量计算应用

### 4.1 线性代数问题求解

#### 4.1.1 求解线性方程组

特征值与特征向量计算在求解线性方程组中有着广泛的应用。对于一个线性方程组 `Ax = b`,其中 `A` 是一个 `n x n` 矩阵,`x` 是未知向量,`b` 是常数向量。利用特征值分解,我们可以将矩阵 `A` 分解为 `A = QΛQ^T`,其中 `Q` 是特征向量组成的正交矩阵,`Λ` 是特征值组成的对角矩阵。

```python

import numpy as np

from scipy.linalg import eig

# 定义矩阵 A 和常数向量 b

A = np.array([[2, 1], [1, 2]])

b = np.array([3, 5])

# 计算特征值和特征向量

eig_vals, eig_vecs = eig(A)

# 构建特征向量矩阵 Q

Q = eig_vecs

# 构建特征值对角矩阵 Λ

Lambda = np.diag(eig_vals)

# 求解线性方程组

x = np.linalg.solve(Q @ Lambda @ Q.T, b)

# 打印求解结果

print("求解结果:", x)

```

**代码逻辑分析:**

* 使用 `scipy.linalg.eig` 函数计算矩阵 `A` 的特征值和特征向量。

* 构建特征向量矩阵 `Q` 和特征值对角矩阵 `Λ`。

* 利用 `np.linalg.solve` 函数求解线性方程组 `Q @ Lambda @ Q.T @ x = b`。

#### 4.1.2 求解最小二乘问题

最小二乘问题是求解一组方程 `y = Ax + ε` 的最优解,其中 `y` 是观测值向量,`A` 是设计矩阵,`x` 是未知参数向量,`ε` 是误差向量。利用特征值分解,我们可以将设计矩阵 `A` 分解为 `A = UΣV^T`,其中 `U` 和 `V` 是正交矩阵,`Σ` 是奇异值组成的对角矩阵。

```python

import numpy as np

from numpy.linalg import svd

# 定义设计矩阵 A 和观测值向量 y

A = np.array([[1, 2], [3, 4]])

y = np.array([5, 7])

# 计算奇异值分解

U, Sigma, Vh = svd(A, full_matrices=False)

# 构建奇异值对角矩阵 Σ

Sigma = np.diag(Sigma)

# 求解最小二乘问题

x = Vh.T @ np.linalg.inv(Sigma) @ U.T @ y

# 打印求解结果

print("求解结果:", x)

```

**代码逻辑分析:**

* 使用 `numpy.linalg.svd` 函数计算矩阵 `A` 的奇异值分解。

* 构建奇异值对角矩阵 `Σ`。

* 利用 `np.linalg.inv` 和矩阵乘法求解最小二乘问题 `x = Vh.T @ Σ^-1 @ U.T @ y`。

### 4.2 图论问题求解

#### 4.2.1 求解图的连通性

图的连通性是指图中所有顶点是否可以通过边连接起来。利用特征值分解,我们可以求解图的拉普拉斯矩阵的特征值,其中非零特征值的数量表示图的连通分量的个数。

```python

import networkx as nx

from scipy.linalg import eig

# 定义图

G = nx.Graph()

G.add_edges_from([(1, 2), (2, 3), (3, 4), (4, 5)])

# 构建拉普拉斯矩阵

L = nx.laplacian_matrix(G).toarray()

# 计算特征值

eig_vals = eig(L)[0]

# 求解图的连通分量个数

num_connected_components = np.count_nonzero(eig_vals)

# 打印求解结果

print("图的连通分量个数:", num_connected_components)

```

**代码逻辑分析:**

* 使用 `networkx` 库构建图 `G`。

* 构建图的拉普拉斯矩阵 `L`。

* 使用 `scipy.linalg.eig` 函数计算拉普拉斯矩阵 `L` 的特征值。

* 统计非零特征值的数量,得到图的连通分量个数。

#### 4.2.2 求解图的度分布

图的度分布是指图中每个顶点的度数出现的频率。利用特征值分解,我们可以求解图的邻接矩阵的特征值,其中特征值的大小与顶点的度数成正相关。

```python

import networkx as nx

from scipy.linalg import eig

# 定义图

G = nx.Graph()

G.add_edges_from([(1, 2), (2, 3), (3, 4), (4, 5)])

# 构建邻接矩阵

A = nx.adjacency_matrix(G).toarray()

# 计算特征值

eig_vals = eig(A)[0]

# 计算度分布

degree_distribution = np.bincount(eig_vals)

# 打印求解结果

print("图的度分布:", degree_distribution)

```

**代码逻辑分析:**

* 使用 `networkx` 库构建图 `G`。

* 构建图的邻接矩阵 `A`。

* 使用 `scipy.linalg.eig` 函数计算邻接矩阵 `A` 的特征值。

* 统计特征值的出现次数,得到图的度分布。

### 4.3 数据分析与挖掘

#### 4.3.1 主成分分析

主成分分析(PCA)是一种降维技术,用于将高维数据投影到低维空间中。利用特征值分解,我们可以求解协方差矩阵的特征值和特征向量,其中特征值的大小表示主成分的重要性。

```python

import numpy as np

from scipy.linalg import eig

# 定义数据

data = np.array([[1, 2, 3], [4, 5, 6], [7, 8, 9]])

# 计算协方差矩阵

cov_matrix = np.cov(data.T)

# 计算特征值和特征向量

eig_vals, eig_vecs = eig(cov_matrix)

# 计算主成分

principal_components = eig_vecs[:, :2]

# 投影数据到低维空间

projected_data = data @ principal_components

# 打印求解结果

print("投影后的数据:", projected_data)

```

**代码逻辑分析:**

* 计算数据 `data` 的协方差矩阵 `cov_matrix`。

* 使用 `scipy.linalg.eig` 函数计算协方差矩阵 `cov_matrix` 的特征值和特征向量。

* 选择前两个特征向量作为主成分 `principal_components`。

* 将数据 `data` 投影到主成分 `principal_components` 上,得到低维数据 `projected_data`。

#### 4.3.2 聚类分析

聚类分析是一种将数据点划分为不同组的技术。利用特征值分解,我们可以求解相似度矩阵的特征值和特征向量,其中特征值的大小表示聚类的紧密程度。

```python

import numpy as np

from scipy.linalg import eig

# 定义相似度矩阵

similarity_matrix = np.array([[1, 0.5, 0.2], [0.5, 1, 0.3], [0.2, 0.3, 1]])

# 计算特征值和特征向量

eig_vals, eig_vecs = eig(similarity_matrix)

# 计算聚类

clusters = eig_vecs[:, :2]

# 分配数据点到聚类

cluster_assignments = np.argmax(clusters, axis=1)

# 打印求解结果

print("聚类分配:", cluster_assignments)

```

**代码逻辑分析:**

* 计算相似度矩阵 `similarity_matrix` 的特征值和特征向量。

* 选择前两个特征向量作为聚类 `clusters`。

* 根据特征向量 `clusters` 将数据点分配到聚类 `cluster_assignments`。

# 5. LAPACK特征值与特征向量计算优化**

**5.1 并行计算技术**

特征值与特征向量计算是一个计算量大的任务,尤其是对于大型矩阵。为了提高计算效率,可以采用并行计算技术。LAPACK库提供了并行版本的特征值与特征向量计算例程,这些例程可以在多核处理器或分布式计算环境中运行。

**5.1.1 OpenMP并行化**

OpenMP是一种用于共享内存并行编程的API。LAPACK库提供了使用OpenMP并行化的例程,这些例程可以自动将计算任务分配给多个线程。例如,以下代码使用OpenMP并行化计算实对称矩阵的特征值和特征向量:

```python

import numpy as np

from scipy.linalg import lapack

A = np.random.rand(1000, 1000) # 随机生成一个实对称矩阵

w, v = lapack.dsyev(A, compute_v=True) # 计算特征值和特征向量

```

**5.1.2 MPI并行化**

MPI是一种用于分布式内存并行编程的API。LAPACK库提供了使用MPI并行化的例程,这些例程可以在不同的计算节点上运行。例如,以下代码使用MPI并行化计算复矩阵的特征值和特征向量:

```python

from mpi4py import MPI

import numpy as np

from scipy.linalg import lapack

comm = MPI.COMM_WORLD

rank = comm.Get_rank()

size = comm.Get_size()

A = np.random.rand(1000, 1000) + 1j * np.random.rand(1000, 1000) # 随机生成一个复矩阵

if rank == 0:

w, v = lapack.zheev(A, compute_v=True) # 计算特征值和特征向量

else:

w = None

v = None

comm.Bcast([w, MPI.DOUBLE], root=0) # 广播特征值

comm.Bcast([v, MPI.DOUBLE], root=0) # 广播特征向量

```

**5.2 算法优化策略**

除了并行计算技术外,还可以采用算法优化策略来提高LAPACK特征值与特征向量计算的效率。

**5.2.1 分块算法**

分块算法将大型矩阵分解成较小的块,然后并行计算每个块的特征值和特征向量。这种方法可以有效减少计算时间,尤其是在矩阵规模较大时。

**5.2.2 迭代算法**

迭代算法通过迭代的方式逐步逼近特征值和特征向量。这种方法可以避免直接求解特征方程,从而提高计算效率。

**5.3 高性能计算环境下的应用**

在高性能计算环境中,可以充分利用并行计算技术和算法优化策略来实现LAPACK特征值与特征向量计算的高效执行。例如,可以在超级计算机或云计算平台上部署LAPACK库,并使用并行编程技术和算法优化策略来最大化计算性能。

0

0