【Python性能优化秘籍】:揭秘代码瓶颈,大幅提升运行效率

发布时间: 2024-06-19 04:32:36 阅读量: 74 订阅数: 36

# 1. Python性能优化概述

Python作为一门高级语言,以其易用性和广泛的库而闻名。然而,对于大型或复杂应用程序,性能优化至关重要。本章将概述Python性能优化的重要性,并介绍各种优化策略和技术。

**1.1 性能优化的重要性**

性能优化对于以下方面至关重要:

- **用户体验:**响应时间慢会影响用户满意度和参与度。

- **资源利用:**优化代码可以减少内存和CPU使用,从而降低成本并提高可扩展性。

- **可维护性:**优化后的代码更容易理解和维护,从而降低长期成本。

**1.2 优化策略和技术**

Python性能优化涉及多种策略和技术,包括:

- 代码分析和瓶颈定位

- 内存优化技巧

- CPU优化技术

- IO优化策略

- 其他优化技巧(如代码最佳实践和性能测试)

# 2. 代码分析与瓶颈定位

### 2.1 性能分析工具和方法

性能分析是识别和定位代码瓶颈的关键步骤。Python 提供了多种内置工具和第三方库,可帮助开发人员分析代码性能并识别瓶颈。

#### 2.1.1 内置函数和模块

Python 内置了几个有用的函数和模块,用于分析代码性能:

- `timeit` 模块:用于测量代码块的执行时间。

- `cProfile` 模块:用于生成代码的调用图和统计信息,包括函数调用次数、执行时间和内存使用情况。

- `pstats` 模块:用于分析 `cProfile` 生成的数据,并生成报告以识别瓶颈。

#### 2.1.2 第三方库和工具

除了内置工具之外,还有许多第三方库和工具可用于 Python 性能分析,例如:

- `line_profiler`:用于分析代码中每一行的执行时间。

- `memory_profiler`:用于分析代码的内存使用情况。

- `pyinstrument`:用于生成代码的调用图和统计信息,并提供交互式可视化界面。

### 2.2 代码瓶颈识别和定位

一旦有了合适的性能分析工具,就可以开始识别和定位代码瓶颈。以下是一些常见的方法:

#### 2.2.1 算法复杂度分析

算法复杂度分析涉及检查算法的执行时间如何随着输入大小的增加而变化。常见的算法复杂度包括:

- O(1):常数时间复杂度,执行时间与输入大小无关。

- O(n):线性时间复杂度,执行时间与输入大小成正比。

- O(n^2):平方时间复杂度,执行时间与输入大小的平方成正比。

通过分析算法复杂度,可以识别潜在的瓶颈,例如嵌套循环或递归调用。

#### 2.2.2 数据结构选择优化

选择合适的的数据结构对于代码性能至关重要。Python 提供了各种数据结构,例如列表、元组、字典和集合。每个数据结构都有其特定的优势和劣势,根据代码的特定需求选择合适的数据结构可以显著提高性能。

例如,如果需要频繁访问元素,则使用列表或元组比使用字典或集合更有效。如果需要快速查找元素,则使用字典比使用列表或元组更有效。

# 3. 内存优化技巧

### 3.1 内存管理基础

#### 3.1.1 Python内存管理机制

Python采用引用计数机制进行内存管理。每个对象都包含一个引用计数器,记录引用该对象的变量数量。当引用计数器为0时,对象将被垃圾回收器回收。

#### 3.1.2 内存泄漏的成因和解决

内存泄漏是指不再使用的对象仍然被引用,导致内存无法被释放。常见原因包括:

- **循环引用:**两个或多个对象相互引用,导致引用计数器无法降为0。

- **全局变量:**全局变量在程序结束前一直存在,可能导致不再使用的对象被长期引用。

- **弱引用:**弱引用不会增加对象的引用计数,但会阻止对象被垃圾回收。

解决内存泄漏的方法包括:

- **打破循环引用:**使用`weakref`模块创建弱引用,或使用`gc.get_referrers()`找出相互引用的对象。

- **使用局部变量:**尽可能将变量声明为局部变量,以减少全局变量的使用。

- **使用`del`关键字:**显式释放不再使用的对象,将引用计数器减为0。

### 3.2 内存优化策略

#### 3.2.1 引用计数优化

引用计数优化通过减少对象的引用计数来提高内存利用率。方法包括:

- **使用`weakref`模块:**创建弱引用不会增加对象的引用计数,从而减少内存占用。

- **使用`gc.disable()`和`gc.enable()`:**在不需要垃圾回收时暂时禁用垃圾回收器,以提高性能。

#### 3.2.2 内存池和对象缓存

内存池和对象缓存通过重用对象来减少内存分配和释放的开销。

- **内存池:**预分配一组对象,并根据需要分配和释放它们。

- **对象缓存:**存储经常使用的对象,以避免重复创建。

```python

# 使用内存池

from multiprocessing.pool import Pool

pool = Pool(processes=4)

result = pool.map(func, range(100))

# 使用对象缓存

import functools

@functools.lru_cache(maxsize=100)

def expensive_function(x):

return x**2

```

### 代码示例

```python

# 循环引用示例

class A:

def __init__(self):

self.b = B(self)

class B:

def __init__(self, a):

self.a = a

# 内存泄漏示例

def create_global_variable():

global global_var

global_var = []

# 引用计数优化示例

import weakref

obj = weakref.ref(object())

```

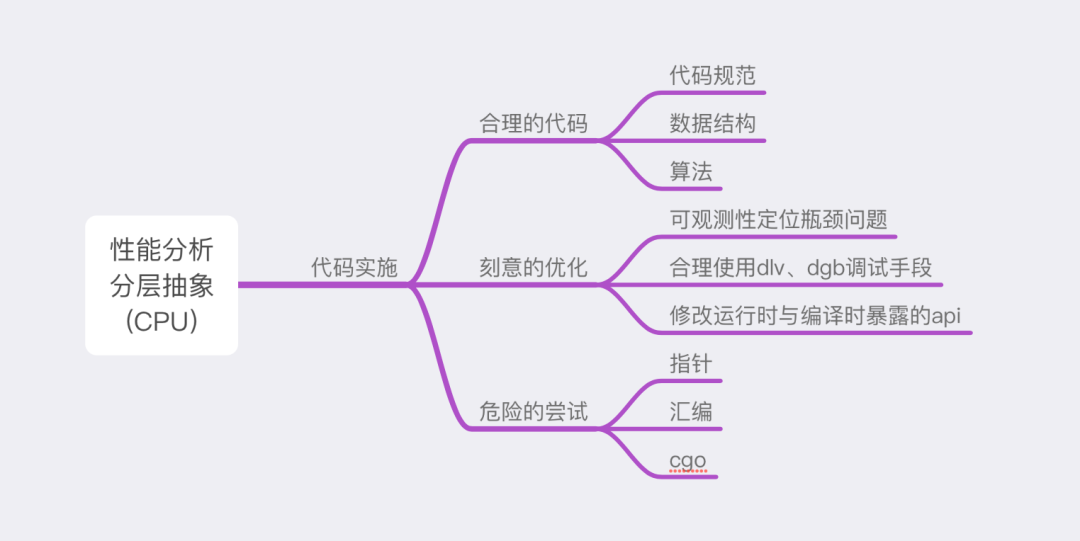

# 4. CPU优化技术

### 4.1 CPU性能优化原理

#### 4.1.1 CPU架构和指令集

CPU架构决定了指令集的类型和处理能力。常见的CPU架构包括:

- **x86架构:**用于台式机、笔记本电脑和服务器,支持Intel和AMD处理器。

- **ARM架构:**用于移动设备和嵌入式系统,以低功耗和高能效著称。

- **RISC-V架构:**一种开源的精简指令集架构,专注于低成本和高性能。

指令集是CPU理解和执行指令的语言。不同的指令集有不同的性能特征,例如:

- **CISC(复杂指令集计算机):**指令复杂,执行效率高,但代码体积较大。

- **RISC(精简指令集计算机):**指令简单,执行效率较低,但代码体积较小。

#### 4.1.2 缓存和内存层次结构

缓存是一种高速存储器,位于CPU和主内存之间。它存储最近访问过的指令和数据,以减少从主内存中读取数据的延迟。

内存层次结构是一个多级存储系统,从最快的缓存到最慢的硬盘驱动器。每个级别都有不同的访问时间和容量:

- **L1缓存:**位于CPU芯片上,访问时间最短,容量最小。

- **L2缓存:**位于CPU芯片外,容量比L1缓存大,访问时间稍长。

- **L3缓存:**位于主板上,容量最大,访问时间最长。

- **主内存(RAM):**容量大,但访问时间比缓存慢得多。

- **硬盘驱动器:**容量最大,但访问时间最慢。

### 4.2 CPU优化实践

#### 4.2.1 代码向量化和并行化

**向量化**将多个相同操作应用于数据数组,从而提高处理速度。例如,使用NumPy库的vectorize函数可以将一个Python函数向量化。

**并行化**将任务分解为多个同时执行的子任务,从而提高处理速度。Python中可以使用多线程或多进程编程来实现并行化。

```python

import numpy as np

# 向量化

def add_vectors(a, b):

return np.vectorize(lambda x, y: x + y)(a, b)

# 并行化(多线程)

import threading

def parallel_sum(arr):

threads = []

for i in range(len(arr)):

thread = threading.Thread(target=lambda x: arr[x] + 1, args=(i,))

threads.append(thread)

for thread in threads:

thread.start()

for thread in threads:

thread.join()

```

#### 4.2.2 多线程和多进程编程

**多线程**在一个进程中创建多个线程,每个线程独立执行自己的任务。线程共享进程的内存空间,因此通信和同步至关重要。

**多进程**创建一个或多个新的进程,每个进程都有自己的内存空间。进程之间通过进程间通信(IPC)机制进行通信。

```python

# 多线程

import threading

def thread_function(arg):

print(arg)

threads = []

for i in range(5):

thread = threading.Thread(target=thread_function, args=(i,))

threads.append(thread)

for thread in threads:

thread.start()

for thread in threads:

thread.join()

# 多进程

import multiprocessing

def process_function(arg):

print(arg)

processes = []

for i in range(5):

process = multiprocessing.Process(target=process_function, args=(i,))

processes.append(process)

for process in processes:

process.start()

for process in processes:

process.join()

```

# 5. IO优化策略

### 5.1 IO性能影响因素

IO(Input/Output)性能是影响Python程序整体运行效率的重要因素。影响IO性能的主要因素包括:

- **文件系统和存储设备:**不同文件系统和存储设备(如HDD、SSD、NAS)具有不同的读写速度和访问延迟。

- **网络和数据库访问:**网络带宽、延迟和数据库连接池等因素会影响网络和数据库访问的性能。

### 5.2 IO优化技术

为了优化Python程序的IO性能,可以采用以下技术:

#### 5.2.1 缓存和预读

缓存是一种将频繁访问的数据存储在内存中的技术,可以减少对磁盘或网络的访问次数,从而提高IO性能。Python中可以使用以下方法进行缓存:

```python

import functools

@functools.lru_cache(maxsize=128)

def fibonacci(n):

if n < 2:

return n

else:

return fibonacci(n-1) + fibonacci(n-2)

```

这段代码使用`@functools.lru_cache`装饰器对`fibonacci`函数进行缓存,`maxsize`参数指定了缓存中存储的最大值。当函数再次被调用时,如果参数与之前调用相同,则直接从缓存中返回结果,无需重新计算。

预读是一种提前读取数据的技术,可以减少因数据读取延迟而造成的性能瓶颈。Python中可以使用以下方法进行预读:

```python

with open('large_file.txt', 'r') as f:

# 预读文件的前100行

f.seek(0, io.SEEK_SET)

f.read(100)

```

这段代码使用`seek`方法将文件指针移动到文件开头,然后使用`read`方法预读文件的前100行。

#### 5.2.2 非阻塞IO和异步编程

非阻塞IO是一种在数据准备就绪时才执行IO操作的技术,可以避免因IO操作而导致的程序阻塞。Python中可以使用以下方法实现非阻塞IO:

```python

import asyncio

async def read_file(filename):

with open(filename, 'r') as f:

while True:

line = await f.readline()

if not line:

break

# 处理每一行

```

这段代码使用`asyncio`库实现了非阻塞IO,`readline`方法会返回一个协程,该协程在数据准备就绪时才会执行。

异步编程是一种基于事件驱动的编程范式,可以处理多个并发操作。Python中可以使用以下方法实现异步编程:

```python

import asyncio

async def main():

# 创建多个协程

tasks = [asyncio.create_task(read_file(filename)) for filename in filenames]

# 等待所有协程完成

await asyncio.gather(*tasks)

```

这段代码使用`asyncio.create_task`创建多个协程,然后使用`asyncio.gather`等待所有协程完成。

# 6. 其他优化技巧

### 6.1 代码优化最佳实践

除了上述的特定优化技术之外,还有一些通用的代码优化最佳实践可以帮助提高Python代码的整体性能:

- **代码可读性、可维护性和可扩展性:**编写可读、可维护和可扩展的代码至关重要,因为这将使以后的优化和维护变得更加容易。遵循编码约定、使用适当的注释和文档,并保持代码简洁和模块化。

- **性能测试和持续优化:**定期进行性能测试以识别瓶颈并跟踪改进情况。使用性能分析工具(如第 2 章所述)来分析代码并确定需要优化的区域。持续优化是一个持续的过程,需要定期审查和改进代码。

### 6.2 其他优化技巧

以下是一些其他优化技巧,可能适用于特定情况:

- **使用JIT编译器:**JIT(即时编译)编译器可以将Python代码编译为机器码,从而提高执行速度。在某些情况下,这可以显着提高性能,但它也可能增加内存使用量和编译时间。

- **使用类型提示:**类型提示可以帮助Python解释器推断变量和函数参数的类型。这可以提高代码的可读性并允许解释器进行一些优化,例如内联函数和消除不必要的检查。

- **使用并行处理:**对于计算密集型任务,并行处理可以通过利用多核CPU来提高性能。Python提供了多线程和多进程模块,允许您轻松地创建并行代码。

- **使用云计算:**对于大型或资源密集型应用程序,云计算可以提供按需的可扩展计算能力。通过利用云平台,您可以避免管理自己的硬件和基础设施的开销,并根据需要扩展或缩减您的应用程序。

0

0