【Gensim调试技巧】:解决运行错误和性能瓶颈的有效方法

发布时间: 2024-09-30 18:52:09 阅读量: 53 订阅数: 21

gensim_note:中文版gensim用户手册

# 1. Gensim库概述

在自然语言处理(NLP)领域中,Gensim库以其高效的文本处理能力赢得了广泛的用户基础。它专门针对大规模语料库的向量化、主题建模和相似性查询进行了优化。本章我们将概览Gensim的核心功能,并分析其在处理文档集合时所扮演的关键角色。

Gensim的设计理念是为了解决现实世界中的非结构化文本数据问题,尤其是在文本相似性分析、文档主题提取和自然语言理解等方面。它支持多种向量化模型,比如TF-IDF、LSA(潜在语义分析)、LDA(隐含狄利克雷分布)等,并能够通过词嵌入模型来捕捉词和文档的语义信息。

本章将通过基础的使用示例来揭示Gensim的用途,同时为接下来的章节提供必要的理论铺垫。我们将介绍如何安装Gensim,以及如何使用它来进行简单的文本预处理和主题建模,为读者建立对Gensim应用的初步认识。接下来,我们会深入探讨Gensim的高级特性,并逐步展开如何调试和优化Gensim的使用。

```python

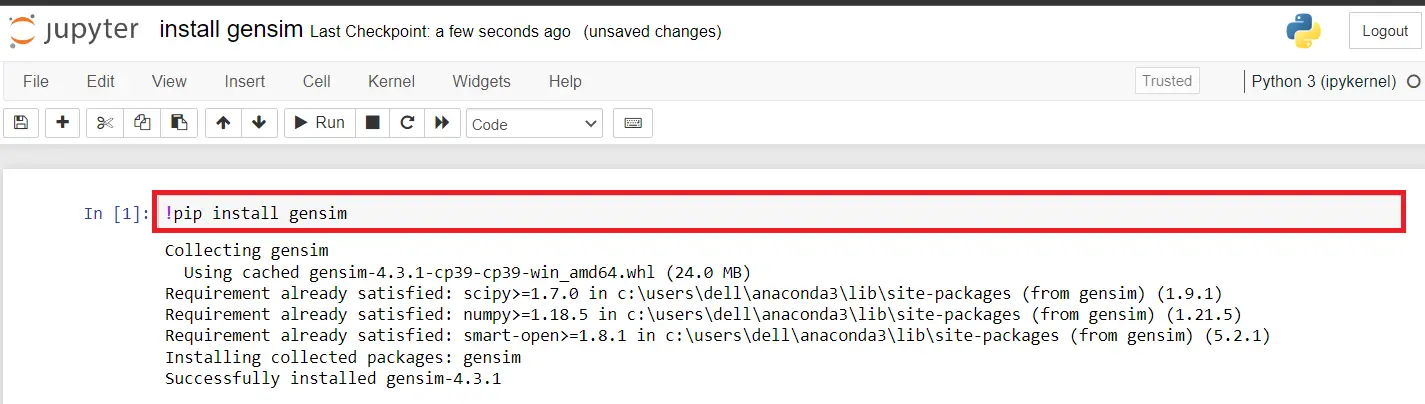

# 示例代码:安装Gensim和基本使用

!pip install gensim

from gensim import corpora, models

# 示例语料库

documents = ["Human machine interface for lab abc computer applications",

"A survey of user opinion of computer system response time",

"The EPS user interface management system"]

# 创建字典和语料库

dictionary = corpora.Dictionary(documents)

corpus = [dictionary.doc2bow(doc) for doc in documents]

# 使用LDA模型

lda_model = models.LdaModel(corpus, num_topics=2, id2word=dictionary, passes=15)

# 打印主题

print(lda_model.print_topics(num_words=4))

```

在上述代码中,我们首先安装了Gensim库,并导入了相关模块。然后定义了一个简单的文本语料库,并创建了一个词典和语料库对象。接着我们用LDA模型生成了两个主题,并打印了每个主题中最重要的四个词。这个例子演示了Gensim在文本处理中的基本应用。随着文章的深入,我们将探索更多的复杂用例和Gensim的高级功能。

# 2. Gensim调试基础

## 2.1 Gensim库的主要组件

### 2.1.1 文档和语料库的处理

处理文本数据是任何自然语言处理项目的第一步,Gensim库提供了多种方式来处理文档和语料库。在这个层次上,Gensim支持从文本文件中读取数据,以及对数据进行预处理,例如分词、去除停用词等。

```python

import gensim

from gensim import corpora

# 示例:从一个简单的文档列表创建语料库

documents = [

"Human machine interface for lab abc computer applications",

"A survey of user opinion of computer system response time",

"The EPS user interface management system",

]

# 分词并创建词袋模型

tokenized-documents = [doc.lower().split() for doc in documents]

dictionary = corpora.Dictionary(tokenized-documents)

corpus = [dictionary.doc2bow(text) for text in tokenized-documents]

# 现在我们有了一个词袋模型的语料库

```

上面的代码中,我们首先将文档文本转换为小写,然后以空格分割字符串进行分词。接着,我们创建了一个字典,它会将每个独特的单词映射到一个唯一的ID上。最后,我们将每篇文档转换为词袋模型。

### 2.1.2 主题建模和向量化

文档向量化是将文本转换为数值形式的过程,这样计算机才能处理。Gensim的LDA模型是一种常用的主题建模技术,它可以识别文档集合中的主题分布。

```python

# 使用LDA进行主题建模

from gensim.models.ldamodel import LdaModel

# 假设我们已经有了上面创建的语料库和字典

lda = LdaModel(corpus=corpus, id2word=dictionary, num_topics=2)

topics = lda.print_topics(num_words=4)

for topic in topics:

print(topic)

```

在这段代码中,我们创建了一个LDA模型,假定有2个主题,然后打印出了每个主题的前4个最相关的词。这是主题建模的一个简单例子,而Gensim库能够以更高级的方式使用,例如增加主题数量、调整模型参数等。

## 2.2 常见Gensim错误类型及分析

### 2.2.1 输入输出错误

Gensim的输入输出错误通常涉及文件格式不匹配、参数设置不当或数据类型错误。识别和解决这些错误的关键在于对输入输出的详细检查和错误信息的仔细阅读。

```python

# 尝试读取不存在的文件将引发IOError

try:

lda = LdaModel.load("non_existing_file")

except FileNotFoundError as e:

print(f"Error: {e}")

```

在这个例子中,我们尝试加载一个不存在的文件,这将导致`FileNotFoundError`异常。在处理Gensim库时,确保提供正确的文件路径和格式是非常重要的。

### 2.2.2 计算错误和资源限制

在处理大规模数据集时,可能会遇到计算错误或资源限制的问题。这通常发生在系统内存不足或处理时间过长的情况下。

```python

# 示例:在小内存环境中使用Gensim

try:

very_large_corpus = ... # 假设这是一个非常大的语料库

large_lda_model = LdaModel(corpus=very_large_corpus, num_topics=10)

except MemoryError as e:

print(f"MemoryError: {e}")

```

上面的代码示例展示了处理大规模数据时可能遇到的`MemoryError`。在实践中,我们可能需要考虑使用内存优化技术,比如使用分批处理数据,或者采用分布式计算解决方案。

## 2.3 Gensim性能分析基础

### 2.3.1 性能评估指标

性能评估在调试中非常重要,它可以帮助我们衡量Gensim模型的效率和效果。常用的评估指标包括模型训练的时间、模型大小以及预测或主题建模的准确性。

```python

import time

# 记录训练开始时间

start = time.time()

# ... 在此执行模型训练 ...

# 记录训练结束时间

end = time.time()

# 计算并打印训练时间

print(f"Model training took {end - start} seconds.")

```

在这个例子中,我们通过记录模型训练前后的时间差来评估模型的训练时间。对于主题模型的评估,我们还可以使用困惑度(perplexity)等指标。

### 2.3.2 资源占用和瓶颈识别

资源占用和瓶颈识别需要我们对Gensim的资源使用情况进行监控。Gensim提供了多种方式来获取模型状态信息,比如`getsizeof`函数可以用来估算模型占用的内存量。

```python

from sys import getsizeof

# 获取模型占用的内存量

model_memory_usage = getsizeof(large_lda_model)

print(f"Model memory usage: {model_memory_usage} bytes")

```

通过这个代码示例,我们使用了Python内置的`getsizeof`函数来估计`lda_model`的内存占用量。对于性能瓶颈的识别,通常需要结合程序运行时间的日志记录、内存分析工具(比如Python的`memory_profiler`库)和CPU使用率监控。

本章节介绍了Gensim库的主要组件、常见错误类型及其分析以及性能分析基础。通过这些内容,读者可以对Gensim有一个初步的理解,并且能够解决一些常见的问题。在下一章节,我们将深入探讨Gensim调试的实践技巧和方法。

# 3. Gensim调试实践

## 3.1 调试技巧和工具选择

在面对复杂的自然语言处理任务时,熟练的调试技巧以及恰当的工具选择是确保程序顺利运行和性能优化的关键。本节将详细讨论如何通过日志记录和分析、使用调试器及性能分析工具来提高调试效率。

### 3.1.1 日志记录和分析

日志记录是调试过程中的基础,它能够记录程序执行过程中的关键信息。合适的日志记录策略能够帮助开发者快速定位问题所在,并理解程序的执行流程。以下是几个关于如何有效使用日志的建议:

- **日志级别**:合理设置日志级别(如DEBUG、INFO、WARNING、ERROR)可以帮助开发者在不同的调试阶段获取关键信息。在开发阶段使用DEBUG级别的日志可以记录尽可能多的信息,而在线上环境可能只保留ERROR级别的日志以减少干扰。

- **日志格式**:日志格式应该清晰明了,包括时间戳、日志级别、模块信息、消息内容等。这有助于快速分析问题发生的时间和上下文。

- **日志轮转**:为了避免日志文件无限制增长,应该实现日志轮转机制。常用工具如logrotate能够自动管理日志文件的轮转和归档。

下面是一个简单的Python日志记录代码块示例:

```python

import logging

def setup_logging(default_path='logging_config.ini', default_level=***):

"""

Setup basic logging configuration

"""

path = default_path

if os.path.exists(path):

section = 'loggers'

try:

config = ConfigParser()

```

0

0